다채널 XR Live 스튜디오 구축 및 효율적 운영 방안 연구

초록

최근 엔터테인먼트 산업은 기술적 진보가 가속화됨에 따라 변화의 폭이 커지고 있으며, 가상현실(VR), 증강현실(AR), 혼합현실(MR) 등 실감형 콘텐츠 기술이 중심에 서고 있다. 이러한 기술들을 아우르는 확장 현실(XR)은 디지털 세계와 물리적 세계의 경계를 허물어 사용자의 몰입감을 극대화하는 것을 목적으로 한다. 본 연구에서는 현재 국내외에서 운영 중인 XR 제작 스튜디오의 구조와 기술적 환경을 면밀히 조사하고 분석하여, 방송사의 특성과 필요에 부합하는 다채널 XR live 스튜디오 설계를 위해 필요한 기술 및 구조적인 요소들을 제안한다. 또한, 효율적인 XR 스튜디오의 운영 지원에 필요한 인력 구성과 역할에 대하여도 정리하여, 콘텐츠의 품질을 높이고 XR 스튜디오의 운영 효율성 개선에 도움이 될 것으로 기대된다.

Abstract

Recently, the scope of change in the entertainment industry is increasing as technological progress accelerates, and realistic content technologies such as Virtual Reality(VR), Augmented Reality(AR), and Mixed Reality(MR) are taking center stage. Extended Reality(XR), which encompasses these technologies, aims to maximize user immersion by breaking down the boundaries between the digital world and the physical world. In this study, we closely investigate and analyze the structure and technical environment of XR production studios currently operating at home and abroad, and propose the technical and structural elements necessary to design a multi-channel XR live studio that meets the characteristics and needs of broadcasters. In addition, this study is expected to help improve the content quality and operational efficiency of the XR studio by organizing the personnel and roles required to support the efficient operation of the XR studio.

Keywords:

XR, eXtended reality, immersive content, multi-channel XR studio, LED wall, media serverⅠ. 서 론

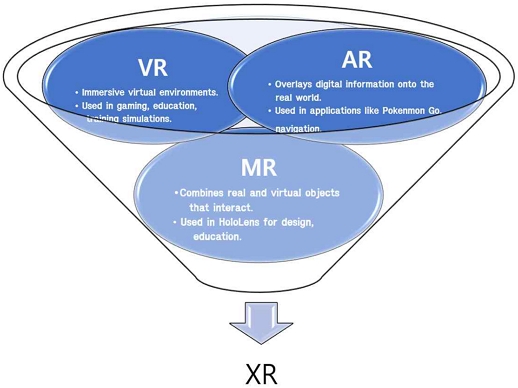

XR는 메타(Meta)에서 마크 저커버그가 가상 공유 공간에서 다양한 활동하는 형태인 메타버스(Metaverse) 계획을 발표 후에 지속적인 관심이 더해졌다. XR은 방송 콘텐츠만 아니라 의학, 여행, 교육, 쇼핑 분야 등 다양한 방법으로 우리의 삶에 많은 영향을 줄 것으로 예상된다. 이를 바탕으로 방송업계에서도 가상현실(VR, Virtual Reality), 증강현실(AR, Augmented Reality), 혼합현실(MR, Mixed Reality) 등의 실감 콘텐츠 제작에 관심이 점점 높아지고 있으며, 이러한 기술들은 방송사에서도 새로운 형태의 콘텐츠 제작 및 제공 방식으로 변화되기를 요구받고 있다. 그림 1은 XR의 기본 개념을 시각화한 것이다[1]-[4].

방송사들은 기존의 XR 제작 환경이 가지고 있는 후반 작업을 통한 콘텐츠 제작 또는 단일카메라 방송 제작 한계를 넘어 기술적 변화를 통해 멀티 카메라 Live 제작 환경으로 콘텐츠 제작 효율성을 높이고자 한다. 또한, 시청자들에게 더욱 몰입감 있는 경험을 제공하도록 요구받고 있다[5]. 본 연구는 방송사나 제작사가 운영하던 기존 XR 제작 환경을 바탕으로, 새로운 방식의 멀티 채널 XR live 제작 스튜디오 구축 및 운용 인력에 관한 것이다. 연구를 통해 향후 스튜디오 운영의 효율성을 높이고, 실감 콘텐츠 제작의 질적 향상을 위한 새로운 시스템 설계와 인력 운용 방안을 제시하는 것을 목적으로 한다.

본 연구는 현재 XR 제작 스튜디오의 구축 및 운용 현황을 파악하고, 방송사의 특성에 맞는 스튜디오 환경 설계에 필요한 요소들을 분석한다. 이를 위해 국내외 XR 스튜디오의 사례를 조사하고, 주요 기술적 요구 사항과 인력 구성 방안을 도출하고자 한다. 연구 방법으로는 문헌 조사, 사례 분석을 활용하여 VR 및 AR 기술이 방송 제작 환경에 미치는 영향을 분석하고, 이를 바탕으로 최적의 XR live 스튜디오 운영 모델을 제안한다. 관련 분야의 기존 연구 논문, 산업 보고서, 기술 백서 등을 광범위하게 검토하여 XR 스튜디오 구축 및 운영에 관한 이론적 배경과 현재의 기술 동향을 파악하며, 성공적인 국내외 XR 스튜디오 사례를 선정하여 그들의 운영 모델, 기술 구성 등을 분석한다. 이러한 종합적인 접근 방법을 통하여 XR live 스튜디오의 구축 및 운영에 필요한 심층적인 이해를 제공하며, 방송사가 혁신적인 방송 환경을 설계하고 구현하는 데 중요한 지침이 될 것으로 판단된다.

Ⅱ. 기존 XR 스튜디오 활용 분석

2.1 실감 콘텐츠 기술

실감 콘텐츠 기술은 사용자에게 가상의 환경이나 정보를 통해 실제와 같은 경험을 제공하는 기술로 가상현실(VR), 증강현실(AR), 혼합현실(MR), 그리고 홀로그램(HR) 등 여러 형태로 나누어진다. 이 중 XR은 이러한 모든 기술을 아우르는 포괄적인 개념으로, 디지털 세계와 물리적 세계가 서로 연결되어 사용자에게 깊은 몰입감을 느낄 수 있게 한다. XR 기술은 특히 LED wall과 크로마키를 활용하여 실제 공간에 디지털 콘텐츠를 결합하는 방식으로 구현되며, 이를 통해 생생한 가상현실 경험이 가능하게 한다. 이 기술들은 광고, 영화, 방송 콘텐츠, 의료 및 쇼핑 등 다양한 미디어 콘텐츠 제작에 활용되어 감각적인 시청 경험 제공에 중요한 역할을 한다[6][7].

2.2 XR 스튜디오의 정의 및 분류

XR 스튜디오는 제작 목적에 따라 다양한 방식으로 분류된다. 주로 두 가지 주요 유형으로 나눌 수 있는데, 첫 번째는 live 프로덕션 스튜디오로, 이는 실시간 방송 제작에 사용된다. 실시간 스포츠 이벤트, 뉴스 방송, 라이브 엔터테인먼트 프로그램 등이 여기에 해당한다. 두 번째 유형은 포스트 프로덕션 스튜디오로, 광고, 영화, 드라마 등의 콘텐츠에 특수 효과를 추가하는 데 주로 사용된다. 이러한 스튜디오는 후반 작업에 필요한 고급 편집 및 효과 적용 작업을 위해 설계되었다[6]. XR 스튜디오의 시스템 구성에 따라 또 다른 분류가 가능하다. 크로마키 기반 스튜디오와 LED wall 기반 스튜디오가 그것으로, 각각의 시스템은 제작의 목적, 비용 및 기술적 요구 사항을 고려하여 선택한다. 크로마키 스튜디오는 비교적 저렴한 비용으로 다양한 가상 배경을 신속하게 적용할 수 있는 반면에, LED wall 기반 스튜디오는 비교적 높은 비용이 들지만, 사용자와 배우가 실시간으로 환경을 볼 수 있어 몰입감과 상호작용이 뛰어난 장점이 있다. 일부 대형 XR 스튜디오에서는 이 두 가지 시스템을 모두 갖추고 있어, 프로젝트의 요구에 따라 유연하게 환경을 조정할 수 있다[8].

2.3 국내 XR 스튜디오 현황

국내 XR 스튜디오는 주로 포스트 프로덕션 개념으로 구축되어 광고, 영화, 드라마의 특수 효과 촬영에 사용되고 있다. 표 1에 나타낸 것처럼, 엑스온 스튜디오(XON studios)는 LED wall을 활용한 드라이빙 컴프 스테이지 시스템에 특화되어 있으며, 자이언트 스텝(Giant step) 스튜디오는 크로마키와 LED wall을 동시에 구축하여 다양한 환경에 맞게 활용하고 있다. 이러한 스튜디오들은 대부분 영화 장비사나 제조사와의 협업을 통해 관련 장비들을 개발하고 도입하여 활용하고 있다. 또한, 비브 스튜디오스(Vive studios)는 자체 제작 통합 제어 솔루션(VIT)을 개발하여 현실감 있는 가상 세계를 구현하는 데 주력하고 있으며, 다양한 다큐멘터리와 방송 프로그램 제작에 활용되고 있다. 국내의 주요 XR 스튜디오들은 대부분 LED wall과 크로마키 기술을 조합하여 활용하고 있으며, 향후 XR 기술의 발전에 따라 더욱 다양한 응용이 가능할 것으로 기대된다. VA corporation의 하남 studio는 아시아 최대 규모의 버추얼 프로덕션 스튜디오로, 영화, 드라마, 광고, 라이브 커머스 등 다양한 메타버스 콘텐츠를 제작할 수 있는 환경을 제공하고 있다. 이 스튜디오는 넷플릭스와의 파트너십을 통해 글로벌 콘텐츠 제작에도 적극적으로 참여하고 있다[9].

2.4 해외 XR 스튜디오 현황

해외에서 XR 스튜디오의 구축과 운영은 혁신적인 기술의 적용을 통해 빠르게 진화하고 있으며, 특히 엔터테인먼트 및 방송 산업에서 주목할 만한 발전이 이루어지고 있다. 디즈니와 산하의 ILM (Industrial Light & Magic)이 개발한 StageCraft 기술은 ‘스타워즈 만달로리안' 시리즈 제작에 사용되어 크게 주목받았다. 이 기술은 대규모 LED wall을 사용하여 실시간으로 다양한 배경을 제공하며, 배우들이 물리적인 세트에서 연기하는 동안 가상 세계를 실시간으로 경험할 수 있게 함으로써 제작 과정에서의 몰입감과 상호작용을 극대화한다. 또한, unreal engine을 활용하여 복잡한 가상 환경을 실시간으로 렌더링하며, 제작 비용을 절감하고 제작의 유연성을 증대시킨다.

Epic games의 unreal engine은 XR 스튜디오에서 널리 사용되는 강력한 게임 엔진으로, 실시간 3D 제작 도구로 활용되고 있다. 다양한 방송 및 영화 프로젝트에서 unreal engine을 이용하여 실시간 시각 효과를 제공하며, 제작자들이 더 신속하게 시각적 내용을 수정하고, 현장에서 즉각적인 피드백을 반영할 수 있게 해준다. Unreal engine은 복잡한 라이팅, 텍스처링, 물리 시뮬레이션을 실시간으로 처리할 수 있는 능력을 갖추고 있어, XR 스튜디오에서의 콘텐츠 제작을 혁신적으로 변화시키고 있다[10][11].

2.5 기존 XR 스튜디오 필수 구축 요소

XR 스튜디오를 운영하기 위해서는 필수적인 시스템 요소들이 필요하다. 여기에는 미디어 서버, LED wall, 크로마키 스크린, 카메라 트래킹 시스템, 동기화 장비(Genlock) 등이 포함된다. 미디어 서버는 사전 제작된 그래픽을 디스플레이하고, LED wall과 크로마키 스크린은 가상 배경을 제공하며 카메라 트래킹 시스템은 카메라의 위치와 움직임을 추적하여 가상 환경과의 일치를 유지하며, 동기화 장비는 모든 장비의 동기화를 유지하여 영상의 싱크 에러 등을 방지하는 요소이다.

Media server의 기능은 LED wall이나 크로마키 스크린을 통해 사전 제작된 그래픽을 표시하는 데 사용되는 서버이다. 이 서버는 AR 그래픽을 표출하는 기능도 포함하며, 사용 목적에 따라 카메라 별로 또는 통합적으로 운영할 수 있다. 대부분의 media server는 unreal engine 그래픽이나 unity 그래픽을 지원하며, 제품에 따라서는 자체 제작 프로그램을 함께 운영할 수 있다.

주요 기능으로는 다음과 같다.

- LED, chroma screen volume 구성

- LED wall output

- Virtual set graphic mapping

- 3rd party device integration

- VR graphic mapping

- Tracking

- Calibration

- Scene time line

- Snap shot memory

- Scene switching

이러한 기능들은 미디어 서버가 복잡한 시각적 요구사항을 충족시키고, 다양한 방송 및 엔터테인먼트 환경에서 효율적으로 활용될 수 있게 한다.

기존 영화 제작 현장에서는 흔히 chroma-key라 불리는 기술을 사용하여, 초록색 배경에서 촬영한 후 CG를 입히는 방식으로 현실에서 구현하기 힘든 장면들을 촬영하였다.

다음의 표 2는 chroma-key와 LED wall 방식의 장단점 및 특징을 정리하여 나타낸 것이며, 그림 2는 chromakey 방식의 스튜디오 구조이다[12].

그림 3은 LED wall 방식의 일반적인 구조이며, 스튜디오 XR용 LED 패널은 주파수 비율에 대하여 매우 구체적인 요구사항을 갖는다. 일반적으로 LED 표시 속도는 50~60Hz 범위에서 3,840Hz, 4,800Hz, 또는 7,680Hz이다. 리프레시 레이트는 촬영 카메라와의 호환성도 중요한데, 이는 포스트 프로덕션 및 방송용 카메라의 사양과 함께 검토되어야 한다. 스캔 드라이브 모드에서는 1/16 또는 1/32를 사용하며, LED 소자의 픽셀 크기는 제작하는 콘텐츠에 따라 달라질 수 있으며, 대략 1.0mm에서 2.7mm 사이의 메인 월 픽셀 크기와 2.5mm에서 3.5mm 사이의 바닥 및 천장 LED 픽셀 크기를 권장한다. 이는 제작 콘텐츠 및 사용 목적에 따라 매우 중요하며, 스튜디오 공간 크기와도 밀접한 관계가 있다[5][6].

LED 패널의 유형은 2세대 rental cabinet 타입의 트러스 타입으로 설치하는 것이 다양한 LED wall volume 디자인 구성에 적합하다. LED 컨트롤러 및 데이터 분배 장치는 모든 비디오 신호를 수집하여 LED wall에 표시한다. HDMI, DisplayPort 또는 12G SDI 연결을 사용하여 4K 이상의 해상도를 준수해야 한다. 이 장비는 genlock을 필요로 한다.

LED 프로세서는 여러 캐비닛을 하나의 이미지로 표시할 수 있는 배열로 결합하는 하드웨어 및 소프트웨어다. LED 프로세서는 대형 LED 스테이지에서 10개 이상의 프로세서를 사용하여 하나의 심리스 LED 벽을 구현할 수 있다. 이 배열을 통해 원하는 구성으로 캐비닛을 배열할 수 있다.

추적 시스템은 두 가지 방식, 광학 유형(Optical type system)과 엔코더 유형(Encoder type system)으로 데이터를 수신할 수 있다. 두 방식 모두 각각의 장단점을 가지고 있다. 현재 live 방송에서는 엔코더 방식이 널리 사용되고 있는데, 이 방식에서는 트라이포드에 엔코더를 설치하여 위치 정보를 검출한다. 또한, 카메라의 줌 정보 등은 Free D 프로토콜을 이용하여 수집한 후, 실시간으로 언리얼 엔진(Unreal engine) 내의 가상공간 속 위치와 동기화하여 카메라의 구도와 화각에 따라 가상 환경 배경을 미디어 서버를 통해 LED wall로 송출한다. 미디어 서버는 각 카메라로부터 Zoom, Pan Tilt, X, Y, Z축 이동 데이터 등의 트래킹 신호를 수신할 수 있다. 수신된 데이터는 3D 그래픽의 위치 데이터와 결합하여 최종적으로 배경 및 AR 그래픽을 이동시킬 수 있다. 이 과정을 통해 가상 환경은 사용자에게 강한 몰입감을 제공하게 된다. 그림 3은 트라이포트와 로보틱스 크레인 사진이다.

XR용 모든 디바이스는 하나의 동기신호를 필요로 하며, 이를 위하여 Genlock이 필요하다. 특히 3rd Party 장비 간의 연결에서 동기화가 이루어지지 않으면 화면 전환 시 여러 부분에서 화면 오류가 발생할 수 있다. 이를 방지하기 위해 카메라, LED 컨트롤러, 미디어 서버, 라우터 등 모든 기기에 동기화를 적용해야 한다. 장비 간의 정확한 동기화는 시스템 전체의 일관성을 유지하고, 원활한 운영을 가능하게 한다.

모든 카메라는 동일한 레이턴시를 사용해야 요구하는 가상공간의 화면을 제대로 제공할 수 있다. 다른 카메라 모델은 각기 다른 레이턴시를 의미하게 되므로, 이를 해결하기 위해 롤링셔터 방식이 아닌 글로벌 셔터 방식의 전자셔터 방식 카메라를 선호한다. 만약 설정에 다른 카메라 모델이 포함된 경우, 모든 카메라의 영상 출력을 가장 느린 카메라에 맞추어 동기화하기 위해 딜레이를 추가하는 작업이 필요하다. 모든 카메라는 Genlock을 통해 동기화되어야 한다. 표 3은 롤링 셔터와 글로벌 셔터 방식의 카메라 장단점을 비교한 것이다.

2.6 기존 XR 스튜디오의 한계

Live 방송에서 XR 스튜디오 제작 환경에는 여러 한계점이 존재한다.

첫째, 기술적 한계가 있다. XR 기술을 먼저 접목했던 POST 스튜디오에서의 방식을 live 방송 환경으로 접목하려다 보니 기본적인 live 방송 제작 운영 워크프로우, 촬영 카메라 및 렌즈의 환경, 트레킹 방식 그리고 해상도의 문제, 멀티카메라 운영, 비상시 대처 방식 등의 기술적 요소의 한계가 있다. 둘째, 소프트웨어 및 시스템 제한이 있다. 기본적인 XR 제작 및 운영 그래픽 소프트웨어인 unreal engine은 live 환경에 적합지 않다. 즉각적인 대처가 어렵고 epic mega grants에 등록된 여러 플러그인 프로그램을 사용해야만 그나마도 live 방송 환경에 적용이 가능하다. 또한 Post 환경에서처럼 시간을 여유롭게 잡고 그래픽이 LED Wall이나 크로마 스크린과 합성되는 시간을 기다릴 수 없는 시스템적 제한이 있다. 셋째, 비용 문제도 중요한 한계점이다. 특히 대형 LED wall의 도입은 상당한 부담이 아닐 수 없으며, 그 때문에 여전히 크로마 스크린을 이용하는 방법이 있으나, live 방송 프로그램에 따라서는 이 또한 이용이 어렵다. 또한, 이를 관리하고 운영하기 위해서는 숙련된 기술 인력이 필요하며, 지속적인 교육과 훈련이 필요하다. 여전히 XR 제작에 숙련된 엔지니어나 제작자를 찾기 어려우며, 그 인원을 고용 유지하는 것도 매우 부담이 아닐 수 없다. 넷째 콘텐츠 제작 및 운영 측면에서도 한계가 존재한다. live 방송에서 고품질의 XR 콘텐츠를 실시간으로 제작하는 것은 많은 인력과 시간을 요구하며, 예기치 않은 문제들이 발생할 가능성이 높다. 방송 중 시스템 오류나 장비 문제로 인해 방송이 중단될 수 있으며, 이는 시청자에게 큰 불편을 초래하고 방송사의 신뢰도를 떨어뜨릴 수 있다.

Ⅲ. 신규 다채널 XR live 스튜디오 구축

새로운 방식의 다채널 XR live 스튜디오 구축을 위해서는 고도의 기술적 요구 사항이 충족되어야 한다. 먼저, 높은 해상도의 LED wall이 필수적이다. LED wall은 최소 3,840Hz 이상의 표시 속도를 가져야 하며, 픽셀 피치는 1.0mm에서 2.7mm까지 다양하게 지원되어야 한다. 이는 높은 주사율과 미세한 픽셀 피치가 몰입감 있는 시청 경험을 제공하기 위해 필요하다. 정확한 카메라 트래킹 시스템 또한 필수적이다. 카메라 트래킹은 옵티컬 방식 트래커 또는 엔코더 방식 트래커를 용도에 맞게 사용하여 정확한 위치 데이터를 제공해야 한다. 옵티컬 트래커는 카메라의 위치와 움직임을 고해상도로 추적할 수 있으며, 엔코더 방식 트래커는 기계적 움직임을 정밀하게 측정할 수 있다. 이러한 트래킹 시스템은 카메라의 이동에 따라 가상 환경을 자연스럽게 조정하는 데 필수적이다. 또한, 낮은 레이턴시와 강력한 media server가 필요하다. media server는 고성능 그래픽 엔진을 지원해야 하며, 특히 unreal engine과 같은 엔진을 지원하는 것이 중요하다. unreal engine은 실시간으로 고품질의 그래픽을 생성할 수 있어 XR 환경에서 자주 사용된다. 더불어, media server는 Free-D와 같은 실시간 데이터 프로토콜을 지원해야 한다.

Free-D 프로토콜은 카메라 트래킹 데이터를 실시간으로 전달할 수 있어, 가상 환경의 동기화와 조정을 용이하게 한다. 따라서, 다채널 XR live 스튜디오의 성공적인 구축을 위해서는 고해상도의 LED wall, 정밀한 카메라 트래킹 시스템, 낮은 레이턴시, 그리고 강력한 media server가 필요하며, 각각의 요소는 상호 유기적으로 작용하여 고품질의 XR 경험을 제공한다. 이러한 기술적 요구 사항들은 몰입감 있고 일관된 시청 경험을 보장하기 위해 필수적이다.

3.1 신규 Media server 구축 및 제작 과정

XR 제작을 할 때 가장 먼저 고려해야 할 요소는 촬영 환경이다. 일반적으로 POST 환경에서는 하나의 카메라로 촬영을 진행하며, 촬영 중 NG가 발생하면 다시 촬영할 수 있는 유연성이 있다. 반면 live 환경에서는 TV 제작을 기준으로 다수의 멀티 카메라를 동시에 운영하며, NG가 발생해도 촬영을 중단할 수 없고 계속 진행해야 한다. 따라서 media server가 어느 제작 환경에 중점을 두고 있는지는 매우 중요한 요소이며, 이러한 이유로 media server의 운영 방식도 크게 달라질 수밖에 없다.

Live 환경에서의 media server 운영 방법은 크게 두 가지로 나눌 수 있다. 첫 번째 방법은 1:1 멀티 서버 운영 방식이다. 이 방식은 live 환경 제작 시 투입되는 카메라 수에 맞춰 각각의 media server를 1:1로 연결하고, 관리자 PC의 프로그램으로 제어하는 방식이다. 이 방식의 장점은 live 제작 환경에서 안정성을 극대화할 수 있다는 점이다. 그러나 개별적으로 한 대씩 연결하기 때문에 비용적인 부담이 크다는 단점이 있다. 두 번째 방법은 통합 media server 운영 방식이다. 이 방식은 최소한의 media server로 여러 대의 카메라를 운영하는 현실적인 방법이다. 그러나 이 경우, 해당 방식이 원하는 프로그램 제작에 적합한지 반드시 검토해야 한다. 구체적으로, 하나의 media server가 수용할 수 있는 카메라의 수, 카메라의 트래킹 데이터를 개별적으로 받을 수 있는지, 내부적으로 비디오 스위칭 역할을 할 수 있는지, 스위칭 기능이 있다면 각 카메라의 PVW 모니터링과 XR 합성 PVW 모니터링이 가능한지, media server의 main & backup 기능이 가능한지, 그리고 위기 상황에 대처할 수 있는지 등을 살펴보아야 한다. 이와 같은 요소들은 live 환경에서 media server의 운영 방식에 큰 영향을 미치며, 각 방식의 장단점을 고려하여 적합한 방법을 선택해야 한다.

일반적인 XR live 프로그램 제작 과정은 기획 및 준비, 세트 구축 및 장비 설치, 가상 환경 준비, 촬영 및 실시간 합성, 후반 작업, 배포 및 피드백의 단계로 구성된다. 먼저, 프로그램의 목적, 대상 시청자, 주요 장면 및 효과를 구체화하고, LED wall 또는 chroma 스크린, 카메라, 트래킹 시스템, 조명 장비 등을 준비한다. LED wall의 크기, 해상도, 배치를 결정하고, 소프트웨어와 하드웨어의 호환성을 점검하며, 제작팀을 구성한다.

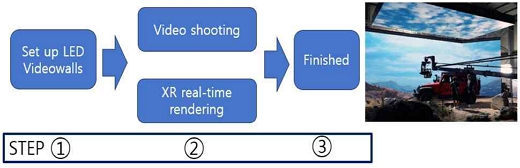

LED wall을 설치하고 카메라 및 트래킹 시스템을 배치하며, 조명을 LED wall의 밝기와 색온도에 맞춰 조정하여 실제 환경과 가상 환경이 자연스럽게 결합되도록 한다. 가상 환경과 오브젝트를 3D로 모델링하고 애니메이션을 제작하여, 이를 LED wall에 표시될 가상 환경으로 설정한다. 촬영 시, 카메라 트래킹 시스템을 통해 실시간으로 가상 환경과 실제 환경을 합성하며, 필요시 즉시 조정하여야 한다. 후반 작업으로 촬영된 영상을 편집하고 색 보정 및 VFX 작업을 진행하며, 오디오를 추가한다. 최종 결과물을 검토하고 배포 준비를 마친 후, 유튜브, TV, 스트리밍 서비스 등 다양한 플랫폼에 배포하고 시청자로부터 피드백을 수집하여 개선점을 도출한다. 이러한 과정은 XR live 프로그램 제작의 효율성을 높이고, 시청자에게 몰입감 있는 경험을 제공한다. 그림 4는 LED wall를 활용한 XR 프로그램 제작 과정을 간단하게 정리한 것이다.

3.2 신규 다채널 XR live 스튜디오 시스템 설계

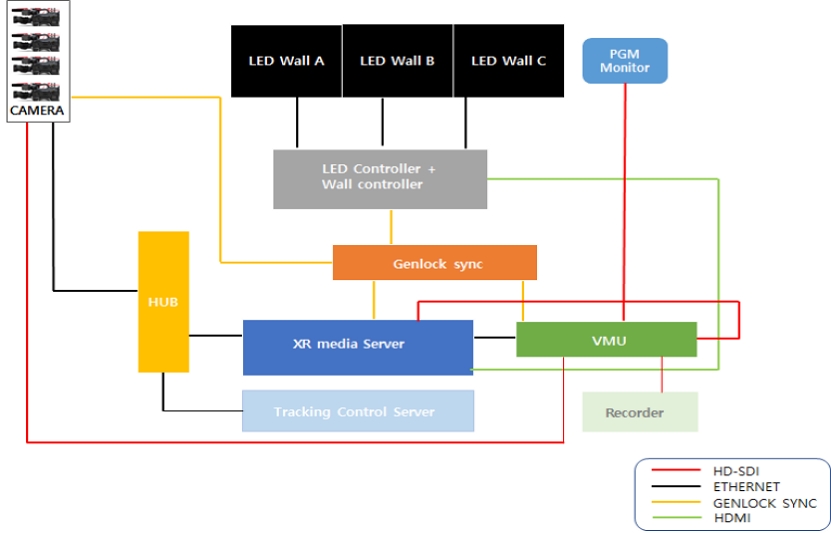

다채널 XR live 스튜디오는 그림 5와 같이 LED wall을 중심으로 다양한 장비와 시스템이 유기적으로 연결된 구조로 구성된다. 이 시스템은 시청자에게 몰입감 있는 경험을 제공하기 위해 고도의 기술적 통합이 필요하다. 다수의 카메라가 다양한 각도에서 촬영을 진행하며, 각 카메라에서 생성된 영상 신호와 트래킹 데이터는 HUB를 통해 XR media server와 트래킹 컨트롤 서버로 전달된다. 이때 각 카메라는 HD-SDI(고화질 시리얼 디지털 인터페이스) 케이블을 사용하여 고화질의 디지털 영상 신호를 전송한다. 카메라의 신호가 HUB에 모인 후, 이 신호들은 두 가지 주요 서버로 분배된다. 첫 번째 서버는 트래킹 컨트롤 서버이다. 트래킹 컨트롤 서버는 카메라의 위치와 움직임을 실시간으로 추적한다. 이 서버는 카메라의 위치 데이터를 XR media server로 전달하며, 이를 통해 가상 환경이 카메라의 움직임에 맞춰 자연스럽게 변화할 수 있도록 한다. 예를 들어, 카메라가 좌측으로 이동하면 가상 환경도 그에 맞춰 동일하게 이동하여 일관된 시각적 경험을 제공한다. 두 번째 서버는 XR media server이다. XR media server는 가상 환경을 생성하고 이를 LED wall에 출력하는 역할을 한다. 이 서버는 가상 환경이 물리적 환경과 원활하게 통합될 수 있도록 복잡한 계산과 그래픽 처리를 수행한다. 또한, genlock sync를 통해 모든 장비의 타이밍을 동기화하여 영상과 오디오의 일관성을 유지한다. Genlock sync는 각 장비의 타이밍을 정밀하게 맞추어 영상의 끊김이나 어긋남을 방지하는 기술이다.

LED wall은 A, B, C 세 개의 벽으로 구성되며, 각 벽은 LED 컨트롤러와 Wall 컨트롤러에 의해 제어된다. LED wall은 가상 환경을 시각적으로 표현하는 핵심 요소로, 트래킹 컨트롤 서버와 XR 미디어 서버로부터 전달받은 데이터를 바탕으로 실시간으로 변화를 반영한다. LED 컨트롤러는 LED 패널의 밝기와 색상을 조절하며, wall 컨트롤러는 전체 벽의 이미지를 통합하여 하나의 큰 화면으로 구성한다. VMU(영상 소스 통합 장치)는 다양한 영상 소스를 통합하여 최종 출력 영상을 생성하는 장치이다. VMU는 각 카메라와 서버로부터 받은 영상을 결합하여 하나의 완성된 영상으로 출력한다. 이 출력 영상은 PGM 모니터와 레코더로 전달된다. PGM 모니터는 최종 출력을 실시간으로 모니터링하여 이상이 없는지 확인하며, 레코더는 영상을 고해상도로 저장한다. 각 장비 간의 연결은 HD-SDI, 이더넷, genlock sync, HDMI 케이블을 통해 이루어진다. HD-SDI는 고화질의 디지털 영상 신호를 전송하며, 이더넷은 데이터 통신을 담당한다.

Genlock sync는 모든 장비의 타이밍을 동기화하여 영상과 오디오의 일관성을 유지하며, HDMI는 고해상도의 비디오와 오디오를 전송한다. 이러한 구조를 통해 XR 라이브 스튜디오는 다양한 각도에서 촬영된 영상을 실시간으로 합성하고, 고품질의 가상 환경을 출력할 수 있다. 모든 구성 요소가 유기적으로 연결되어 일관된 영상을 제공함으로써 시청자에게 몰입감 있는 경험을 선사한다. 이 시스템의 설계는 최신 기술과 정교한 통합 작업을 기반으로 하여 높은 수준의 영상 제작을 가능하게 한다.

3.3 XR live 스튜디오 효율적 인력 구성 방안

XR 스튜디오의 운영을 위해서는 다양한 전문 인력이 필요하다. 버추얼 프로덕션 슈퍼바이저, 프로듀서, 오퍼레이션 팀, 인프라 시스템 팀, 디지털 인터미디어트(DI) 팀 등으로 구성되며, 각 팀은 특정 역할과 책임을 나누어서 담당하게 한다.

각 팀은 자신들의 역할에 따라 효율적인 XR 스튜디오 운영을 위해 긴밀히 협력해야 한다.

특히, 버추얼 프로덕션 슈퍼바이저와 프로듀서의 역할은 프로젝트의 성공적인 완수를 위해 매우 중요하다. 이들은 전체 프로젝트를 조율하고, 각 부서 간의 원활한 소통을 책임진다. 다음은 각 인력 구성과 역할에 대하여 정리한 것이다.

버추얼 프로덕션 슈퍼바이저: 현장 촬영과 프로젝트 전반을 감독하며, 전체적인 제작 과정을 관리한다. 이들은 가상 환경과 실제 환경을 통합하여 원활한 촬영을 지원한다.

버추얼 프로덕션 프로듀서: 프로젝트 계획을 조율하고, 예산 관리, 일정 조정, 팀 간 협력 등을 통해 프로젝트를 성공적으로 마무리한다. 이들은 모든 단계에서 프로젝트의 진행 상황을 모니터링하며, 필요한 자원을 적절히 배분한다.

버추얼 프로덕션 오퍼레이션 팀: 하드웨어와 소프트웨어 기반의 가상 제작 시스템을 운용한다. 이들은 시스템 설치, 유지보수, 실시간 문제 해결 등을 담당하여, 제작 과정이 원활히 진행되도록 지원한다.

버추얼 프로덕션 인프라 시스템 팀: 스튜디오 시설의 유지보수와 네트워크 관리를 담당한다. 이 팀은 스튜디오의 물리적 환경과 기술 인프라를 관리하며, 안정적인 운영을 보장한다.

디지털 인터미디어트(DI) 팀: 실존 환경과 가상 환경의 색감을 확인하고 조정한다. 이들은 촬영된 영상과 가상 그래픽이 자연스럽게 조화되도록 색 보정 작업을 수행한다.

그러나, TV 방송사에서는 상기 언급된 인력 구성에는 현실적인 어려움이 따른다. 따라서 live 방송용 XR 제작은 기존 제작 인력을 최대한 활용하여야 할 필요가 있으며, 효율적인 인력 배치 방안이 우선 필요하게 된다. 여기서 각자의 제작 인력의 기능을 약간만 추가하고, 최소한의 관련 분야 교육을 통해 현재 제작 인력으로 XR 스튜디오 운영이 가능할 것이다. 특히, CG팀의 역할이 필요한데 XR의 기초가 되는 unreal engine에서 마이그레션이 가능한 능력을 키우고 VIDEO 담당자는 스위칭에 media server에서 올려주는 영상 신호를 감안하여 운영하면 현재 근무하는 인력을 활용하여 운영이 가능하게 된다. 그리고 조명팀에서 LED wall 부분을 일부 분담하고, 카메라에서 트레킹 부분을 담당하면 추가 인원을 최소화하여 현재 제작 인원으로 XR live 방송 제작을 할 수 있을 것이다.

Ⅳ. 결 론

본 연구는 XR live 스튜디오의 구축 및 운용 인력에 관한 현황을 분석하고, 방송사가 다채널 XR live 스튜디오를 구축하기 위한 주요 시스템의 설계와 효율적인 인력 운영 방안을 제시하였다. XR live 스튜디오는 실감 콘텐츠 제작의 핵심 기술로, 방송사에서의 활용 가능성이 매우 높다. 이를 통해 방송사에서 필요한 live 콘텐츠를 제작할 수 있도록 하는 것이 목적이다. 주요 내용으로는 XR 기술의 정의 및 종류를 정리하고, VR, AR, MR, XR 등 다양한 실감 콘텐츠 기술이 방송 콘텐츠 제작에 어떻게 적용될 수 있는지를 분석하였다. 국내외 주요 XR 스튜디오 사례를 조사하고, 각 스튜디오의 기술적 특징과 운영 방식을 비교하여 방송사가 벤치마킹할 수 있는 다양한 사례를 제시하였다. 또한, XR live 스튜디오를 구축하기 위한 필수 시스템 구성 요소와 기술적 요구 사항을 분석하고, 최적의 다채널 XR live 스튜디오 설계 방안을 제시하였다.

이어서, 효과적인 다채널 XR live 스튜디오 운영을 위해 필요한 인력 구성 방안을 제시하고, 각 인력의 역할과 책임을 구체적으로 명시하였다. 향후 다채널 XR live 스튜디오의 성공적인 운영을 위해서는 지속적인 기술 개발과 전문 인력 양성이 필요하다. 또한, 스튜디오 운영 과정에서 발생할 수 있는 다양한 문제를 해결하기 위한 상세한 설명서와 교육 프로그램이 마련되어야 할 것이다. 방송사들의 다채널 XR live 스튜디오 도입을 위한 국산 장비의 개발 및 연구 지원 등 다양한 지원도 필요할 것으로 판단된다. XR 기술의 빠른 발전에 맞춰 최신 기술을 도입하고 업데이트하는 것이 중요하다. 이를 위해 방송사들은 지속적인 기술 모니터링과 도입 계획을 수립해야 한다. 다채널 XR live 스튜디오의 성공적인 운영을 위해 기술적 역량을 갖춘 전문 인력의 양성이 필수적이다. 이를 위해 교육 기관과의 협력, 내부 교육 프로그램의 개발 및 운영이 필요하다. 스튜디오 운영 과정에서 발생할 수 있는 문제를 사전에 예방하고 신속하게 대응하기 위해 구체적인 운영 매뉴얼과 표준 운영 절차(SOP)를 개발해야 한다. 주요 장비의 국산화를 위한 연구 개발 지원을 통해 다양한 XR 콘텐츠 제작 지원이 필요하다. 이러한 노력을 통해 XR live 스튜디오는 미래 방송 콘텐츠 제작의 중요한 축으로 자리 잡을 것이며, 방송사들은 이를 통해 더욱 혁신적이고 몰입감 있는 콘텐츠를 시청자들에게 제공할 수 있을 것이다.

References

- J. Hong, "Review and Suggestions on Virtual Reality (VR) and Augmented Reality (AR)", The Magazine of KIICE, Vol. 18, No. 1, pp. 36-42, 2017.

-

S. Jin, "A Study on Innovation Resistance and Adoption of Extended Reality Devices", Journal of the Korea Contents Association, Vol. 21, No. 5, pp. 918-940, May 2021

[https://doi.org/10.5392/JKCA.2021.21.05.918]

-

L. Gong, A. Fast-Berglund, and B. Johansson, "A framework for extended reality system development in manufacturing", IEEE Access, Vol. 9, pp. 24796-24813, Feb. 2021.

[https://doi.org/10.1109/ACCESS.2021.3056752]

- Korea Electronics Association, "XR Industry and Device Trends", Issue report, No. 21, Nov. 2023. https://www.gokea.org/core/?cid=53&uid=50223&page=&role=view&cate1, .

- https://www.pwc.com/us/en/tech-effect/emerging-tech/improve-healthcare-with-extended-reality.html, [accessed: Jul. 26, 2024]

- K. S. Yang, "Configuration, Characteristics, and Utilization Trends of XR Systems for Immersive Media Production", KCA, Media issue & trend, Vol. 52, pp 35-48, Oct. 2022. https://www.kca.kr/Media_Issue_Trend/vol52/sub02_01.html, .

- https://www.ibc.org/features/remote-production-and-xr-technologies-drive-uk-broadcasters-euros-coverage/11085.article, [accessed: Jul. 26, 2024]

- K. S. Choi and Y. S. Son, "Trends in the XR Industry Ecosystem and Device Standardization", Korean Institute of Information Scientists and Engineers, Vol. 41, No. 9, pp. 8-12, Sep. 2023.

- C. C. Jung, S. M. Cho, and B. Y. Park, "Status and Prospects of Virtual Production Domestically and Internationally", Korean Film Council, Feb. 2023. https://www.kofic.or.kr/kofic/business/rsch/findPolicyDetail.do?boardNumber=39&policyNo=5886, .

- https://www.slashfilm.com/955412/how-ilms-volume-technology-reinvents-visual-effects-and-what-it-means-for-the-future/, [accessed: Jul. 22, 2024]

- https://www.unrealengine.com/en-US/spotlights/unreal-engine-powers-ilm-s-vr-virtual-production-toolset-on-solo-a-star-wars-story, [accessed: Jul. 22, 2024]

- K. T. Kim, "Production of Space-Based XR Content and Utilization of Unreal Engine for Immersive Experiences", Broadcasting and Media, Vol. 27, No. 4, pp. 59-65, Oct. 2022. https://www.kibme.org/resources/journal/20221123115111734.pdf, .

2004년 8월 : 한양대학교 전자통신전공(공학석사)

2008년 10월 ~ 현재 : 재단법인

서울특별시 미디어재단 티비

에스(TBS) 팀장

관심분야 : 방송기술/빅데이터, 클라우드, AI, VR, XR, AR, OTT

1996년 2월 : 한남대학교 전공(이학석사)

2001년 2월 : 순천향대학교 전기전자공학과(공학박사)

2001년 3월 ~ 현재 : 동아방송예술대학교 방송기술과 부교수

관심분야 : 디지털 방송기술, OTT, XR, AI

2021년 2월 : 서울과기대 방송통신 정책학(석사)

2003년 3월 ~ 현재 : (주)사운드폭스 대표

관심분야 : 디지털 방송기술, OTT, XR, AI