프로젝터-카메라 시스템의 객체 감지 향상을 위한 Unet 기반 이미지 복원

초록

프로젝터-카메라 시스템은 증강현실(AR), 교육, 의료 등 다양한 분야에서 활용되는 기술로서, 프로젝터 광원으로 인해 객체 색상이 왜곡되어 객체 인식 성능이 저하되는 문제점을 갖고 있다. 따라서 본 연구에서는 U-Net 기반 색상 복원 모델을 제안하였다. 제안한 모델은 빛에 의한 색상 왜곡 이미지를 입력으로 받아 원본에 가까운 색상을 복원하는 기능을 수행하며, 복원된 이미지의 유사도 및 객체 인식 정확도의 향상을 실험을 통해 검증하였다. 또한, 본 방식은 객체 인식 시스템과 독립적으로 동작하도록 설계되어 조명 변화에도 기존 학습 모델을 재학습 없이 적용할 수 있는 장점이 있다. 본 연구 결과는 프로젝터-카메라 시스템에서 색상 왜곡 문제를 효과적으로 해결하고 객체 인식 성능을 유의미하게 개선하는 가능성을 확인하였다.

Abstract

The projector-camera system is a technology widely used in fields such as augmented reality (AR), education, and healthcare, but it suffers from degraded object recognition performance due to color distortion caused by the projector light. To address this issue, this study proposes a U-Net-based color restoration model. The proposed model takes color-distorted images as input and restores them to colors close to the original, which was experimentally validated through improvements in image similarity and object recognition accuracy. In addition, the model operates independently from object recognition systems, allowing flexible application under varying lighting conditions without retraining. The results demonstrate the model’s effectiveness in resolving color distortion issues and improving recognition performance.

Keywords:

projector-camera system, image restoration, object detection, unetⅠ. 서 론

프로젝터-카메라 시스템은 실제 환경과 가상 정보를 결합하여 직관적인 상호작용을 제공하는 기술로, 증강현실(AR, Augmented Reality), 교육, 의료, 엔터테인먼트 등 다양한 분야에서 활용되고 있다. 이 시스템은 프로젝터를 통해 물리적 공간에 디지털 콘텐츠를 투사하고, 카메라를 이용하여 사용자의 움직임이나 객체의 상태를 실시간으로 감지하여 반응한다. 교육 분야에서 프로젝터-카메라 시스템은 테이블에 가상 학습 자료를 투사하여 학습자의 몰입감을 높이며[1][2], 박물관에서는 관람객이 전시물과 상호작용할 수 있는 콘텐츠로 사용된다[3]-[5]. 또한 의료 분야에서는 환자의 신체 부위에 정보를 투사하여 정밀한 진단과 수술을 지원하고[6]-[8], 산업 분야에서는 작업자에게 실시간 가이드라인을 제공하는 데 사용되고 있다[9][10].

프로젝터-카메라 시스템에서 객체 인식(Object detection)은 필수적인 기능이다. 직관적인 사용자 상호작용을 지원하고, 증강된 가상 콘텐츠를 정확한 위치에 투사하기 위해서는 시스템이 물리적 객체를 올바르게 감지해야 한다. 객체 인식은 일반적으로 형태(Shape), 색상(Color), 마커(Marker) 등의 특징을 분석하며, 특히 형태가 유사한 객체들의 경우 색상 정보가 중요한 판별 기준이 된다. 예를 들어, 사과, 귤, 배, 감과 같은 과일들은 크기와 형태가 유사하여 색상이 가장 직관적이고 효과적인 구별 요소로 작용한다.

그러나 프로젝터-카메라 시스템은 프로젝터가 투사하는 빛이 객체의 색상에 영향을 미쳐 인식 성능을 저하시키는 근본적인 문제가 존재할 수 있다. 프로젝터가 인식 대상 물체 표면에 직접 빛을 투사하면, 카메라가 감지하는 색상이 원래 색상과 다르게 변형된다. 강한 흰색 조명이 투사되면 붉은색 사과가 밝은 주황색으로 인식되고, 파란색 조명이 투사되면 귤이 어두운 갈색으로 변할 수 있다. 이러한 색상 변형은 색상 기반 객체 인식 알고리즘의 성능을 크게 저하시킬 수 있다.

이러한 색상 변화는 조명의 강도, 색온도, 주변 환경의 밝기 등에 의해 더욱 복잡해진다. 프로젝터 빛의 색상과 물체의 반사율이 상호작용하여 색상이 비선형적으로 왜곡되며, 동일한 물체라도 주변 광원 조건에 따라 다르게 인식된다. 이는 객체 인식 모델의 일관된 학습을 방해하여 전체 시스템의 인식 정확도를 저하시킬 수 있다.

기존 연구들은 색상 왜곡 문제를 완화하기 위해 특정 색상만 투사하는 제약 기반 접근법, 물체 표면을 회피하여 투사하는 영역 분할 기법, 외부 센서나 고급 알고리즘을 활용하는 하드웨어 중심 방법 등이 제안되었다. 그러나 이러한 접근법은 각각 콘텐츠 표현력의 제약, 시각적 효과의 감소, 실시간 처리 성능 저하 등의 한계를 가진다.

따라서 본 연구는 이러한 한계를 보완하기 위해 U-Net 구조를 기반으로 한 색상 복원 모델을 적용하였다. U-Net은 영상 처리 분야에서 제안된 인코더–디코더 기반 심층 신경망으로, 인코더에서 추출한 다양한 해상도의 특징과 디코더의 해당 단계를 skip connection으로 연결하여 세부 공간 정보를 보존한다. 이러한 구조는 픽셀 단위의 정밀한 복원을 가능하게 하며, 비교적 적은 데이터셋에서도 우수한 성능을 발휘하므로, 색상 복원과 같이 세부 색상 및 형태 정보를 정확하게 재현해야 하는 작업에 적합하다. 더 나아가 이러한 skip connection은 색상 복원 과정에서 세부 색상 차이와 객체의 형태 정보를 동시에 유지할 수 있어, 단순 선형 보정 기법이나 전통적 색상 매핑 방식보다 비선형적인 색상 왜곡을 효과적으로 처리할 수 있다.

제안하는 방법은 카메라로 획득한 프로젝터 빛과 합성된 왜곡 이미지를 분석하여 프로젝터의 영향을 받기 전 원본 객체의 색상을 추정·복원하는 것을 목표로 한다. 이를 통해 콘텐츠 표현력을 유지하면서도 색상 기반 객체 인식의 성능을 향상시키고자 한다.

본 연구에서 제안하는 U-Net 기반 색상 복원 모델은 다양한 조명 조건에서 원본 색상을 효과적으로 복원하였으며, 기존 대비 색상 기반 객체 인식의 정확도가 향상되었다.

Ⅱ. 관련 연구

본 절에서는 프로젝터-카메라 시스템에 대한 설명과 시스템의 문제점 및 한계, 그리고 이를 극복하기 위해 진행된 연구들에 대하여 검토한다.

프로젝터-카메라 시스템은 공간 증강현실(SAR, Spatial Augmented Reality) 구현을 위한 핵심 기술로, 프로젝터를 통해 디지털 콘텐츠를 현실 공간에 직접 투사함으로써 사용자가 별도의 착용 장비 없이 몰입감 있게 체험할 수 있도록 한다[11]. 이러한 방식은 동일한 공간에서 다수의 사용자가 동시에 콘텐츠를 경험할 수 있게 하여, 전시, 교육, 공연, 엔터테인먼트 등 다양한 분야에서 활용되고 있다[12].

최근 연구에서는 깊이 카메라를 이용한 사용자 추적, 시점 및 행동에 따른 맞춤형 콘텐츠 자동 생성, 고속으로 움직이는 물체에 마커를 부착한 프로젝션 매핑 등 새로운 형태의 상호작용 콘텐츠 개발이 활발히 진행되고 있다[13][14]. 그러나 실제 환경에서는 조명 조건, 투사 표면의 색상·질감 등 다양한 환경적 요인으로 인해 영상의 색상 왜곡과 해상도 저하가 발생할 수 있음이 보고되었다[15].

이러한 문제를 완화하기 위해 다양한 연구가 진행되었다. 비대각 반사율 행렬을 활용한 표면 색상 추정, 공간 색상 보정, 다중 카메라를 통한 자연 조명 보정, 역투광을 이용한 그림자 제거, 눈부심 및 가독성 개선 등 다양한 연구가 진행되고 있다[16]-[20]. 손 제스처 인식 관련 연구도 암흑 채널 기반으로 일부 문제를 해결했으나, 단일 객체나 제한된 상황에 한정되어 있다[21].

요약하면, 기존 접근법들은 특정 조건에서 성과를 보였으나, 다양한 조명 환경과 복잡한 장면에서 발생하는 비선형 색상 왜곡을 충분히 해결하지 못했다. 이러한 한계는 학습 기반 복원 기법의 필요성을 보여준다.

Ⅲ. 프로젝터-카메라 시스템

프로젝터-카메라 시스템은 영상을 출력하는 프로젝터, 입력 영상을 수집하는 카메라, 그리고 인식 대상 객체들로 구성된다. 시스템은 카메라를 통해 객체를 인식하면 프로젝터에서 특정 상황을 재생해주는 방식으로 콘텐츠를 구현한다. 그러나 기존 시스템은 프로젝터 광원이 객체 표면의 색상에 영향을 주어 색상 왜곡을 유발하며, 이는 객체 인식 정확도를 저하시킬 수 있다. 또한 프로젝터와 카메라의 시점 차이로 인해 투사된 영상이 기하학적으로 왜곡되어 위치 인식이 어려운 문제가 존재한다.

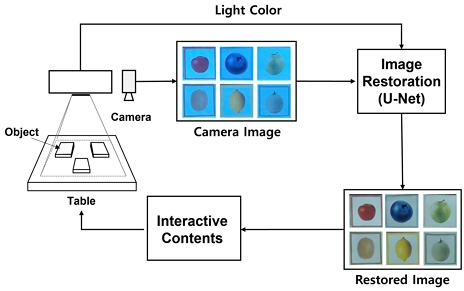

이러한 문제를 해결하기 위해 본 연구에서는 기존 시스템에 U-Net 기반 색상 복원 모듈을 추가하였다. 제안하는 시스템은 카메라 영상에 ROI Warping을 통해 시점 보정을 수행한 후, 보정된 이미지를 U-Net 모델에 입력하여 원본에 가까운 색상으로 복원한다. 특히, 본 모델은 왜곡된 이미지와 투사 광원의 색상 정보 두 가지를 동시에 입력받아, 구조적 특징과 조명 특성을 함께 고려한 복원을 수행한다. 이를 통해 다양한 조명 환경에서도 안정적인 복원이 가능하다. 그림 1은 제안하는 시스템의 전체 객체 인식 과정을 나타내며, 복원 모듈은 전처리 단계에 삽입되어 색상 왜곡을 완화하고 인식기의 정확도를 향상시킨다.

제안하는 U-Net 기반 복원 모듈은 인코더-디코더 구조로 구성되며, 왜곡된 이미지와 조명 색상 정보를 입력받아 다중 스케일 특징을 추출하고, 이를 바탕으로 색상 복원을 수행한다. 인코더는 합성곱 연산과 풀링 연산을 통해 해상도를 점진적으로 축소하며 고차원 특성을 추출하고, 디코더는 업샘플링과 합성곱 연산을 통해 특징 맵의 해상도를 증가시킨다. 동일 해상도 단계에서 인코더의 출력을 skip connection을 통해 디코더에 전달하여, 공간적 세부 정보와 의미적 정보를 결합함으로써 복원 성능을 향상시킨다.

또한, 본 복원 모듈은 조명 색상 정보를 효과적으로 활용하기 위해 색상 조건 결합 기법을 채택하였다. 투사 광원의 RGB 값을 Dense를 거쳐 저차원 임베딩으로 변환한 뒤, bottleneck 구간에서 공간적으로 확장하여 인코더의 최종 특징 맵과 결합한다. 이를 통해 네트워크는 왜곡된 이미지의 구조적 특징뿐만 아니라 광원 특성을 함께 학습하여, 색상 왜곡의 원인을 직접 보정할 수 있다. 이러한 조건 주입 기법은 다양한 광원 환경에서도 안정적인 복원 성능을 제공하며, 결과적으로 객체 인식기의 색상 불변성을 강화하고 전체 시스템의 인식 신뢰도를 향상시킬 수 있다.

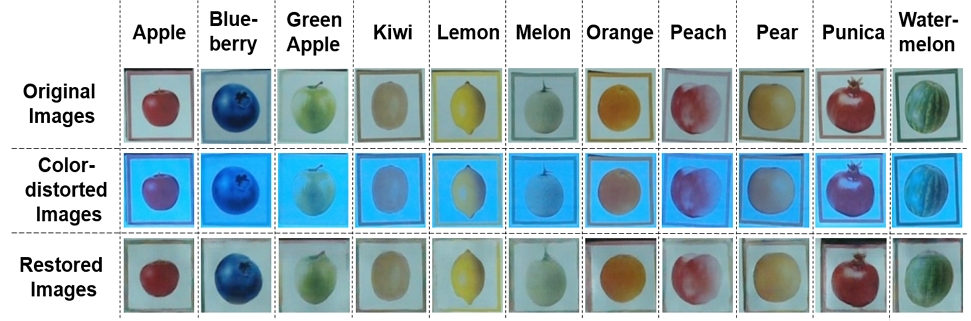

다음으로, 수집된 데이터를 이용해 왜곡된 이미지와 투사 광원의 색상 정보를 입력으로 하는 U-Net 기반 색상 복원 모델을 학습하였다. 학습 과정에서는 L1 손실과 Perceptual 손실의 가중합을 사용하였으며, 손실 값(Loss)을 지속적으로 모니터링하여 성능을 확인하고, 필요에 따라 하이퍼파라미터를 조정하였다. 학습은 약 30,000장의 이미지/색상 데이터셋을 대상으로, batch size 8, epochs 30으로 설정하여 진행하였다. 그림 2는 원본 이미지, 색상 왜곡 이미지, 그리고 복원된 이미지를 보여준다.

Ⅳ. 실험 및 결과

본 연구에서는 프로젝터에서 출력되는 영상에 의해 발생하는 색상 왜곡이 콘텐츠 진행에 필요한 객체 인식률 저하를 초래할 수 있음을 확인하고, 이를 해결하기 위해 프로젝션 이미지를 원본 이미지로 복원하는 과정을 제안하였다.

이를 위해 U-Net 기반 색상 복원 모델을 활용하여 프로젝터로 인해 왜곡된 이미지를 복원하였으며, 본 절에서는 해당 복원 기법을 통해 생성된 이미지와 원본 이미지 간의 유사도를 측정하고, 복원된 이미지의 객체 인식 성능 향상 여부를 분석하여, 제안한 복원 과정을 프로젝터-카메라 시스템에 적용 가능한지를 검토하였다.

이미지 유사도 평가는 SSIM(Structural Similarity Index Measure)와 색상 히스토그램 코사인 유사도를 이용하여 수행하였으며, 객체 인식 성능 평가는 YOLO 모델과 Template Matching 기법을 사용하였다.

4.1 이미지 유사도

이미지의 구조적 및 색상 유사도를 측정하기 위해 SSIM과 색상 히스토그램 코사인 유사도를 활용하여 복원된 이미지에 대한 평가를 진행하였다. 각 지표의 유사도 점수는 백분율로 환산하여 제시하였다.

SSIM은 두 이미지 간의 구조적 유사도를 정량적으로 측정하는 지표로, 비교 대상 이미지의 동일한 위치 픽셀 집합 x, y에 대해 평균 밝기(μx,, μy), 분산(σ2x, σ2y), 그리고 공분산(σxy)을 이용하여 다음과 같이 계산된다.

| (1) |

여기서 C1, C2는 분모가 0이 되는 것을 방지하기 위한 안정화 상수이다. SSIM 값은 1에 가까울수록 두 이미지의 구조적 유사도가 높음을 의미한다.

히스토그램 코사인 유사도는 두 이미지의 색상 히스토그램 분포를 벡터로 변환하여, 벡터 간의 코사인 유사도를 계산하는 방식이다.

두 히스토그램 벡터 A, B에 대해 코사인 유사도는 다음과 같이 정의된다.

| (2) |

여기서 A𐤟B는 두 벡터의 내적(dot product), ‖A‖와 ‖B‖는 각각의 벡터 크기이다. 값의 범위는 0~1이며, 1에 가까울수록 두 이미지의 색상 분포가 유사함을 의미한다. 본 연구에서는 RGB 채널별 히스토그램을 계산한 후, 이를 결합하여 코사인 유사도를 산출하였으며, 이 지표를 통해 색상 왜곡 복원 성능을 정량적으로 평가하였다.

표 1은 원본 이미지에 대해 색상이 왜곡된 이미지와 복원된 이미지의 유사도 점수를 비교한 결과이다. 각 이미지에 대해 라벨링된 정보를 바탕으로 클래스별 비교를 진행하였으며, 클래스당 3,500장의 이미지를 표본으로 선정하여 분석하였다. 분석 결과, 프로젝터에 의해 색상이 왜곡된 이미지의 평균 SSIM 점수는 0.84, 복원된 이미지의 평균 SSIM 점수는 0.89로 나타났다. 이는 복원 과정에서 구조적 정보가 유지되었음을 의미하며, 일부 클래스(예: GreenApple, Kiwi, Lemon)는 SSIM 값이 거의 변동이 없었고, 일부 클래스(예: BlueBerry, WaterMelon, Pear)는 소폭 증가하는 경향을 보였다.

Similarity scores measured between the color-distorted images (DI) and the restored images (RI) with respect to the original photographs

또한, 색상이 왜곡된 이미지의 평균 히스토그램 코사인 유사도는 0.41, 복원된 이미지의 평균 점수는 0.72로 나타났다. 즉, 복원된 이미지가 프로젝션 이미지보다 색상 유사도가 0.31 증가하였으며, 이는 색상 왜곡이 효과적으로 보정되었음을 보여준다. 대부분의 클래스에서 유사도가 증가하였다.

추가적으로, 색상이 왜곡된 이미지는 구조적 변형이 거의 없고 주로 색상 변화만 발생하였으며, 복원된 이미지 또한 원본과 비교했을 때 구조적 차이가 미미했다. 오히려 일부 경우에는 색상 보정 효과로 인해 원본 대비 시각적으로 약간 향상된 결과를 보였다.

4.2 객체 감지

프로젝터-카메라 시스템을 활용한 SAR 콘텐츠는 정확하고 빠른 객체 인식이 필수적이다. 특히 본 연구의 Top-view 카메라 환경에서는 카메라와 객체 간의 수직 거리가 고정되어 있어, 객체의 스케일 변화가 최소화되는 특성이 있다. 이러한 환경적 특성을 바탕으로 복원 이미지와 색상 왜곡 이미지의 객체 인식 성능을 비교·분석하였다.

객체 인식 성능 평가는 Template Matching과 YOLOv8 두 가지 방법으로 진행하였다. Template Matching은 원본 이미지에서 클래스별 템플릿 이미지를 추출하고, 이를 입력 이미지에서 검색하여 위치를 찾는 방식이다.

본 연구는 색상 왜곡 보정 효과를 검증하는 것이 주목적이므로, Top-view 환경의 특성상 발생 빈도가 낮은 회전 변화는 실험에서 제외하였다. 매칭 성능 평가는 템플릿과 입력 이미지 간의 유사도 점수를 계산하여, 일정 기준 이상일 경우 객체 인식 성공으로 판단하였다.

YOLOv8은 이미지 전체를 한 번에 분석하여 객체의 위치와 클래스를 동시에 예측하는 딥러닝 기반 실시간 객체 탐지 모델이다. 본 실험은 300장의 원본 이미지를 라벨링한 후, 다양한 조명 조건과 배경 환경을 시뮬레이션하기 위해 해당 데이터들에 대해서 채도, 명도를 조절하여 학습데이터를 증강하여, 총 3000장의 데이터셋으로 실험을 진행했다. 데이터셋은 학습:검증을 8:2 비율로 분할하고, batch size 8, epochs 30으로 학습을 진행하였다.

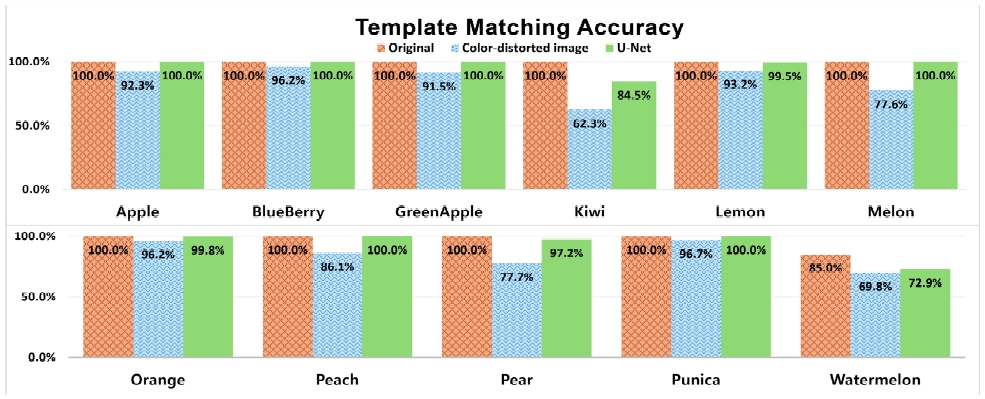

그림 3은 Template Matching 기법을 이용하여 원본 이미지, 프로젝션 이미지, 그리고 복원 이미지의 클래스별 인식 정확도를 비교한 결과를 보여준다. 동일한 3,500장의 데이터를 기반으로 정확도를 산출하였으며, 모든 클래스에서 복원 이미지의 인식률이 프로젝션 이미지 대비 향상되었다.

Class-wise accuracy of the Template Matching method for the original, color distorted, and restored images

프로젝션으로 인해 색상이 왜곡된 이미지의 평균 정확도는 86.0%였으며, 복원 이미지는 94.6%로 약 8.6% 상승하였다.

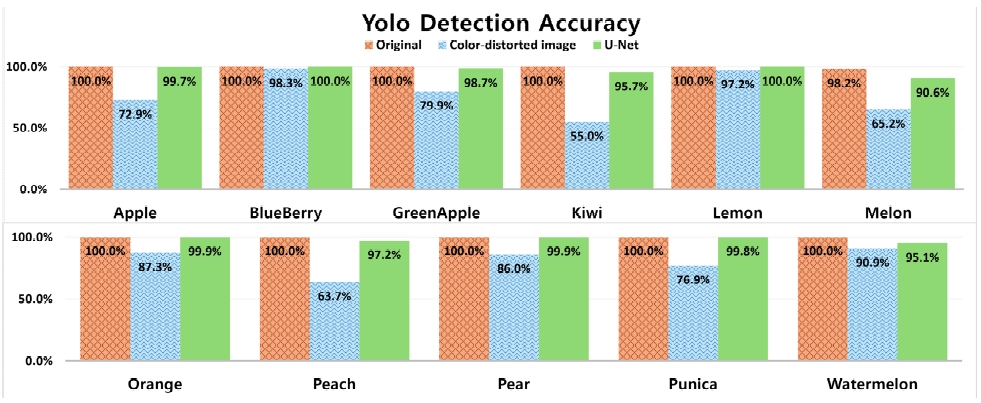

그림 4는 YOLOv8 모델을 이용한 객체 탐지 결과를 나타낸다. 클래스별 정확도는 대부분의 경우에서 색상 복원 후 향상되었으며, 프로젝션으로 인해 색상이 왜곡된 이미지의 평균 정확도는 79.6%, 복원 이미지는 94.5%로 약 14.9% 향상되었다.

이러한 결과를 보았을 때, 제안된 복원 시스템을 실제 프로젝터–카메라 기반 인식 환경에 적용하면 색상 왜곡으로 인한 인식 성능 저하를 효과적으로 완화할 수 있으며, 나아가 기존 시스템 대비 더 높은 정확도와 안정성을 확보할 수 있다.

Ⅴ. 결론 및 향후 과제

본 연구에서는 U-Net 기반의 색상 복원 모델을 설계하여 프로젝터–카메라 시스템 환경에서 발생하는 색상 왜곡 문제를 완화하고 객체 인식 정확도를 향상시키는 방안을 제안하였다. 실험 결과, 제안한 모델은 왜곡된 이미지를 원본에 가까운 형태로 효과적으로 복원하였으며, 기존 기법에 비해 복원 이미지와 원본 간의 유사도가 개선됨을 확인하였다. 또한 복원 이미지를 활용한 객체 인식 실험에서도 정확도 향상이 이루어져, 제안된 모델이 색상 왜곡 보정과 인식 성능 향상에 모두 기여할 수 있음을 확인하였다.

제한사항으로 본 연구는 단색광 기반의 제어된 환경을 전제로 하였으며, 데이터셋의 색상·객체 구성이 제한적이었다. 따라서 다양한 색상 스펙트럼, 복잡한 배경 텍스처, 다중 객체가 존재하는 실제 환경에서는 복원 성능에 한계가 있을 수 있다. 특히 투사 표면의 재질이나 주변 조명 조건에 따라 특정 색상의 복원 품질이 저하되는 경향이 관찰되었다.

향후 연구에서는 컬러 광원 기반의 학습 데이터 확보와 함께, 다양한 표면 반사 조건을 반영한 데이터셋을 구축하여 일반화 성능을 강화할 예정이다. 더 나아가 경량화된 U-Net 구조와 객체 인식 알고리즘을 통합하여 실시간 응용 환경에서도 안정적으로 작동하는 복원 시스템을 개발하고자 한다. 이러한 시스템은 교육 현장의 인터랙티브 콘텐츠, 의료 분야의 증강 수술 가이드, 산업 현장의 작업 보조 시스템 등 다양한 분야에서 활용 가능성을 가진다.

References

-

F. Zulfiqar, R. Raza, M. O. Khan, M. Arif, A. Alvi, and T. Alam, "Augmented reality and its applications in education: A systematic survey", IEEE Access, Vol. 11, pp. 143250-143271, Nov. 2023.

[https://doi.org/10.1109/ACCESS.2023.3331218]

-

D. Beck, "Augmented and virtual reality in education: Immersive learning research", Journal of Educational Computing Research, Vol. 57, No. 7, pp. 1619-1625, Jun. 2019.

[https://doi.org/10.1177/0735633119854035]

-

V. Nikolakopoulou, P. Printezis, V. Maniatis, D. Kontizas, S. Vosinakis, P. Chatzigrigoriou, and P. Koutsabasis, "Conveying intangible cultural heritage in museums with interactive storytelling and projection mapping: the case of the mastic villages", Heritage, Vol. 5, No. 2, pp. 1024-1049, May 2022.

[https://doi.org/10.3390/heritage5020056]

-

D. Cisternino, L. Corchia, V. D. Luca, C. Gatto, S. Liaci, L. Scrivano, and L. T. D. Paolis, "Augmented reality applications to support the promotion of cultural heritage: the case of the basilica of saint catherine of alexandria in Galatina", Journal on Computing and Cultural Heritage (JOCCH), Vol. 14, No. 4, pp. 1-30, Jul. 2021.

[https://doi.org/10.1145/3460657]

-

Y. Y. Lee, J. H. Lee, B. Ahmed, M. G. Son, and K. H. Lee, "A new projection-based exhibition system for a museum", Journal on Computing and Cultural Heritage (JOCCH), Vol. 12, No. 2, pp. 1-17, May 2019.

[https://doi.org/10.1145/3275522]

-

J. C. Chien, J. D. Lee, C. W. Chang, and C. T. Wu, "A projection-based augmented reality system for medical applications", Applied Sciences, Vol. 12, No. 23, p. 12027, Nov. 2022.

[https://doi.org/10.3390/app122312027]

-

L. K. Hasan, A. Haratian, M. Kim, I. K. Bolia, A. E. Weber, and F. A. Petrigliano, "Virtual reality in orthopedic surgery training", Advances in Medical Education and Practice, pp. 1295-1301, Nov. 2021.

[https://doi.org/10.2147/AMEP.S321885]

-

T. Hoang, M. Reinoso, Z. Joukhadar, F. Vetere, and D. Kelly, "Augmented studio: Projection mapping on moving body for physiotherapy education", Proc. CHI Conf. Human Factors in Computing Systems, Denver, Colorado, USA, pp. 1419-1430, May 2017.

[https://doi.org/10.1145/3025453.3025860]

-

T. Zigart and S. Schlund, "Ready for industrial use? a user study of spatial augmented reality in industrial assembly", Proc. IEEE Int. Symp. Mixed and Augmented Reality Adjunct (ISMAR-Adjunct), Singapore, Singapore, pp. 60-65, Oct. 2022.

[https://doi.org/10.1109/ISMAR-Adjunct57072.2022.00022]

-

P. Rupprecht, H. Kueffner-McCauley, M. Trimmel, and S. Schlund, "Adaptive spatial augmented reality for industrial site assembly", Procedia CIRP, Vol. 104, pp. 405-410, Nov. 2021.

[https://doi.org/10.1016/j.procir.2021.11.068]

-

H. Benko, A. D. Wilson, and F. Zannier, "Dyadic projected spatial augmented reality", Proc. 27th Annu. ACM Symp. User Interface Software and Technology, Honolulu, Hawaii, USA, pp. 645-655, Oct. 2014.

[https://doi.org/10.1145/2642918.2647402]

-

J. Lee, Y. Kim, M. H. Heo, D. Kim, and B. S. Shin, "Real-time projection-based augmented reality system for dynamic objects in the performing arts", Symmetry, Vol. 7, No. 1, pp. 182-192, Feb. 2015.

[https://doi.org/10.3390/sym7010182]

-

A. Fender, P. Herholz, M. Alexa, and J. Müller, "Optispace: Automated placement of interactive 3d projection mapping content", Proc. CHI Conf. Human Factors in Computing Systems, Montreal, QC, Canada, pp. 1-11, Apr. 2018.

[https://doi.org/10.1145/3173574.3173843]

-

H. L. Peng and Y. Watanabe, "High-speed dynamic projection mapping onto human arm with realistic skin deformation", Applied Sciences, Vol. 11, No. 9, p. 3753, Apr. 2021.

[https://doi.org/10.3390/app11093753]

-

D. Iwai, "Projection mapping technologies: A review of current trends and future directions", Proc. Japan Academy, Series B, Vol. 100, No. 3, pp. 234-251, Mar. 2024.

[https://doi.org/10.2183/pjab.100.012]

-

M. Nishizawa and K. Okajima, "Precise surface color estimation using a non-diagonal reflectance matrix on an adaptive projector-camera system", Proc. IEEE Int. Symp. Mixed and Augmented Reality Adjunct (ISMAR-Adjunct), Munich, Germany, pp. 190-195, Oct. 2018.

[https://doi.org/10.1109/ISMAR-Adjunct.2018.00064]

-

B. Huang and H. Ling, "Deprocams: Simultaneous relighting, compensation and shape reconstruction for projector-camera systems", IEEE Trans. Visualization and Computer Graphics, Vol. 27, No. 5, pp. 2725-2735, Mar. 2021.

[https://doi.org/10.1109/TVCG.2021.3067771]

-

K. Hiratani, D. Iwai, Y. Kageyama, P. Punpongsanon, T. Hiraki, and K. Sato, "Shadowless projection mapping using retrotransmissive optics", IEEE Trans. Visualization and Computer Graphics, Vol. 29, No. 5, pp. 2280-2290, Feb. 2023.

[https://doi.org/10.1109/TVCG.2023.3247104]

-

P. J. Chiu and S. Y. Chien, "Painted face effect removal by a projector-camera system with dynamic ambient light adaptability", Proc. IEEE Int. Conf. Multimedia and Expo (ICME), Turin, Italy, pp. 1-6, Jun. 2015.

[https://doi.org/10.1109/ICME.2015.7177434]

-

T. Abe, T. Suganuma, and N. Kazuta, "Legibility estimation for projected AR contents", Proc. IEEE 9th Global Conf. Consumer Electronics (GCCE), Kobe, Japan, Oct. 2020.

[https://doi.org/10.1109/gcce50665.2020.9291705]

-

Q. Zhang, M. Yang, Q. Zheng, and X. Zhang, "Segmentation of hand gesture based on dark channel prior in projector-camera system", Proc. IEEE/CIC Int. Conf. Communications in China (ICCC), Qingdao, China, pp. 1-6, Oct. 2017.

[https://doi.org/10.1109/ICCChina.2017.8330336]

2023년 3월 ~ 현재 : 경상국립대학교 컴퓨터공학과 학사과정

관심분야 : 확장현실, 증강현실, 인공지능

2024년 8월 : 경상국립대학교 컴퓨터공학과(공학사)

2025년 3월 ~ 현재 : 경상국립대학교 컴퓨터공학부 석사과정

관심분야 : 증강/가상현실, 확장현실, 컴퓨터 그래픽스

2010년 2월 : 광주과학기술원 정보기전공학부(공학석사)

2017년 8월 : 광주과학기술원 전기전자컴퓨터공학부(공학박사)

2018년 3월 ~ 현재 : 경상국립대학교 컴퓨터공학과 부교수

관심분야 : 컴퓨터 그래픽스, 증강현실, 인공지능