PIDNet-S 기반 실시간 콘크리트 변색 세그멘테이션 모델 구현 및 성능 평가

초록

본 연구는 드론(UAV)으로 촬영된 교량 콘크리트 영상을 대상으로 변색(Discoloration) 영역을 실시간으로 분할하기 위한 경량 세그멘테이션 모델을 제안한다. 콘크리트 변색은 조도 변화와 재질 특성에 따라 경계가 불명확하여 기존 딥러닝 기반 모델에서 안정적인 성능 확보가 어려운 문제가 있다. 이를 해결하기 위해, 본 연구에서는 PIDNet-S 기반의 경량 시맨틱 세그멘테이션 구조를 적용하여 변색 영역을 이진 분할하는 모델을 구현하였다. 또한 드론으로 촬영한 교량 콘크리트 표면 이미지를 대상으로 폴리곤 기반 라벨링과 이진 마스크 생성 과정을 통해 변색 데이터셋을 구축하였다. 실험 결과, 제안 모델은 IoU 89.0%, F1-score 93.0%, Pixel Accuracy 98.0%를 달성하여 U-Net 및 Improved U-Net 대비 우수한 성능을 보였으며, Mask R-CNN과 유사한 정확도를 유지하면서도 약 25 FPS의 실시간 처리 속도를 확보하였다.

Abstract

This study proposes a lightweight semantic segmentation model for real-time detection of concrete discoloration in UAV-acquired bridge images. Concrete discoloration exhibits ambiguous boundaries due to lighting and material variations, which limits the performance of conventional deep learning models. To address this issue, a PIDNet-S–based lightweight segmentation architecture is adopted for binary discoloration segmentation. In addition, a concrete discoloration dataset is constructed using polygon-based annotation and binary mask generation from UAV images. Experimental results show that the proposed model achieves 89.0% IoU, 93.0% F1-score, and 98.0% pixel accuracy, outperforming U-Net and Improved U-Net while maintaining accuracy comparable to Mask R-CNN. Moreover, the model achieves real-time inference at approximately 25 FPS, demonstrating its applicability to UAV-based automated bridge inspection.

Keywords:

concrete discoloration segmentation, PIDNet-S, UAV-based inspection, real-time semantic segmentationⅠ. 서 론

교량과 터널, 옹벽과 같은 콘크리트 기반 사회기반시설은 사용 연한이 증가함에 따라 다양한 손상과 열화가 발생한다. 이 과정에서 나타나는 표면 변색(Discoloration) 은 단순한 미관 저하를 넘어, 수분 침투, 염해, 표면 오염 및 재료 노화 등과 관련된 초기 징후로 해석될 수 있어 유지관리 관점에서 중요한 시각 정보이다[1][2]. 특히 교량의 경우 외부에 노출된 부재가 많고, 강우·누수·배수 불량 등의 영향으로 국부적인 변색·수분 자국이 쉽게 형성되므로, 변색의 공간 분포를 체계적으로 파악하는 것은 향후 정밀 조사 대상을 선정하고 보수·보강의 우선순위를 판단하는데 활용될 수 있다[1].

전통적인 교량 점검은 숙련된 점검자가 접근 장비를 이용해 근접 육안 검사를 수행하는 방식이 일반적이다. 그러나 이러한 방식은 작업자의 안전 부담이 크고, 넓은 네트워크를 주기적으로 조사하기에는 시간과 비용 측면에서 비효율적이라는 한계가 있다. 최근에는 드론을 활용해 교량 외면을 촬영하고, 딥러닝 기반 컴퓨터 비전 기법으로 표면 손상을 자동 인식·분류·분할하려는 시도가 증가하고 있다[3][4]. Y.-H. Na and D.-K. Kim[3]은 드론으로 촬영한 철도교량 이미지를 대상으로 U-Net 계열 모델을 활용한 다중 손상 세그멘테이션을 수행하여, 균열, 박리·박락, 노출 철근, 누수, 도장 박리 등 여러 손상 유형을 동시에 인식하는 전략을 제시하였다. J. Guo et al.[4]은 이미지 기반 구조물 표면 결함 검출 연구를 정리하면서, 딥러닝이 기존의 규칙 기반 영상처리보다 다양한 배경과 조명 조건에서 높은 성능을 보인다고 보고하였다.

콘크리트 구조물의 표면 손상 인식 연구는 그동안 주로 균열과 같은 형상이 뚜렷한 결함에 집중되어 왔다. 객체의 경계가 비교적 명확한 균열이나 박리와 달리, 변색은 경계가 모호하고 색상·명도 변화가 서서히 퍼지는 형태로 나타나는 경우가 많다. 더불어 실제 교량 표면 영상에서는 조도 변화, 그림자, 표면 습윤, 오염물 부착 등 다양한 외란이 동시에 존재하여, 단순한 색상 임계값 설정이나 히스토그램 분석과 같은 전통적 영상처리 기법으로는 변색을 안정적으로 분리하기 어렵다[1][2]. M. Ishikawa et al.[1]은 능동 열화상 비파괴시험에서 콘크리트의 조성 및 표면 변색 정도가 결함 검출 성능에 영향을 미친다는 점을 정량적으로 분석하며, 변색이 열화의 중요한 지표가 될 수 있음을 보여주었다.

변색과 유사한 시각 특성을 갖는 수분 자국·누수 영역을 대상으로는 딥러닝 기반 세그멘테이션 연구가 상대적으로 활발히 진행되고 있다. S. Zhao et al.[5]은 쉴드 터널 라이닝(Shield tunnel lining) 내 수분 자국을 대상으로 Mask R-CNN을 적용하여 인스턴스 세그멘테이션(Instance segmentation)을 수행하였고, 다양한 조도·배경 조건에서도 습윤 영역을 높은 정밀도로 추출할 수 있음을 보였다. 이 연구는 수분 자국과 같은 색상 변화 패턴을 딥러닝으로 분리·계수할 수 있다는 가능성을 제시한다. 이후 후속 연구들에서도 터널 라이닝의 누수 영역을 자동 인식하기 위한 딥러닝 기반 세그멘테이션 기법이 제안되며, 수분·변색 정보를 구조물 상태 평가의 입력으로 활용하려는 흐름이 나타나고 있다[5].

한편, 컴퓨터 비전 기반 인프라 점검·모니터링 분야 전반에서는 최근 수년간 딥러닝의 도입이 급속도로 진행되고 있다. X. Pan et al.[6]은 데이터 기반 컴퓨터 비전 기법을 이용한 인프라 상태평가 연구를 체계적으로 정리하면서, 구조물 결함 검출·손상 분류·변형 계측 등 다양한 응용에서 딥러닝이 기존 방법을 대체하거나 보완하는 방향으로 발전하고 있음을 보고하였다. 이러한 동향은 콘크리트 변색과 같은 비교적 초기에 나타나는 표면 징후도, 적절한 데이터셋과 모델 설계를 통해 자동 분석 대상으로 확장할 수 있음을 시사한다. 그럼에도 불구하고, 기존 딥러닝 기반 교량·터널 손상 인식 연구의 대부분은 손상 유형 중 하나로서의 누수·오염·변색을 포함하거나, 특정 응용에서만 색상 변화 정보를 다루는 수준에 머무르는 경우가 많다[3][5]. 콘크리트 표면 변색 그 자체를 독립적인 분석 대상으로 설정하고, 변색 영역을 픽셀 단위로 세그멘테이션하여 후속 정량 평가(변색 비율, 분포 패턴 등)에 활용하려는 연구는 상대적으로 부족하다. 특히 드론이 촬영한 교량 콘크리트 영상을 대상으로 변색 영역을 실시간에 가깝게 추출하기 위한 경량 실시간 세그멘테이션 모델에 대한 연구는 거의 보고되어 있지 않다.

실시간 시맨틱 세그멘테이션 분야에서는 최근 PIDNet과 같은 경량 네트워크가 교통 장면 등에서 정확도와 속도를 동시에 만족하는 모델로 주목받고 있다. PIDNet은 비례(Proportional)–적분(Integral)–미분(Derivative) 제어 개념을 네트워크 구조에 접목하여, 저수준 경계 정보와 고수준 의미 정보를 효율적으로 결합함으로써 경량 구조에서도 안정적인 분할 성능을 제공하는 것으로 보고된다[7][8]. 이러한 특성은 고정밀 서버뿐만 아니라 엣지 장비·모바일 환경에서도 적용이 가능하다는 점에서, 넓은 콘크리트 표면에서 나타나는 변색 영역을 빠르게 추출해야 하는 교량 점검 응용에 적합한 후보 모델이 될 수 있다.

따라서 본 연구의 목적은 드론으로 촬영한 교량 콘크리트 이미지를 대상으로, 변색 영역을 실시간으로 추출할 수 있는 PIDNet 기반 세그멘테이션 모델을 설계·검증하는 것이다. 본 연구에서는 변색의 정도를 세분화하여 등급화하기보다는, 변색이 존재하는 영역을 배경과 구분하는 이진 세그멘테이션(Binary segmentation)에 초점을 둔다. 이를 위해 교량 콘크리트 표면 변색을 대상으로 한 세그멘테이션 데이터셋을 구축하고, PIDNet 기반 변색 탐지 모델을 구현하여 학습한 뒤, 기존 세그멘테이션 모델과의 성능 및 연산 효율을 비교 평가한다. 이러한 연구를 통해 변색을 구조물 상태평가의 독립적인 시각 지표로 활용할 수 있는 기반을 마련하고, 향후 균열·박리·누수 등 다른 손상 지표와의 통합 분석으로 확장할 수 있는 가능성을 제시하고자 한다.

Ⅱ. 관련 연구

2.1 누수·습윤 자국 변색 검출을 위한 딥러닝

콘크리트 구조물에서 누수는 표면에 어두운 습윤 자국이나 얼룩 형태의 변색으로 나타나는 경우가 많으며, 이는 내부 수분 이동 및 균열·조인트 열화의 간접 지표가 될 수 있다. 이러한 누수 자국은 조도 변화, 그림자, 오염 등과 뒤섞여 나타나기 때문에, 단순 임계값 기반 영상처리로는 안정적인 검출이 어렵다. 이에 따라 터널 라이닝을 대상으로 누수 영역을 딥러닝으로 분할하거나 정량화하는 연구가 먼저 축적되고 있다.

Y. Xue et al.[9]은 지하철 터널 라이닝을 대상으로 SfM(Structure from Motion)에 기반한 3차원 재구성과 딥러닝 기반 누수 검출을 결합한 방법을 제안하였다. 먼저 SfM으로 터널 내벽의 3차원 점군 모델을 복원한 뒤, 열화된 구간의 영상에서 딥러닝 모델로 누수 영역을 인식하여 3차원 표면에 투영함으로써 누수 면적과 분포를 정량화하였다. 이 연구는 누수 자국과 같이 색·명도 변화로 나타나는 결함을 픽셀 수준으로 분할하고, 이를 면적, 지표 등의 유지관리 지표로 연계할 수 있음을 보여준다.

S. Zhao et al.[10]은 쉴드 터널 라이닝 표면의 습윤 자국을 대상으로 Mask R-CNN 기반 인스턴스 세그멘테이션을 적용하였다. 제안 모델은 터널 내부 저조도, 라이트 반사, 배관·케이블 가림 등 복잡한 환경에서도 누수 자국을 개별 객체 단위로 분리·검출할 수 있음을 보였으며, 전통적인 영상처리 기법에 비해 다양한 조명 조건에서 높은 강인성을 나타냈다.

P. Wang and G. Shi[11]는 이러한 연구 흐름을 확장하여, 복잡한 터널 환경에서 누수 영역을 보다 안정적으로 분리하기 위한 CSG-Unet(Customized Side Guided-Unet) 모델을 제안하였다. 해당 연구는 U-Net을 기본 구조로 사용하면서, 오츠(Otsu) 기반 다중 임계값 이진화를 통해 생성한 밝기 강조 채널을 보조 입력으로 활용하고, 병렬 어텐션 모듈과 채널 어텐션 모듈을 도입하여 저조도 환경에서 밝기 변화에 대한 민감도를 높였다. 터널 내 실측 이미지와 공개 데이터셋으로 구성된 데이터에 대해, 기본 U-Net 대비 누수 영역의 분할 정확도와 일반화 성능이 향상되는 것을 보고하였다[11].

이들 연구는 모두 누수·습윤 자국을 어두운 변색 패턴으로 인식하고, 색·명도·텍스처 특성을 학습한 딥러닝 모델을 통해 픽셀 수준 세그멘테이션 혹은 인스턴스 분할을 수행한다는 공통점을 가진다. 다만 대상 구조물은 대부분 지하 터널 또는 실내 라이닝이며, 촬영 조건도 차량·검측차량에 탑재한 카메라나 고정식 촬영 장비에 한정되어 있어, 드론으로 촬영한 교량 외부 콘크리트 표면까지 직접적으로 확장한 사례는 아직 보고되지 않았다.

2.2 백화 및 표면 변색 검출을 위한 딥러닝

콘크리트 및 조적 구조물에서 발생하는 백화(Efflorescence) 는 표면에 흰색 침전물 또는 밝은 얼룩이 나타나는 대표적인 변색 손상이다. 이는 미관 저하뿐 아니라 수분 이동, 염류 집적과 관련된 열화 징후로 간주되며, 수분 경로 및 투수성을 증가하는 간접 지표가 될 수 있다.

C.-L. Fan and Y.-J. Chung[12]은 콘크리트 백화를 자동 검출하기 위해 디지털 이미지에서 색상 기반 특징을 추출하고, 세 가지 지도학습 모델(SVM, Maximum Likelihood, Random Forest)을 비교 분석하였다. 실험 결과 SVM이 약 90% 수준의 분류 정확도를 보였으며, 조명 종류와 조도의 변화가 백화 검출 성능에 큰 영향을 미친다는 점을 정량적으로 분석하였다[12]. 이 연구는 백화와 같은 변색 손상이 색·명도 특징을 통해 자동 분류 가능한 대상임을 보여주는 동시에, 조명 변화에 대한 강인성 확보 가 핵심 과제임을 지적한다.

보다 직접적으로 딥러닝을 활용한 백화 검출 연구로는 S. Nayır and Y. Yılmaz[13]의 논문이 있다. 이들은 콘크리트 및 미장(Plaster) 표면에서 발생하는 백화 결함을 대상으로, 아이폰으로 촬영한 600여 장의 이미지를 라벨링하여 YOLOv8x 기반 객체 검출 모델을 학습하였다. 학습된 모델은 정확도(Accuracy), 재현율(Recall), 정밀도(Precision), mAP@0.5 및 mAP@0.5–0.95에서 각각 약 0.96, 0.90, 0.99, 0.85, 0.63 수준의 성능을 달성하였다고 보고되며, 백화 손상을 자동으로 검출하는 데 딥러닝이 유효함을 보여준다[13]. 동시에, 밝은 색상의 콘크리트 또는 흰색 도장면에서는 배경과 백화의 색 대비가 낮아 검출 성능이 저하되고, 넓게 퍼진 저대비 변색에 대해서는 검출이 어려운 한계도 논의된다[13].

건물 외피 전반의 변색·열화 결함을 포함하는 연구를 진행했던 연구에서는, 건물 외벽에서 발생하는 곰팡이(Mould), 열화(Deterioration), 얼룩(Stain) 등의 결함을 대상으로, VGG-16 기반 사전학습 CNN 분류기를 구축하고 CAM(Class Activation Map)을 이용해 결함 위치를 약하게 국소화(Weak localization)하였다. 다양한 조명·배경 조건에서 균열, 오염, 변색 등을 포함한 결함 클래스를 안정적으로 분류하고, CAM을 통해 결함이 위치한 영역을 시각적으로 강조할 수 있음을 보였다[14]. 다만 출력이 이미지 수준 분류 + 히트맵 시각화에 주로 초점을 두고 있어, 변색 영역을 정량적으로 세그멘테이션하는 데에는 한계가 있다.

이러한 연구들은, 기존 백화·표면 변색 관련 전통적인 지도학습 기반 분류 모델로 백화 여부를 판정하거나[12], YOLO 계열 딥러닝 객체 검출을 통해 백화 영역을 바운딩 박스 단위로 검출하는 접근[13], 건물 외피 결함 전체를 CNN으로 분류하고 CAM을 활용해 변색·열화 영역을 간접적으로 강조하는 접근[14]으로 정리할 수 있다. 이들 연구는 모두 색상·텍스처 변화에 기반한 변색 패턴을 학습 대상으로 삼고 있으나, 대부분이 정확한 픽셀 단위 분할이 아닌 분류/검출/약한 국소화 에 중점을 두고 있다는 공통된 한계를 가진다.

Ⅲ. 제안하는 연구 방법

3.1 연구 개요 및 시스템 구성

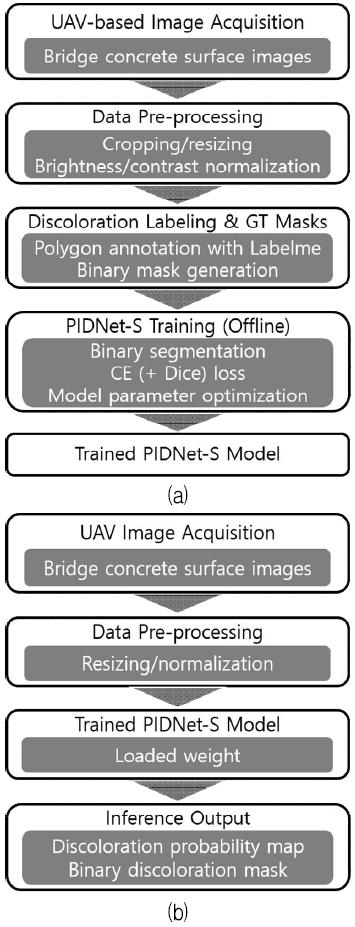

본 연구는 드론으로 촬영된 교량 콘크리트 표면 영상에서 변색 영역을 실시간으로 분할하기 위한 PIDNet 기반 이진 세그멘테이션 모델을 구현하였다. 그림 1은 제안하는 방법의 전체적인 처리 개요를 나타내며, 모델 학습을 위한 오프라인 단계와 실제 적용을 위한 온라인 추론 단계를 함께 포함한 개념적 흐름을 제시한다.

Overview of the PIDNet-S–based concrete discoloration segmentation system (a) Training pipeline, (b) Inference pipeline

모델 학습을 위한 오프라인 단계에서는 교량 외부 부재를 드론으로 촬영하여 고해상도 이미지를 확보하고, 촬영된 이미지를 고정 크기로 정규화한 후 변색 영역을 폴리곤 형태로 수동 라벨링하여 이진 GT(Ground Truth) 마스크를 생성한다. 드론 기반 교량 점검 영상의 활용 가능성은 기존 연구에서 이미 검토된 바 있으며[2][3][6], 본 연구에서는 이러한 접근을 콘크리트 표면 변색 탐지에 특화하여 적용하였다. 변색의 정의와 라벨링 기준에 대한 상세 내용은 3.3절에서 기술한다.

생성된 이미지–마스크 쌍을 이용하여 PIDNet 기반 이진 세그멘테이션 모델을 학습한다. PIDNet은 실시간 시맨틱 세그멘테이션을 목적으로 설계된 경량 네트워크로, 도로 장면 분할 등에서 정확도와 처리 속도의 균형을 보인 바 있다[7]. 본 연구에서는 PIDNet-S 구조를 기반으로 변색 검출에 적합하도록 출력부를 이진 분할 형태로 구성하였다.

실제 적용을 위한 온라인 추론 단계에서는 학습된 모델만을 사용하며, 라벨링 및 학습 과정은 수행되지 않는다. 학습이 완료된 PIDNet-S 모델에 새로운 드론 촬영 이미지를 입력하면, 픽셀 단위 변색 확률맵과 이에 기반한 이진 변색 마스크가 출력된다. 이를 통해 드론 기반 교량 점검 환경에서 변색 영역을 실시간으로 식별할 수 있다.

3.2 데이터셋 구성

본 연구에서 사용한 데이터셋은 국내 교량 및 고가도로 구조물을 대상으로 드론을 활용하여 직접 촬영한 콘크리트 표면 이미지를 기반으로 구축하였다. 촬영 대상은 실제 운영 중인 교량 구조물로, 교량 상부 구조물의 콘크리트 표면을 중심으로 다양한 변색 양상이 포함되도록 구성하였다. 드론 기반 영상과 컴퓨터 비전을 결합하여 교량 손상을 자동으로 평가하는 접근은 기존 연구에서도 그 유효성이 보고된 바 있으며[2][3][6], 본 연구는 이러한 흐름을 콘크리트 표면 변색 탐지 문제에 특화하여 적용하였다.

본 연구에서는 총 700장의 이미지를 사용하였으며, 이를 학습(Training), 검증(Validation), 테스트(Test) 데이터셋으로 분할하였다. 데이터 분할은 원본 이미지 단위로 수행하여, 동일한 촬영 원본에서 파생된 이미지가 서로 다른 데이터셋에 동시에 포함되지 않도록 함으로써 학습 및 평가 과정에서의 데이터 누출(Data leakage)을 방지하였다. 이러한 데이터 구성 방식은 모델의 일반화 성능을 보다 객관적으로 평가하기 위한 것이다.

3.3 변색 정의 및 라벨링 기준

콘크리트 표면 변색은 재료 조성, 수분 이동, 열화 정도에 따라 다양한 색상·명도 패턴으로 나타나며, 열화 징후와의 관련성이 실험적으로 보고된 바 있다[1]. 또한 터널 라이닝의 습윤 자국·누수[5][9][11], 콘크리트·미장 표면의 백화[12][13], 건물 외피의 곰팡이·얼룩 등 결함[14]은 모두 색상·명도 변화 형태의 변색 패턴으로 관찰되며, 딥러닝 기반 검출 연구의 대상으로 다루어져 왔다. 본 연구에서는 이러한 선행 연구를 참고하여 교량 콘크리트 표면 변색을 다음과 같이 정의하였다. 변색은 주변 정상 콘크리트와 비교할 때 육안으로 식별 가능한 수준의 색상(Hue), 명도(Lightness), 채도(Saturation) 차이가 지속적으로 분포하는 영역으로서, 누수·습윤에 의한 어두운 자국, 오염으로 인한 흑색·갈색 얼룩, 백화 및 분말형·막형 백색 침전 등이 포함되는 영역을 포괄한다. 한편 균열, 박리·박락, 노출 철근 등 형상(Geometry)을 중심으로 하는 구조적 손상은 변색과 구분하여 배경으로 취급하며, 촬영 조건에 기인한 그림자, 일시적인 강한 반사, 점검자·장비의 투영 등은 변색으로 간주하지 않는다.

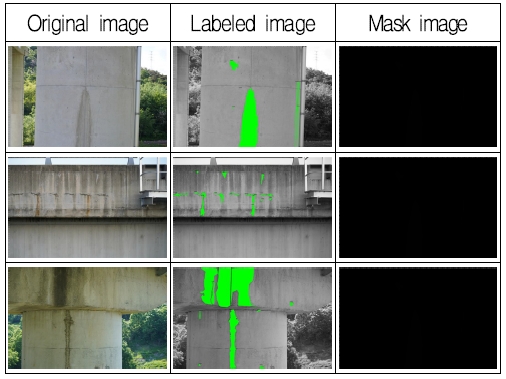

라벨링은 오픈소스 어노테이션 툴인 Labelme를 사용하여 수행하였다. 각 이미지에 대해 라벨러는 위 정의에 따라 변색으로 판단되는 영역을 폴리곤 도구로 둘러싸고, 해당 폴리곤에 단일 클래스 태그를 부여하였다. 변색 영역이 여러 조각으로 나뉘어 있을 경우, 각각을 독립 폴리곤으로 라벨링하되 동일 클래스에 포함하였다. 생성된 JSON 라벨 파일은 변환 스크립트를 통해 이진 마스크로 변환되며, 마스크에서 변색 영역은 값 1, 배경은 값 0으로 인코딩된다. 모든 이미지는 PIDNet 입력에 적합하도록 512×512 픽셀로 리사이즈하였다.

본 연구에서 구축한 데이터셋에는 다양한 형태의 변색 패턴이 포함되어 있다. 라벨링 결과를 기준으로 분석한 결과, 전체 변색 영역 중 누수·습윤에 의한 어두운 자국이 가장 큰 비중을 차지하였으며, 그 다음으로 오염에 의한 흑색·갈색 얼룩, 백화 및 백색 침전 형태의 변색이 분포하였다. 이러한 구성은 실제 교량 콘크리트 표면에서 관찰되는 변색 양상과 유사한 분포를 보이며, 단일 유형에 편중되지 않은 변색 데이터셋을 형성한다. 그림 2는 이러한 변색 유형 중 일부를 대표적으로 제시한 예시이다.

3.4 PIDNet-S 기반 변색 세그멘테이션 모델

PIDNet은 J. Xu et al.[7]이 제안한 실시간 시맨틱 세그멘테이션 네트워크로, PID 제어기의 개념을 네트워크 구조에 적용한 것이 특징이다. 이 모델은 대략적으로 세 가지 브랜치(고해상도 특징, 저해상도 문맥, 경계 보완)를 통해 세부 특징과 전역 문맥, 경계 정보를 동시에 처리하며, Cityscapes 데이터셋 기반 평가에서 정확도(mIoU)와 추론 효율(FPS)을 균형 있게 확보한 실시간 세그멘테이션 모델로 보고되었다[7].

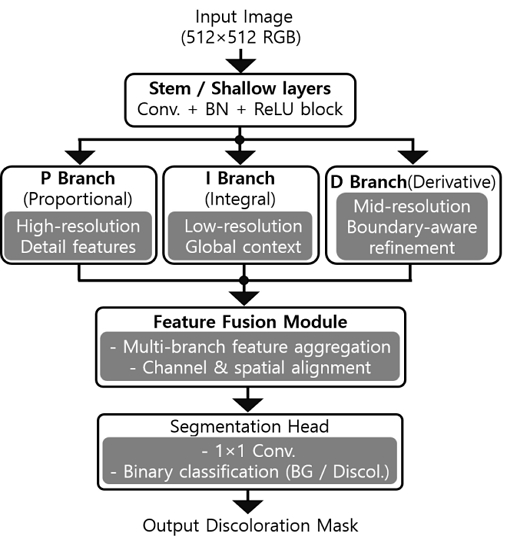

본 연구에서는 PIDNet 계열 중 비교적 경량인 PIDNet-S 구조를 기반으로, 표 2와 같이 배경과 변색 영역을 구분하는 2클래스 이진 세그멘테이션에 적합하도록 출력부를 단순화하여 구성하였다. 입력은 512×512 RGB 이미지이고, 출력은 두 채널(배경, 변색)을 갖는 픽셀 단위 클래스 확률맵이다. 최종 출력은 softmax 연산을 통해 두 클래스에 대한 확률로 변환되며, 변색 클래스의 확률이 일정 임계값을 초과하는 픽셀을 변색 영역으로 판정한다.

그림 3은 본 연구에서 사용한 PIDNet-S 기반 변색 세그멘테이션 네트워크의 전체 구조를 나타낸다. PIDNet-S는 원본 PIDNet이 제안한 P–I–D 다중 브랜치 개념을 유지하면서, 채널 수와 네트워크 깊이를 축소하여 연산량과 파라미터 수를 감소시킨 경량화 모델이다. 본 연구에서는 이러한 PIDNet-S의 경량 구조를 채택함으로써, 변색 세그멘테이션 문제에서도 실시간 추론이 가능하도록 설계하였다.

제안 모델은 기존 PIDNet-S의 기본 아키텍처를 그대로 유지하며, 고해상도 디테일 정보를 담당하는 P 브랜치, 저해상도 전역 문맥 정보를 추출하는 I 브랜치, 그리고 중간 해상도에서 경계 변화를 보정하는 D 브랜치로 구성된다. 각 브랜치에서 추출된 특징은 특징 융합 모듈을 통해 채널 및 공간 정렬을 거쳐 통합되며, 이후 출력부에서는 1×1 합성곱 연산을 적용하여 최종 분할 결과를 생성한다.

기존 PIDNet-S가 도심 장면을 대상으로 한 다중 클래스 세그멘테이션을 목적으로 설계된 것과 달리, 본 연구에서는 콘크리트 변색 검출이라는 이진 분할 문제에 적합하도록 출력부(head)만을 단순화하여 수정하였다. 이를 통해 네트워크의 경량성과 실시간 처리 특성을 유지하면서도, 변색 영역의 경계 표현과 분할 성능을 효과적으로 확보할 수 있다.

PIDNet 자체는 주로 교통 장면 분할에 적용되어 왔으며[7], 콘크리트 변색 세그멘테이션에 직접 적용된 선행 연구는 제공된 참고문헌 범위 내에서는 확인하지 못하였다. 그러나 구조물 표면 결함 검출 분야의 딥러닝 활용 동향[4][6][13]과 터널 누수·백화 등 변색 패턴에 대한 세그멘테이션·검출 연구[5][8][12]를 고려할 때, 경량·실시간 세그멘테이션 모델을 변색 탐지에 적용하는 접근은 합리적인 확장으로 볼 수 있다.

3.5 학습 설정

학습 하이퍼파라미터 설정은 데이터셋 규모와 GPU 메모리 제약 등을 고려하여 결정하였다. 이 절에서는 구체적인 수치보다는 설정의 방향과 근거를 기술한다.

본 연구에서는 딥러닝 기반 구조물 결함 검출 분야에서 널리 활용되고 있는 Adam 및 모멘텀을 포함한 SGD를 최적화 알고리즘으로 사용하였다[3][10][13]. 초기 학습률은 1×10⁻³으로 시작하였으며, 학습이 진행됨에 따라 단계적으로 학습률을 감소시키는 step decay 스케줄을 적용하였다. 배치 크기는 GPU 메모리 용량을 고려하여 4~8 이미지 수준에서 선택하였고, 학습 epoch 수는 검증(Validation) 데이터의 손실 및 성능 지표가 수렴하는 시점까지 반복하였다. 특정 epoch 수 이상에서 검증 성능이 개선되지 않을 경우, 조기 종료(Early stopping)를 통해 과적합을 방지하였다. 이러한 설정은 세그멘테이션 및 결함 검출 연구에서 흔히 사용되는 범위이며[3][10][13], 변색 세그멘테이션에 대한 별도의 표준값은 문헌에서 제시된 바 없다. 손실 함수로는 기본적으로 픽셀 단위 cross-entropy 손실을 사용하였으며, 변색 영역이 전체 픽셀 수에 비해 상대적으로 적은 경우, 클래스 불균형을 완화하기 위해 Dice 항을 가중합 형태로 추가하는 복합 손실을 시험적으로 적용하였다. 재현성 확보를 위해, 본 연구에서 실제 사용한 주요 학습 하이퍼파라미터는 표 3에 정리하여 제시한다.

모든 모델은 배치 크기 8로 학습하였으며, 최대 학습 epoch 수는 200으로 설정하였다. 초기 학습률은 1×10−3으로 설정하고, 학습이 진행됨에 따라 step decay 방식으로 감소시키는 학습률 스케줄을 적용하였다. 구체적으로는 80 epoch 및 140 epoch에서 학습률을 각각 0.1배로 감소시켰다. 최적화 알고리즘으로는 Adam 옵티마이저를 사용하였으며, 𝛽1=0.9, 𝛽2=0.999로 설정하였다. 모든 실험에서 동일한 학습 설정을 적용하여 모델 간 공정한 비교가 이루어지도록 하였다.

Ⅳ. 실 험

4.1 실험 환경

실험 환경은 표 4과 같다. 실험은 GPU 가속이 가능한 워크스테이션 환경에서 수행하였다. 운영체제는 64비트 리눅스 기반 환경(예: Ubuntu 계열)을 사용하였으며, CUDA를 지원하는 NVIDIA GPU 1기와 32 GB 이상 메인 메모리를 탑재하였다. 딥러닝 프레임워크는 Python 기반 PyTorch 계열 라이브러리를 사용하였고, 데이터 전처리와 시각화에는 OpenCV, NumPy, Matplotlib 등을 활용하였다. 이러한 구성은 교량·터널 손상 인식을 위한 딥러닝 연구[3][5][11][14]에서 보고되는 일반적인 실험 환경과 유사한 수준이다.

학습·추론 파이프라인 구현과 모델 구조 정의는 PIDNet 원 논문[7] 및 콘크리트 균열 탐지에 PIDNet을 적용한 선행 연구[8]에서 제시한 코드를 참고하여 구성하였다. 단, 본 연구에서는 균열이 아닌 변색 세그멘테이션을 대상으로 하므로, 출력 클래스 수(배경/변색)와 손실 함수 구성이 기존 연구와 다르다.

4.2 실험 방법

실험은 3장에서 구축한 데이터셋을 대상으로 수행하였다. 학습과 평가는 배경–변색 이진 세그멘테이션을 기준으로 하며, 모든 모델에 대해 동일한 학습·평가 절차를 적용하여 공정한 비교가 이루어지도록 하였다. 데이터 분할 및 세그멘테이션 평가 방식은 구조물 표면 결함 검출 연구[4][6][11][14]와 누수·습윤 세그멘테이션 연구[5][9][10]에서 사용되는 일반적인 프로토콜을 참고하였다.

학습 데이터는 리사이즈를 적용한 뒤 PIDNet 기반 변색 세그멘테이션 모델을 학습하였다. 학습 시 손실 함수는 픽셀 단위 cross-entropy 손실을 기본으로 사용하였으며, 변색 영역의 클래스 불균형 정도에 따라 Dice 항을 가중합 형태로 추가하는 복합 손실을 시험적으로 적용하였다. 학습률, 배치 크기, epoch 수 등 하이퍼파라미터는 검증 데이터셋의 성능을 기준으로 조정하였다.

제안 모델의 성능을 비교·검증하기 위해 표 5와 같이 변색 세그멘테이션에 널리 사용 가능한 대표적인 세그멘테이션 모델들을 선택하여 동일 데이터셋에서 학습·평가하였다. 비교 대상으로는 구조물 결함 인식에 널리 사용되는 U-Net 계열 모델과 딥러닝 기반 터널 누수 세그멘테이션에서 검증된 개선형 U-Net 모델[11], 그리고 표면 결함 검출에서 자주 활용되는 DeepLab 계열 모델[4][6] 등을 포함할 수 있다. 어떤 모델을 비교 대상으로 선택할지는 실제 구현 범위와 연구 초점에 따라 결정해야 하며, 본 논문에서는 다음과 같은 구성을 예시적으로 제시한다.

성능 평가는 테스트 데이터셋을 대상으로 다양한 정량적 지표를 활용하여 수행하였다. 먼저 변색 클래스에 대한 분할 성능을 평가하기 위해 IoU를 산정하였다. 또한 변색 영역 검출의 분류 성능을 보다 종합적으로 분석하기 위해 정밀도, 재현율, F1-score를 함께 계산하였다. 아울러 전체 픽셀에 대한 정확도(Pixel accuracy)를 보조 지표로 산출하여 모델의 전반적인 분할 성능을 추가적으로 분석하였다. 아울러 모델의 효율성을 비교하기 위해 파라미터 수와 FLOPs를 측정하고, 단일 이미지당 추론 시간 또는 FPS(Frame Per Second)를 기준으로 추론 속도를 평가하였다. 또한 각 모델의 성능 변동성을 고려하기 위하여, U-Net, Improved U-Net, Mask R-CNN, PIDNet-S 모든 모델에 대해 서로 다른 난수 시드(Random seed)로 3회 독립적으로 학습을 수행하였다. 학습·검증·테스트 데이터 분할, 전처리 및 증강 조건은 모델 간 공정한 비교를 위해 모든 실험에서 동일하게 유지하였다. 추론 속도(FPS)는 테스트 데이터셋에서 임의로 선택한 이미지를 512×512 해상도로 리사이즈한 후 배치 크기 1로 입력하여 측정하였다. 각 모델에 대해 동일한 조건에서 5회 반복 측정을 수행하고, 그 평균값을 최종 추론 속도로 사용하였다. GPU 부하 및 시스템 상태에 따라 측정값에 소폭의 변동이 발생할 수 있으므로, 표에는 평균값을 기준으로 소수 첫째 자리에서 반올림한 결과를 제시하였다.

4.3 실험 결과

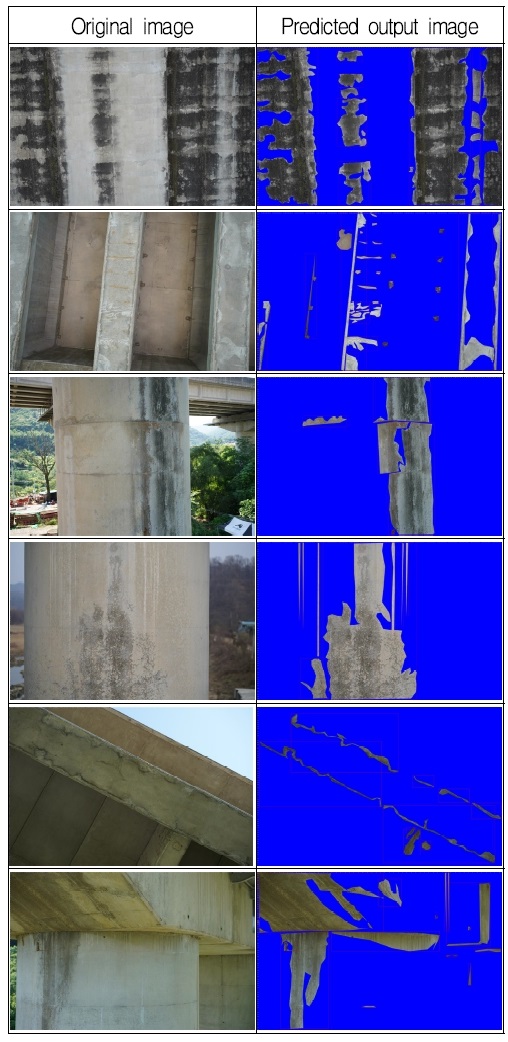

그림 5는 PIDnet의 변색 검출 결과 데이터 중 일부를 보여주는 그림이다. 테스트 데이터셋 100장을 대상으로 제안한 PIDNet-S 기반 변색 세그멘테이션 모델과 비교 모델의 성능을 평가한 결과는 표 6 및 7과 같다. 모든 모델에 대해 서로 다른 난수 시드(Random seed)를 사용하여 3회 독립적으로 학습을 수행하였으며, 표에 제시된 IoU, F1-score, Pixel Accuracy 값은 이들 반복 실험 결과의 평균값이다. 추론 속도(FPS)는 입력 해상도 512×512, 배치 크기 1 조건에서 각 모델에 대해 5회 반복 측정한 후 평균값을 사용하였고, 표에서는 소수 첫째 자리에서 반올림하여 제시하였다.

Comparison of concrete discoloration segmentation performance between the proposed and baseline models

정확도 측면에서, Mask R-CNN은 변색 IoU 90.0%, F1-score 94.5%, Pixel Accuracy 98.5%로 가장 높은 수치를 기록하였다. 이는 쉴드 터널 라이닝 습윤 자국 인스턴스 세그멘테이션에서 높은 검출 성능을 보고한 선행 연구와 유사한 경향을 보인다[5][10]. 제안한 PIDNet-S는 IoU 89.0%, F1-score 93.0%, Pixel Accuracy 98.0%로 Mask R-CNN에 근접한 수준의 분할 성능을 달성하였으며, Improved U-Net(86.0%, 90.0%)과 U-Net(84.0%, 88.0%)에 대해서는 변색 클래스 기준으로 분명한 성능 우위를 나타냈다. 이는 균열 탐지에 적용된 선행 연구에서 보고된 바와 같이[8], PIDNet이 세부 구조 정보와 전역 문맥 정보를 동시에 활용하여 구조물 표면 결함을 효과적으로 분할할 수 있음을 재확인해 주는 결과이다[7][8].

연산 효율 측면에서는 PIDNet-S의 장점이 두드러졌다. PIDNet-S는 약 7.6M의 파라미터와 25 FPS 수준의 추론 속도를 보였으며, 이는 U-Net(31M, 11 FPS), Improved U-Net(34M, 10 FPS), Mask R-CNN(44M, 8 FPS)과 비교할 때 모델 크기와 추론 속도 모두에서 유의미하게 우수한 결과이다. 특히 PIDNet-S는 Mask R-CNN과 거의 동급의 변색 분할 성능을 유지하면서도, 파라미터 수는 약 1/5 수준, FPS는 3배 이상 빠른 것으로 나타났다. 따라서, 제안한 PIDNet-S 기반 변색 세그멘테이션 모델은 기존 U-Net 계열 및 Mask R-CNN 대비 정확도–속도 트레이드오프 측면에서 균형 잡힌 성능을 보여, 드론 기반 교량 점검과 같이 엣지 단에서 실시간 처리가 요구되는 응용에 적합한 대안이 될 수 있음을 확인하였다.

Ⅴ. 고찰 및 한계점

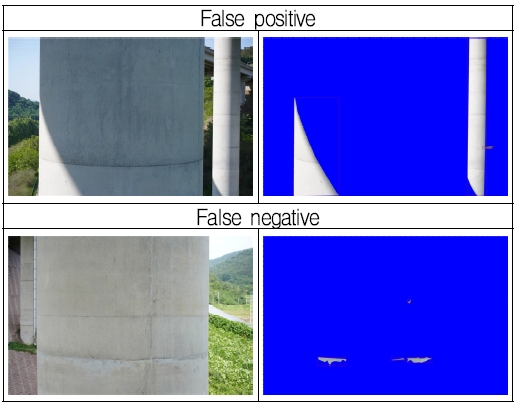

본 절에서는 제안한 PIDNet-S 기반 변색 세그멘테이션 모델의 한계와 함께, 오탐지(False positive) 및 미탐지(False negative) 사례를 중심으로 성능 특성을 분석한다. 그림 6은 대표적인 오탐지 및 미탐지 사례를 시각적으로 제시한다.

오탐지 사례는 주로 콘크리트 표면의 음영, 그림자, 국부적인 오염 흔적이 변색 영역과 유사한 색상 및 명도 분포를 보이는 경우에 발생하였다. 이는 본 연구가 RGB 영상 기반 접근을 채택함에 따라, 조도 변화와 표면 반사 특성에 민감하게 반응하는 한계에서 기인한 것으로 판단된다[5][11]. 특히 드론 촬영 환경에서는 촬영 각도와 태양 고도에 따른 조명 변화가 불가피하므로, 이러한 오탐지 경향이 일부 관찰될 수 있다. 미탐지 사례는 변색 영역의 색 대비가 매우 낮거나, 경계가 주변 정상 콘크리트 영역과 점진적으로 변화하는 경우에 주로 나타났다. 이러한 영역은 변색의 공간적 범위가 작고 시각적 특징이 미약하여, 학습 과정에서 충분히 강조된 특징으로 반영되지 않았을 가능성이 있다. 또한 본 연구에서는 변색을 단일 클래스로 정의하여 이진 세그멘테이션 문제로 다루었기 때문에, 변색 유형 간의 미세한 차이를 모델이 구분하지 못하는 구조적 한계가 존재한다.

그럼에도 불구하고, 본 연구의 목적은 변색의 정밀한 유형 분류보다는, 드론 기반 교량 점검 환경에서 실시간 처리가 가능한 경량 모델을 통해 변색 영역을 신속하게 식별하는 데 있다. 이러한 관점에서 PIDNet-S는 정확도와 추론 속도 간의 균형 측면에서 실용적인 대안을 제공한다. 향후 연구에서는 다중 스펙트럼 영상의 활용, 조도 보정 기반 전처리 기법의 결합, 또는 변색 유형별 다중 클래스 세그멘테이션 확장을 통해 오탐지 및 미탐지 문제를 완화하고 모델의 활용 범위를 확장할 수 있을 것으로 기대된다.

본 연구에서는 실시간성을 강조하면서도 비교 모델로 U-Net 및 Mask R-CNN과 같은 정확도 중심의 세그멘테이션 모델을 포함하였다. 이는 변색 세그멘테이션 문제에서 달성 가능한 성능의 상한선을 함께 비교함으로써, 제안 모델의 정확도–속도 균형 특성을 보다 명확히 분석하기 위함이다. BiSeNet, ENet, Fast-SCNN 등 기존의 실시간 세그멘테이션 모델들은 주로 도심 도로 장면을 대상으로 설계·검증되었으며, 구조물 표면 결함이나 변색과 같은 비정형적이고 경계가 모호한 대상에 대한 적용 사례는 제한적으로 보고되고 있다. 이에 본 연구는 구조물 결함 검출 분야에서 널리 사용되어 온 대표 모델들을 비교 기준으로 삼아, PIDNet-S가 정확도 저하 없이 실시간 처리가 가능한 대안이 될 수 있음을 검증하고자 하였다. 향후 연구에서는 BiSeNet 계열 등 타 실시간 모델과의 직접 비교를 통해, 변색 세그멘테이션 문제에서의 상대적 장단점을 보다 폭넓게 분석할 필요가 있다.

Ⅵ. 결 론

본 연구에서는 드론으로 촬영한 교량 콘크리트 영상을 대상으로, 변색 영역을 효율적으로 분할하기 위한 PIDNet-S 기반의 경량 실시간 세그멘테이션 모델을 제안하였다. 변색은 균열·박락과 달리 경계가 모호하고 조도 변화의 영향을 크게 받는 특성이 있어, 기존 U-Net 계열 모델 또는 인스턴스 세그멘테이션 모델의 성능이 상황에 따라 크게 변동하는 한계가 보고되어 왔다. 이러한 문제를 해결하기 위해 본 연구는 PIDNet-S의 실시간 처리 구조와, 라벨링 기반 이진 분할 방식을 결합하여 변색 영역을 안정적으로 분할하는 접근을 적용하였다.

실험 결과, 제안한 PIDNet-S 모델은 변색 IoU 89.0%, F1-score 93.0%, Pixel Accuracy 98.0%로, 기본 U-Net 및 Improved U-Net 대비 명확한 성능 향상을 보였으며, Mask R-CNN과 유사한 정확도를 달성하였다. 특히 파라미터 수 7.6M, 약 25 FPS 수준의 추론 속도는 U-Net(≈11 FPS), Mask R-CNN(≈8 FPS) 대비 실시간성에서 뚜렷한 우위를 보여, 실제 드론 기반 점검 환경에서의 적용 가능성을 크게 높여준다. 이러한 결과는 PIDNet이 도심 장면 및 구조물 균열 탐지에서 보고된 실시간 처리 능력이 변색 탐지 문제에도 효과적으로 확장될 수 있음을 확인한 것이다[7][8].

본 연구는 변색이라는 단일 클래스를 대상으로 한 초기 연구로서, 변색 범주의 다양성이 라벨링 품질과 성능에 영향을 줄 수 있으며, 드론 촬영 조건의 변화에 대한 강건성 역시 추가 검증이 필요하다. 향후 연구에서는 다양한 유형의 변색 데이터를 포함한 대규모 교량 표면 데이터셋 구축, 조도 보정·컬러 특성 기반 전처리 기법 통합, 변색·균열·박락 등 다중 결함 통합 세그멘테이션 모델 확장 등을 수행함으로써, 보다 포괄적인 교량 표면 상태 진단 시스템으로 발전시킬 수 있을 것으로 판단된다.

Acknowledgments

본 논문은 산업통상자원부의‘지역혁신클러스터육성(R&D) 거점기관 개방형혁신’사업의 연구비지원(P0025720)으로 수행된 연구결과입니다

References

-

M. Ishikawa, M. Tsukagoshi, H. Kasano, and H. Nishino, "Influence of composition and surface discoloration of concrete on active thermographic nondestructive inspection", Measurement, Vol. 168, pp. 108395, Jan. 2021.

[https://doi.org/10.1016/j.measurement.2020.108395]

- B. Shafei and I. Odeh, "Automated assessment of defects in bridge structures using computer vision and UAV-based imaging", Final Research Report, Bridge Engineering Center, Iowa State University, Ames, IA, USA, 2025. https://bec.iastate.edu/wp-content/uploads/2025/04/automated_assessment_of_defect_in_bridge_structures_w_cvr.pdf, .

-

Y.-H. Na and D.-K. Kim, "Deep learning strategy for UAV-based multi-class damage detection on railway bridges using U-Net with different loss functions", Applied Sciences, Vol. 15, No. 15, pp. 8719, Aug. 2025.

[https://doi.org/10.3390/app15158719]

-

J. Guo, P. Liu, B. Xiao, L. Deng, and Q. Wang, "Surface defect detection of civil structures using images: Review from data perspective", Automation in Construction, Vol. 158, pp. 105186, Feb. 2024.

[https://doi.org/10.1016/j.autcon.2023.105186]

-

S. Zhao, D. M. Zhang, and H.-W. Huang, "Deep learning–based image instance segmentation for moisture marks of shield tunnel lining", Tunnelling and Underground Space Technology, Vol. 95, 103156, Jan. 2020.

[https://doi.org/10.1016/j.tust.2019.103156]

-

X. Pan, T. T. Y. Yang, J. Li, C. Ventura, C. Málaga-Chuquitaype, C. Li, R. K. L. Su, and S. Brzev, "A review of recent advances in data-driven computer vision methods for structural damage evaluation: Algorithms, applications, challenges, and future opportunities", Archives of Computational Methods in Engineering, Vol. 32, pp. 4587-4619, Apr. 2025.

[https://doi.org/10.1007/s11831-025-10279-8]

-

J. Xu, Z. Xiong, and S. P. Bhattacharyya, "PIDNet: A real-time semantic segmentation network inspired by PID controllers", Proc. IEEE/CVF Conf. on Computer Vision and Pattern Recognition (CVPR), Vancouver, Canada, pp. 19529-19539, Jun. 2023.

[https://doi.org/10.1109/CVPR52729.2023.01871]

-

Y. K. Kim, D. Y. Choi, J. H. Chung, and D. N. Kim, "Implementation of a real-time concrete crack detection model based on PIDNet", Journal of KIIT, Vol. 22, No. 12, pp. 155-164, Dec. 2024.

[https://doi.org/10.14801/jkiit.2024.22.12.155]

-

Y. Xue, P. Shi, F. Jia, and H. Huang, "3D reconstruction and automatic leakage defect quantification of metro tunnel based on SfM–deep learning method", Underground Space, Vol. 7, No. 3, pp. 311-323, Jun. 2022.

[https://doi.org/10.1016/j.undsp.2021.08.004]

-

S. Zhao, D. M. Zhang, and H.-W. Huang, "Deep learning–based image instance segmentation for moisture marks of shield tunnel lining", Tunnelling and Underground Space Technology, Vol. 95, pp. 103156, Jan. 2020.

[https://doi.org/10.1016/j.tust.2019.103156]

-

P. Wang and G. Shi, "Image segmentation of tunnel water leakage defects in complex environments using an improved U-net model", Scientific Reports, Vol. 14, pp. 24286, Oct. 2024.

[https://doi.org/10.1038/s41598-024-75723-4]

-

C.-L. Fan and Y.-J. Chung, "Supervised machine learning–based detection of concrete efflorescence", Symmetry, Vol. 14, No. 11, pp. 2384, Nov. 2022.

[https://doi.org/10.3390/sym14112384]

-

S. Nayır and Y. Yılmaz, "Determination of the efflorescence defects on concrete and plaster surfaces using a novel deep-learning model", Journal of Structural Engineering & Applied Mechanics, Vol. 7, No. 2, pp. 123-135, Jul. 2024.

[https://doi.org/10.31462/jseam.2024.02123135]

-

H. Perez, J. H. M. Tah, and A. Mosavi, "Deep learning for detecting building defects using convolutional neural networks", Sensors, Vol. 19, No. 16, pp. 3556, Aug. 2019.

[https://doi.org/10.3390/s19163556]

2005년 2월 : 경주대학교 전자공학과(공학사)

2011년 2월 : 경북대학교 모바일통신공학과(공학석사)

2016년 8월 : 경북대학교 전자공학부(공학박사)

(재)경북IT융합산업기술원 선임연구원

관심분야 : 컴퓨터 아키텍처, 운영체제, 인공지능

2001년 2월 : 울산대학교 제어계측(공학사)

2003년 2월 : 울산대학교 전기전자정보시스템공학(공학석사)

2010년 2월 : 울산대학교 전기전자정보시스템공학(공학박사)

2013년 6월 ~ 현재 : (재)경북IT융합산업기술원 책임연구원

관심분야 : 영상처리, 드론, 배터리

2014년 2월 : 영남대학교 생명공학부(공학사)

2018년 2월 : 경북대학교 전자공학부(공학석사)

2022년 3월 ~ 현재 : 경북대학교 전기전자공학부 공학박사과정

2023년 2월 ~ 현재 : 주식회사 파미티 기술이사(공동대표)

관심분야 : 인공지능, 3D, 컴퓨터 비전, 머신러닝