도플러 레이더와 YOLO 기반의 손동작 인식을 이용한 디스플레이 제어 시스템

초록

본 논문에서는 24GHz 도플러 레이더와 YOLO(You Only Look Once)를 활용하여 실시간 손동작 인식 및 디스플레이 제어 시스템을 구현하였다. 손동작에 따른 도플러 특성을 추출하기 위해 손동작에 따른 스펙트로그램 영상을 생성하였으며, 이를 통해 6개의 손동작에 대하여 각각 500개씩, 총 3000개의 스펙트로그램 영상을 수집하였다. 수집된 스펙트로그램 영상으로 YOLOv5(YOLO version 5) 분류기의 학습을 진행하였으며, 학습된 모델을 이용해 각 손동작에 대해 100개씩 총 600개의 데이터를 테스트한 결과 97.833%의 정확도를 보였다. 분류된 손동작은 BLE(Bluetooth Low Energy) 기반 무선 통신으로 제어 명령을 전달한 후, 그 명령에 따라 디스플레이가 정확히 제어되는지를 확인하였다. 실험 결과 6개의 제어 기능이 정확히 수행됨을 입증하였다.

Abstract

A real-time hand gesture recognition and display control system was developed using a 24 GHz Doppler radar and You Only Look Once (YOLO). To extract Doppler features corresponding to each gesture, spectrogram images were generated for six distinct hand gestures, with 500 images collected per gesture, resulting in a total of 3,000 images. The spectrogram images were used to train the YOLOv5 classifier. The trained model was evaluated on 600 test samples, with 100 samples for each gesture, and achieved an accuracy of 97.833%. The recognized gestures were transmitted as control commands via Bluetooth Low Energy (BLE) wireless communication, and the correct execution of display control for each command was verified. Experimental results demonstrate that all six control functions are accurately performed.

Keywords:

YOLO classifier, Doppler characteristic, 24GHz Doppler radar, hand gesture, spectrogramⅠ. 서 론

최근 AI(Artificial Intelligence) 기술과 가상 및 증강 현실 발전으로 HCI(Human Computer Interaction)에 관한 관심이 증가하고 있다. 특히, 손동작 인식 기술은 이미 다양한 상용 제품에 적용되어 높은 수준의 비접촉 HCI를 실현하고 있다. Microsoft HoloLens 2와 같은 기기는 손 추적 기능을 기반으로 사용자가 혼합현실(MR) 콘텐츠와 자연스럽고 직관적으로 상호작용할 수 있도록 지원하며, 가정, 의료, HCI 연구 등 다양한 분야에서 활발히 활용되고 있다[1].

손동작 인식 HCI는 글러브와 카메라 등 여러 방법으로 사용되고 있으며 글러브를 사용하는 경우, 착용에 대한 번거로움과 추가적인 방해 요소가 될 수 있다[2]. 반면 카메라는 조도, 날씨 등 환경 변화에 따라 인식 정확도가 저하될 수 있으며, 사생활 침해 우려를 동반할 수 있다. 이러한 문제점을 해결하기 위해 레이더 기반 손동작 인식 기술이 대두되고 있다[3]. 레이더 기술은 시각적 이미지를 캡처하지 않으며 사생활 침해의 우려가 없어 가정환경에서 유연한 사용이 가능하다[2]. 또한, 전파를 송수신하여 손의 움직임과 위치를 정밀하게 감지하며, 카메라와 달리 야간 사용 능력과 조명 변화나 날씨와 같은 환경적 요인에 강인하다[4]. FMCW(Frequency Modulated Continuous Wave)레이더는 전방 물체의 거리, 속도, 각도 등 다양한 정보를 측정할 수 있다. 하지만 하드웨어 구현이 복잡하고 가격이 비싸다는 단점이 있다[5]. 반면 도플러 레이더는 이동하는 물체의 마이크로 도플러 주파수를 직접 측정할 수 있다. 또한, 상대적으로 간단한 구조로 실시간 속도 추정에 있어 시스템 구현의 용이성을 제공하며, 비교적 저렴한 가격으로 구현할 수 있다[6]. 최근에는 도플러 레이더로 추출한 시간-도플러 특성을 CNN(Convolutional Neural Network)과 같은 딥러닝 모델에 입력하여 손동작을 인식하는 연구가 활발히 이루어지고 있으며, AlexNet이나 ResNet 등 기존의 CNN 구조를 개선해 인식 정확도와 실시간 처리 성능을 높이는 연구가 활발히 이루어지고 있다[7]. 이러한 연구들은 HCI 및 HMI(Human Machine Interface) 분야에서 사용자와 시스템 간의 직관적인 상호작용을 위한 중요한 기초가 되고 있다.

따라서 본 논문에서는 24GHz 도플러 레이더를 이용하여 시간-도플러 맵을 실시간으로 생성하고, 이를 YOLOv5[8] 기반의 딥러닝 분류기로 학습시켜 6개 손동작을 인식하는 시스템을 제안한다. 또한, 인식된 손동작 결과를 블루투스를 통해 디스플레이 제어 명령으로 연동하는 실시간 HMI 구현 방법을 제시함으로써, 실용적인 손동작 인식시스템의 가능성을 확인하였다.

Ⅱ. 관련 이론

2.1 도플러 레이더를 이용한 데이터 수집

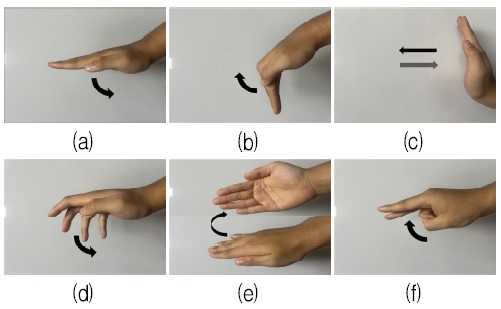

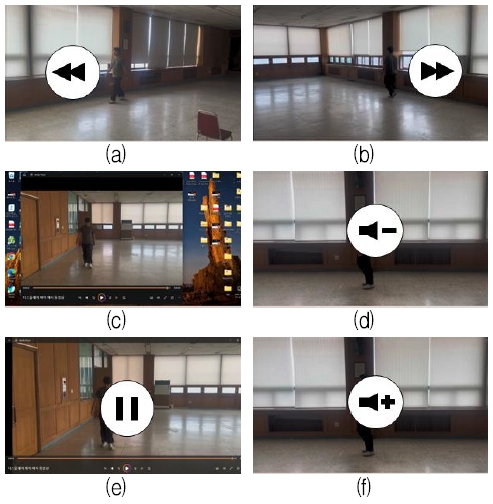

본 논문에서 손동작 인식을 위해 사용된 24GHz 도플러 레이더 모듈은 InnoSenT의 IPS-937 모델이다. 이 모듈은 24GHz의 단일 주파수를 가지고 있으며 I/Q 데이터를 아날로그 값으로 출력하는 특징이 있다[9]. 실험에서 측정한 손동작은 (a) 손목 접기, (b) 손목 펴기, (c) 손바닥 밀고 당기기, (d) 손가락 순차적으로 접기, (e) 손목 돌리기, (f) 손가락 2개 순차적으로 펴기 등 총 6개로 구성되어 있다. 각 손동작은 속도 정보가 명확히 구분되어야 한다는 점을 고려하였으며 그림 1은 6개 손동작을 시각적으로 묘사한 예시이다. 본 연구에서는 손동작 인식을 위해 도플러 주파수와 STFT(Short Time Fourier Transform)을 활용하였다. 도플러 레이더는 표적의 상대적 운동에 의해 발생하는 주파수 이동, 즉 도플러 효과를 기반으로 동작한다. 도플러 주파수는 표적이 레이더에 가까워질수록 양의 도플러 주파수를, 멀어질수록 음의 도플러 주파수를 가진다[10]. STFT는 비정상(Non-stationary)신호를 작은 세그먼트로 나누어 푸리에 변환을 수행하는 방법으로, 시간과 주파수 영역에서 신호를 동시에 분석할 수 있다. 이를 통해 시간에 따른 도플러 주파수 변화를 효과적으로 추출하고, 손동작의 세부적인 특성을 파악하였다. 본 논문에서는 STFT 분석 시 가우시안 윈도우를 적용하였으며[11], 윈도우 크기는 256 샘플로 설정하였다. 샘플링 주파수는 4kHz로, 이에 따라 각 윈도우의 시간 길이는 64ms에 해당한다. 모든 윈도우는 중첩(overlap) 없이 순차적으로 적용하였다.

2.2 HMI 시스템 구조

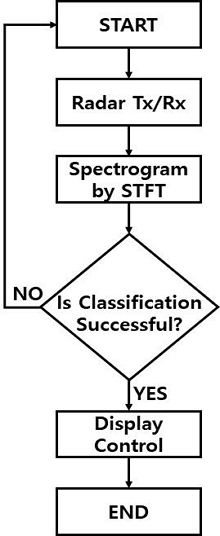

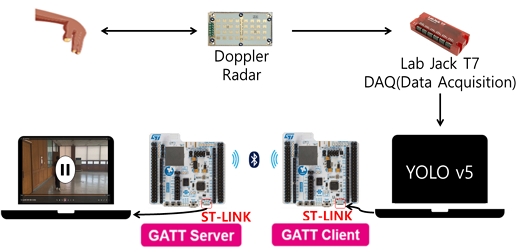

본 시스템은 24GHz 도플러 레이더를 사용하여 손동작에 대한 아날로그 I/Q 데이터를 획득한다. 이 데이터를 DAQ(Data Acquisition)모듈[9]을 통해 디지털 데이터로 변환한 후 STFT를 적용하여 스펙트로그램을 생성한다. 생성된 스펙트로그램은 YOLOv5 모델을 통해 객체 탐지를 수행하며, YOLOv5는 실시간으로 이미지에서 객체를 인식하고 해당 객체의 위치와 클래스 정보를 추출한다. 탐지된 객체 정보는 STM32WB55RG[12] 마이크로컨트롤러를 사용하여 BLE기반 시리얼 통신 방식으로 전송된다. STM32WB55RG는 전력 소모를 최소화하면서 안정적으로 데이터를 전송할 수 있게 한다. 마지막으로, 블루투스로 전송된 데이터는 디스플레이 제어를 수행하며 무선으로 HMI를 수행한다. 그림 2는 블록다이어그램이며 그림 3은 시스템 구조이다.

2.3 YOLO v5 분류기

YOLO는 하나의 신경망으로 물체의 위치와 종류를 동시에 예측하는 모델이다. 이 모델은 이미지 데이터를 직접 분석하여 바운딩 박스(Bounding box)와 클래스 확률을 신속하게 계산한다. 또한 YOLO는 다양한 버전이 있으며 버전에 따라 모델 특성에 차이가 있다.

YOLO 버전별 특징을 살펴보면 YOLO v1과 v2는 탐지율이 중요한 모델에 적합하며, v3와 v4는 탐지 속도가 중요한 상황에서 적합하다. v5와 v6는 탐지 속도와 정확도 간의 균형이 뛰어나 실시간 객체 탐지에 적합하다. 마지막으로 v7과 v8은 메모리 및 컴퓨팅 성능이 제한된 환경에서 적은 자원으로 객체 탐지, 객체 추적, 포즈 추정과 같은 작업을 수행하는 데 적합한 모델이다.

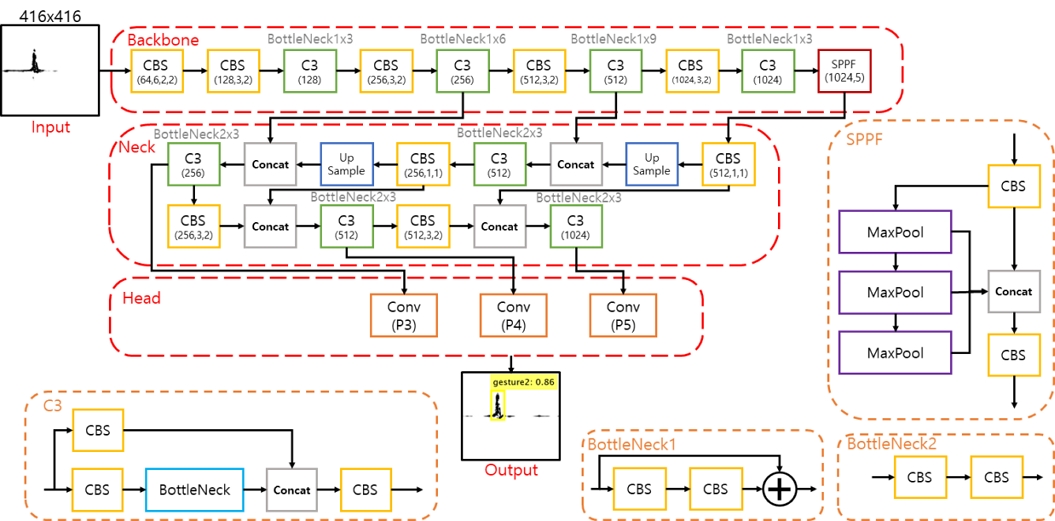

본 연구에서는 초당 최대 140프레임의 빠른 탐지 속도와 탐지 정확도가 높은 YOLOv5s 버전을 사용하였다[13]. YOLOv5는 특징을 추출하고 가공하여 최종적으로 객체를 탐지하는 전체적인 구조로, 그림 4와 같이 백본(Backbone), 넥(Neck), 헤드(Head)로 구성된다. 백본은 입력 이미지에서 주요 특징을 추출하는 단계로, CBS(Convolution-Batch Normalization-SiLU)와 C3 모듈이 반복적으로 쌓여 있으며, 마지막에 SPP(Spatial Pyramid Pooling) 모듈이 연결된다. CBS는 Convolution과 활성화 함수 SiLU, 그리고 Batch Normalization으로 구성되어 특징 추출을 안정적으로 수행하며, C3 모듈은 입력 특징을 부분적으로 처리하고 결합해 학습 효율성을 높인다. SPP는 다양한 크기의 피라미드 영역에서 특징을 추출하고 이를 요약하여 객체 탐지 성능을 향상시킨다. 넥은 백본에서 추출된 특징을 가공하여 여러 크기의 객체를 탐지할 수 있도록 다중 스케일 정보를 전달하며, 헤드는 가공된 특징을 기반으로 객체의 위치와 클래스 정보를 최종적으로 예측하여 바운딩 박스를 생성한다. 이 과정에서 P3(Stride 8), P4(Stride 16), P5(Stride 32) 크기의 특징 맵이 각각 작은 크기, 중간 크기, 큰 크기 객체 탐지에 사용되며, 각 특징 맵은 사전에 정의된 앵커 박스(Anchor Box)를 기반으로 객체를 탐지한다. YOLOv5 모델은 CBS의 복잡도와 파라미터 수에 따라 n, s, m, l, x로 구분되며, 본 연구에 사용된 YOLOv5s는 경량화된 구조로 빠른 연산 속도를 제공하면서도 높은 실시간 성능을 발휘한다.

객체 탐지 모델 학습 전, 데이터셋 전처리를 위해 바운딩 박스와 다각형 분할(Polygon segmentation) 두 가지 애노테이션 방법이 있다. 바운딩 박스는 사각형의 영역으로 나타내며 객체의 경계를 명확하게 하고 객체의 위치를 정의하며, 단순한 형태로 애노테이션이 가능하다. 반면 다각형 분할 방법은 객체의 형태를 보다 정밀하게 반영하며 더 세밀한 경계 정보를 제공한다. 손동작 통해 생성된 스펙트로그램 영상은 다른 이미지에 비해 간단한 구조이며 이를 반영하여 직관적으로 판단하고자 바운딩 박스로 애노테이션 작업을 사용하였다. 이렇게 전처리된 데이터는 YOLOv5s 모델 학습에 활용되어 손동작 분류 성능을 최적화하는 데 기여한다.

Ⅲ. 측정 및 실험 결과

3.1 측정 실험

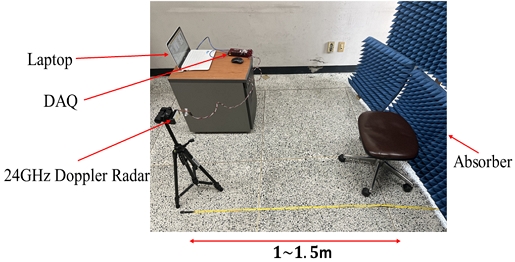

실험에서 사용된 24GHz 도플러 레이더를 삼각대로 고정한 후, 안테나의 메인 로브 내에서 손동작을 수행하였다. 레이더와 손동작의 간격은 1m에서 1.5m 간격을 두고 측정했으며 그림 5에서 확인 할 수 있듯이 뒤에 전파흡수체를 두고 불필요한 반사파를 최소화하고 측정하였다.

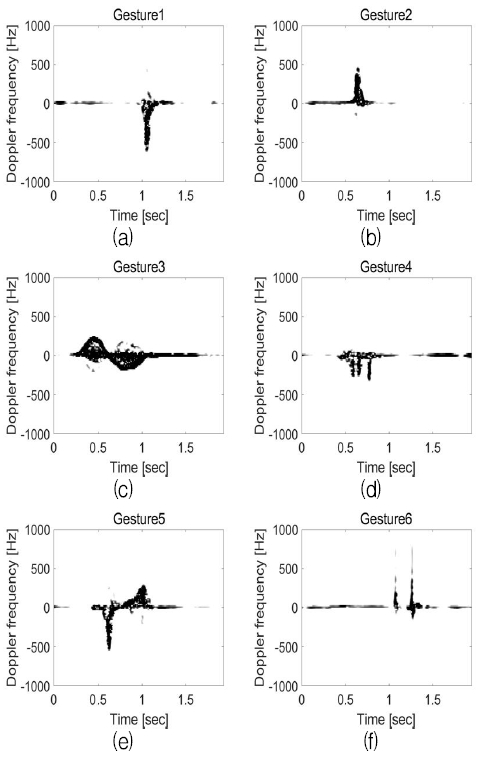

피실험자는 2.1 절에서 설명한 6개 손동작을 고정된 위치에서 2초 주기로 수행하였으며, 각 손동작의 스펙트로그램 영상은 그림 6에 제시하였다.

Spectrogram images for six hand gestures (a) wrist flexion (b) wrist extension (c) pushing and pulling with palm (d) sequential finger flexion (e) wrist rotation (f) sequential two-finger extension

손동작 그림 6(a)와 그림 6(b)는 손목을 접는 동작과 손목을 펴는 동작으로, 단순한 움직임이기 때문에 스펙트로그램 영상 또한 비교적 단순한 구조를 나타낸다. 반면, 그림 6(c)와 그림 6(e)는 팔을 접었다 펴는 동작과 손목을 돌리는 동작으로, 큰 움직임 궤적을 가지며 도플러 주파수의 동적 변화가 두드러져 나타난다. 그림 6(d)와 그림 6(f)는 손가락을 사용하는 동작으로, 손 전체를 사용하는 그림 6(a)와 그림 6(b)에 비해 스펙트로그램 영상에서 샤프한 도플러 주파수 특성을 보인다. 이처럼 손동작별로 관찰되는 고유한 스펙트로그램 특징은 분류기의 학습 데이터로 활용하기에 적합하다.

3.2 YOLOv5 학습 및 평가

각 손동작을 분류하기에 앞서 YOLOv5s 모델로 학습하였으며 바운딩 박스로 전처리 후 학습하였다. 스펙트로그램 영상은 5명의 피실험자로부터 6개 손동작을 100개씩 총 3000개의 데이터를 수집하였다. 수집한 데이터셋은 훈련, 검증, 테스트용으로 7:2:1의 비율로 분할하였으며, 학습에 사용된 하이퍼파라미터는 표 1과 같이 나와 있다.

손동작 분류 모델의 학습 및 탐지 성능을 평가하기 위해 IoU(Intersection Over Union), 정밀도(Precision), 재현율(Recall) 및 mAP(mean Average Precision)와 같은 지표를 사용한다. IoU는 예상 바운딩 박스(A)와 실제 바운딩 박스(B) 간의 겹침 정도를 계산한 값으로, 식 (1)에 정의되어 있다.

| (1) |

이는 두 박스의 교집합 면적을 합집합 면적으로 나눈 비율로, 탐지 결과가 얼마나 정확히 객체의 경계를 반영했는지를 나타낸다. 예를 들어, IoU 값이 0.5 이상이면 해당 탐지 결과를 TP(True Positive)로 간주하며, 0.5 미만일 경우 FN(False Negative)으로 처리한다. 혼동행렬은 분류 모델의 성능을 분석하는 데 널리 사용되는 도구로, TP, FP(False Positive), FN, TN(True Negative)의 분포를 기반으로 정밀도와 재현율을 계산할 수 있다. 계산식은 식 (2)와 (3)에 제시되어 있으며, 정밀도는 모델이 탐지한 객체 중 실제 객체로 정확히 탐지된 비율을, 재현율은 실제 객체 중 모델이 정확히 탐지한 비율을 나타낸다. mAP는 식 (4)로 정의되며 클래스별 AP(Average Precision)의 평균값으로, 모델 전반의 탐지 성능을 종합적으로 평가하는 데 사용한다.

| (2) |

| (3) |

| (4) |

N은 클래스의 총 개수이고 APi는 클래스 i의 평균 정밀도로 Precision-Recall 곡선 아래 면적(Area Under Curve)을 계산하여 정의한다.

YOLOv5s 분류기의 성능 평가는 테스트셋 총 300개를 기준으로 진행하였으며, 그 결과는 표 2에 요약되어 있다. 각 클래스에서 정밀도 값이 0.996에서 0.998 사이로 나타나 모든 클래스에서 높은 정확도를 보였다. 또한 mAP@50은 모든 손동작에서 0.995로 6개 손동작 클래스에 대해 일관되게 높은 성능을 보였다.

3.3 분류 결과 및 응용

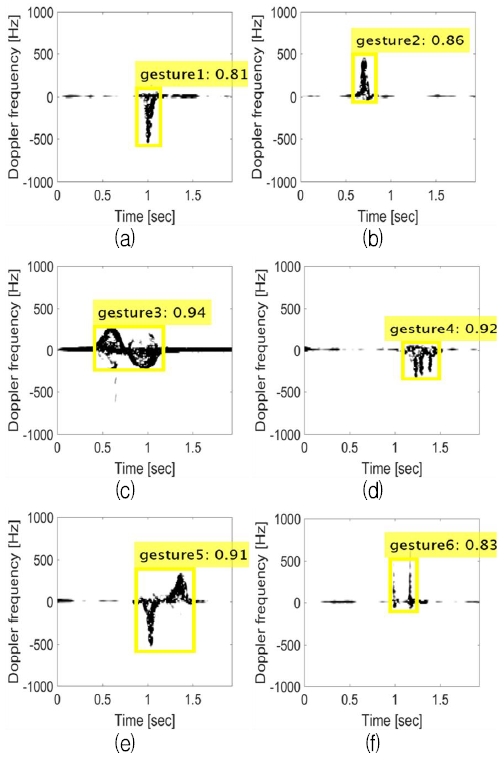

그림 7은 3.1절에서 획득한 6개 손동작의 스펙트로그램 영상을 실시간으로 YOLOv5s 분류기에 입력으로 넣어 분류한 결과이다.

Spectrogram image with bounding box processing (a) wrist flexion (b) wrist extension (c) pushing and pulling with palm (d) sequential finger flexion (e) wrist rotation (f) sequential two-finger extension

분류기의 실시간 동작 성능을 정량적으로 평가하기 위해, 각 손동작별 100개씩 총 600개의 데이터를 실시간으로 측정하여 분류한 결과, 평균 분류 속도는 2.5142초, 분류 정확도는 97.833%를 기록하였다. 분류기를 통해 예측된 클래스는 STM32WB55RG 보드를 통해 블루투스 시리얼 통신으로 데이터가 다른 보드로 전송되고, 해당 보드를 통해 디스플레이를 제어하였다. 그림 8은 이러한 디스플레이 제어의 예시를 보여준다. 디스플레이 제어는 그림 8(a) 손목 접기를 통해 5초 뒤로가기, 그림 8(b) 손목 펴기를 통해 5초 앞으로가기, 그림 8(c) 손바닥 밀고 당기기를 통해 전체화면, 그림 8(d) 손가락 순차적으로 접기를 통해 볼륨 내리기, 그림 8(e) 손목 돌리기를 통해 정지, 그림 8(f) 손가락 2개 순차적으로 펴기를 통해 볼륨 올리기 등 총 6개 옵션으로 구성되었으며, 각각의 명령이 의도대로 잘 제어되는 것을 확인하였다.

Ⅳ. 결 론

본 논문에서는 24GHz 도플러 레이더를 활용하여 실시간 손동작 인식시스템을 설계하였다. 실시간 분류 및 제어 실험 결과, 평균 분류 속도 2.5142초, 분류 정확도 97.833%를 달성하였으며, 실제 디스플레이 제어에도 성공적으로 적용할 수 있음을 확인하였다. 분류된 손동작 클래스는 블루투스 통신을 통해 디스플레이 제어 명령을 전송함으로써 HMI 응용 가능성을 검증하였다. 또한 도플러 레이더를 사용하여 빛의 영향을 받지 않고 야간이나 다양한 조명 환경에서도 안정적인 성능을 보이며, 카메라 기반 시스템과 달리 영상 데이터를 사용하지 않아 사생활 침해 우려 없이 가정환경에서 안전하게 사용이 가능하다. 향후에는 보다 다양한 손동작 인식에 대해 연구와 환경 변화에 강건한 성능을 확보하는 연구를 통해 모션 인식 및 HMI 분야에 대한 전망을 넓힐 것이다.

Acknowledgments

이 논문은 2024학년도 한남대학교 학술연구조성비 지원에 의해 연구되었음(No. 2024A053)

본 논문은 2024년도 한국정보기술학회 추계종합학술대회에서 발표한 논문(도플러 레이더와 손동작 인식을 이용한 YOLO 기반 디스플레이 제어 시스템)[14]을 확장한 것임.

References

-

J. Bertolasi, N. V. Garcia-Hernandez, M. Memeo, M. Guarischi, and M. Gori, "Evaluation of HoloLens 2 for Hand Tracking and Kinematic Features Assessment", Virtual Worlds, Vol. 4, No. 3, Jul. 2025.

[https://doi.org/10.3390/virtualworlds4030031]

-

J. W. Choi, C. W. Park, and J. H. Kim, "FMCW Radar-Based Real-Time Hand Gesture Recognition System Capable of Out-of-Distribution Detection", IEEE Access, Vol. 10, pp. 87425-87434, Aug. 2022.

[https://doi.org/10.1109/ACCESS.2022.3200757]

- T. Y. Kim, K. T. Kang, S. J. Lee "Hand Gesture Recognition Using FMCW Radar", Korean Institute of Electronic Engineers Conference, Busan, Korea, pp. 2179-2182, Jun. 2024.

-

J. Soom, M. Leier, K. Janson, and J. A. Tuhtan, "Open Urban mmWave Radar and Camera Vehicle Classification Dataset for Traffic Monitoring", IEEE Access, Vol. 12, pp. 65128-65140, May 2024.

[https://doi.org/10.1109/ACCESS.2024.3397013]

-

H. Eugin and J. Lee, "Hardware architecture design and implementation for FMCW radar signal processing algorithm", 2014 Conference on Design and Architectures for Signal and Image Processing, Madrid, Spain, pp. 1-6, Oct. 2014.

[https://doi.org/10.1109/DASIP.2014.7115643]

-

M. Reznicek, and P. Bezousek, "Commercial CW Doppler radar design and application", 2017 27th International Conference Radioelektronika, Brno, Czech Republic, pp. 1-5, Apr. 2017.

[https://doi.org/10.1109/RADIOELEK.2017.7937577]

-

Y. Le, V. P. Hoang, V. S. Doan, and D. P. Lee, "Dop-DenseNet: Densely Convolutional Neural Network-Based Gesture Recognition Using a Micro-Doppler Radar", Journal of Electromagnetic Engineering and Science, Vol. 22, No. 3, pp. 335-343, May 2022.

[https://doi.org/10.26866/jees.2022.3.r.95]

- G. Jocher YOLOv5, https://github.com/ultralytics/yolov5, . [accessed: Jun. 22, 2024]

-

Y.-B. Kim, Y.-J. Choi, and I.-S. Choi, "Measurement and Analysis for Scale Model of Wind Turbine Blade Using 24GHz Doppler Radar", Journal of the Korean Institute of Information Technology, Vol. 18, No. 6, pp. 55-63, Jun. 2020.

[https://doi.org/10.14801/jkiit.2020.18.6.55]

-

J. Kim, and I. S. Choi, "A Study on Classification of Human and Animals using Deep Learning and Spectrogram", Journal of Korean Institute of Information Technology (JKIIT), Vol. 22, No. 4, pp. 71-77, Apr. 2024.

[https://doi.org/10.14801/jkiit.2024.22.4.71]

- V. C. Chen and H. Ling, "Time-Frequency Transfrom for radar imaging and signal analysis", Artech House, pp. 173-181, 2001.

- STM32WB55RG Datasheet, https://www.st.com/resource/en/datasheet/stm32wb55rg.pdf, [accessed: Aug. 15, 2024]

-

R. Y. Kim, H. J. Cha, and A. R. Kang, "A Study on the Impact of Noise on YOLO-based Object Detection in Autonomous Driving Environments", Journal of The Korea Society of Computer and Information, Vol. 29, No. 10, pp. 69-75, Oct. 2024.

[https://doi.org/10.9708/jksci.2024.29.10.069]

- H. S. Nam and I. S. Choi, "YOLO-based Display Control System using Doppler Radar and Hand Gesture Recognition", Proc. of 2024 KIIT Fall conference, Jeju, Korea, pp. 1004-1005, Nov. 2024.

2019년 3월 ~ 2025년 2월 : 한남대학교 전기전자공학과(공학사)

2025년 3월 ~ 현재 : 서강대학교 전자공학과 석사과정

관심분야 : RADAR 신호처리, Deep learning, RCS 해석

1998년 2월 : 경북대학교 전자공학과(공학사)

2000년 2월 : POSTECH 전자전기공학과 (공학석사)

2003년 2월 : POSTECH 전자전기공학과 (공학박사)

2003년 4월 ~ 2004년 1월 : LG전자 선임연구원

2004년 2월 ~ 2007년 2월 : 국방과학연구소 선임연구원

2007년 3월 ~ 현재 : 한남대학교 전기전자공학과 교수

관심분야 : RADAR 신호처리, RADAR 시스템 설계, RCS 해석 및 분석, EMI/EMC 해석