자율 주행 환경 딥러닝 기반 라이다 인식기 신경망을 위한 도메인 적응 기법 연구 분석

초록

3D 환경에서의 정확한 인식은 자율 주행, 로봇 공학과 같은 분야에서 매우 중요합니다. 그러나 실제 환경에서는 날씨 변화, 센서 구성 차이 그리고 지리적 요인으로 인해 데이터 분포가 크게 변화 할 수 있고, 이러한 변화로 인해 3D 인식 신경망의 성능이 저하되는 경우가 많습니다. 이 한계를 극복하기 위하여 도메인 적응 기법이 제안되었으며, 이는 제한된 환경에서의 레이블된 데이터를 활용하여 타겟 도메인에서의 성능을 향상시키기 위해 소스 도메인의 풍부한 학습 데이터를 효과적으로 활용하는 기법입니다. 본 연구에서는 먼저 LiDAR 인식 신경망과 도메인 적응의 기본 개념을 설명한 후, 이어서 도메인 적응 기술을 증강 기반, 지도 기반, 수도 레이블 기반으로 분류하여 자율 주행에 맞춤화된 접근 방식에 대한 자세한 통찰력을 기술합니다.

Abstract

Accurate perception of 3D environment is important in various fields such as autonomous driving and robotics. However, in real-world scenarios, variations in weather conditions, sensor configurations, and geographical factors can significantly alter data distributions, often leading to a decline in the performance of 3D perception neural networks. To overcome this limitation, domain adaptation techniques have been proposed. These techniques effectively utilize the abundant training data from the source domain to enhance performance in the target domain, where labeled data is limited. In this paper, we first explain the fundamental concepts of LiDAR perception neural networks and domain adaptation. Then, we categorize domain adaptation techniques and provide detailed insights.

Keywords:

autonomous driving, domain adaptation, LiDAR, deep learning, 3D perception, neural networkⅠ. 서 론

최근 자율주행 기술의 발전은 인공지능 기술의 급속한 진보와 더불어 가속화되고 있다. 자율주행 기술은 교통 체증 완화, 운전 및 도로 안전성 향상과 같은 다양한 이점을 제공할 잠재력을 내포하고 있다. 자율 주행 기술의 안정적 적용을 위해서는 주변 환경에 대한 인지, 예측, 계획 및 제어와 같은 다양한 작업이 필수적으로 수행되어야 한다. 이 과정 중에 발생할 수 있는 아주 작은 오류조차도 심각한 결과를 초래할 수 있기 때문에 안정적인 자율주행 시스템 구축의 중요성이 점점 대두되고 있다. 특히, 인지 단계는 자율주행 시스템 내에서 가장 먼저 수행되는 가장 중요한 단계이다. 인지 시스템은 다양한 기상 조건, 다양한 센서 설정 그리고 지역적인 차이를 포함한 환경에서도 신뢰할 수 있는 정확한 정보를 제공할 수 있어야 한다. 이 정보를 바탕으로 자율주행 차량은 신속하고 효율적인 의사 결정을 가능하게 해야 한다.

자율주행 시스템은 카메라, 레이다, 라이다를 비롯한 다양한 센서를 활용하여 주변 환경을 인식한다[1][2]. 센서들은 각기 다른 고유한 원리를 바탕으로 주변 환경에 대한 정보를 수집하며, 수집된 정보를 통해 자율주행 차량이 환경을 정확히 인식할 수 있게 한다. 고해상도 이미지를 제공하는 카메라 센서의 시각적 데이터에 기반한 다양한 객체의 분류와 검출하는데 유리한 반면, 광원의 변화나 날씨 조건에 크게 영향을 받고, 거리 정보를 제공하지 못해 3차원 환경을 인지하는데 한계가 있다. 반면, 레이다 센서는 3차원 정보를 제공하고 장거리 탐지와 상대 속도 측정이 가능하여 악천후 상황에도 강점을 보이지만, 낮은 해상도로 인해 세밀한 객체 인식에 어려움이 있다. 라이다는 고해상도의 3차원 정보 제공으로 정밀한 환경 인식이 가능하며, 레이저를 이용한 정확한 거리 측정이 가능하다(그림 1 참조). 라이다의 거리 정보는 센서로부터 출력된 빛이 주변 대상에 반사되어 돌아오는 시간을 측정함으로써 얻을 수 있다. 이 측정값은 하나의 3차원 점 형태로 표현되며, 레이저 빔 스캐닝을 통해 주변 환경을 나타내는 3차원 점의 집합인 "포인트 클라우드" 형태의 데이터를 생성한다.

각 점은 특정 위치의 좌표 (x, y, z)를 나타내며, 물체의 외형과 구조를 입체적으로 표현한다. 포인트 클라우드는 대량의 점으로 이루어져 있어 고해상도의 3차원 정보를 제공하며, 비정형적이고 밀도가 낮은 특성을 가진다.

포인트 클라우드 데이터는 픽셀 기반의 이미지 데이터와 달리 규격화되어 있지 않아, 이미지를 입력으로 하는 객체 인식 알고리즘을 통해 물체를 검출하는 것은 불가능하다. 따라서 최근 딥러닝 연구자들은 포인트 클라우드를 픽셀을 3차원으로 확장한 복셀 형태로 가공하는 방법[3][4], 조감도 형태의 가상의 이미지로 변환하는 방법[5][6], 혹은 포인트 클라우드를 위한 새로운 알고리즘을 설계하는 방법을[7][8] 통해 라이다 객체 인식을 위한 연구가 진행되고 있다.

라이다 기반 신경망은 다양한 인식 분야에서 인상적인 결과를 보여주었지만, 안정적인 성능을 위해서는 학습 시나리오와 일치하는 방대한 양의 레이블 데이터가 필요하다. 이러한 접근은 학습 데이터와 실제 시나리오 데이터가 동일한 분포를 공유한다는 중요한 가정에 기반한다. 그러나 자율주행 차량과 같은 실제 세계 응용 분야에서는 이러한 가정이 유효하지 않는 경우가 많다. 예를 들어, 자율주행 차량은 지리적 지역, 날씨, 계절 등 다양한 도메인에서 운행된다. 각각의 도메인은 고유한 데이터 분포를 가질 수 있으며, 이로 인해 인식 시스템의 성능이 급격히 저하될 위험이 있다. 또한 새로운 도메인에 대해 데이터를 수집하고 레이블을 하는 과정은 시간과 비용 면에서 비실용적이다.

이에 대한 해결책으로 도메인 적응(Domain adaptation) 기술이 제안되었다. 도메인 적응은 서로 다른 분포를 가지는 소스 도메인과 타겟 도메인이 존재하고 해결하고자 하는 분야가 동일할 때 소스 도메인의 정보를 타겟 도메인으로 손실 없이 전달하는 것을 목표로 한다. 현재 도메인 적응 기술의 대부분은 2D 카메라 이미지에 초점을 맞추고 있으며, 이는 3차원 환경 인식에 중요한 포인트 클라우드의 특성과 기하학적 정보를 고려하지 못한다. 따라서, 확장 가능한 자율주행 시스템을 위해 도메인 적응 기법, 특히 라이다 인식을 위한 도메인 적응에 대한 연구의 필요성이 증가하고 있다. 최근 도메인 적응 기법과 라이다 기반 인식 모델에 대한 관심이 높아지면서 발표된 기법 및 신경망에 대해 분석하는 연구도 함께 진행되고 있다. L. T. Triess et al.[9]은 라이다 기반 인식 신경망의 도메인 적응 기법에 대해 리뷰하며, 이를 활용 방식에 따라 분류하고 구체적인 예시에 대해서 다루었다. 그러나 급격히 떠오르고 있는 현재 도메인 적응 기법에 관한 내용을 포함하지 않고 있다. 한편, J. Koh et al.[10], M. Sun et al.[11]은 라이다 기반 객체 인식 신경망 분석을 다루고 있으며, 특히 자율주행 환경에 적합한 신경망을 선정하여 이의 활용 방법에 대해 설명한다.

본 연구는 자율주행 환경 딥러닝 기반 라이다 객체 인식 신경망을 대상으로 한 도메인 적응 기법 중 최근에 제안된 기법들을 중점적으로 다룬다. 본론에서는 도메인 적응 기법의 흐름에 대해 다루고, 도메인 적응 기법들을 적절한 기준으로 분류하여 연구에 대한 개괄적 개념을 다룬다. 본 논문은 2장에서 라이다 객체 인식 신경망과 도메인 적응 기법을 비교하기 위한 배경 지식에 대해 간단하게 소개한다. 그리고 3장에서 도메인 적응 기법에 대한 구체적인 분류와 분석을 제공하고 4장 결론으로 구성되어 있다.

Ⅱ. 배 경

본격적으로 라이다 객체 인식을 위한 도메인 적응 신경망에 대한 리뷰를 시작하기 전, 해당 분야에 대한 깊은 이해를 돕기 위해 배경 지식을 체계적으로 정리하고자 한다. 이를 위해, 본 장에서는 이어질 도메인 적응 기법을 명확하게 전달하기 위한 라이다 기반 3차원 인식 신경망, 도메인 적응 기법, 그리고 기법을 평가하기 위해 사용되는 데이터 셋에 대한 개략적인 설명을 짚고 나아가고자 한다.

2.1 라이다 기반 3차원 인식 신경망

라이다 센서를 통해 자율주행 차량은 주변 환경을 3차원으로 정밀하게 인식할 수 있으며, 센서로부터 얻은 포인트 클라우드 데이터는 정확한 거리 정보를 가지고 있어 자율주행 차량이 주변 환경을 인식하는 물체 검출(Object detection), 시맨틱 분할(Semantic segmentation), 인스턴트 분할(Instance segmentation) 등 다양한 작업을 수행하는 데 사용된다.

포인트 클라우드 데이터는 불규칙하며 희소하고 순서가 없는 비정형 데이터이기 때문에 영상 처리에 사용되는 컨벌루션 뉴럴 네트워크(CNN)을 사용하기 부적절하다. 따라서 연구자들은 포인트 클라우드 데이터의 의미적인 특징을 추출하는 인코딩 기술을 개발하였다. 인코딩 방식은 크게 포인트 클라우드를 직접 입력으로 추출하는 포인트 방식과, 포인트를 사전 정의된 그리드로 규격화하여 연산하는 그리드 방식으로 나눌 수 있다.

먼저 그리드 기반 방식은 포인트 클라우드를 사전 정의된 복셀 또는 기둥 그리드에 할당하고, 그리드 내부에 있는 포인트를 신경망을 통과시켜 그리드의 대표 값을 결정한다. 인코딩된 그리드를 3D 혹은 2D 컨벌루션 레이어를 통과시켜 특징값을 추출한 후, 이를 기반으로 3차원 혹은 조감도(Bird's Eye View)에서 주변 환경을 인식한다. 이 방식은 이미지와 같은 형태로 규격화되기 때문에 CNN 기반 레이어를 사용할 수 있고 높은 효율성을 보여 포인트의 개수가 비교적 많은 자율주행 환경 신경망에서 대표적으로 사용된다. 하지만 규격화 하는 과정에서 일어나는 정보 손실이 생긴다는 단점이 있다[3][4][6]. 이러한 정보 손실 문제를 보완하기 위해, 포인트를 직접 이용하는 PointNet[12]이 제안되었다. PointNet은 포인트 클라우드의 순서 불변성과 회전 불변성을 반영한 MLP(Multi-Layer Perceptron) 기반 신경망에 포인트 클라우드를 직접 통과시켜 특징을 추출한다. 이후 PointNet++[13]은 포인트 클라우드를 균일한 거리를 가지는 클러스터로 그룹화하고, 각 클러스터 내의 포인트를 PointNet 기반의 MLP 레이어를 통해 특징을 추출한다. 이렇게 추출된 포인트 형태의 특징을 활용하여 물체 검출 또는 시맨틱 분할을 수행한다[7][8][14].

앞서 소개한 3차원 인식 신경망은 도메인 적응 기법의 비교 기준으로 사용된다. 이러한 네트워크의 특성을 반영한 학습 방법을 통해, 도메인 간의 분포 변화를 완화할 수 있는 방안에 대해 알아보게 된다.

2.2 도메인 적응 기법

도메인 적응(DA, Domain Adaptation)은 기계 학습 분야에서 자율주행 시스템, 이미지 인식, 자연어 처리 등 응용 분야에서 주목받는 연구 주제이다. 도메인 적응의 핵심 목표는 소스 도메인에서 학습된 모델이 타겟 도메인에서도 성능저하 없이 작동하도록 하는 것이다. 여기서 소스 도메인은 모델 학습에 사용된 데이터를 포함하는 도메인을 의미하며, 타겟 도메인은 모델을 적용하고자 하는 새로운 환경이나 조건의 데이터를 포함하는 도메인을 의미한다. 도메인 적응은 이 두 도메인이 유사하면서 해결하고자 하는 분야가 동일할 상황을 가정한다.

자율주행 차량의 경우 차량 운용 가능 영역을 넓혀가는 과정에서, 날씨 조건, 도로 상황, 지리적 위치 등에 따라 도메인 간의 분포 차이가 발생한다. 또한 라이다 데이터는 환경 조건, 자율주행 차량의 센서의 배치와 센서의 해상도에 따라서 포인트 클라우드의 분포가 크게 달라지는 성질이 있다. 이 변화는 라이다 인식 신경망에 있어서 성능 저하를 가져오며, 이를 극복하기 위해서는 모든 세팅 마다 레이블 데이터를 수집하여 다시 학습하는 방법이 있지만 이는 시간적 비용적 문제로 현실적으로 불가능하다. 도메인 적응은 신경망이 변화에 비용 효율적으로 적응 가능하게 하여, 실제 운행 환경에서의 다양한 시나리오에 더욱 비용 효율적으로 대응할 수 있다.

도메인 적응 기법은 타겟 도메인의 레이블 데이터의 유무에 따라 분류할 수 있다. 비지도 도메인 적응(UDA, Unsupervised Domain Adaptation) 기법은 타겟 도메인에 레이블 데이터가 전혀 없을 때 사용된다. 준지도 도메인 적응(SSDA, Semi-Supervised Domain Adaptation) 기법은 타겟 도메인의 소량만이 레이블링 되어있을 때 사용되는 방식이다. 두 방식 모두 소스 도메인의 레이블 데이터가 풍부하며 타겟 도메인의 레이블 되지 않은 데이터 또한 풍부함을 가정한다. 각 도메인 적응 방식은 레이블이 없거나 소량의 레이블이 있는 타겟 도메인 데이터를 도메인 차이를 극복하는 방법에 초점을 맞추고 있다.

도메인 적응 과정에서는 다양한 기술이 사용될 수 있다. 예를 들어, 도메인 불변 특징 학습은 특정 도메인에 의존하지 않고 모든 도메인에서 공통적으로 존재하는 특징을 학습함으로써 도메인 적응을 수행한다. 또한, 도메인 매핑은 소스 도메인의 데이터에서 얻은 학습 정보를 타겟 도메인에 전달함으로써 학습 과정에서 도메인 간 차이를 극복한다. 이외에도 사용 가능한 데이터의 유형과 도메인 간 차이의 정도에 따라 다양한 방법으로 도메인간 차이를 완화할 수 있는 방법이 제안되고 있다.

2.3 데이터 셋

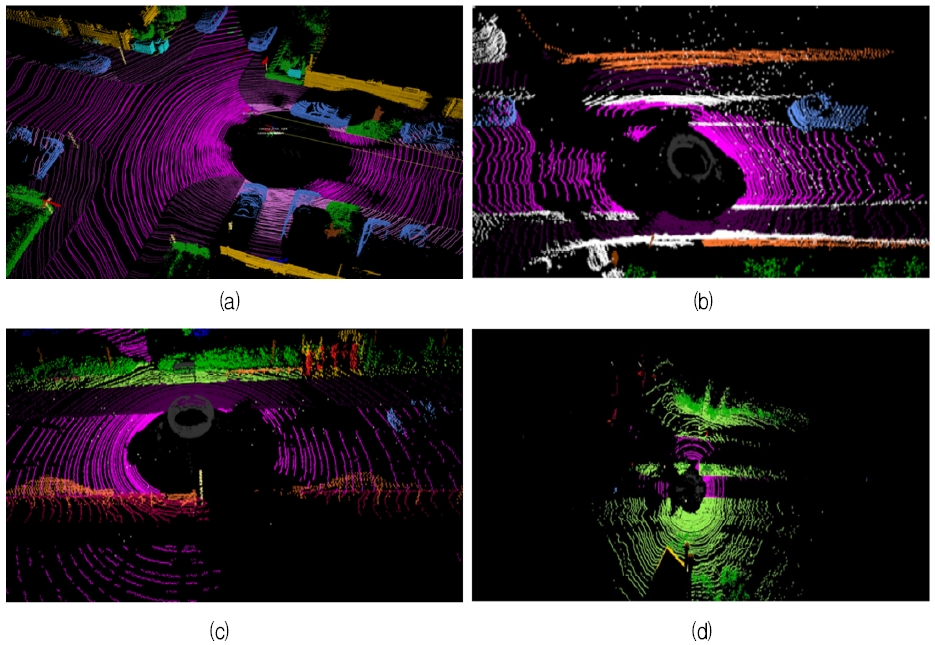

자율주행 환경에서 수집된 데이터셋은 수집한 차량에 탑재된 센서의 종류와 설정(예: 32채널 라이다, 64채널 라이다, 레이다, 카메라 등)과 배열(예: 센서의 개수와 배치), 수집 지역(예: 독일, 미국, 싱가포르), 그리고 다양한 날씨 조건에 의해 결정되는 고유의 특성을 가진다. 데이터셋의 특성은, 표 1에서 확인할 수 있듯이, 구성하는 센서의 종류와 데이터셋의 크기 등 서로 다른 특성을 가지고 있다. 데이터셋의 이러한 다양성은 자율주행 차량의 인식 시스템을 평가할 때 실제 운행 환경의 다양성과 복잡성을 포괄하여 반영할 수 있게 만들고, 동시에 다중 데이터셋 활용 시 도메인 적응 기법의 성능을 평가할 수 있는 지표로 사용된다. 연구자들은 특정 데이터셋에서 학습된 신경망 모델이 다른 데이터셋 환경에서도 효과적으로 작동하는지를 통해 도메인 적응 기법의 유효성을 검증한다. 특히, 라이다 기반 3차원 인식 신경망에서는 수집된 라이다 센서의 채널 수가 모델의 도메인 적응 난이도에 큰 영향을 미친다(그림 2 참조). 예를 들어, 동일한 채널 수의 라이다를 사용하는 데이터셋 간의 도메인 적응(예: Waymo 대 KITTI)은 비교적 난이도가 낮지만, 서로 다른 채널 수의 라이다를 사용하는 데이터셋 간의 도메인 적응(예: Waymo 대 nuScenes)은 보다 복잡한 기법을 요구한다. 이처럼 데이터셋의 특성을 면밀히 분석하고 도메인 간의 분포 차이를 파악하는 것은 도메인 적응 기법을 결정하고 적용하는 과정에서 매우 중요한 고려사항이다.

KITTI[13] 데이터셋은 자율주행 자동차 연구를 위해 설계된 가장 오래되고 광범위하게 사용되는 데이터셋이다. 이 데이터셋은 독일 카를스루헤 공과대학교(Karlsruhe Institute of Technology)와 도요타 기술 연구소(Toyota Technological Institute)의 공동 프로젝트로 제작되었다. 데이터는 자율주행 시스템이 직면할 수 있는 여러 상황을 반영하기 위해 주로 독일의 도시, 시골, 그리고 고속도로 등 다양한 환경에서 수집되었다.

KITTI 데이터셋은 스테레오 카메라, 64채널 라이다 센서(그림 2(a) 참조), GPS, IMU 등 다양한 센서를 사용하여 수집되었다. 데이터셋은 약 15,000장의 이미지와 200개의 주행 시나리오로 구성되어 있으며, 객체 감지, 객체 추적, 깊이 추정, 시맨틱 분할 등 자율주행과 관련된 다양한 연구를 지원한다. 데이터셋에는 전방 카메라 내에 있는 차량, 보행자, 자전거 세가지 클래스에 대하여 레이블링되어 있다. KITTI는 다양한 센서 정보와 실제 세계의 복잡한 시나리오를 포함하고 있으나 차량의 전방 카메라 이미지 내에 있는 물체에 대한 레이블만을 제공하고 데이터셋 프레임의 절대적인 양이 적다는 단점이 있다.

nuScenes[16] 데이터셋은 자율주행 차량 연구를 위한 데이터셋으로, 미국 보스턴과 싱가포르에서 미국 Motional에 의해 수집된 데이터셋이다. 이 데이터셋은 도시 환경에서의 복잡한 교통 상황을 포착하기 위해 설계되었으며, 여러 종류의 센서 데이터를 포함하고 있다. 1대의 32채널 라이다(그림 2(b) 참조), 5대의 레이더 그리고 360도를 커버하는 6대의 카메라로 데이터를 수집하였다. nuScenes 데이터셋은 20초로 구성된 1,000개의 주행 시나리오와 1.4백만 개의 이미지, 390,000개의 라이다 스캔으로 구성되어 있으며, 2Hz로 27,000개의 프레임에서 50m 내의 대한 차량, 보행자, 자전거 등 23개의 객체 클래스에 대한 레이블이 포함되어 있다. nuScenes 데이터셋은 3차원 물체 검출, 물체 추적, 물체 예측, 포인트 분할, 경로 계획의 분야를 지원한다. nuScenes의 장점은 다양한 센서로 구성되며 다양한 클래스에 레이블이 되어있고 다양한 분야 평가를 제공한다는 장점이 있다.

Waymo Open Dataset[17]은 미국 Waymo에 의해 수집되고 공개된 자율주행 자동차 데이터셋으로, 미국의 샌프란시스코, 마운틴뷰, 커클랜드 등의 여러 도시에서 수집되었다. 이 데이터셋은 4대의 64채널 라이다 센서와 전방향 카메라를 사용하여 수집되었으며, 10Hz로 1,150개의 주행 시나리오, 총 230,000장 프레임에 대해서 레이블이 되어있다. Waymo 데이터셋은 75m 내의 차량, 보행자, 자전거, 표지판 4개의 클래스에 대한 3D 객체 레이블을 제공한다. 또한 자율주행 데이터셋 중 유일하게 도시 혹은 날씨를 기준으로 데이터셋을 분할하여 도메인 적응 평가를 위한 데이터셋도 제공한다.

SemanticKITTI[18]는 KITTI 데이터셋을 3차원 시맨틱 분할을 위해 확장된 데이터셋이다. 포인트 별로 시맨틱 레이블을 제공하며 시퀀스 기반 데이터를 제공한다는 특징이 있다. preSIL[19]은 자율주행을 위한 시뮬레이션에서 수집되었으며 3차원 물체 검출, 시맨틱 분할 등의 분야를 지원한다. 실제 데이터의 부족을 해결하기 위해 구성되었으며 도메인 적응 분야에서는 시뮬레이션 데이터로 학습된 모델을 실제 환경에 적응하는 능력을 평가하기 위한 데이터셋으로 사용된다. SemanticPOSS[20] 또한 라이다 기반의 인식 분야를 평가하기 위한 데이터셋으로 중국 푸젠성에서 수집되어 도메인 적응 분야에서 지역적 차이를 평가하기 위한 데이터셋으로 사용된다.

Ⅲ. 라이다 인식 신150

3.1 도메인 불변 기법

도메인 불변 기법은 학습된 신경망이 도메인에 영향받는 특징보다 영향받지 않는 특징을 추출하도록 유도함으로써 다른 도메인에서도 성능을 유지할 수 있도록 하는 기법이다. 이 기법은 신경망의 특정 단계에서 도메인 간에 차이에 영향받지 못하도록 유도하는 것이다. 이를 위해, 입력 데이터를 제3의 도메인으로 전이 시키는 도메인 불변 생성 기법과 네트워크가 도메인을 구분하지 못하도록 유도하는 도메인 불변 특징 추출 기법이 제안되었다.

도메인 불변 데이터 생성 기법(그림 3 참조)은 라이다 포인트를 추가적으로 생성함으로써 입력 데이터를 소스와 타겟이 아닌 도메인으로 유도하는 기법이다. Complete & Label[21] 연구는 포인트 클라우드의 시맨틱 분할을 위해 제안된 신경망으로, 포인트 생성을 통해 어떤 도메인의 데이터가 입력되더라도 동일한 처리를 가능하게 하도록 유도하는 방법이다. 포인트 생성 학습을 위한 정답 레이블로, 라이다 포인트 클라우드 시퀀스를 누적한 후 푸아송 표면 복원 기법을 적용하여 고밀도 포인트 클라우드를 생성하고 이를 생성을 위한 레이블로 사용한다. 신경망은 어떤 분포의 포인트 클라우드가 들어와도 고밀도 포인트 클라우드를 생성하게 되어 도메인 차이를 완화한다.

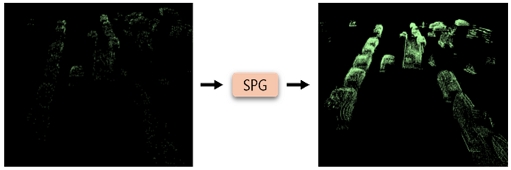

SPG[22]는 3D 물체 검출을 목표로 제안된 신경망으로 물체 내부에 포인트를 생성하는 것에 초점을 맞춘다(그림 4 참조). 먼저 복셀 기반의 인코딩 방식을 활용하여 물체가 위치할 가능성이 높은 영역을 식별한 후, 해당 영역 내부에 포인트를 생성함으로써 물체 검출 과정에서의 도메인 적응 능력을 향상시킨다. 이 접근법은 Complete & Label보다 더 가볍고 3D 물체 검출 태스크에 특화되어 있는 방법이다.

적대적 증강 기반 데이터 생성 방식은 포인트 클라우드의 변형을 통해 신경망이 도메인 불변성을 가진 표현을 학습하도록 유도한다. 3차원 포인트 클라우드 데이터를 활용한 적대적 예제 생성 기법은 X. Chong et al.[23]에서 처음 제안되었다. 이 방법론은 손실 함수의 역전파 그래디언트를 활용하여 모델이 검출하기 어려운 적대적 예제를 생성한다. 포인트 클라우드 데이터의 포인트들을 이동시켜 데이터를 변형시키는 적대적 포인트 섭동 방식과, 객체의 취약한 부분에 새로운 포인트들을 추가하여 적대적 예제를 생성하는 적대적 포인트 생성 방식으로 구성된다.

3D-VField[24]는 자율주행 환경에서 학습 과정에서 접하기 힘든 희귀하거나 손상된 자동차를 검출하기 위해 적대적 예제를 활용한다. 이 방식은 신경망이 물체 검출 오류를 유도하는 손실 함수를 기반으로 3차원 벡터장을 생성한다. 벡터장은 3차원 박스 내의 물체 포인트들이 이동해야 할 방향을 학습하는 데 사용되며, 이를 통해 물체의 포인트들이 라이다 센서의 레이저 경로로 이동하여 적대적 예제를 생성한다. 적대적 예제로 학습하면 모델은 물체가 실제 세계에서 발생할 수 있는 다양한 변형을 학습하게 되고 결과적으로 보지 못한 도메인에 대한 일반화 능력을 향상시키는 결과를 가져왔다.

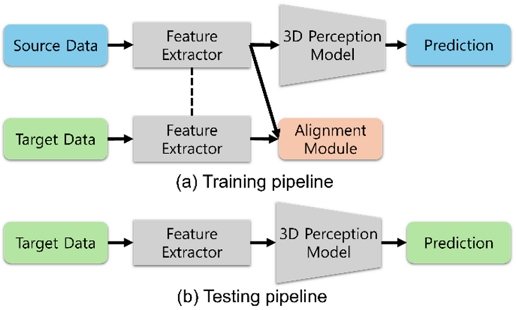

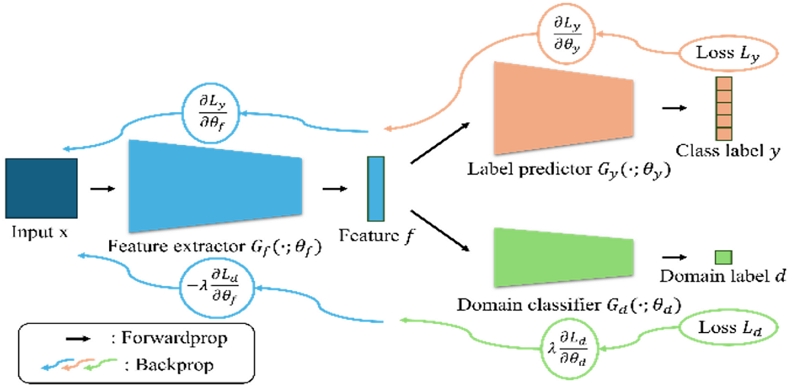

도메인 불변 특징 추출 기법(그림 5 참조)은 모델이 입력 데이터가 어떤 도메인에 속해 있는지 구분하는 능력을 제한함으로써 도메인에 영향받지 않는 특징을 추출하도록 한다. DANN[25]은 이 분야의 선구적 연구로 이미지 분류 분야를 위한 도메인 적응 기법으로 제안되었다. 이미지 분류기의 특징 추출 단계 이후에 도메인 분류기(그림 6 의 초록색 모듈)를 추가하여 도메인 불변 특징을 추출하였다. 도메인 분류기는 입력 데이터가 소스 도메인에 속하는지, 아니면 타겟 도메인에 속하는지를 구분하는 신경망이다. 학습 과정에서 도메인 분류기의 역전파 과정에 음수를 적용함으로써, 신경망이 도메인을 구분할 수 없도록 유도한다. 결과적으로 전체 신경망은 도메인에 영향받지 않는 특징을 추출하도록 유도된다.

이 과정을 도메인 적대적 학습 기법이라 칭하며, 이를 통해 신경망은 도메인 불변 특징을 학습하게 되어 도메인 적응 성능을 획기적으로 개선할 수 있었다.

SRDAN[26]은 도메인 적대적 학습 기법을 라이다 기반의 자율주행 환경에서의 3차원 물체 검출 분야에 적용한 연구이다. SRDAN은 라이다 포인트 클라우드를 입력으로 할 때 크기가 큰 물체와 작은 물체, 그리고 거리에 따라 물체의 분포가 다르다는 점을 반영한 두가지 모듈을 제안하였다. 전체 특징을 입력으로 도메인을 분류하는 전역 도메인 분류기와, 거리에 따라 가중치를 다르게 적용하는 모듈, 그리고 조감도를 격자 단위로 분할하여 중요도에 따라 다른 가중치를 부여하는 새로운 도메인 분류기를 추가함으로써 라이다 데이터에 특화된 도메인 적대적 학습 기법을 제안하였다. 하지만 도메인 적대적 학습 기법은 분류기의 손실을 신경망으로 전달하는 과정에서 음수를 적용하는 방법이 모델이 도메인에 불변하는 핵심 특징을 학습하는 데 직접적으로 기여하는지 증명하기 어렵다는 점은 연구의 한계로 지적된다.

3.2 도메인 매핑 기법

도메인 매핑 기법은 소스 도메인의 정보를 손실 없이 타겟 도메인으로 전이하는 데 중점을 둔 접근법이다. 이 기법은 어떤 단계에서 전이하는지에 따라 구분될 수 있으며, 주로 두 가지 방법으로 나뉜다. 첫 번째는 입력 단계에서 타겟 도메인의 특성을 반영해 변형시키는 방식을 취하는 데이터 증강 도메인 매핑이고, 두 번째는 신경망의 인코딩 단계에서 추출된 특징을 전이하는 특징 정렬 기반 도메인 매핑으로 나눌 수 있다.

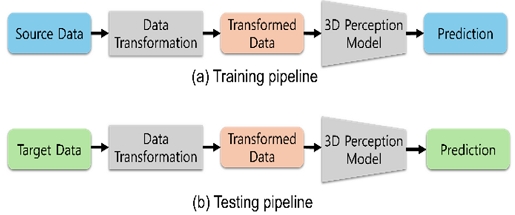

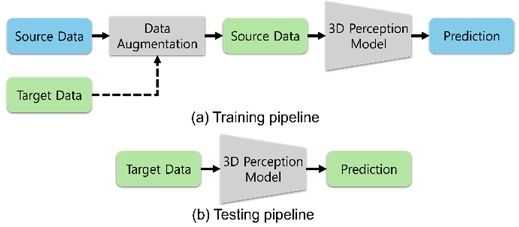

데이터 증강 기반 도메인 매핑 접근법(그림 7 참조)은 입력 데이터를 구성할 때 타겟 도메인의 특성을 반영함으로써 소스 도메인과 타겟 도메인의 격차를 완화한다. 이미지 분야에서 두 가지 프레임을 섞는 CutMix[27]나 MixUp[28]과 같은 데이터 증강 기법에 라이다 센서의 특성을 반영하여 신경망이 소스 도메인의 정보를 학습하면서 자연스럽게 타겟 도메인의 특성을 학습할 수 있게 한다.

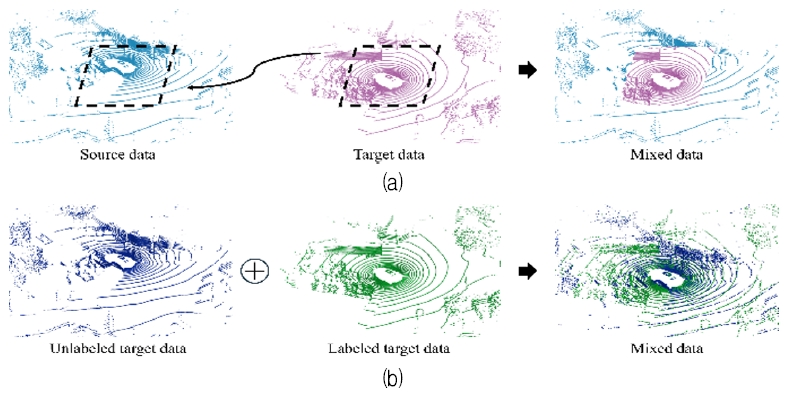

SSDA3D[29]는 3D 물체 검출 분야에 대한 준지도 도메인 적응 방법을 제안하였다. 준지도 도메인 적응은 도메인간 격차와 타겟 도메인의 레이블 데이터와 레이블 되어있지 않은 데이터 간의 내부 격차 두가지 격차를 고려해야 한다. SSDA3D는 도메인간 격차 완화를 위해 그림 8(a)와 같이 조감도 좌표계에서 임의의 직사각형의 범위를 선정하고 해당 범위의 소스 데이터와 타겟 데이터를 교환하는 Point-CutMix를 제안하였다. 또한, 그림 8(b)와 같이 레이블 데이터와 레이블 되어있지 않은 데이터를 포인트 단위로 합치는 Point-MixUp을 통해 내부 격차를 줄이면서 학습 가능하도록 하는 데이터 증강 기법을 제안하였다.

PolarMix[30]는 포인트 클라우드의 의미적 분할 분야를 위해 제안된 신경망이다. 라이다 센서의 스캐닝 알고리즘이 주로 극좌표계(Polar-coordinate)를 기반으로 한다는 점에 착안하여 조감도 좌표계에서 CutMix 기법을 극좌표계에 맞게 변형하여 적용하는 방법을 제안하였다. 극좌표계를 기준으로 부채꼴 모양의 영역을 정하여, 영역에 포함된 소스 도메인과 타겟 도메인의 포인트 클라우드 데이터를 교환하는 방식으로 작동한다. 이 과정을 통해 PolarMix는 라이다 포인트 클라우드의 본질적인 특성을 유지하면서 도메인 간의 유연하게 적응할 수 있도록 하였다.

데이터 증강 기반 도메인 매핑 기법들은 센서의 설정(채널 개수, 채널당 포인트의 개수, 화각)에 크게 영향받는 라이다 포인트 클라우드 특성에 적합하다. 이 접근법은 소스 도메인과 타겟 도메인의 라이다 환경 설정을 파악하고 있고 타겟 도메인에서 충분한 데이터를 확보할 수 있다면 도메인 간 격차를 효과적으로 줄일 수 있는 장점을 가진다. 그러나 타겟 도메인의 데이터 확보가 어려울 경우, 기법의 적용이 제한적일 수 있다는 단점이 존재한다.

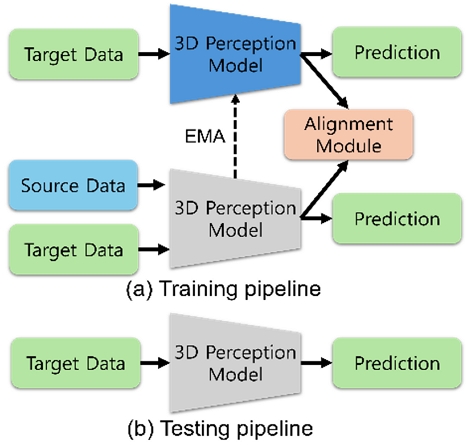

특징 지도 기반 도메인 매핑 접근법(그림 9 참조)에서 중요한 요소는 일관성 손실(Consistency loss) 이다. 이 방법론은 레이블이 없는 타겟 도메인 데이터에 서로 다른 데이터 증강 기법을 적용한 후 동일한 결과를 예측하도록 유도하는 일관성 손실을 적용함으로써 레이블이 없는 데이터에서 학습 가능한 방법을 사용한다. 이 과정을 통해 신경망이 소스 도메인에 과적합되지 않고 레이블 없이 타겟 도메인의 내재적인 특성을 학습할 수 있도록 한다.

MLC-Net[31]은 3차원 객체 검출 분야에서 비지도 도메인 적응을 목표로 개발된 방법이다. 이 모델은 레이블이 없는 타겟 도메인 데이터 학습 시 생기는 모델 학습의 변동성을 완화하기 위해 mean-teacher[32] 프레임워크를 채택했다. 추가적으로, 데이터 증강을 통해 생성된 두 가지 형태의 타겟 도메인 데이터를 활용하여, 예측된 3차원 박스 내 포인트들과 박스 간에 동일한 예측을 유도하는 두 가지 일관성 손실을 제안하였다.

DTS[33] 또한 3차원 객체 검출 분야를 위해 제안된 도메인 적응 기법이다. 먼저 소스 도메인과 타겟 도메인의 밀도를 일치시키는 데이터 증강 기법을 도입하였다. 추가적으로 조정된 밀도를 가진 데이터와 기존 데이터에서 예측한 객체를 기반으로 그래프를 형성한다. 예측된 객체를 그래프의 노드로 정의하고 인접한 객체 사이에 엣지를 형성하여 그래프는 객체 간의 관계를 모델링하게 된다. DTS는 타겟 도메인 데이터에서 생성된 그래프 간의 일관성 손실 방법을 통해 신경망이 객체뿐만 아니라 객체 간의 관계를 일관적으로 학습 가능하도록 유도함으로써 타겟 도메인에서의 정보 학습을 개선하였다.

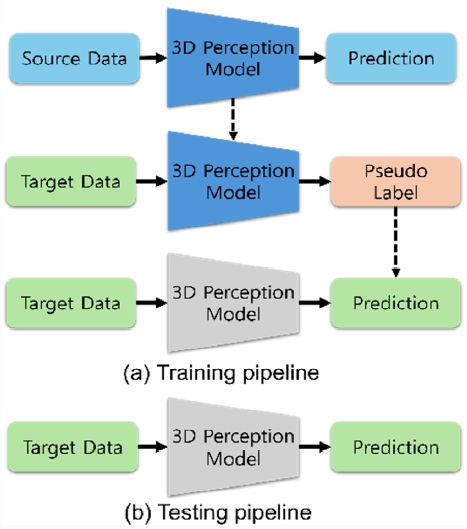

수도 레이블(Pseudo label) 기반 기법(그림 10 참조)은 소스 도메인 데이터를 직접적으로 변환하지 않고 양질의 수도 레이블을 통해 간접적으로 매핑하는 방법이다. 수도 레이블 기법[34]은 학습된 모델이 타겟 도메인의 레이블이 없는 데이터에 대해 예측한 결과를 수도 레이블로 가정한 후 수도 레이블을 레이블로 가정하고 신경망을 학습하는 방식이다. 생성된 고품질의 수도 레이블은 신경망이 타겟 도메인 내 다양한 데이터 형태에 빠르게 적응하게 만들어, 소스 정보를 타겟 도메인에 효과적으로 전달한다. 그러나 이 과정에서 수도 레이블의 품질은 신경망의 성능에 크게 의존하며, 부정확한 레이블은 학습 과정에 악영향을 미칠 수 있다. 따라서 신경망의 정확도를 개선하고 잘못된 레이블로 인한 학습 문제를 최소화하는 것이 이 기법의 핵심 과제이다.

SF-UDA3D[35]는 수도 레이블 생성 기법을 라이다 기반의 도메인 적응 분야에 처음 적용한 방법 중 하나이다. SF-UDA3D는 타겟 도메인 데이터의 다중 프레임 데이터에 스케일을 조정하는 데이터 증강을 적용하여 가장 일관성 있는 수도 레이블을 선정한다. 또한 생성한 수도 레이블 간의 일관성 손실을 적용함으로써 신경망이 타겟 도메인에서 강건한 수도 레이블을 생성할 수 있도록 한다. 이를 통해 타겟 도메인에서 생성되는 수도 레이블의 변동성과 노이즈를 감소시켜 양질의 수도 레이블을 생성하였다.

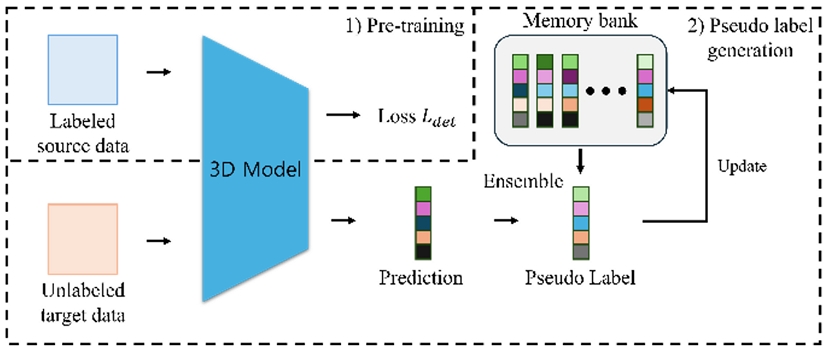

ST3D[36]는 타겟 도메인에서 레이블이 없는 데이터를 활용하여 수도 레이블을 생성하고, 이를 활용해 모델을 반복적으로 개선하는 자가 학습 프레임워크를 제안한다(그림 11 참조). 생성된 수도 레이블은 메모리 뱅크에 저장되며 다음 학습 단계에서 신경망이 메모리 뱅크에 저장된 수도 레이블과의 비교를 통해 수도 레이블의 품질을 지속적으로 개선시킨다(그림 12 참조). ST3D++[37]는 ST3D를 확장한 방법으로 수도 레이블 선정 시 신경망이 예측한 정확도와 예측한 IoU를 기반으로 수도 레이블을 선정하여 품질을 개선하였다. 또한 정보 전이시 적용하는 데이터 증강 기법의 강도를 서서히 올리는 Curriculum Data Augmentation 기법을 제안하여 노이즈 관리를 최적화하였다.

CL3D[38]는 SGA(Spatial Geometry Alignment)모듈과 TMA(Temporal Motion Alignment)모듈을 통해 공간적 정보와 시간적 정보를 통해 프로토타입을 구성하는 기법을 제안하였다. 프로토타입 기법은 클래스가 속하는 대표적인 예시(프로토타입)를 선정하고, 이를 기준으로 수도 레이블을 선정하는 기법이다. 먼저 SGA 모듈은 FPS(Furthest Point Sampling) 알고리즘을 통해 포인트 클라우드의 대표 포인트를 샘플링한 후 얻은 지역적 정보와 전역적 정보를 합쳐서 기하학적 중심의 정보를 얻는다. TMA 모듈은 연속 프레임 간의 움직임 정보를 추출하는 신경망 구조를 통해 움직임 인식 정보를 얻는다. 두 정보를 기반으로 생성된 프로토타입은 타겟 도메인의 다양성을 반영하는 수도 레이블을 안정적으로 생성하고, 프로토타입을 지속적으로 개선함으로써 모델의 적응 능력을 강화하였다.

3.3 기타 기법

배치 정규화[37](BN, Batch Normalization)는 신경망의 학습 과정을 안정화하기 위해 제안된 방법으로, 배치 내 데이터의 평균과 분산을 계산하여 데이터를 정규화 하는 모듈이다. 이 방법은 학습의 안정성을 크게 개선하여 현대 신경망을 구성할 때 필수적으로 포함되는 모듈이지만, 소스 도메인과 타겟 도메인 간의 분포 차이가 클 때 도메인 적응을 방해하는 원인이 된다. Mirza 등[40]은 이를 위해, 타겟 도메인 데이터가 입력으로 들어올 때 배치 정규화의 평균과 분산을 유동적으로 조절하는 방법을 제안한다. 평균과 분산을 계산할 때 조정 비율을 관리하기 위한 모멘텀 항을 추가함으로써, 타겟 도메인의 데이터 분포에 적응할 수 있게 한다. 결과적으로 자율주행 환경의 날씨 변화와 같은 조건에서도 높은 성능을 유지하였다. Wang 등[41]은 객체의 크기의 분포가 데이터셋이 취득된 국가나 지역에 따라 달라지며, 이 분포의 차이로 인해 성능이 하락한다는 문제를 지적한다. 이를 해결하기 위해, 타겟 도메인의 객체 크기의 평균과 분산을 알고 있는 경우 소스 도메인 학습과정에서 객체 크기의 분포를 조절하는 데이터 증강 기법을 제안함으로써 성능 하락 문제를 효과적으로 완화하였다.

Ⅳ. 결 론

본 논문은 자율주행 환경에서 라이다를 이용한 인지 신경망을 위한 다양한 도메인 적응 기법에 대한 연구를 종합적으로 소개하였다. 라이다 기반 신경망 인지 모델은 카메라로는 얻기 어려운 거리 정보를 활용해 3차원 인식 분야에서 뛰어난 성능을 보이지만, 학습 도메인과 다른 환경에서는 성능이 크게 저하되는 문제가 있다. 도메인 적응 기법은 이러한 성능 저하 문제를 극복하고, 자율주행 운용 영역 확장에 있어서 핵심적인 역할을 하기 위해 제안되었다.

도메인 적응 기법은 신경망이 학습하는 과정에서 도메인 간 차이를 어떻게 완화할 수 있는지에 초점을 맞추며, 이는 두 가지 주요 방법으로 분류된다. 도메인 불변 기법은 도메인에 영향받지 않는 데이터 혹은 특징을 추출하여 신경망이 도메인의 분포에서 받는 영향을 최소화하도록 한다. SPG, Complete & Label, 3D-VField 은 입력 포인트 클라우드에 변형을 통해 제3의 도메인으로 전이시켜 입력 도메인 간의 차이를 완화하였다. SRDAN은 도메인 분류기의 역전파에 음수를 취함으로써 신경망이 도메인을 분류하지 못하도록 유도함으로써 도메인 불변인 특징을 추출하였다. 도메인 매핑 기법은 소스 도메인의 정보를 타겟 도메인으로 효과적으로 전이하기 위한 기법이다. SSDA3D, PolarMix는 입력 포인트 클라우드를 변화시켜 도메인 격차를 완화하는 데이터 증강 기법을 제안하였고 MLC-Net, DTS는 신경망이 레이블이 없는 타겟 도메인 데이터에 대해 일관성 있는 예측을 하게 하는 일관성 손실을 적용함으로써 도메인 격차를 완화한다. SF-UDA3D, ST3D, ST3D++는 타겟 도메인의 수도 레이블 생성시 도메인 격차로부터 생기는 노이즈를 완화함으로써 소스 도메인 정보를 보존하였다. 또한 배치 정규화 모듈로부터 생기는 도메인 격차에 대한 민감함을 완화하거나 물체 크기에 영향받는 자율주행 환경의 특성을 반영해 물체 크기 정규화를 통해 도메인 격차를 완화하는 학습 방법이 제안되었다.

표 2에서 비교한 도메인 적응 기법 외에도 다양한 기법이 존재하며, 신경망 학습 프레임워크에서 다양한 단계에서 발생할 수 있는 도메인 격차를 완화하고, 자율주행 환경에서 생기는 도메인 격차를 완화하는지에 따라 매우 다양한 방법들이 제시되고 있다.

Categorization of domain adaptation methods for point cloud learning(Task: SemSeg – Semantic Segmentation, Detect – Detection, Datasets: K – KITTI, W – Waymo, N – nuScenes, SK–SemanticKITTI, NL–nuScenes-lidarseg, P–PreSIL, SP–SemanticPOSS)

이러한 도메인 적응 기법들은 대부분 카메라 이미지를 위해 개발된 기법에서 영감을 받았지만, 자율주행 환경의 라이다 포인트 클라우드의 특성을 반영한 방법론이 계속 제시되고 있다. 자율주행 기술의 상용화가 가속되는 현시점에서 다양한 회사가 자율주행 운용 가능 영역 확장에 집중하고 있으며, 이에 따라 도메인 적응 기법의 중요성은 계속해서 증가할 것으로 보인다.

Acknowledgments

“이 논문은 2024년도 정부(과기정통부)의 재원으로 한국연구재단의 지원을 받아 수행된 연구임”(No. RS-2024-00421129, 50%)

“이 논문은 2024년도 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 연구임”(No. RS-2021-II211343,인공지능대학원지원(서울대학교), 50%)

References

-

M. Lee, J. Bae, S. Choi, and S. Lee, "Plane Detection and Projection-based Filter for Enhanced MovingObject Segmentation in 3D LiDAR Environment", Journal of KIIT, Vol. 22, No. 12, pp. 19-27, Dec. 2024.

[https://doi.org/10.14801/jkiit.2024.22.12.19]

-

J. Kim and J. Choi, "YOLO-based Real-Time Object Detection Scheme Combining RGB Image with LiDAR Point Cloud", Journal of KIIT, Vol. 17, No. 8, pp 93-105, Aug. 2019.

[https://doi.org/10.14801/jkiit.2019.17.8.93]

-

Y. Zhou and O. Tuzel, "Voxelnet: End-to-end learning for point cloud based 3d object detection", Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR), Salt Lake City, UT, USA, pp. 4490-4499, Jun. 2018.

[https://doi.org/10.1109/CVPR.2018.00472]

-

Y. Yan, Y. Mao, and B. Li, "Second: Sparsely embedded convolutional detection", Sensors, Vol. 18, No.10, pp. 3337, Oct. 2018.

[https://doi.org/10.3390/s18103337]

-

Y. Bin, W. Luo, and R. Urtasun, "Pixor: Real-time 3d object detection from point clouds", Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR), Salt Lake City, UT, USA, pp. 7652-7660, Jun. 2018.

[https://doi.org/10.1109/CVPR.2018.00798]

-

S. H. Lang, S. Vora, H. Caesar, L. Zhou, J. Yang, and O. Beijbom, "Pointpillars: Fast encoders for object detection from point clouds", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Long Beach, CA, USA, pp. 12697-12705, Jun. 2019.

[https://doi.org/10.1109/CVPR.2019.01298]

-

S. Shi, X Wang, and H. Li, "Pointrcnn: 3d object proposal generation and detection from point cloud", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Long Beach, CA, USA, pp 770-779, Jun. 2019.

[https://doi.org/10.1109/CVPR.2019.00086]

-

Z. Yang, Y. Sun, S. Liu, and J. Jia, "3dssd: Point-based 3d single stage object detector", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Seattle, WA, USA, pp 11040-11048, Jun. 2020.

[https://doi.org/10.1109/CVPR42600.2020.01105]

-

L. T. Triess, M. Dreissig, C. B. Rist, and J. M. Zöllner, "A survey on deep domain adaptation for lidar perception", 2021 IEEE Intelligent Vehicles Symposium Workshops(IV workshops), Nagoya, Japan, pp 350-357, Jul. 2021.

[https://doi.org/10.1109/IVWorkshops54471.2021.9669228]

- J. Koh, J. Kim, and J. W. Choi, "Survey on deep learning-based 3D object detection algorithms using LiDAR data", Communications of the Korean Institute of Information Scientists and Engineers, Vol. 37, No. 1, pp. 61-71, Jan. 2019.

-

M. Sun, D. Paek, and S. Kong, "A study on deep learning based lidar object detection neural networks for autonomous driving", Transaction of the Korean Society of Automotive Engineers, Vol. 30, No. 8, pp 635-647, Aug. 2022.

[https://doi.org/10.7467/KSAE.2022.30.8.635]

-

C. R. Qi, H. Su, K. Mo, and L. J. Guibas, "Pointnet: Deep learning on point sets for 3d classification and segmentation", Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR), Honolulu, HI, USA, pp. 652-660, Jul. 2017.

[https://doi.org/10.1109/CVPR.2017.16]

- C. R. Qi, L. Yi, H. Su, and L. J. Guibas, "Pointnet++: Deep hierarchical feature learning on point sets in a metric space", Advances in Neural Information Processing Systems(NeurIPS), Long Beach, California, USA, pp. 5105-5114, Dec. 2017.

-

C. R. Qi, W. Liu, C. Wu, H. Su, and L. J. Guibas, "Frustum pointnets for 3d object detection from rgb-d data", Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR), Salt Lake City, UT, USA, pp. 918-927, Jun. 2018.

[https://doi.org/10.1109/CVPR.2018.00102]

-

A. Geiger, P. Lenz, and R. Urtasun, "Are we ready for autonomous driving? the kitti vision benchmark suite", Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition(CVPR), Providence, RI, USA, pp 3354-3361, Jun. 2012.

[https://doi.org/10.1109/CVPR.2012.6248074]

-

H. Caesar, V. Bankiti, A. H. Lang, S. Vora, V. E. Liong, Q. Xu, A. Krishnan, Y. Pan, G. Baldan, and O. Bejibom, "nuScenes: A multimodal dataset for autonomous driving", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Seattle, WA, USA, pp. 11621-11631, Jun. 2020.

[https://doi.org/10.1109/CVPR42600.2020.01164]

-

P. Sun, H. Kretzschmar, X. Dotiwalla, A. Chouard, V. Patnaik, P. Tsui, J. Guo, Y. Zhou, Y. Chai, B. Caine, V. Vasudevan, W. Han, J. Ngiam, H. Zhou, A. Timofeev, S. Ettinger, M. Krivokon, A. Gao, A. Joshi, Y. Zhang, J. Shlens, Z. Chen, and D. Anguelov, "Scalability in perception for autonomous driving: Waymo open dataset", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Seattle, WA, USA, pp. 2446-2454, Jun. 2020.

[https://doi.org/10.1109/CVPR42600.2020.00252]

-

J. Behley, M. Garbade, A. Milioto, J. Quenzel, S. Behnke, C. Stachniss, and J. Gall, "SemanticKITTI: A dataset for semantic scene understanding of lidar sequences", Proceedings of the IEEE/CVF International Conference on Computer Vision(ICCV), Seoul, Korea, pp. 9297-9307, Oct. 2019.

[https://doi.org/10.1109/ICCV.2019.00939]

-

B. Hurl, K. Czarnecki, and S. Waslander, "Precise synthetic image and lidar (presil) dataset for autonomous vehicle perception", IEEE Intelligent Vehicles Symposium(IV), Paris, France, pp. 2522-2529, Jun. 2019.

[https://doi.org/10.1109/IVS.2019.8813809]

-

Y. Pan, B. Gao, J. Mei, S. Geng, C. Li, and H. Zhao, "Semanticposs: A point cloud dataset with large quantity of dynamic instances", IEEE Intelligent Vehicles Symposium(IV), Las Vegas, NV, USA, pp. 687-693, Oct. 2020.

[https://doi.org/10.1109/IV47402.2020.9304596]

-

L. Yi, B. Gong, and T. Funkhouser, "Complete & label: A domain adaptation approach to semantic segmentation of lidar point clouds", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Nashville, TN, USA, pp. 15363-15373, Jun. 2021.

[https://doi.org/10.1109/CVPR46437.2021.01511]

-

Q. Xu, Y. Zhou, W. Wang, C. R. Qi, and D. Anguelov, "Spg: Unsupervised domain adaptation for 3d object detection via semantic point generation", Proceedings of the IEEE/CVF International Conference on Computer Vision(ICCV), Montreal, QC, Canada, pp. 15446-15456, Oct. 2021.

[https://doi.org/10.1109/ICCV48922.2021.01516]

-

X. Chong, C. R. Qi, and B. Li, "Generating 3d adversarial point clouds", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Long Beach, CA, USA, pp. 9136-9144, Jun. 2019.

[https://doi.org/10.1109/CVPR.2019.00935]

-

A. Lehner, S. Gasperini, A. Marcos-Ramiro, M. Schmidt, M. N. Mahani, N. Navab, B. Busam, and F. Tombari, "3d-vfield: Adversarial augmentation of point clouds for domain generalization in 3d object detection", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), New Orleans, LA, USA, pp. 17295-17304, Jun. 2022.

[https://doi.org/10.1109/CVPR52688.2022.01678]

- Y. Ganin, E. Ustinova, H. Ajakan, P. Germain, H. Larochelle, F. Laviolette, M. March, and V. Lempitsky, "Domain-adversarial training of neural networks", Journal of Machine Learning Research(JMLR), Vol. 17, No. 59, pp. 1-35, 2016.

-

W. Zhang, W. Li, and D. Xu, "Srdan: Scale-aware and range-aware domain adaptation network for cross-dataset 3d object detection", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Nashville, TN, USA, pp. 6769-6779, Jun. 2021.

[https://doi.org/10.1109/CVPR46437.2021.00670]

-

S. Yun, D. Han, S. J. Oh, S. Chun, J. Choe, and Y. Yoo, "Cutmix: Regularization strategy to train strong classifiers with localizable features", Proceedings of the IEEE/CVF International Conference on Computer Vision(ICCV), Seoul, Korea, pp. 6023-6032, Oct. 2019.

[https://doi.org/10.1109/ICCV.2019.00612]

- H. Zhang, M. Cisse, Y. N. Dauphin, and D. Lopez-Paz, "Mixup: Beyond empirical risk minimization", International Conference on Learning Representations(ICLR), Vancouver CANADA, Apr. 2018.

-

Y. Wang, J. Yin, W. Li, P. Frossard, R. Yang, and J. Shen, "Ssda3d: Semi-supervised domain adaptation for 3d object detection from point cloud", Proceedings of the AAAI Conference on Artificial Intelligence(AAAI), Washington DC, USA, Vol. 37, No. 3, pp. 2707-2715, Feb. 2023.

[https://doi.org/10.1609/aaai.v37i3.25370]

- A. Xiao, J. Huang, D. Guan, K. Cui, S. Lu, and L. Shao, "Polarmix: A general data augmentation technique for lidar point clouds", Advances in Neural Information Processing Systems(NeurIPS), New Orleans, Louisiana, USA, Vol. 35, pp. 11035-11048, Nov. 2022.

-

Z. Luo, Z. Cai, C. Zhou, G. Zhang, H. Zhao, S. Yi, S. Lu, H. Li, S. Zhang, and Z. Liu, "Unsupervised domain adaptive 3d detection with multi-level consistency", Proceedings of the IEEE/CVF International Conference on Computer Vision(ICCV), Montreal, QC, Canada, pp. 8866-8875, Oct. 2021.

[https://doi.org/10.1109/ICCV48922.2021.00874]

- A. Tarvainen and H. Valpola, "Mean teachers are better role models: Weight-averaged consistency targets improve semi-supervised deep learning results", Proceedings of the 31st International Conference on Neural Information Processing Systems, Long Beach, California, USA, pp. 1195-1204, Dec. 2017.

-

Q. Hu, D. Liu, and W. Hu, "Density-insensitive unsupervised domain adaption on 3d object detection", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Vancouver, BC, Canada, pp. 17556-17566, Jun. 2023.

[https://doi.org/10.1109/CVPR52729.2023.01684]

- D. H. Lee, "Pseudo-label: The simple and efficient semi-supervised learning method for deep neural networks", Workshop on Challenges in Representation Learning, ICML, Vol. 3, No. 2, pp. 896, Jul. 2013.

-

C. Saltori, S. Lathuiliére, N. Sebe, E. Ricci, and F. Galasso, "Sf-uda 3d: Source-free unsupervised domain adaptation for lidar-based 3d object detection", International Conference on 3D Vision (3DV), Fukuoka, Japan, pp. 717-780, Nov. 2020.

[https://doi.org/10.1109/3DV50981.2020.00087]

-

J. Yang, S. Shi, Z. Wang, H. Li, and X. Qi, "St3d: Self-training for unsupervised domain adaptation on 3d object detection", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Nashville, TN, USA, pp. 10368-10378, Jun. 2021.

[https://doi.org/10.1109/CVPR46437.2021.01023]

-

J. Yang, S. Shi, Z. Wang, H. Li, and X. Qi, "St3d++: Denoised self-training for unsupervised domain adaptation on 3d object detection", IEEE Transactions on Pattern Analysis and Machine Intelligence(TPAMI), Vol. 45, No. 5, pp. 6354-6371, May 2023.

[https://doi.org/10.1109/TPAMI.2022.3216606]

-

X. Peng, Z. Zhu, and Y. Ma, "Cl3d: Unsupervised domain adaptation for cross-lidar 3d detection", Proceedings of the AAAI Conference on Artificial Intelligence(AAAI), Washington, DC, USA, Vol. 37, No. 2, pp. 2047-2055, Feb. 2023.

[https://doi.org/10.1609/aaai.v37i2.25297]

- S. Ioffe and C. Szegedy, "Batch normalization: Accelerating deep network training by reducing internal covariate shift", International Conference on Machine Learning(ICML), Lille France, Vol. 37, pp. 448-456, Jul. 2015.

-

M. J. Mirza, J. Micorek, H. Possegger, and H. Bischof, "The norm must go on: Dynamic unsupervised domain adaptation by normalization", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), New Orleans, LA, USA, pp. 14765-14775, Jun. 2022.

[https://doi.org/10.1109/CVPR52688.2022.01435]

-

Y. Wang, X. Chen, Y. You, L. E. Li, B. Hariharan, M. Campbell, K. Q. Weinberger, and W. Chao, "Train in germany, test in the usa: Making 3d object detectors generalize", Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR), Seattle, WA, USA, pp. 11713-11723, Jun. 2020.

[https://doi.org/10.1109/CVPR42600.2020.01173]

2006년 2월 : 한양대학교 전자전기공학과(공학사)

2008년 8월 : 한양대학교 전자전기제어계측공학과(공학석사)

2018년 ~ 현재 : 한양대학교 전기공학과 박사과정

관심분야 : Vision AI, Cloud Platform, Image Processing

2000년 2월 : 서울대학교 전기공학과(공학사)

2002년 2월 : 서울대학교 전기공학과(공학석사)

2010년 8월 : 어바나샴페인 일리노이 주립대 전기 및 컴퓨터 공학부(공학박사)

2010년 8월 ~ 2013년 8월 : 시니어 엔지니어, 퀄컴(샌디에고)

2013년 9월 ~ 2024년 2월 : 한양대학교 전기생체공학부 교수

2024년 3월 ~ 현재 : 서울대학교 자유전공학부, 전기정보공학부 부교수

관심분야 : 인공지능, 로봇인지, 자율주행, 센서신호처리