ARCore 기반 이미지 트래킹에서의 객체 지터 감소 기법

초록

ARCore는 증강현실(Augmented reality) 기술을 활용하여 다양한 분야에서 안드로이드 기반 사용자 경험을 향상시키는 플랫폼이다. 그러나 ARCore 기반 이미지 추적 시스템에서 발생하는 증강 오브젝트의 지터(Jitter) 문제는 사용자 경험을 저해하는 주요 원인으로 작용한다. 본 연구는 월드 좌표계에서 고정된 객체를 카메라 좌표계로 변환하여 상대 위치를 계산하고, 프레임 간 상대 변화량을 정량적으로 분석하였다. 이를 구현하기 위해 보간 및 보정 알고리즘을 설계하였으며, 지터에 대한 비교 실험 결과 약 37.75%의 지터 감소와 추적 안정성 향상을 확인하였다. 본 연구는 AR 시스템의 지터 문제를 개선하는 효율적 접근법을 통해 다양한 응용 가능성을 제시한다.

Abstract

ARCore is a platform that improves the Android-based user experience in various fields by utilizing Augmented Reality technology. However, the problem of jittering of augmented objects in ARCore-based image tracking systems is a major cause that hinders the user experience. This study calculated the relative position by converting fixed objects from the world coordinate system to the camera coordinate system, and quantitatively analyzed the relative change between frames. To implement this, interpolation and correction algorithms were designed, and as a result of comparative experiments on jittering, it was confirmed that jittering was reduced by about 37.75% and tracking stability was improved. This study presents various application possibilities through an efficient approach to improve the jittering problem of AR systems.

Keywords:

augmented reality, ARCore, jittering, image tracking, QR codeⅠ. 서 론

AR(Augmented Reality)은 물리적 세계와 디지털 정보를 결합해 새로운 경험과 상호작용을 가능하게 하는 기술로, 다양한 산업 분야에서 빠르게 확산되어 보급되고 있다[1][2]. AR 기술은 제조업, 의료, 교육, 마케팅, 게임 등 다양한 응용 분야에서 중요한 역할을 하고 있으며, 특히 엔터프라이즈 애플리케이션 및 상업적 응용에서 그 가능성을 입증하고 있다[3][4]. IKEA의 ‘IKEA Place’ 앱은 사용자가 가구를 자신의 집에 가상으로 배치하도록 지원하며, AR 기술이 상업적 성공을 이루는 데 기여한 사례로 잘 알려져 있다[5]. 또한, 의료 분야에서는 AR 기반 시뮬레이션과 수술 가이드 시스템이 정교한 시각적 정보를 제공함으로써 외과 수술의 정확성을 높이는 데 중요한 역할을 하고 있다[6].

산업 현장에서도 AR 기술은 작업 효율성과 정확성 향상에 중요한 역할을 하고 있다. 제조업과 유지보수 분야에서는 작업자가 모바일 패드를 통해 증강된 가상 객체를 실시간으로 확인하며 작업을 수행할 수 있다. 이를 통해 기계의 내부 구조나 배선 정보를 시각적으로 안내하거나, 실시간 진단 및 유지보수 절차를 제공함으로써 작업자의 생산성과 효율성을 크게 향상시킬 수 있다[7]. 이러한 응용 애플리케이션은 복잡한 장비의 조작 및 유지보수 과정에서 유용하며, 교육 자료의 제공이나 원격 지원 시스템으로도 활용될 수 있다. 결과적으로 AR 기술은 산업 전반에 걸쳐 효율성과 정확성을 증대시키고, 혁신적인 솔루션을 제공하는 데 기여하고 있다.

ARCore는 Google에서 개발한 AR 플랫폼으로, 안드로이드 모바일 장치에서 이미지 또는 객체 인식을 통해 가상 객체를 물리적 환경에 배치하는 강력한 도구로 자리 잡고 있다[8]. ARCore는 SLAM (Simultaneous Localization and Mapping) 기술을 활용하여 카메라 위치를 추적하고 환경을 매핑하며, QR 코드와 같은 정적 이미지를 기준으로 가상 객체를 정확히 배치할 수 있다[9]. 이 기술은 엔터테인먼트, 교육, 상업적 애플리케이션뿐만 아니라 제조업과 같은 산업용 유지보수 시스템에도 널리 활용되고 있다. 그러나 ARCore 기반 이미지 추적 시스템에서는 지터(Jittering) 문제가 빈번히 발생하며, 이는 사용자의 몰입도를 저하시킬 뿐만 아니라 시스템의 신뢰성을 제한하는 주요 요인으로 작용한다.

지터 현상은 주로 카메라의 위치 변화, 추적 알고리즘의 오차 누적 같은 환경적 요인에 의해 발생한다. 카메라와 QR 코드 간 거리 변화가 클수록 지터 현상이 심화될 가능성이 높으며, 이는 특히 근거리 환경에서 사용자 경험을 저해할 수 있다[10].

본 연구는 ARCore 환경에서 QR 코드와 같은 이미지 추적 시 발생하는 지터 문제를 분석하고, 이를 해결하기 위한 거리 기반 보정 알고리즘을 제안한다. 제안된 알고리즘은 사용자가 가상 객체와의 거리에 따라 적응형 보정을 수행하며, 가까운 거리에서는 SmoothDamp를 활용하여 부드럽고 자연스러운 움직임을 제공하고, 먼 거리에서는 Lerp를 적용하여 계산 비용을 줄이고 효율적인 추적을 가능하게 한다. 이를 통해 지터 문제를 해결하고, 안정적인 사용자 경험을 제공하고자 한다.

본 논문의 각 장의 주요 내용을 다음과 같이 요약한다.

Ⅱ. 배경 이론에서는 ARCore와 이미지 트래킹 기술의 기초 개념, 지터 문제의 발생 원인과 주요 요인에 대해 논의하였다.

Ⅲ. 시스템 개발에서는 지터 문제 해결을 위해 제안된 거리 기반 보정 알고리즘과 보간 기법의 설계 과정을 상세히 설명하였다. 월드 좌표계와 카메라 좌표계 변환 방법 및 기법을 활용한 보정 과정을 체계적으로 다루었다.

Ⅳ. 측정 및 결과에서는 실험 설계를 통해 제안된 알고리즘의 성능을 검증하였다. 다양한 거리 조건에서 지터 감소율을 측정하고, 통계적 분석을 통해 제안된 기법의 유효성을 입증하였다.

Ⅴ. 결론에서는 연구의 성과와 한계를 정리하고, 실제 환경에서의 확장 가능성과 향후 연구 방향을 제안하였다.

Ⅱ. 배경 이론

2.1 AR 기반 이미지 추적 및 지터 문제

AR에서 이미지 기반 객체 추적은 가상 객체를 물리적 환경에 고정하고 정확히 배치하는 데 필수적인 기술로, 사용자 경험의 정확성과 몰입도를 결정짓는 중요한 요소이다. 그러나 이미지 추적 과정에서 발생하는 지터 문제는 AR 시스템의 안정성을 저하시킨다. 이는 이미지의 인식 정확도와 추적 빈도에 따라 객체의 위치값이 불규칙하게 변동하면서 발생하며, 사용자에게 어지러움과 불편함을 유발할 수 있다[11].

지터 현상은 특히 카메라와 QR 코드와 같은 객체 간의 미세한 흔들림이 증폭되어 발생한다[12]. 이는 주로 이미지 인식의 잦은 갱신으로 인해 발생하며, 복잡한 배경, 추적 데이터의 품질 저하가 그 원인으로 작용한다. 인식 이미지를 촬영해야 하는 카메라가 움직일 경우, 이미지 추적 알고리즘이 불안정하게 작동하여 위치 및 위치값이 빈번히 변동될 가능성이 높아진다. 이러한 문제는 몰입형 경험을 중시하는 AR 응용에서 특히 치명적일 수 있다.

2.2 이미지 추적의 정확도와 주요 요인

AR 시스템에서 이미지 추적은 카메라가 물리적 이미지를 인식하고, 해당 이미지의 위치와 회전을 계산하여 가상 객체의 좌표를 결정하는 방식으로 이루어진다. 이 과정은 ARCore와 같은 플랫폼을 통해 실행되며, 이미지의 위치와 각도를 실시간으로 감지하여 가상 객체를 물리적 세계에 정확히 배치한다. 그러나 이미지 추적의 정확도는 다양한 요인의 영향을 받는다. 대표적인 요인으로는 카메라와 QR 코드 간 거리, 이미지의 크기, 카메라의 움직임 등이 있다. 카메라와 QR 코드 간의 거리 변화는 지터 문제를 유발하는 주요 원인 중 하나이다[13].

본 연구는 이러한 지터 문제를 해결하기 위해 거리 기반 보정 알고리즘과 보간 기법을 결합하여, 사용자와 QR 코드 간 거리 변화에 따라 적응형 보정을 수행하는 방안을 제안한다. 이를 통해 근거리와 원거리 모두에서 안정적인 추적 데이터를 제공하고, 사용자 몰입도를 개선하는 데 기여하고자 한다.

Ⅲ. 시스템 개발

3.1 문제 정의

ARCore 기반 이미지 추적 시스템에서 발생하는 지터 문제는 주로 카메라와 QR 코드 간 거리 변화에서 기인한다. 카메라와 QR 코드 사이의 움직임이 위치값 변동으로 해석될 가능성이 높아지며, 이로 인해 추적된 가상 객체가 화면에서 불안정하게 떨리거나 과도한 위치값 변화를 경험하게 된다. 이러한 문제는 추적 빈도가 높아질수록 미세한 오차가 누적되면서 장기적으로 추적 정확도가 낮아지는 결과를 초래한다. 이는 사용자 경험을 저해하고 시스템 신뢰성을 떨어뜨리는 주요 원인으로 작용한다. 따라서 지터 문제를 해결하기 위해 거리 변화에 따라 동적으로 보정하는 기술적 접근이 요구된다.

3.2 카메라 좌표에 대한 상대 좌표 구현

상대 좌표 변환은 카메라의 이동으로 인해 화면에서 객체가 움직이는 것처럼 보이는 현상을 분석하고, 이를 기반으로 보정 및 보간 알고리즘을 설계하는 데 필수적인 역할을 한다.

따라서, 지터 문제를 해결하기 위해 월드 좌표계에서 고정된 객체를 카메라 좌표계로 변환하여 상대 위치를 분석하는 방법을 제안한다. 객체의 상대 위치는 월드 좌표계에 고정된 객체의 위치를 카메라 기준으로 변환하므로, 객체와 카메라 간의 상대적인 회전은 카메라 기준으로 객체의 회전 상태로 측정한다. 이러한 상대 좌표 방식은 프레임 간 객체의 위치와 회전 변화량을 정량적으로 평가할 수 있는 기반을 제공한다.

객체의 월드 좌표계 위치를 카메라 좌표계로 변환하기 위해 다음과 같은 수식을 사용한다.

| (1) |

Pcamera : 카메라 좌표계에서의 객체 위치

Rcw : 월드 좌표계에서의 객체 위치

Pworld : 월드 좌표계를 카메라 좌표계로 회전시키는 회전 행렬

Tcw : 월드 좌표계에서 카메라의 변환 벡터

Unity 엔진에서는 cameraTransform.InverseTransform Point를 이용하여 위 수식을 계산하며, 카메라를 기준으로 객체의 상대적인 위치를 실시간으로 측정한다.

프레임 간 객체의 상대 위치 변화량(지터)은 다음과 같이 계산한다.

| (2) |

ΔPjitter : 프레임 간 상대 위치 변화량(지터)

t : 현재 프레임

t+1 : 다음 프레임

‖ ㆍ ‖ : 유클리드 거리 계산

Unity에서는 Vector3.Distance를 통해 구현한다.

기존 방식과 개선된 방식의 상대 위치 변화량을 각각 측정하여, 개선된 방식의 효과를 아래와 같이 평가할 수 있다.

| (3) |

ΔPjitter, original : 기존 방법에서 측정된 지터 값

ΔPjitter, improved : 개선된 방법에서 측정된 지터 값

3.3 Lerp와 SmoothDamp를 이용한 위치값 보정

Lerp(Linear Interpolation)와 SmoothDamp를 활용한 보간 기법은 급격한 변화를 완화하고 부드러운 움직임을 보장하기 위해 설계되었다. Lerp 기법은 현재 값과 목표 값 사이를 선형적으로 보간하는 기법으로, 위치값 변화를 정밀하게 제어할 수 있다. Lerp는 계산 비용이 낮고, 변화가 급격하지 않은 원거리 환경에서의 안정성을 유지하는 데 적합하다. 따라서 본 연구에서는 먼 거리에서의 위치값 변동을 효과적으로 처리하기 위해 Lerp를 활용하였다.

SmoothDamp 기법은 감속 운동 방식을 적용하여 근거리에서 발생하는 위치값 변화를 점진적으로 조정하는 기법이다. 이는 작은 움직임이 과도하게 확대 해석되거나 흔들림으로 나타나는 문제를 완화하는 데 효과적이므로 SmoothDamp를 사용한다.

제안된 알고리즘은 카메라와 QR 코드 간의 거리를 기준으로 Lerp와 SmoothDamp를 동적으로 전환하여 적용한다. 거리 기반 적응형 보정 방식을 통해 단일 기법의 한계를 극복하며, 거리에 따른 일관된 성능을 보장한다.

3.4 시스템 워크플로우

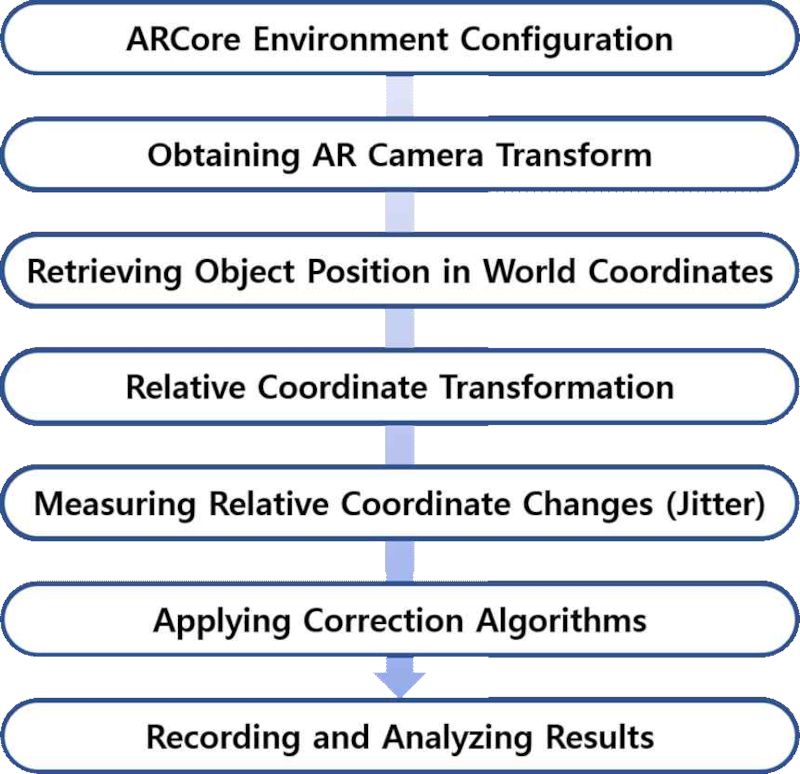

그림 1은 ARCore를 활용하여 상대 좌표를 계산하고 보정하는 전체 과정을 체계적으로 보여준다. 먼저 ARCore 환경을 설정하고 AR 세션과 카메라 구성을 수행한다.

이후 실제 디바이스가 인식한 위치와 회전 정보를 Unity 카메라 트랜스폼에 반영하여, 가상 공간과 실제 공간 간의 위치 매핑이 이루어진다. 다음으로 월드 좌표계에서 객체의 위치를 확인한 후, 이를 카메라 기준 좌표로 변환함으로써 객체와 카메라 간의 상대적인 위치를 계산한다. 이때 프레임마다 상대 좌표 변화를 추적하여 지터 정도를 정량적으로 측정한다. 측정된 지터를 완화하기 위해 보정 알고리즘을 적용함으로써 빠른 위치 변화나 튐 현상을 줄이고, 보다 안정적인 증강현실 경험을 제공한다. 마지막으로 보정 알고리즘 적용 전후의 결과를 기록하고 분석하여, 제안된 방식이 지터 문제를 개선하는 데 얼마나 효과적인지 종합적으로 평가한다.

Ⅳ. 측정 및 결과

4.1 연구 목적 및 실험 설계

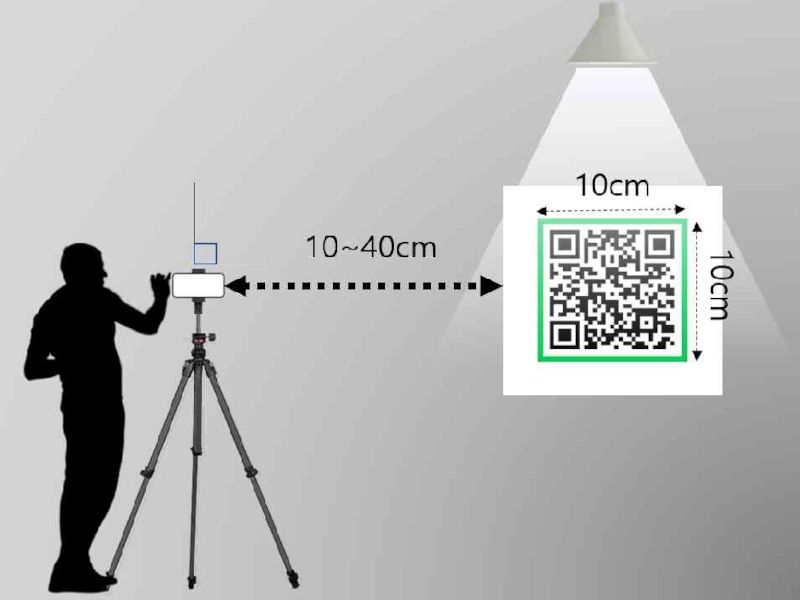

본 연구는 ARCore 기반 이미지 추적 시스템에서 발생하는 지터 문제를 정량적으로 분석하고, 제안된 거리 기반 보정 알고리즘의 효과를 검증하기 위해 실험을 설계하였다. 실험은 고정된 환경 설정과 알고리즘 비교를 통해 수행되었으며, 결과를 바탕으로 제안된 방법의 유효성을 검증하였다. 실험 환경은 ARCore를 사용하는 Android 장치에서 QR 코드를 추적하는 상황을 가정하고, 조명 조건과 배경 상태를 일정하게 유지하여 외부 변수의 영향을 최소화하였다. 또한, 카메라와 QR 코드 간 거리를 조정하여 다양한 상황에서의 성능을 측정하였다.

4.2 측정 지표와 알고리즘 적용

지터 문제와 추적 정확도를 평가하기 위해 실험은 보정 전 증강 객체 위치, 보정 후 증강 객체 위치, 총 2가지 주요 측정 지표를 포함하였다. 각 프레임에서 증강된 오브젝트의 위치값 변화를 기록하여 지터의 강도를 측정하였다. 거리와 QR 코드 크기가 지터 현상에 미치는 영향을 분석하기 위해 실험 조건을 적용하였다.

지터 계산은 각 프레임 간 위치값의 변화를 측정하었다. 변화량이 설정된 임계값을 초과할 경우 지터가 발생한 것으로 간주하였으며, 제안된 보정 알고리즘은 SmoothDamp와 Lerp를 활용해 이러한 변화를 완화하도록 설계되었다. 실험은 가로 세로의 길이가 각각 10cm로 제작된 QR 코드와 거리 변화에 따른 지터 저감 여부를 기준으로 진행되었다.

그림 2와 같이 QR 코드와 카메라의 거리를 10cm에서 40cm까지 5cm 단위로 조정하며 각 거리에서 보정 전, 후의 데이터를 동시에 비교하였다. 실험은 위치값 변동을 1,000 frame 씩 10회 반복 측정하여 크기 변화가 지터 빈도와 추적 정확도에 미치는 영향에 대한 데이터를 정량적으로 파악하기 위해 수행하였다.

4.3 실험 결과 및 분석

표 1의 왼쪽 데이터는 기존 ARCore 알고리즘으로 측정한 위치값 변동 데이터를 나타낸다. 거리 10cm에서 0.000106의 위치값이 관찰되었으며, 거리가 증가함에 따라 값이 0.000145(35cm)까지 점진적으로 증가하였다. 이는 거리가 멀어질수록 추적 불안정성이 커지는 경향을 반영한다.

표 1의 오른쪽 데이터는 제안된 거리 기반 보정 알고리즘 적용 후의 위치값 변동 데이터를 나타낸다. 거리 10cm에서 0.000068의 위치값이 측정되었으며, 거리 40cm에서는 0.000065로 감소하였다. 기존 데이터와 비교하여 개선된 알고리즘이 거리에 대응하여 더 안정적인 위치값 변동을 유지함을 보여준다.

표 2는 거리별 지터의 평균값 감소율을 나타낸다. 제안된 거리 기반 보정 알고리즘은 기존 ARCore 대비 거리 40cm에서 가장 큰 감소율(52.90%)이 나타났으며, 이는 카메라와 QR 코드 간의 적정 거리 유지가 위치값 변동 안정성에 중요한 영향을 미친다는 것을 보여준다. 거리 30cm에서도 일정 수준의 감소율(33.33%)이 확인되었으며, 이는 보정 알고리즘이 다양한 거리 조건에서도 효과적으로 작동함을 입증한다. 보정 알고리즘은 위치값 변동의 평균값을 약 37.75%, 분산을 약 29.60% 감소시키며, 기존 ARCore 대비 추적 안정성을 향상시켰다.

표 3은 제안된 보정 알고리즘의 효과를 검증하기 위해 2가지 통계적 방법인 t-검정과 ANOVA를 활용한 결과이다. t-검정을 통해 보정 전후 위치값 변동의 평균값 차이가 유의미한 것으로 나타났다. p-value가 0.05보다 작아 보정 알고리즘이 위치값 변동을 효과적으로 줄였음을 나타낸다. 또한, ANOVA 분석을 통해 거리 조건이 위치값 변동에 유의미한 영향을 미치는 것으로 나타났다. 마찬가지로 p-value가 0.05보다 작아 거리와 위치값 변동 간의 관계가 유의미함을 나타낸다.

이러한 결과는 ARCore 기반 이미지 추적 시스템의 신뢰성과 안정성을 높이는 데 기여하며, 여러 거리에서의 실용성을 강화할 수 있는 가능성을 제시한다.

Ⅴ. 결 론

본 연구는 ARCore 기반 이미지 추적 시스템에서 발생하는 지터 문제를 해결하기 위해 상대 좌표계 변환, 보간 기법 거리 기반 보정 알고리즘을 활용한 접근 방법을 제안하였다. 지터 문제는 카메라와 QR 코드 간의 거리 변화, 오차 누적, 추적 데이터의 불규칙한 갱신 등 다양한 요인으로 인해 발생하며, 이는 사용자 경험과 시스템 안정성에 부정적인 영향을 미친다. 이를 해결하기 위해 본 연구는 상대 좌표계 변환을 포함한 다각적 접근 방법을 설계하고 이를 실험적으로 검증하였다. 이를 통해 다른 거리에 따른 환경에서도 안정적인 트래킹 성능을 보장한다는 점에서 기존 연구와 차별화된다.

상대 좌표계 변환 기법을 통해 월드 좌표계에서 고정된 객체를 카메라 좌표계로 변환하여 프레임 간 상대적 위치와 회전 변화를 정량적으로 분석하였다. 이 과정은 지터 문제를 정밀히 평가하고 보정 알고리즘을 설계하는 데 기초가 되었다. 제안된 알고리즘은 거리 변화에 따라 동적으로 보정을 수행하며, 가까운 거리에서는 SmoothDamp를 활용해 급격한 위치값 변화를 부드럽게 완화하고, 먼 거리에서는 Lerp를 적용해 계산 효율성과 안정성을 동시에 확보하였다. 이를 통해 작은 움직임으로 인한 과도한 추적 데이터 갱신을 줄이고, 큰 움직임은 부드럽게 처리함으로써 지터 문제를 효과적으로 감소시켰다.

본 연구의 결과에서 상대 좌표계 변환 기법을 활용한 점은 기존 연구와 차별화되는 특징으로, 객체와 카메라 간의 상대적 위치와 회전 변화를 직관적으로 분석하고 이를 보정 기법에 통합함으로써 사용자 경험과 시스템 신뢰성을 높였다.

그러나 본 연구는 통제된 실험 환경에서 수행되었으며, 카메라가 속도를 가지고 움직이거나 QR코드가 반듯하게 찍히지 않고 기울어진 상태에서 인식되는 상황과 같은 다양한 실제 환경에 대한 고려가 부족하다. 이를 보완하기 위해, 다양한 시나리오에서의 성능 검증이 필요하다. 카메라가 속도를 가지고 이동하는 경우나 QR코드가 기울어진 상태에서 촬영되는 경우, 알고리즘의 정확도와 인식 속도를 평가하는 실험 환경을 구성할 필요가 있다.

카메라가 움직이는 환경을 설정하고, 각 속도에서 QR코드의 인식 정확도와 처리 시간 및 점진적으로 기울어진 상태에서의 정확도와 인식 오류율을 비교 분석 평가한다. 이를 통해 실험 환경에서뿐만 아니라 실사용 환경에서의 신뢰성을 확보한다.

또한, 실제 다중 객체 추적 환경이나 동적 조명 조건에서의 알고리즘 성능 검증과 같은 확장 연구가 필요하다. 향후 연구에서는 다양한 실제 환경에서의 알고리즘 성능 평가뿐만 아니라, 소프트웨어와 하드웨어의 통합적 관점에서 AR 시스템의 안정성을 더욱 강화하는 방안을 모색해야 할 것이다.

Acknowledgments

본 과제(결과물)는 교육부와 한국연구재단의 재원으로 지원을 받아 수행된 3단계 산학연협력 선도대학 육성사업(LINC 3.0)의 연구결과입니다. 또한, 2024년도 교육부의 재원으로 한국연구재단의 지원을 받아 수행된 지자체-대학 협력기반 지역혁신 사업의 결과입니다(2021RIS-003)

References

-

F. Arena, M. Collotta, G. Pau, and F. Termine, "An overview of augmented reality", Computers, Vol. 11, No. 2, pp. 28, Feb. 2022.

[https://doi.org/10.3390/computers11020028]

-

S. H. La, Y. C. Byun, and D. C. Lee, "Development of User-Centered Experiential Museum ExhibitionContents using Augmented Reality Technology", Journal of Korean Institute Information Technology, Vol. 21, No. 8, pp. 211-218, Aug. 2023.

[https://doi.org/10.14801/jkiit.2023.21.8.211]

-

M. G. Yeom, S. M. Lee, Y. H. Park, and K. S. Han, "Augmented Reality Game of Experiential Metaverse based on Landmark", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 23, No. 6, pp. 109-117, 2023. Dec.

[https://doi.org/10.7236/JIIBC.2023.23.6.109]

-

K. E. Kwon, D. H. Kim, K. M. Park, D. Y. Jeon, and W. W. Huh, "A Design of AR Science Experiment Application for Education of 6th graders", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 23, No. 2, pp. 193-199, Apr. 2023.

[https://doi.org/10.7236/JIIBC.2023.23.2.193]

-

S. Ozturkcan, "Service innovation: Using augmented reality in the IKEA Place app", Journal of Information Technology Teaching Cases, Vol. 11, No. 1, pp. 8-13, 2021.

[https://doi.org/10.1177/2043886920947110]

-

E. Barcali, E. Iadanza, L.Manetti, P. Francia, C.Nardi, and L. Bocchi, "Augmented reality in surgery: a scoping review", Applied Sciences, Vol. 12 No. 14, pp. 6890, Jul. 2022.

[https://doi.org/10.3390/app12146890]

-

M. Eswaran and M. R. Bahubalendruni, "Challenges and opportunities on AR/VR technologies for manufacturing systems in the context of industry 4.0: A state of the art review", Journal of Manufacturing Systems, Vol. 65, pp. 260-278. Oct. 2022.

[https://doi.org/10.1016/j.jmsy.2022.09.016]

-

Z. Oufqir, A. E. Abderrahmani, and K. Satori, "ARKit and ARCore in serve to augmented reality", In 2020 International Conference on Intelligent Systems and Computer Vision (ISCV), Fez, Morocco, pp. 1-7, Jun. 2020.

[https://doi.org/10.1109/ISCV49265.2020.9204243]

-

Y. Song, J. Qin, L. Dong, and Y. Zhao, "Design of Mobile Augmented Reality System Based on SLAM", In 2021 International Conference on Culture-oriented Science & Technology (ICCST), Beijing, China, pp. 43-46, Nov. 2021.

[https://doi.org/10.1109/ICCST53801.2021.00020]

-

D. Li, J. Zhang, M. Zhou, and Z. Cao, "A motion blur QR code identification algorithm based on feature extracting and improved adaptive thresholding", Neurocomputing, Vol. 493, pp. 351-361, Jul. 2022.

[https://doi.org/10.1016/j.neucom.2022.04.041]

-

T. A. Syed, et al., "In-depth review of augmented reality: Tracking technologies, development tools, AR displays, collaborative AR, and security concerns", Sensors, Vol. 23, No.1, pp. 146, Dec. 2022.

[https://doi.org/10.3390/s23010146]

-

N. Rewkowski, A. State, and H. Fuchs, "Small marker tracking with low-cost, unsynchronized, movable consumer cameras for augmented reality surgical training", 2020 IEEE International Symposium on Mixed and Augmented Reality Adjunct (ISMAR-Adjunct), Recife, Brazil, pp. 90-95, Nov. 2020.

[https://doi.org/10.1109/ISMAR-Adjunct51615.2020.00038]

-

R. Zabels, R. Smukulis, R. Fenuks, A. Kučiks, E. Linina, K. Osmanis, and I. Osmanis, "Reducing motion to photon latency in multi-focal augmented reality near-eye display", Optical Architectures for Displays and Sensing in Augmented, Vol. 11765, pp. 213-224. Mar. 2021.

[https://doi.org/10.1117/12.2578144]

2016년 2월 : 경상대학교 미술교육학과(학사)

2022년 2월 : 국립창원대학교 문화융합기술협동과정(공학석사)

2022년 3월 ~ 현재 : 국립창원대학교 문화융합기술협동과정 박사과정

관심분야 : 대형언어모델, 증강/가상현실, 실감형 콘텐츠

2006년 2월 : 연세대학교 컴퓨터공학과(공학석사)

2011년 2월 : 연세대학교 컴퓨터공학과(공학박사)

2016년 3월 ~ 현재 : 강남대학교 소프트웨어응용학부 교수

관심분야 : 가상현실, 증강현실, 모바일컴퓨팅, 기계학습, HCI

2003년 8월 : 고려대학교 전자정보공학(공학사)

2006년 2월 : 연세대학교 생체인식공학(공학석사)

2011년 2월 : 연세대학교 전기전자공학(공학박사)

2011년 1월 ~ 2012년 5월 : LG전자기술원 미래IT융합연구소 선임연구원

2012년 5월 ~ 2013년 2월 : 연세대학교 전기전자공학과 연구교수

2013년 3월 ~ 2016년 8월 : 제주한라대학교 방송영상학과 조교수

2016년 9월 ~ 2019년 8월 : 동명대학교 디지털미디어공학부 부교수

2019년 9월 ~ 2024년 9월 : 국립창원대학교 문화테크노학과 부교수

2024년 10월 ~ 현재 : 국립창원대학교 문화테크노학과 정교수

관심분야 : 컴퓨터비전, 증강/가상현실, HCI