딥러닝과 깊이카메라를 활용한 안정성이 강화된 전동 킥보드

초록

본 논문은 딥러닝 기반의 전방 장애물 감지 모듈 및 사고 알림 모듈을 통합한 안전성이 강회된 전동 킥보드를 제안한다. 전방 장애물 감지 모듈은 딥러닝 모델을 활용하여 장애물(자동차, 오토바이, 사람, 자전거, 킥보드)과 불량 노면(포트홀, 과속 방지턱)을 감지하고, 감지된 객체가 장애물인 경우 깊이 카메라를 사용해 장애물과의 거리를 정확히 측정한다. 사고 알림 모듈은 장애물 감지 시 장애물과 전동 킥보드 간의 거리에 따른 경고음을 출력하며, 사고 발생 시 보호자에게 사고 정보를 전송한다. 딥러닝 모델의 mAP는 0.8118로 높은 정확도를 보였고, 장애물 거리 측정 실험에서는 평균 10% 이하의 오차를 확인하였다. 제안하는 시스템은 전방 주시 태만 및 운전 미숙으로 인한 사고를 줄이고, 사용자 안전성을 크게 향상시킬 것으로 기대된다.

Abstract

This paper proposes an enhanced safety electric scooter(S-scooter) integrating a deep learning-based forward obstacle detection module and an incident notification module. The forward obstacle detection module uses a deep learning model to detect obstacles such as cars, motorcycles, pedestrians, bicycles, and scooters, as well as defective road surfaces (potholes and speed bumps). When a detected object is identified as an obstacle, the system measures the distance using a depth camera. The incident notification module outputs a warning sound on the measured distance and sends incident information to a guardian in case of an accident. Performance evaluation shows that the deep learning model achieved a high mAP of 0.8118, and the obstacle distance measurement experiment demonstrated an average error rate of less than 10%. The proposed system is expected to reduce accidents caused by inattentive driving and inexperienced operation while significantly enhancing user safety.

Keywords:

personal mobility, obstacle detection, accident notification, image processingⅠ. 서 론

개인 이동 수단(PM, Personal Mobility)은 전기 동력을 사용하는 1인용 이동 수단을 의미한다. 최근 PM은 공유 서비스의 확산과 단거리 이동의 편이성 때문에 사용자가 지속적으로 증가하는 추세이다[1]. 국내 PM 공유 서비스 이용자는 2020년 기준 약 180만명에 달했으며, 특히 전동 킥보드 이용자는 전년 대비 3배 이상 급증하였다[2]. 그러나 이러한 급격한 증가에는 무면허 운전자와 이륜 차량 조작 미숙자가 포함되어 있어, PM 관련 교통사고 건수 또한 2017년에서 2022년 사이 약 10배나 증가하였다[3][4].

특히, 전공 킥보드 사고의 주요 원인은 주행 중 발생하는 불량 노면과 장애물로 인한 미끄러짐 및 충돌이다. 한국소비자원에서 조사한 통계에 따르면, 전공 킥보드 관련 사고 중 77.8%는 주행 중 사고이며, 이 중 불량 노면이나 장애물로 인한 사고가 76.1%를 차지한다[5]. 이러한 사고는 운전자가 사전에 사고 원인을 인지하지 못하거나, 운전 미숙으로 전방 주시에 어려움을 겪을 때 더욱 빈번하게 발생한다. 따라서 전동 킥보드 사고를 줄이기 위해서는 전방의 불량 노면과 장애물을 감지할 수 있는 방법이 필요하다.

불량 노면이나 장애물을 감지하기 위해 RADAR(Radar-Based Obstacle Detection in Unstructured Scenes), LiDAR(Light Detection And Ranging) 그리고 카메라 기반 기술이 주로 활용된다[6]-[11]. 그러나 이러한 기술들은 각각의 장단점이 존재하기 때문에 PM과 같은 제한적인 환경에 적용하기 위해서는 적합성을 신중히 고려해야 한다. 예를 들어, RADAR는 낮은 해상도로 인해 작은 장애물이나 가까운 거리의 장애물을 세밀히 감지하기 어렵지만, 날씨 조건(비, 안개 등)이나 광량에 영향을 받지 않는다는 장점이 있다[12]. LiDAR는 높은 정밀도로 복잡한 환경에서도 장애물의 거리와 형태를 정확히 감지할 수 있지만, 데이터 처리 과정이 복잡하고 가격이 비싸 경제성을 중요시하는 PM에는 적합하지 않다. 또한, 카메라는 가격이 저렴하고 설치가 간단하지만, 측정 환경의 광량에 따라 감지 성능이 크게 영향을 받을 수 있다[13].

한편, 전동 킥보드 사고로 가장 큰 위해를 입는 신체 부위는 머리와 얼굴로, 사고 발생 비율이 51.9%에 달한다. 머리와 얼굴에 상해를 입을 경우 운전자가 스스로 사고 상황에 적절히 대처하기 어려울 수 있다. 사고 대처가 지연될수록 피해가 커질 수 있어 신속하게 대응할 수 있는 시스템이 필요하다. 그러나 기존에는 사고 예방 기술에 초점이 맞춰져 있거나, 사고 발생 이후의 대응 방안만 제안하는 연구들이 대부분이다[14]-[16].

따라서 본 연구에서는 전동 킥보드의 안전성을 향상시키기 위한 새로운 접근법으로 S-scooter(Safety scooter)를 제안한다. S-scooter는 운전자가 전방의 장애물이나 불량 노면을 인지하지 못해 발생할 수 있는 사고를 예방하고, 사고 발생 시 신속히 대응할 수 있도록 설계되었다. 이를 위해 딥러닝 기반 객체 탐지 깊이 카메라로 전방 장애물의 위치와 거리를 정밀하게 측정하고 실시간 경고를 제공하는 전방 장애물 감지 모듈과, AHRS(Attitude Heading Reference System)를 활용해 사고 여부를 판단하여 보호자나 긴급 구조 시스템에 즉시 상황을 알리는 사고 알림 모듈을 통합적으로 제공한다.

본 논문의 구성은 다음과 같다. 2장에서는 기존 PM 사고 방지와 관련된 연구 동향과 기술적 한계를 분석하여 본 연구의 차별성을 제시한다. 3장에서는 S-scooter의 시스템 설계와 주요 모듈(전방 장애물 감지 모듈, 사고 알림 모듈)의 기술적 세부 사항을 설명한다. 4장에서는 S-scooter의 성능 평가 결과를 제시하며, 제안 시스템의 유효성을 검증한다. 마지막으로, 5장에서는 본 연구의 결론과 함께 향후 연구 방향을 제시한다.

Ⅱ. 관련 연구

PM의 사용 증가와 함께 안전 문제 해결을 위한 다양한 연구들이 진행되고 있다. 특히, 불량 노면이나 장애물로 인한 사고를 줄이기 위한 기술적 접근이 주목받고 있다. A. Li[14]는 딥러닝 기반 알고리즘을 사용하여 단일 카메라로 장애물을 감지하는 방식을 제안하였다.

이 알고리즘은 COCO 데이터셋에 포함된 객체들(사람, 자전거, 차량 등)과 함께 쓰레기통, 연석, 포트홀과 같은 PM 주행 환경에서 자주 마주치는 장애물들을 효과적으로 탐지한다. 특히, 가장 가까운 장애물에 대해 실시간으로 경고를 제공함으로써 사고 예방에 기여하였다. 그러나 해당 연구는 장애물의 정확한 거리 측정보다는 탐지에 중점을 두고 있으며, 사고 발생 시에 대한 대비책은 없다는 한계가 있다.

또한, E.-J. Jung et al.[15]은 자율주행 기술과 다양한 센서 시스템을 결합한 퍼스널 모빌리티 스쿠터를 개발하였다. 이 스쿠터는 실내 자율 주행, 실외 반자율 주행, 보호자 추종 주행과 같은 기능을 제공하며, 충돌 방지와 전복 방지 기술을 통해 사용자의 안전성을 높였다. 그러나, 해당 연구는 3개의 2D LiDAR와 1개의 깊이 카메라, 4개의 초음파 센서 등 다양한 센서를 활용하므로 데이터 처리에 높은 컴퓨팅 파워를 요구한다. 이러한 복잡한 시스템은 PM과 같은 소형 이동 수단에 적용하기에는 비용과 에너지 효율성 측면에서 제약이 있을 수 있다.

현재까지의 연구들은 PM의 안전성을 개선하기 위한 다양한 시도를 보여주고 있으나, 실시간성과 비용 효율성을 동시에 충족시키면서도 복잡한 환경에서 안정적으로 작동할 수 있는 시스템 개발에는 여전히 한계가 있다. 본 연구는 이러한 문제를 해결하기 위해 객체 감지와 거리 측정을 통합하여 불량 노면과 장애물을 실시간으로 탐지하고 정확한 거리 정보를 제공하는 시스템을 제안한다. 또한, 사고 발생 시 상황을 즉시 감지하고, 적절한 후속 조치를 수행함으로써 사고 이후의 안전성을 강화한다. 더불어, 비용 효율성을 고려한 설계를 통해 PM과 같은 소형 이동 수단에 적합한 기술적 대안을 제시한다.

Ⅲ. 안정성이 강화된 전동 킥보드

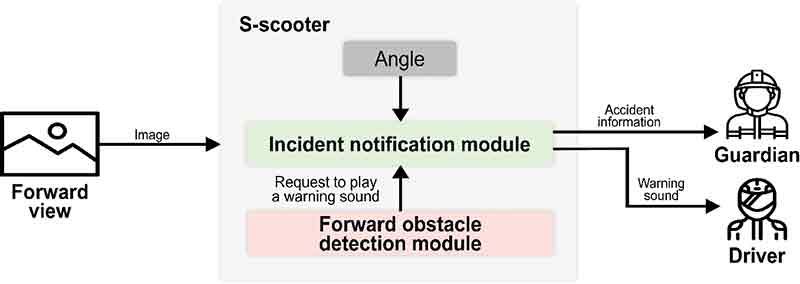

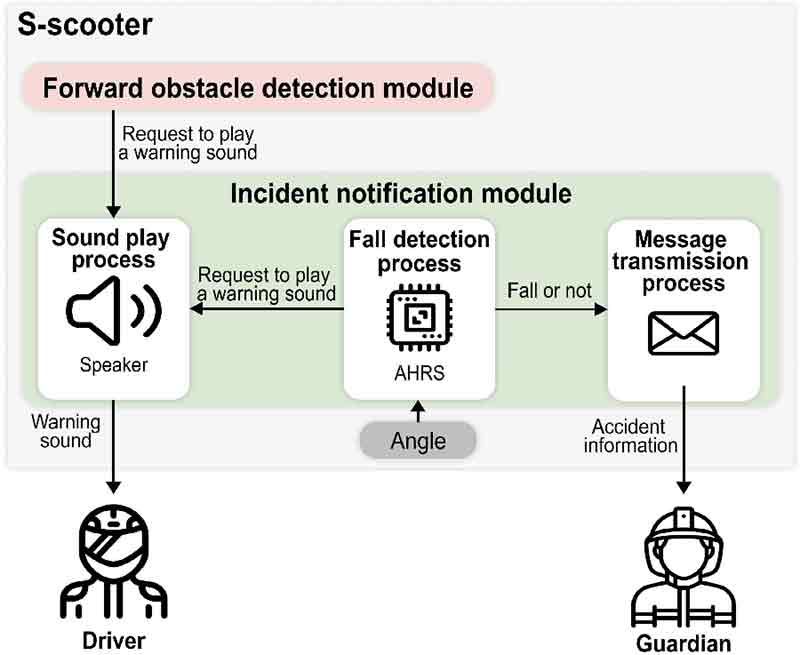

본 논문에서 제안하는 S-scooter는 전방 장애물 감지 모듈과 사고 알림 모듈로 구성된다(그림 1). 전방 장애물 감지 모듈은 노면 상태를 파악하는 프로세스와 주행 중 도로 위의 객체를 검출하여 전동 킥보드와 장애물 간의 거리를 측정하는 프로세스를 수행한다. 불량 노면이나 충돌 가능 범위 내에 장애물이 감지되면, 이 정보를 사고 알림 모듈로 전송한다. 사고 알림 모듈은 전방 상황에 따라 경고음을 재생하는 프로세스와 전동 킥보드의 각도를 측정하여 전도 여부를 판단하고 사고 발생 시 상황을 전파하는 프로세스를 수행한다.

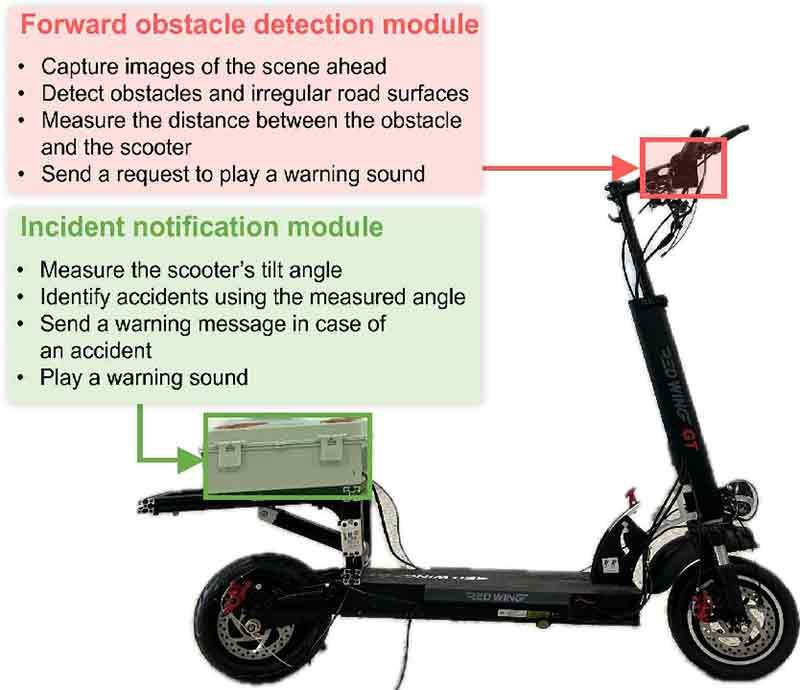

그림 2는 전방 장애물 감지 모듈과 사고 알림 모듈의 위치와 주요 기능을 나타낸다. 전방 장애물 감지 모듈은 깊이 카메라(Intel, realsense D455)를 활용하여 전방의 깊이 정보와 컬러 이미지를 동시에 수집한다.

해당 깊이 카메라는 두 개의 카메라를 사용하여 깊이 프레임을 계산하며, 이 프레임의 각 픽셀 값은 해당 지점과 카메라 간 거리를 나타낸다. 또한, 깊이 카메라에 내장된 RGB 카메라 기능을 활용해 컬러 이미지를 수집할 수 있으며, 이 이미지는 장애물 식별에 사용된다.

사고 알림 모듈은 AHRS(E2BOX, AHRS EBIMU-9DOFV5)와 스피커로 구성되며, 외부 환경(눈, 비 등)의 영향을 최소화하기 위해 컨트롤 박스 내부에 배치되었다. AHRS는 가속도계, 자이로스코프, 지자기 센서를 통해 킥보드의 회전 각도를 측정하며, 이를 통해 전동 킥보드의 전도 여부를 실시간으로 감지한다. 또한, 킥보드가 전도될 위험이 있거나 이미 전도된 경우, 스피커를 통해 경고음을 출력한다. 전도 사고가 발생했을 때 사전에 등록된 보호자에게 비상 문자를 발송한다. 또한, 전방 장애물 감지 모듈에서 경고음 출력 요청을 받으면 상황에 맞는 경고음을 재생한다.

전방 장애물 감지 모듈과 사고 알림 모듈을 제어하기 위해 임베디드 보드(NVIDIA, Jetson Orin Nano Developer Kit 8GB)를 사용하였다. 제어용 임베디드 보드는 전도 여부 판단과 경고음 출력, 딥러닝 기반 불량 노면 및 장애물을 검출 등 각 모듈의 주요 작업을 수행한다. 각 모듈의 전원은 전동 킥보드의 배터리를 통해 공급된다. 이를 위해 배터리와 SMPS(Switching Mode Power Supply)(MEAN WELL, RSD-100C-5)를 연결하여 5V(최대 20A)의 안정적인 전압을 변환 및 출력한다.

3.1 전방 장애물 감지 모듈

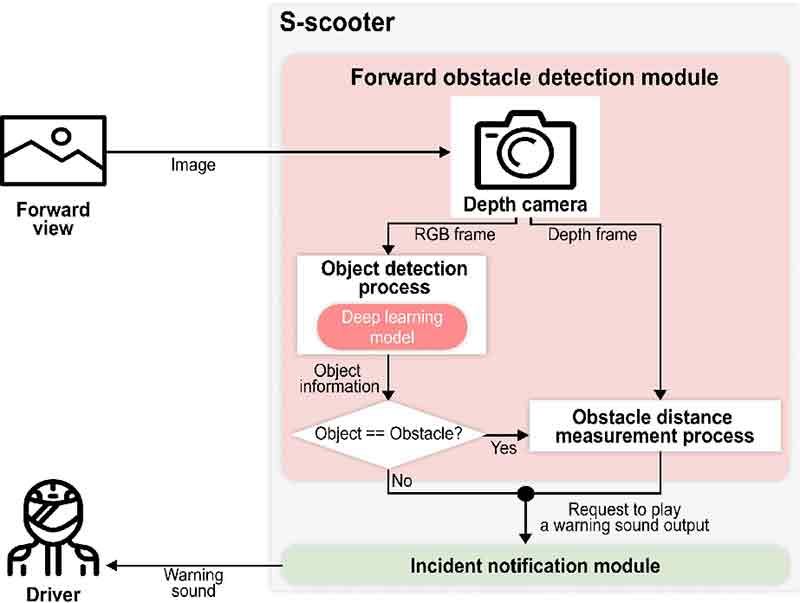

그림 3은 전방 장애물 감지 모듈의 전체 구조이다. 전방 장애물 감지 모듈은 객체 탐지 프로세스와 장애물 거리 측정 프로세스로 구성된다. 객체 탐지 프로세스는 딥러닝 모델을 통해 RGB 프레임(컬러 이미지) 상의 객체를 감지하며 해당 객체가 장애물인지 불량 노면인지를 구분한다. 이때, 감지된 객체가 불량 노면일 경우 즉시 사고 알림 모듈로 경고음 알림 요청 신호를 송신한다. 또한, 감지된 객체가 장애물일 경우에는 장애물과 전동 킥보드 간 거리를 측정한 후, 사고 알림 모듈로 경고음 알림 요청 신호를 송신한다. 장애물과 전동 킥보드 간의 거리 측정 기능을 위해 깊이 프레임을 사용하며, 장애물과의 거리가 가까울수록 큰 경고음이 발생된다.

객체 탐지 프로세스의 개발 환경과 구동 환경은 표 1과 같다. 본 논문에서는 딥러닝 모델을 통한 전방 장애물 감지에서 빠른 연산 및 처리를 위해 CUDA(Computed Unified Device Architecture)를 활용하였으며 학습은 파이썬 가상 환경 플랫폼인 아나콘다에서 진행하였다. S-scooter에는 딥러닝용 임베디드 보드를 탑재하여, 학습된 딥러닝 모델이 원활히 실행될 수 있도록 하였다.

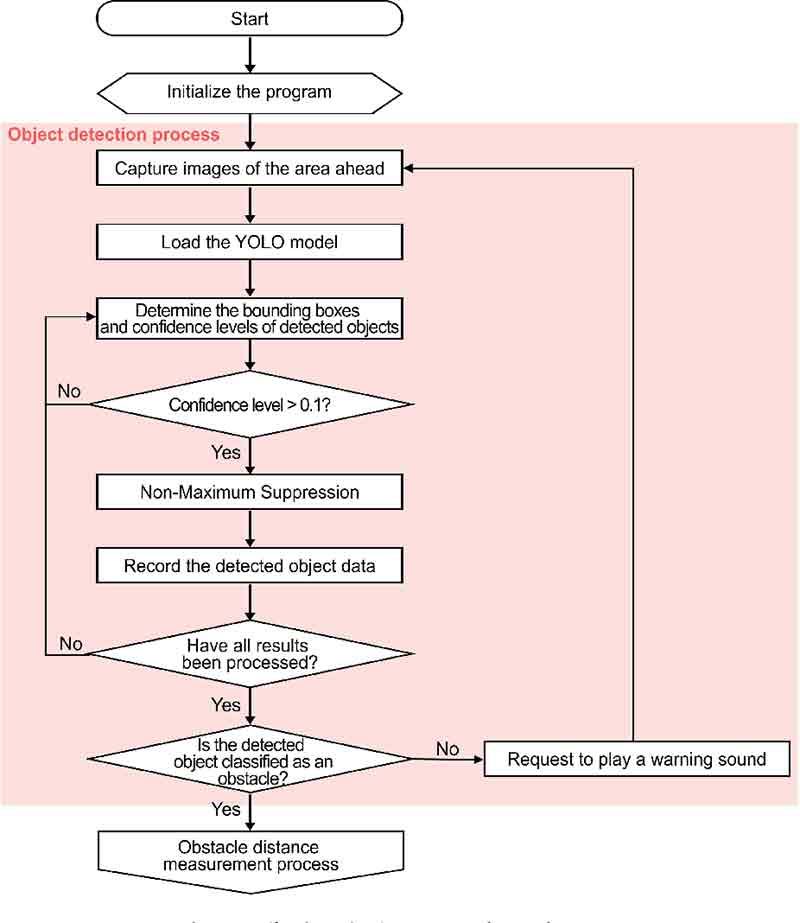

그림 4는 객체 탐지 프로세스를 통해 운전자의 주행에 방해가 되는 객체를 식별하는 과정을 보여준다. 전동 킥보드에 전원이 인가되면, 전방 장애물 감지 프로세스를 실행하기 위한 초기화 작업이 수행된다. 이 과정에서 딥러닝 모델과 분류할 객체의 이름을 로드하며, 깊이 카메라로부터 깊이 프레임과 RGB 프레임을 수신할 파이프라인을 구성한다. 또한, 각 프레임의 수신 속도를 설정하고, 사고 알림 모듈로 경고음 알림 요청 신호를 송신할 네트워크 소켓을 연결한 뒤, 객체 탐지 프로세스 및 장애물 거리 측정 기능이 반복적으로 실행된다.

깊이 카메라는 전동 킥보드 전방의 환경을 촬영하여 RGB 프레임을 생성하며, 딥러닝 모델은 이 프레임에서 객체의 존재 여부, 종류 그리고 2차원 위치를 탐지한다. 탐지 결과로 경계 상자, 신뢰도, 객체의 이름, 중심 좌표가 도출된다. 신뢰도가 0.1 이상인 결과만 필터링한 후 비최대 억제(NMS, Non-Maximum Suppression)를 통해 겹치는 경계 상자 중 신뢰도가 가장 높은 것을 남기고 나머지를 제거한다. 이를 통해 최종적으로 객체를 검출하고 검출된 객체들의 탐지 결과를 저장한다. RGB 프레임에서 탐지된 모든 결과들을 처리하면, 감지된 객체가 장애물인 경우 장애물 거리 측정 프로세스를 수행하고, 객체가 불량 노면인 경우에는 경고음 출력을 요청한다.

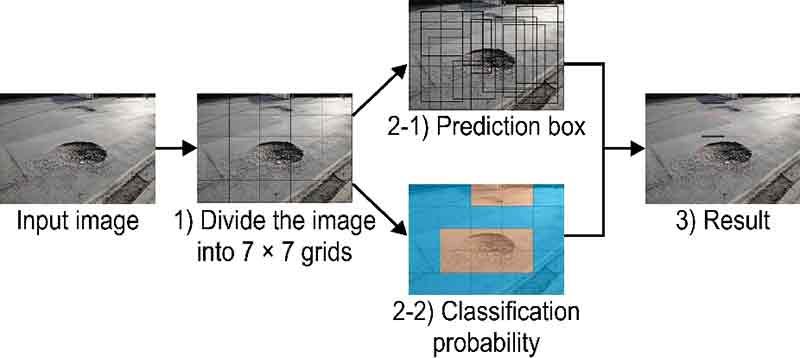

본 연구에서는 전동 킥보드 전방에 위치한 객체를 탐지하기 위해 YOLO(You Only Look Once) 모델을 활용하였다. YOLO는 합성곱 신경망(CNN, Convolutional Neural Networks) 기반으로 이미지를 한 번만 분석하여 객체를 빠르게 탐지할 수 있는 딥러닝 객체 탐지(object detection) 모델이다.

그림 5는 YOLO 알고리즘의 구조를 보여준다. 1단계에서는 입력 이미지를 7 × 7 의 그리드 셀 (Grid cells)로 분할하고, 각 그리드 셀에 대해 객체가 포함될 가능성을 판단한다. 이를 기반으로 객체의 존재 확률과 예측 상자(prediction box)를 생성한다. 2-1단계에서는 예측 상자를 기반으로 객체의 위치와 크기를 세밀히 조정하고, 각 객체에 대해 후보 경계 상자(Bounding box)를 생성한다. 이 단계에서는 동일한 객체에 대해 중복된 여러 개의 경계 상자가 생성된다. 2-2단계에서는 생성된 경계 상자를 필터링하여 신뢰도가 낮은 상자를 제거하고, 신뢰도가 높은 상자만 남긴다. 그러나 동일한 객체에 대해 여전히 중복된 경계 상자가 존재할 수 있으므로, 마지막으로 NMS를 수행한다. NMS를 통해 겹치는 경계 상자 중 신뢰도가 가장 높은 상자를 남기고, 나머지를 제거하여 탐지 결과를 정제한다. 3단계에서는 최종적으로 탐지된 객체의 경계 상자와 객체의 이름이 시각화된 것을 확인할 수 있다.

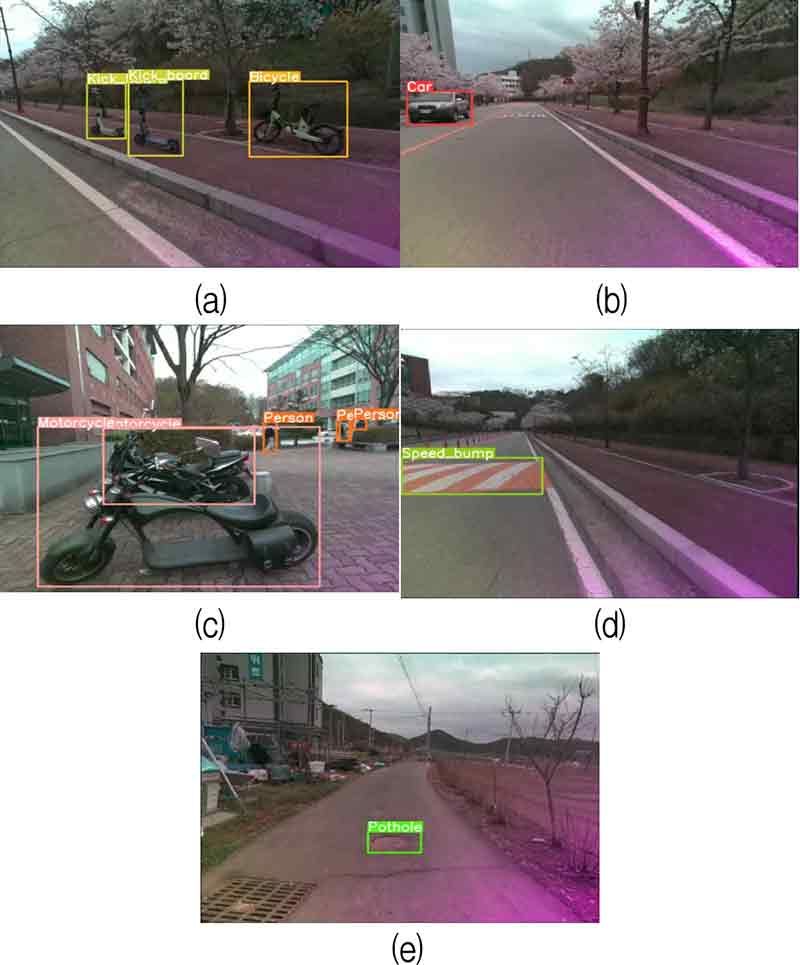

본 논문에서는 YOLO의 여러 버전 중 SOTA(State-Of-The-Art) 프레임워크 기반인 YOLOv8을 활용하였다. YOLOv8 기반 객체 탐지 기술 개발을 위해, 전동 킥보드 주행 환경에서 주요하게 관찰되는 장애물을 대상으로 총 11,747장의 이미지 데이터를 수집하였다. 수집한 이미지 데이터는 자동차, 오토바이, 사람, 자전거, 킥보드, 불량 노면(포트홀, 과속 방지턱)와 같은 7개의 클래스로 구성된다. 수집된 데이터는 학습 이미지 10,319장, 검증 이미지 1,058장, 테스트 이미지 370장으로 분리하였다. 학습된 모델을 통해 불량 노면과 장애물을 분류한 결과는 그림 6과 같다.

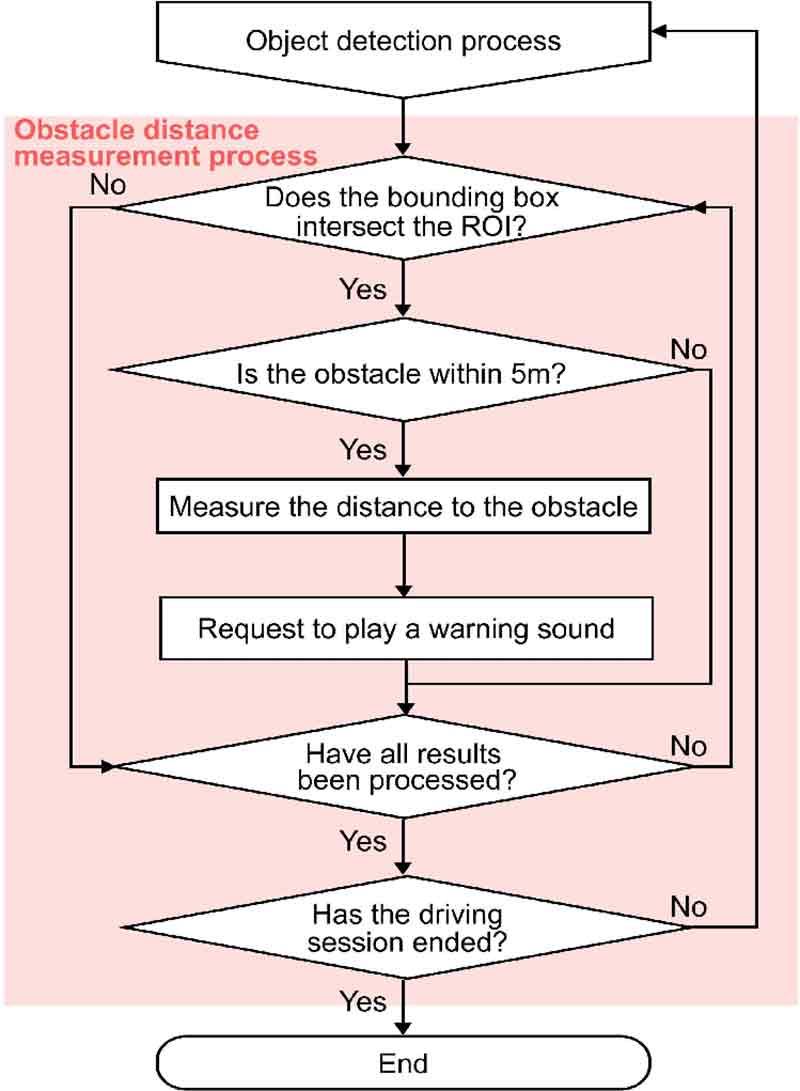

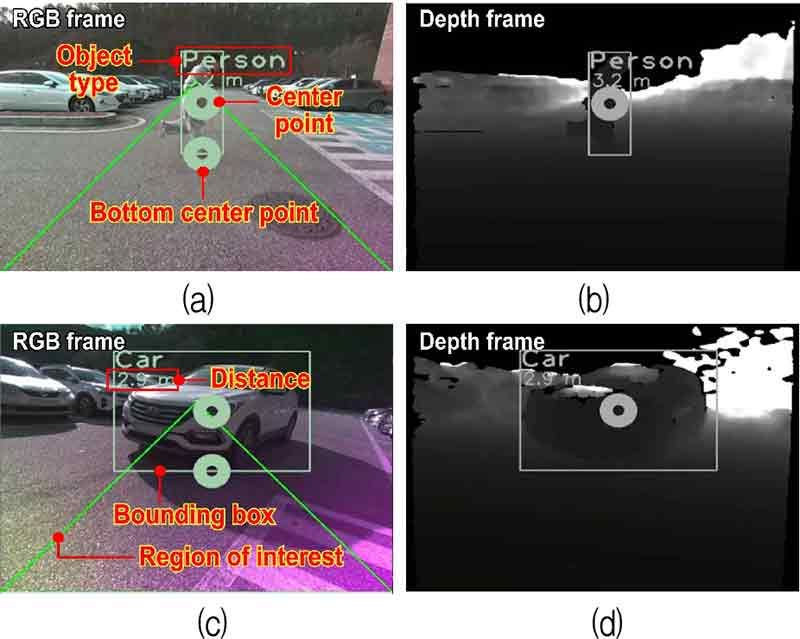

장애물 거리 측정 프로세스는 객체 탐지 프로세스를 통해 탐지된 장애물과 전동 킥보드 간의 거리를 측정한다. 그림 7은 장애물 거리 측정 프로세스의 상세 흐름을 보여준다. 전방 장애물 감지 모듈이 활성화되면, 먼저 RGB 프레임을 사용하여 객체 탐지 및 분류를 수행한다(객체 탐지 프로세스). 이 프로세스에서는 탐지된 객체의 종류와 2차원 위치 및 크기를 나타내는 경계 상자가 도출된다. 탐지된 객체가 장애물(자동차, 오토바이, 사람, 킥보드)로 분류되면, 해당 객체의 경계 상자와 관심 영역(ROI, Region of Interest)의 교차 영역을 확인한다.

관심 영역은 주행 경로 상에 존재하는 장애물만 탐지하기 위해 전방 1 m 부터 카메라 시야의 소실점까지의 영역으로 설정하였다. 만약 탐지된 장애물의 경계 상자와 관심영역 간의 교차영역이 존재한다면, 탐지된 장애물의 중심점과 전동 킥보드 간의 거리를 계산한다.

장애물과 전동 킥보드 간 거리를 계산하기 위해 깊이 카메라로 획득한 깊이 프레임을 사용한다. 깊이 프레임의 각 픽셀은 해당 위치와 카메라 간의 거리를 나타낸다. RGB 프레임과 깊이 프레임은 각각 RGB 카메라와 적외선 기반 깊이 카메라를 통해 얻어지며, 두 카메라는 물리적으로 서로 다른 위치에 설치되어 있다. 따라서, 두 프레임의 일관성을 유지하기 위해 깊이 카메라의 렌즈 정보와 센서 간 상대 위치 및 각도를 사용하여 픽셀 좌표를 동일하게 맞추는 캘리브래이션 과정을 진행한다.

탐지된 장애물이 5 m 이내에 위치할 경우, 사고 알림 모듈은 장애물과 전동 킥보드 사이의 거리에 반비례하는 크기의 경고음을 재생한다. 전동 킥보드 주행 속도에 따른 제동거리를 측정한 연구에 따르면, 20 km/h에서는 제동거리가 2.2 m, 10 km/h에서는 1.0 m이다[17]. 그러나 실제 주행 상황에서는 제동거리뿐만 아니라 공주거리나 노면상태 등 추가적으로 고려해야 할 요소들이 존재한다. 이에 따라 충분한 안전거리를 확보하기 위해 5 m 이내에 장애물이 감지되면 운전자에게 경고음을 제공하도록 설계하였다. 그림 8은 객체 탐지 프로세스와 장애물 거리 측정 프로세스가 결합된 전방 장애물 감지 모듈의 결과를 보여준다.

3.2 사고 알림 모듈

사고 알림 모듈은 S-scooter에서 사고 발생의 위험이 있거나 사고가 발생한 경우 빠른 조치를 통해 피해를 최소화하는 역할을 한다. 사고 알림 모듈은 소리 출력 프로세스, 넘어짐 감지 프로세스, 문자 전송 프로세스로 구성된다(그림 9). 소리 출력 프로세스에서는 전방 장애물 감지 모듈로부터 요청받은 경고음을 재생하거나 전도에 따른 경고음을 재생하고, 전도 감지 프로세스에서는 전동 킥보드의 전도 여부를 판단한다. 문자 전송 프로세스는 사고 시 긴급 연락처로 등록된 보호자에게 문자를 송신한다.

전도 감지 프로세스는 AHRS를 활용하여 전동 킥보드의 각도를 측정하고, Roll축(x축 회전) 각도가 60° 이상일 경우 전도가 발생한 것으로 판단한다. 이때, 전동 킥보드가 주행하는 방향을 x축으로 설정하였다. 전도가 발생하면 경고음을 출력하고 시간을 측정하기 시작한다. 만약 10초 이상 Roll축 각도가 60° 이하로 복귀하지 않을 경우, 사고가 발생한 것으로 판단하여 보호자에게 문자로 사고 정보를 전송한다.

Ⅳ. 성능 평가

4.1 객체 탐지 프로세스의 성능 평가

본 논문에서는 YOLOv8의 세 가지 모델을 비교하였다. 각 모델은 스케일의 차이에 따라 Yolov8-n(Nano), Yolov8-s(Small), Yolov8-m(Medium)로 구분된다. Yolov8-n, Yolov8-s, Yolov8-m 순으로 계산량과 파라미터 수가 증가한다.

전방 장애물 감지 모듈에서 객체 탐지 프로세스의 성능은 mAP(mean Average Precision)로 평가하였다. mAP는 객체 검출 문제에서 다양한 클래스에 대한 모델의 전반적인 성능을 측정하는 지표이다. 평가 과정에서 IoU(Intersection over Union)를 50%로 설정하여 mAP를 산출하였다.

그 결과, YOLOv8-n의 mAP50은 0.8118, YOLOv8-s은 0.8041, 그리고 YOLOv8-m은 0.8155로 나타났다. 세 모델 모두 80% 이상의 정확도를 보였으며, 모델 간 차이가 미미했다. 전방 감지 모듈에서는 실시간 객체 탐지와 운전자 알림을 위해 객체 탐지 속도가 중요하다. 따라서 계산량과 파라미터 수가 가장 적은 yolov8-n을 최종 객체 판별 모델로 선정하였다.

4.2 거리 별 측정 성능 평가

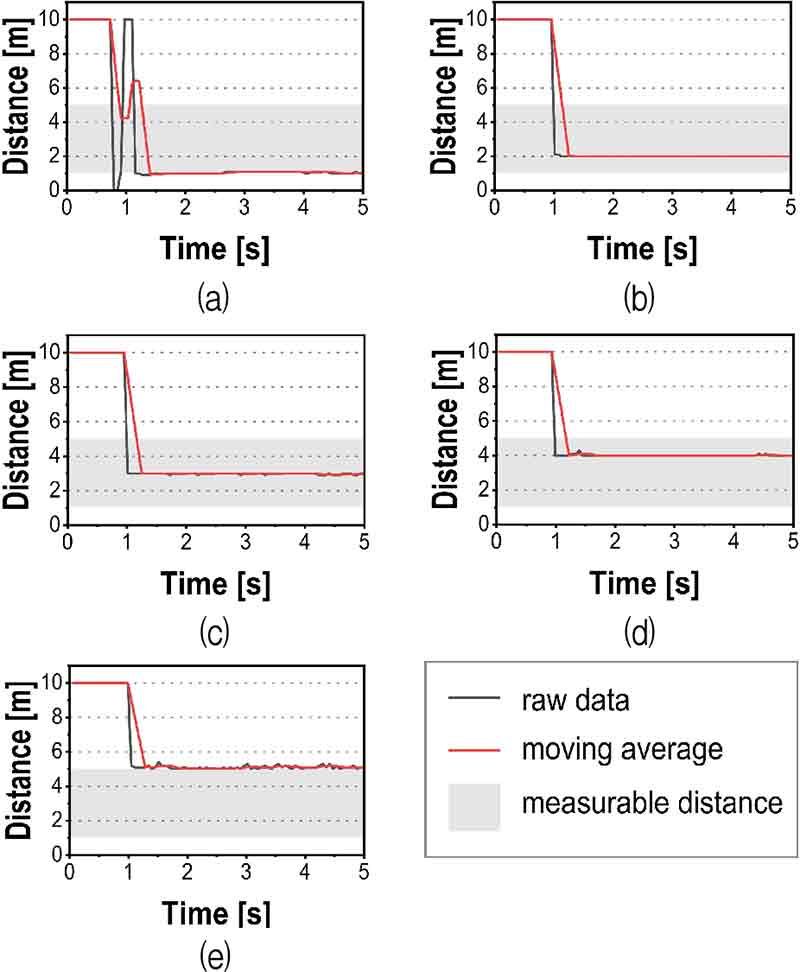

장애물 거리 측정 프로세스의 거리 측정 성능을 평가하기 위해 실험을 진행하였다. 장애물 거리 측정 프로세스 실행 직후, 장애물을 1 m, 2 m, 3 m, 4 m, 5 m 거리에 배치하였다. 그림 10은 실험 결과를 보여준다. x축은 프로세스 실행 후의 시간을 나타내며, y축은 측정된 장애물과 깊이 카메라 사이의 거리를 나타낸다. 회색 영역은 깊이 카메라가 측정 가능한 거리를 의미한다. 본 실험에서는 이동 평균 필터를 적용하여 노이즈를 제거하였다. 실험 결과, 모든 거리에서 0.5초 이내에 전방 장애물과의 거리를 정확하게 측정할 수 있음을 확인하였다. 따라서, S-scooter의 장애물 거리 측정 프로세스는 1 m에서 5 m 사이의 장애물 거리를 정확하게 측정할 수 있다고 판단하였다.

4.3 실제 거리와 측정 거리의 비교 실험

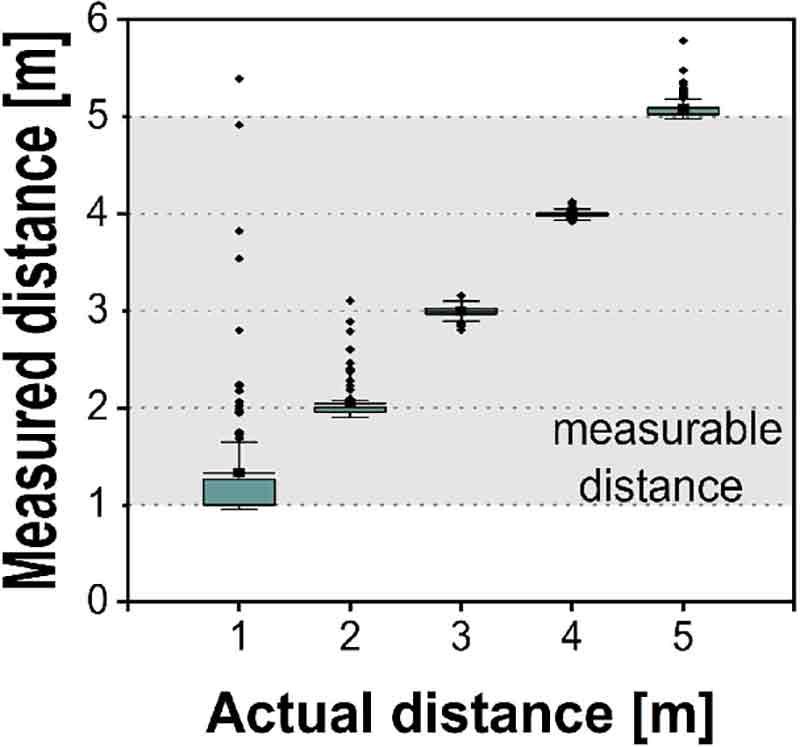

객체 검출 시 측정된 거리의 정확도를 평가하기 위한 실험을 수행하였다. 기본적인 실험 환경은 4.2절의 실험 환경과 동일하다. 프로그램을 실행시키기 전, 측정하고자 하는 거리에 장애물을 미리 배치한 뒤, 프로그램을 실행하여 5초간의 데이터를 수집하고 평균값을 도출하였다. 이 과정을 거리별로 100회 반복하여 데이터를 수집하였다. 그림 11은 수집된 평균값을 박스 플롯(Box plot)으로 시각화한 결과를 보여준다. x축은 장애물이 실제 위치한 거리를 나타내고, y축은 측정된 거리의 평균값을 의미한다.

장애물 측정 거리와 실제 거리 간 정확성을 확인하기 위해 IQR(Inter Quartile Range)을 활용하였다. IQR은 데이터를 오름차순으로 정렬했을 때 하위 25%와 상위 75% 사이의 범위를 의미한다. 본 실험에서의 IQR는 1 m에서 267 mm, 2 m에서 50 mm, 3 m에서 58 mm, 4 m에서 29 mm, 5 m에서 68 mm이다. 1 m를 제외한 모든 거리에서 IRQ가 10%를 넘지 않음을 확인할 수 있었다.

Ⅴ. 결론 및 향후 과제

본 논문에서는 안전성을 향상시킨 전동 킥보드(S-scooter)를 제안하였다. S-scooter는 Yolov8-n 모델을 활용한 전방 장애물 감지 모듈과 AHRS를 활용한 사고 알림 모듈로 구성된다. 전방 장애물 감지 모듈은 불량 노면 및 장애물을 검출하고 깊이 카메라로 거리를 측정하며, 사고 알림 모듈은 사고 발생 시 보호자에게 정보를 전송한다. 성능 평가 결과, Yolov8-n의 mAP는 0.8118로 높은 정확도를 보였고, 장애물 거리 측정 실험에서도 5 m 이내에서 평균 10% 이하의 오차를 확인하였다. 제안하는 시스템을 통해 전방 주시 태만 및 운전 미숙으로 인한 사고를 줄일 수 있을 것으로 기대된다. 향후 연구에서는 더 다양한 객체를 학습하고 충돌 방지 시스템을 추가하여 안전성을 더욱 강화할 예정이다.

Acknowledgments

이 연구는 국립금오공과대학교 대학 연구과제비로 지원되었음(2022~2024)

References

- Seoul institute, https://www.si.re.kr/node/66018, . [accessed: Dec. 12, 2024]

- Nielsen, https://www.koreanclick.com/insights/newsletter_view.html?code=topic&id=599&page=1&utm_source=board&utm_medium=board&utm_campaign=topic&utm_content=20201130, . [accessed: Dec. 07, 2024]

- KoROAD, https://www.koroad.or.kr/main/board/6/87946/board_view.do, . [accessed: Dec. 07, 2024]

- KoROAD, https://www.koroad.or.kr/main/board/6/89602/board_view.do, . [accessed: Dec. 07, 2024]

- H. J. Kim, "Safety Survey on Electric Kickboard Sharing Services", Korea Consumer Agency, pp. 1-51, Aug. 2021.

-

J. Beltrán, C. Guindel, F. M. Moreno, D. Cruzado, F. García, and A. D. L. Escalera, "BirdNet: A 3D Object Detection Framework from LiDAR Information", Proc. of 2018 21st International Conference on Intelligent Transportation Systems (ITSC), Maui, HI, USA, pp. 3517-3523, Nov. 2018.

[https://doi.org/10.1109/ITSC.2018.8569311]

-

A. Manjunath, Y. Liu, B. Henriques, and A. Engstle, "Radar Based Object Detection and Tracking for Autonomous Driving", Proc. of 2018 IEEE MTT-S International Conference on Microwaves for Intelligent Mobility (ICMIM), Munich, Germany, pp. 1-4, Apr. 2018.

[https://doi.org/10.1109/ICMIM.2018.8443497]

-

Rahul and B. B. Nair, "Camera-Based Object Detection, Identification and Distance Estimation", Proceedings of 2018 2nd International Conference on Micro-Electronics and Telecommunication Engineering (ICMETE), Ghaziabad, India, pp. 203-205, Sep. 2018.

[https://doi.org/10.1109/ICMETE.2018.00052]

-

J. Kim and J. Cho, "YOLO-based Real-Time Object Detection Scheme Combining RGB Image with LiDAR Point Cloud", Journal of KIIT, Vol. 17, No. 8, pp. 93-105, Aug. 2019.

[https://doi.org/10.14801/jkiit.2019.17.8.93]

-

S.-Y. Cho and J.-J. Kim, "Development of a Multi-disciplinary Video Identification System for Autonomous Driving", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 24, No. 1, pp. 65-74, Feb. 2024.

[https://doi.org/10.7236/JIIBC.2024.24.1.65]

-

B.-C. Yoo and S.-J. Shin, "Proposal for Research Model of High-Function Patrol Robot using Integrated Sensor System", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 24, No. 3, pp. 77-85, Jun. 2024.

[https://doi.org/10.7236/JIIBC.2024.24.3.77]

-

S. Sugimoto, H. Tateda, H. Takahashi, and M. Okutomi, "Obstacle detection using millimeter-wave radar and its visualization on image sequence", Proc. of the 17th International Conference on Pattern Recognition (ICPR), Cambridge, UK, pp. 342-345, Aug. 2004.

[https://doi.org/10.1109/ICPR.2004.1334537]

- lidarradar.com, https://lidarradar.com/info/pros-and-cons-of-lidar, . [accessed: Dec. 07, 2024]

- A. Li, "Finding a safety feature algorithm for electric-scooter by detecting the closest obstacles", Sheridan College, pp. 1-58, Dec. 2020.

-

E.-J. Jung, K. W. Jeon, J. Kim, J. Lee, M.-G. Kim, and H.-J. Cha, "Development of a Personal Mobility Scooter with Autonomous Driving and Safety Features", Journal of Institute of Control, Robotics and Systems, Vol. 29, No. 5, pp. 404-411, May 2023.

[https://doi.org/10.5302/J.ICROS.2023.23.0033]

- J. Kim, J. Cho, S. Kim, J. Lee, J. Lee, H. Choi, J. Choi, and N. Kim, "A Proposal for Shared Electric Scooter Application Service Structure with Fall Detection Procedures", Proc. of KIIT Conference, Jeju, Korea, pp. 1019-1023, Jun. 2023.

- H. C. Shin, J. Y. Lee, and S. R. Kim, "Study on the Improvement of Laws and Regulations for Personal Mobilities", Korea Transport Institute, pp. 1-115, Nov. 2016.

2024년 8월 : 국립금오공과대학교 컴퓨터공학과(공학사)

2024년 9월 ~ 현재 : 국립금오공과대학교 컴퓨터·AI융합공학과 석사과정

관심분야 : 햅틱스, 임베디드시스템

2024년 2월 : 국립금오공과대학교 컴퓨터공학과(공학사)

2024년 3월 ~ 현재 : 국립금오공과대학교 컴퓨터·AI융합공학과 석사과정

관심분야 : 임베디드시스템, 사물인터넷, 소프트로보틱스

2019년 3월 ~ 현재 : 국립금오공과대학교 컴퓨터공학과 학사과정

관심분야 : 인공지능, 머신러닝, 딥러닝, 컴퓨터비전

2013년 2월 : 한국기술교육대학교 컴퓨터공학부(공학사)

2015년 2월 : 한국기술교육대학교 컴퓨터공학과(공학석사)

2020년 8월 : 한국기술교육대학교 ICT융합전공(공학박사)

2020년 9월 ~ 2022년 2월 : 세명대학교 컴퓨터공학과 조교수

2022년 3월 ~ 현재 : 국립금오공과대학교 컴퓨터공학과 조교수

관심분야 : 몰입형 VR/AR, 햅틱스, 3D 터치 센서