시각장애인의 안전한 보행을 위한 2D LiDAR-단안 카메라 기반 거리 측정 및 장애물 회피 시스템

초록

시각장애인의 안전하고 독립적인 보행을 보장하는 것은 시각장애인의 기본권 보장을 위한 중추적인 역할을 제공하는 것이다. 본 논문에서는 시각장애인의 안전한 독립 보행을 위해 Sensor Fusion AEB 시스템을 제안한다. 이 시스템은 2D LiDAR와 단안 카메라 캘리브레이션을 통해 카메라 이미지에서 거리 정보를 측정한다. 이를 통해 시각장애인이 원하는 목적지로 이동하는 동안 장애물을 인식하는 경우 거리 정보를 통해 위험에서 벗어날 수 있다. 본 시스템의 정확도와 안전성을 검증하기 위해 클러스터링 및 캘리브레이션 그리고 거리 측정 정확도 실험을 진행하였으며 자율주행 도중 장애물 충돌 여부를 검증하였다. 실험 결과 캘리브레이션 결과는 재투영 오차 4.86 픽셀 오차를 보여주었으며 자율주행을 통한 보행 도중 장애물에 부딪히지 않고 안전하게 보행할 수 있었다. 이를 통해 제안하는 시스템이 시각장애인의 안전한 보행을 지원할 수 있음을 입증하였다.

Abstract

Ensuring safe and independent mobility for visually impaired individuals is essential for safeguarding their fundamental rights. This paper proposes a Sensor Fusion Autonomous Emergency Braking(AEB) system to achieve this goal. By calibrating a 2D LiDAR and a monocular camera, the system measures distance information from camera images, enabling obstacle detection and avoidance during navigation. Experiments were conducted to validate the system's accuracy and safety, including clustering, calibration, and distance measurement, as well as obstacle collision tests during autonomous navigation. Calibration results showed a reprojection error of 4.86 pixels, and the system ensured safe navigation without collisions. These findings confirm that the proposed system effectively supports safe and independent mobility for visually impaired individuals.

Keywords:

2D LiDAR-camera calibration, obstacle avoidance, emergency braking, 2D LiDAR, visually impaired peopleⅠ. 서 론

국내의 시각장애인 수는 2023년 등록장애인 기준으로 9.4%의 비중을 차지하고 있으며, 2014년부터 꾸준히 약 25만 명 정도를 유지해 왔다. 시각장애인의 안전하고 독립적인 보행을 보장하는 것은 사회자립을 보장하기 위한 중추적인 역할을 수행하는 것이며 시각장애인을 위한 보행 보조 기술의 연구도 활발히 진행되고 있다[1][2]. 특히 자율주행 기술은 자동차, 로봇, 드론 등에 활용되어 인공지능 기술의 핵심 연구 주제로 주목받고 있으며 시각장애인을 위한 보조 기술에도 접목되어 첨단 보조 기술 연구에 새로운 전환점을 제공하고 있다[3].

시각장애인을 보조하는 로봇은 시스템의 정확도와 안전성에 따라 사용자의 안전에 직접적인 영향을 미치게 되므로 단일 센서보다는 두 개 이상의 센서로 데이터를 통합하는 센서 융합 방식으로 처리하는 것이 중요하다[4]. 특히, 자동긴급제동장치(AEB, Autonomous Emergency Braking) 기능은 앞의 상황을 인지할 수 없는 시각장애인을 대신하여 장애물을 식별하고 충돌을 방지하기 위해 자동으로 정지하는 필수적인 기능이다. 일반적으로 장애물 식별을 위해 카메라 센서를 사용하지만, 단안 카메라의 경우 거리 정보가 소실되는 한계가 있으며 이를 극복하기 위해 딥러닝을 활용한 상대 거리 추정 모델을 사용하기도 한다[5]. 그러나 거리 정보가 존재하는 참조 물체가 없으면 절대적인 거리를 알 수 없는 한계가 존재한다. 이러한 기능은 정확성 및 안전성 측면에서 높은 성능을 요구하므로 실제 거리를 측정하기 위해 카메라와 LiDAR 센서를 정확하게 융합하는 방법이 필요하다[6].

본 논문에서는 시각장애인의 안전한 보행을 위해 장애물과의 거리를 측정하고 자동으로 주행을 정지하는 Sensor Fusion AEB 시스템을 제안한다. 제안하는 시스템은 2D LiDAR와 단안 카메라의 좌표계를 통합하는 복잡한 과정을 간편하게 수행할 수 있도록 지원하며 정확한 캘리브레이션을 가능하게 한다. 또한, 센서 융합 결과를 통해 장애물의 검출 및 거리 정보를 ROS2 토픽으로 전달하여 자율주행 도중 장애물이 식별되면 주행을 자동으로 정지하는 것이 최종 목표이다. 이를 통해 시각장애인은 장애물 식별 정보와 함께 거리 정보를 인지함으로써 안전한 독립 보행을 추구할 수 있으며, 단안 카메라와 2D LiDAR 센서 융합을 통해 보행 보조 로봇 이외의 분야에서도 정확한 임무 수행이 가능할 것으로 기대한다.

Ⅱ. 관련 연구

2.1 2D LiDAR-카메라 캘리브레이션 연구

2D LiDAR 센서는 단축에서 데이터를 획득하며 주변 환경의 깊이 정보를 파악할 수 있는 센서이다. P. An et al.[7]은 LiDAR와 카메라 센서를 캘리브레이션 하기 위해 데이터 처리 방식을 기준으로 명시적 대응 기반과 암묵적 대응 기반으로 분류하였다. 명시적 대응 기반은 캘리브레이션 대상 데이터를 매칭 쌍으로 직접 지정하여 위치 관계를 파악하며 PnP(Perspective-n-Point) 알고리즘으로 LiDAR의 3D 좌표계를 카메라의 2D로 추정하는 방법을 이용한다. 주로 캘리브레이션 마커를 사용하여 높은 정확도를 보여준다. 암묵적 대응 기반은 명확한 대응점을 사용하지 않고, 각 센서 데이터 간의 유사성을 학습하여 대응점을 예측하는 방법을 사용한다. 암묵적 대응 기반은 학습 데이터의 품질에 의존적이나 실시간으로 자동화된 캘리브레이션이 가능하다. 그러나 사용자의 안전이 시스템 정확도에 크게 의존하는 자율주행 분야에서는 명시적 대응 기반의 캘리브레이션이 중요하며 개방적이고 복잡한 환경에서 한계를 극복하는 연구가 필요하다.

2.2 주행 및 회피에 관한 자율주행 연구

시각장애인을 안내하는 로봇이 장애물을 안전하게 회피하며 주행하기 위해서는 장애물을 인식하고 회피하는 알고리즘이 필수적이다. 이러한 방법에는 LiDAR 스캔 값을 벽으로 간주하고 거리에 따라 조향을 결정하는 Wall Follow[8]와 포인트 클라우드 사이의 가장 넓은 Gap을 향해 주행하는 FGM(Follow the Gap Method)[9] 등이 연구되었다. 이러한 주행 방법은 주변 환경에 대한 지도가 필요하지 않으나 경로가 명확하지 않고 최악의 상황에서는 의도하지 않은 방향으로 안내할 수 있다는 한계가 있다. 정확한 경로를 바탕으로 목적지로 이동하는 방법에는 사전에 정의된 지도를 통해 경로 계획을 수행하고 Lookahead를 생성하여 이동하는 Pure Pursuit[10]이 있다. 그러나 이러한 알고리즘을 직접적으로 적용하기에는 한계가 있으며, 본 연구에서는 이러한 자율주행 알고리즘을 바탕으로 제안하는 시스템을 적용하여 시각장애인이 안전하게 보행 가능한지 실험을 통해 검증하였다.

Ⅲ. 2D LiDAR와 카메라 캘리브레이션을 활용한 Sensor Fusion AEB 시스템

3.1 제안하는 시스템

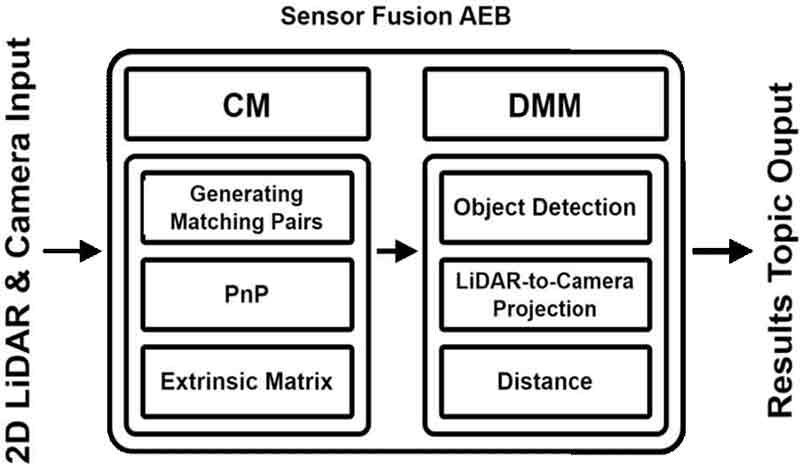

본 논문에서 제안하는 Sensor Fusion AEB 시스템은 그림 1과 같이 2D LiDAR와 카메라를 캘리브레이션 하는 CM(Calibration Module)과 캘리브레이션 결과를 통해 장애물과의 거리를 측정하는 DMM(Distance Measurement Module)로 구성된다.

Sensor Fusion AEB 시스템은 타 시스템과의 호환성을 고려하여 ROS2 기반으로 설계하였으며 센서의 입력을 통해 캘리브레이션을 진행하고 장애물 검출 결과와 거리를 토픽 단위로 전달한다. 이를 통해 장애물과의 거리를 계산하여 시각장애인이 안전하게 보행할 수 있도록 지원한다.

3.2 캘리브레이션 및 거리 측정 방법

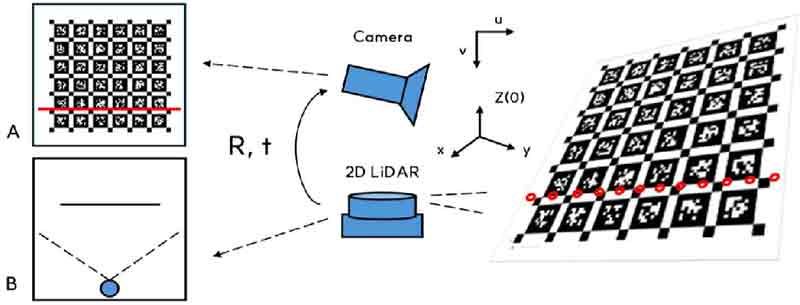

Sensor Fusion AEB 시스템의 핵심 모듈인 CM은 높은 정확도 확보를 위해 명시적 대응 기반 방법으로 구현한다[7]. 이 방법에는 특정한 캘리브레이션 마커가 활용되는데 본 연구에서는 AprilTag를 사용한다. AprilTag는 그림 2와 같은 흑백 패턴으로 구성된 마커로, 각 마커에서 고유한 ID를 검출할 수 있는 특징을 가진다.

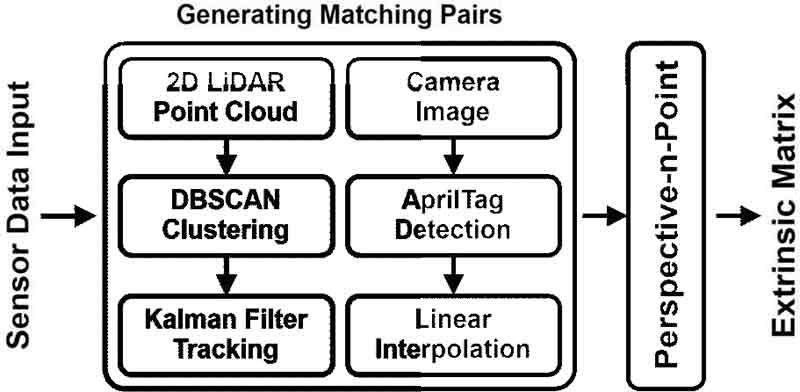

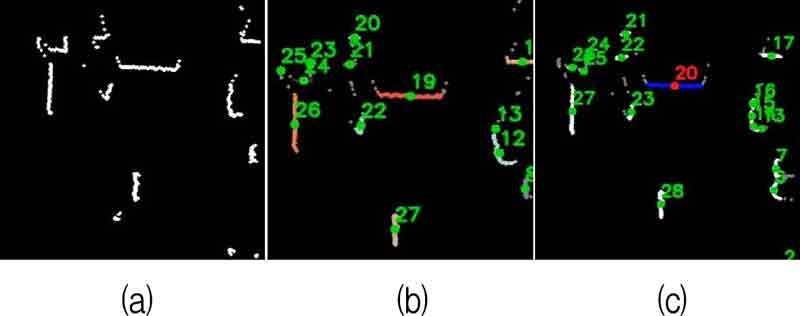

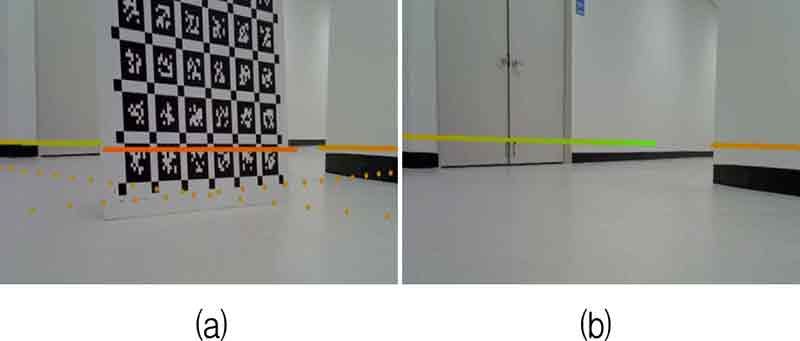

CM에서 2D LiDAR와 카메라를 캘리브레이션 하는 과정은 그림 3의 구조도와 같이 나타낼 수 있다. 먼저, 각 센서의 데이터를 동기화하는 작업을 수행한다. 이후 2D LiDAR 데이터는 그림 4의 (a)과 같이 거리 정보만 존재하며 어디까지 하나의 객체로 구성되어 있는지 판별할 수 없다. 따라서 그림 4의 (b)와 같이 클러스터링 알고리즘으로 LiDAR의 거리 데이터를 객체 단위로 나누는 작업이 필요하다.

Visualization of 2D LiDAR calibration process(a) LiDAR scan data (b) Clustering process (c) Kalman Filter tracking process

클러스터링된 데이터는 미세한 환경 변화에도 클러스터 ID가 변경될 수 있으며, 이는 캘리브레이션 결과의 정확도에 부정적인 영향을 미칠 수 있다. 따라서 본 연구에서는 칼만 필터를 통해 클러스터 중심 좌표를 추적하여 그림 4의 (c)과 같이 매칭하고자 하는 객체의 특징점 좌표를 획득할 수 있게 하였다.

이러한 접근 방식은 명시적 대응 기반 방법의 한계점이었던 주변 환경에 의존적이고 복잡한 매칭 점 생성 과정을 개선하여 효율적이고 신속하게 수행할 수 있다.

카메라 센서 데이터의 경우 AprilTag를 활용하여 특징점을 생성한다. AprilTag의 특징점을 2D LiDAR와 정확하게 매칭하기 위해 검출되는 마커의 양 끝점으로 직선을 형성하고, 해당 직선에 포함되도록 테두리에 추가 좌표를 생성한다. 이 점들을 다시 직선으로 연결할 때 선형 보간을 이용하여 내부에 LiDAR와 매칭하기 위한 특징점을 생성한다.

각 센서를 캘리브레이션 하기 위한 충분한 매칭 쌍이 확보되면 이후에는 PnP 알고리즘으로 정렬을 수행한다. 여기서 PnP 알고리즘은 식 (1)과 같이 표현할 수 있으며, Levenberg-Marquardt 최적화 알고리즘에 기반하여 3D-2D 점 간의 대응 관계를 재투영 오차로 최소화한다[11]. 식 (1)에서 pi는 이미지의 2D 점을 의미하고 Pi는 LiDAR의 3D 점을 의미한다. 본 연구에서는 2D LiDAR를 사용하므로 Z축은 0으로 고정한다. 또한 K는 카메라 내부 행렬을 R은 회전 행렬, t는 변환 벡터를 의미한다.

| (1) |

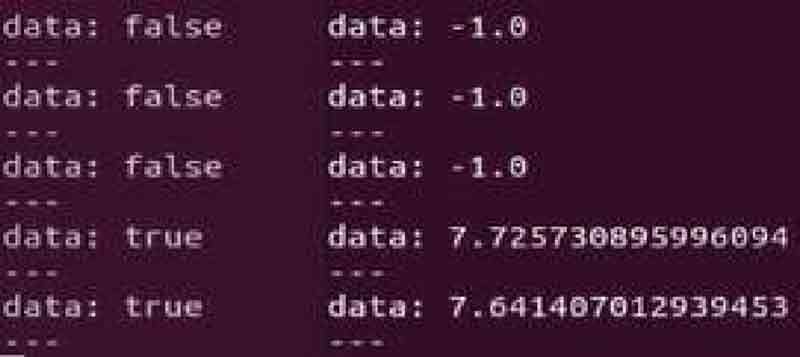

그러나 이를 통해 투영된 캘리브레이션 결과는 그림 5의 (a)과 같이 의도하지 않은 위치에 투영되는 노이즈가 발생한다. 이를 X 좌표와 Y 좌표 기준으로 히스토그램으로 시각화하면 그림 5와 같다. 히스토그램 분석 결과, 특정 구간에 포인트가 집중되어 있는 것을 확인할 수 있다. 따라서 일정 빈도 이하의 포인트를 제거함으로써 노이즈를 효과적으로 제거할 수 있으며, 그 결과는 그림 5의 (b)와 같다. 이러한 처리를 통해 단안 카메라와 2D LiDAR를 결합하여 신뢰성 있는 거리 측정이 가능해지며, DMM을 통해 이미지에서 장애물이 감지되면 거리를 측정하고 그림 6과 같이 결과를 토픽으로 발행한다.

2D LiDAR point image projection result(a) Result of the presence of noise(b) Result of the removal of noise

Ⅳ. 실험 및 결과

본 연구에서는 시각장애인 보조 장치로 사용하기 위해 그림 7과 같이 2D LiDAR와 단안 카메라 센서가 부착된 NVIDIA Jetson Xavier 기반 F1-Tenth 자율주행 대회 규격의 로봇 자동차를 활용하였다.

이를 바탕으로 본 논문에서 제안하는 시스템이 시각장애인 보행 보조 목적으로 사용하기에 적합한지 검증하기 위해 시스템의 모듈별로 성능 평가를 진행하였다.

4.1 2D LiDAR 포인트 클라우드 클러스터링

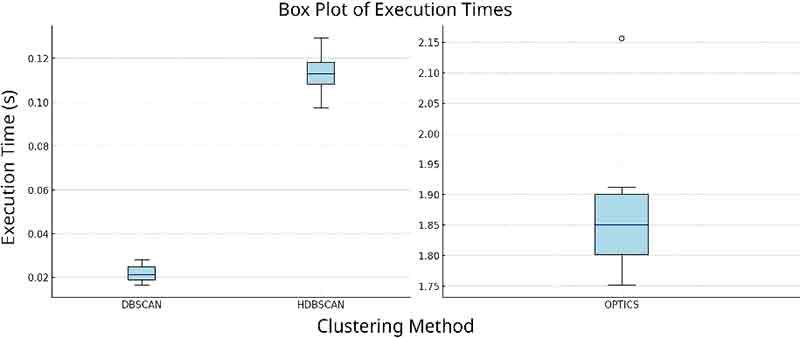

먼저 2D LiDAR의 포인트 클라우드에서 식별 가능한 객체 단위로 분할하기 위해 밀도 기반의 클러스터링 알고리즘 3가지를 비교 분석하였다. 자율주행 시스템에서는 알고리즘의 수행 품질뿐만 아니라 처리 시간 또한 중요한 요소이다. 따라서 클러스터링의 처리 시간과 품질을 종합적으로 검증하였으며 처리 시간 평가에서는 클러스터링을 한 번 수행하는 데 소요되는 시간을 측정하였다.

품질 평가에서는 군집 내의 데이터 응집도와 군집 간의 분리도를 측정하여 각 데이터 포인트가 클러스터에 적절하게 할당되었는지 평가하기 위해 Silhouette Score와 DBI(Davies-Bouldin Index)를 활용하였으며, 식 (2)의 Silhouette Score는 높을수록, 식 (3)의 DBI는 낮을수록 높은 품질을 나타낸다. 여기서 식 (2)의 a(i)와 b(i)는 각각 데이터 포인트 i와 같은 클러스터 내 다른 데이터 포인트 간의 평균 거리(응집도), 데이터 포인트 i와 가장 가까운 다른 클러스터 내 데이터 포인트 간의 평균 거리(분리도)를 의미한다. 또한, 식 (3)의 k는 클러스터 개수를 의미하며, Si와 Sj는 각각 클러스터 i와 j의 내부 데이터 포인트가 각 클러스터 중심으로부터 얼마나 퍼져있는지를 나타내며 응집도를 의미한다.

| (2) |

| (3) |

또한, 클러스터링 품질 평가를 위해 CHI(Calinski-Harabasz Index)를 활용하였으며 수치가 높을수록 분산이 적고 분리도가 높아 클러스터링 품질이 좋다는 것을 의미한다. 여기서 CHI는 식 (4)로 표현할 수 있으며 N은 식 (2)와 마찬가지로 전체 데이터 포인트 개수를 의미한다. 그리고 Tr(Bk)는 클러스터 간의 분리도를 의미하며 Tr(Wk)는 클러스터 내 응집도를 의미한다. 또한, Noise Ratio는 노이즈로 판별된 데이터의 비율을 나타내며 낮을수록 노이즈 제거 성능이 높다고 평가할 수 있다.

| (4) |

표 1과 그림 8 평균 수행 시간을 분석하면 DBSCAN이 HDBSCAN보다 약 5.2배 빠르며 OPTICS보다 86.1배 빠른 성능을 보여주었다. 마찬가지로 표 2에서도 DBSCAN의 Silhouette Score를 비롯한 평가 지표들이 다른 알고리즘들과 비교하여 더 나은 성능을 나타내었으며, 이러한 결과를 바탕으로 본 연구에서는 DBSCAN 클러스터링 방법을 채택하였다.

4.2 캘리브레이션 결과 정확도 검증

제안하는 시스템을 통해 카메라와 LiDAR의 매칭 쌍을 생성하고 PnP 알고리즘으로 캘리브레이션을 수행하였을 때의 투영 결과는 그림 5의 (b)와 같이 확인되었다. 본 시스템의 캘리브레이션 정확도는 거리 측정 시스템 전반에 영향을 미치므로 투영된 포인트 클라우드를 LiDAR 좌표계로 재투영하였을 때의 오차를 측정하는 재투영 오차 방식으로 평가를 진행하였다. 재투영 오차는 식 (5)로 표현될 수 있다.

| (5) |

각 센서의 매칭 쌍 좌표는 모두 픽셀 단위로 생성되었으므로 표 3의 결과 값은 픽셀 단위로 측정되었다. 재투영 오차는 낮을수록 캘리브레이션이 정확하게 수행되었음을 의미하며 제안하는 시스템의 캘리브레이션 성능을 평가하기 위해 사람이 직접 일치하는 특징점 좌표를 지정하는 방법과 비교 실험을 진행하였다. 총 10번의 실험 결과 제안하는 시스템의 경우 평균 6.443 픽셀 재투영 오차를 보여주었으며 직접 캘리브레이션을 지정하는 방법보다 평균 약 10.43% 개선되었음을 확인할 수 있었다.

4.3 장애물 거리 측정 및 보행 안전성 평가

2D LiDAR와 카메라 캘리브레이션을 수행하고 LiDAR의 포인트 클라우드를 이미지에 투영하게 되면 이미지 상에서 거리 측정이 가능해진다. 본 시스템의 장애물 감지 및 거리 측정 성능을 평가하기 위해 OpenCV의 HOG(Histogram of Oriented Gradients) 기반 보행자 감지기를 활용하였다. HOG 감지기는 사전 학습된 형태로 제공되며, 본 실험에서는 장애물을 보행자로 가정하여 실험을 진행하였다.

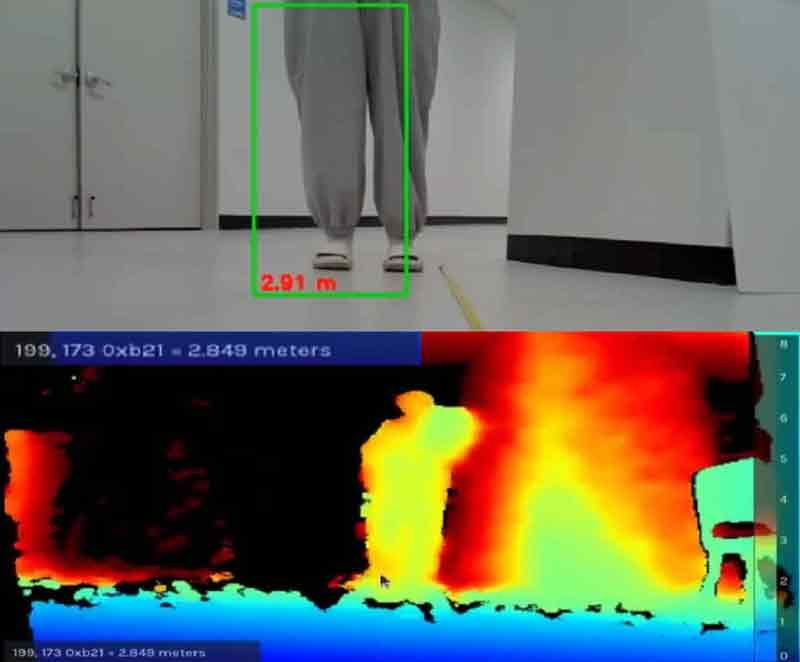

그림 9과 같이 이미지에서 장애물이 감지되면 해당 영역 내부에 존재하는 포인트 클라우드의 거리 값을 평균하여 거리를 산출하며, 그림 6과 같이 장애물이 감지될 경우 감지 상태는 True로 발행되고 측정된 거리 또한 소수점 단위로 발행된다.

본 연구에서는 측정된 거리의 정확도를 검증하기 위해 Intel RealSense D435i 카메라와의 비교 실험을 수행하였다. 동일한 위치에서 제안하는 시스템은 2.91m로 측정되었고 D435i는 2.84m로 측정되었다. 측정 결과는 0.07m 정도의 오차가 발생하였는데 나타난 오차는 제안하는 시스템이 바운딩 박스 내부의 모든 거리값을 평균하는 방식을 사용하는 반면, D435i는 특정 지점의 거리를 측정하는 방식의 차이에서 기인한 것으로 분석된다. 그러나 D435i의 공식 최소-최대 오차범위인 0.3m 내외의 오차 범위 내로 측정되었으며 이러한 결과는 시각장애인 보행 보조 시스템으로서 적합하다는 것을 보여주었다.

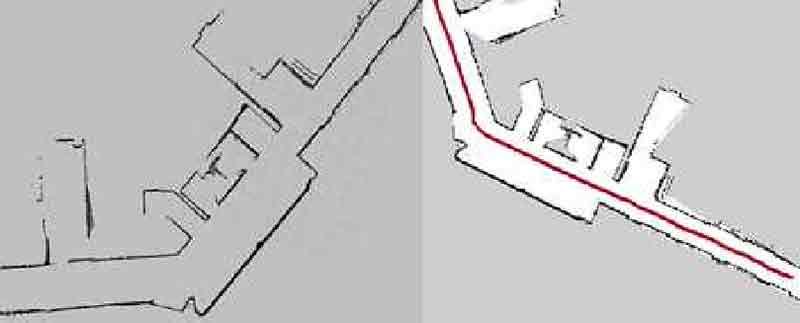

또한 제안하는 시스템의 실제 적용 가능성을 검증하기 위해, 이를 자율주행 알고리즘에 통합하고 사용자가 시각을 차단한 상태에서 시각장애인을 가정하여 목적지까지의 이동 실험을 수행하였다. 특히 장애물 회피 성능을 검증하기 위해 Wall Follow, FGM, Pure Pursuit 알고리즘을 대상으로 평가를 진행하였다. Pure Pursuit 알고리즘의 경우 경로 계획이 필요하므로 그림 10과 같이 SLAM ToolBox를 활용하여 실험 환경의 정적 지도를 생성하고 시작점에서 목적지까지의 약 30m의 이동 경로를 설정하였다.

그리고 주행 중 5m 이내에서 장애물이 감지되면 장애물이 사라질 때까지 주행을 일시 정지하고 TTS로 장애물의 존재를 알려주도록 하였으며, 주행 경로상에 장애물이 교차하도록 실험 환경을 구성하였다.

실험 결과, 표 4와 같이 제안하는 시스템이 적용된 알고리즘은 모두 장애물과 충돌 없이 안전하게 보행할 수 있음을 확인하였다. 다만 보행 시간이 다소 증가하는 것으로 나타났는데, 이는 장애물 감지 시 주행을 일시 정지하는 시간이 추가되었기 때문이다. 시각장애인의 보행에서는 이동 시간보다 안전성이 더욱 중요한 요소이므로 제안하는 시스템이 장애물과의 충돌 없이 안전한 보행을 지원할 수 있음을 실험을 통해 입증하였다.

Ⅴ. 결론 및 향후 과제

본 논문에서는 2D LiDAR와 카메라 센서를 융합하여 시각장애인의 안전한 보행을 지원하는 Sensor Fusion AEB 시스템을 제안하였다. 본 시스템은 외부 행렬을 추정하는 캘리브레이션 과정에 매칭 쌍을 생성하기 위해 칼만 필터 기반 추적을 도입하고 투영 과정에서 발생하는 노이즈를 히스토그램 분석을 통해 효과적으로 제거하여 최소 4.862 픽셀, 평균 6.443 픽셀, 최대 7.561 픽셀의 재투영 오차로 사람이 직접 특징점 좌표를 지정하는 방법보다 평균 약 10.43% 향상된 결과로 이종 센서 간의 복잡한 캘리브레이션을 효율적으로 수행할 수 있었다. 아울러 장애물 검출 및 거리 정보를 ROS2 토픽으로 전달하여 자율주행 알고리즘과의 통합이 용이하도록 설계하였으며, 실제 보행 실험을 통해 장애물 충돌 없이 안전한 보행이 가능함을 검증하였다.

본 연구에서는 장애물과의 충돌을 회피하기 위해 AEB 방식으로 장애물을 회피하였으나 실험 과정에서 시각장애인의 장애물 반응시간과 시스템 수행 시간과 관련된 실험이 부족하였다고 사료된다. 따라서 향후 연구에서는 이를 보완하여 장애물 반응 및 기능 수행 시간 개선 그리고 실시간 캘리브레이션 기능 구현과 더불어 다양한 환경에서의 안전성 검증을 추가로 수행할 계획이다. 이를 통해 시각장애인의 보행 지원은 물론, 다양한 자율주행 및 로봇 응용 분야에서의 활용이 기대된다.

Acknowledgments

본 논문은 2022년도 정부(교육부)의 제원으로 한국연구재단의 지원을 받아 수행된 기초연구사업(NRF-2021R1G1A1006381)과 교육부와 한국연구재단의 재원으로 지원을 받아 수행된 3단계 산학연협력 선도대학 육성사업(LINC 3.0)의 연구결과임

References

-

S. Min and Y. Oh, "Survey on Obstacle Detection Features of Smart Technologies to Help Visually Impaired People Walk", Journal of the Korea Industrial Information Systems Research, Vol. 25, No. 3, pp. 31-38, Jun. 2020.

[https://doi.org/10.9723/jksiis.2020.25.3.031]

-

J. Lee, K. S. Kim, B. Min, D. Kim, M. Park, G. Hwang, Y. T. Kim, and J. Nam, "Deep Learning Wearable Device using IoT-associated Voice Recognition for the Visually Impaired", The Journal of Korean Institute of Information Technology, Vol. 21, No. 4, pp. 57-65, Apr. 2023.

[https://doi.org/10.14801/jkiit.2023.21.4.57]

-

A.-H. Kim, G.-C. Kang, S.-B. Park, J.-H. Goo, S.-H. Kim, S. C. Lee, and J.-W. Kim, "Development of Indoor Guide Robot based on RF Sensor for the Visually Impaired", Journal of Korean Institute of Intelligent Systems, Vol. 33, No. 3, pp. 189-196, Jun. 2023.

[https://doi.org/10.5391/JKIIS.2023.33.3.189]

-

Z. Wei, F. Zhang, S. Chang, Y. Liu, H. Wu, and Z. Feng, "MmWave radar and vision fusion for object detection in autonomous driving: A review", Sensors, Vol. 22, No. 7, pp. 2542, Mar. 2022.

[https://doi.org/10.3390/s22072542]

-

R. Ranftl, K. Lasinger, D. Hafner, K. Schindler, and V. Koltun, "Towards robust monocular depth estimation: Mixing datasets for zero-shot cross-dataset transfer", IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 44, No. 3, pp. 1623-1637, Mar. 2020.

[https://doi.org/10.1109/TPAMI.2020.3019967]

-

Z. Wang, G. Yu, X. Wu, H. Li, and D. Li, "A camera and LiDAR data fusion method for railway object detection", IEEE Sensors Journal, Vol. 21, No. 12, pp. 13442-13454, Jun. 2021.

[https://doi.org/10.1109/JSEN.2021.3066714]

-

P. An, J. Ding, S. Quan, J. Yang, Y. Yang, Q. Liu, and J. Ma, "Survey of Extrinsic Calibration on LiDAR-Camera System for Intelligent Vehicle: Challenges, Approaches, and Trends", IEEE Transactions on Intelligent Transportation Systems, pp. 15342-15366, Jul. 2024.

[https://doi.org/10.1109/TITS.2024.3419758]

-

X. Wei, E. Dong, C. Liu, G. Han, and J. Yang, "A wall-following algorithm based on dynamic virtual walls for mobile robots navigation", 2017 IEEE International Conference on Real-time Computing and Robotics (RCAR), Okinawa, Japan, pp. 46-51, Jul. 2017.

[https://doi.org/10.1109/RCAR.2017.8311834]

-

V. Sezer and M. Gokasan, "A novel obstacle avoidance algorithm: ‘Follow the Gap Method’", Robotics and Autonomous Systems, Vol. 60, No. 9, pp. 1123-1134, Sep. 2012.

[https://doi.org/10.1016/j.robot.2012.05.021]

-

V. Sukhil and M. Behl, "Adaptive lookahead pure-pursuit for autonomous racing", arXiv preprint, arXiv:2111.08873, , Nov. 2021.

[https://doi.org/10.48550/arXiv.2111.08873]

-

Y. Zheng, Y. Kuang, S. Sugimoto, K. Astrom, and M. Okutomi, "Revisiting the pnp problem: A fast, general and optimal solution", IEEE International Conference on Computer Vision (ICCV), Sydney, NSW, Australia, pp. 2344-2351, Dec. 2013.

[https://doi.org/10.1109/ICCV.2013.291]

2019년 3월 ~ 현재 : 경상국립대학교 컴퓨터공학부 학사과정

관심분야 : 인공지능, 컴퓨터 비전, 이미지 생성, 온디바이스 AI

2019년 3월 ~ 현재 : 경상국립대학교 컴퓨터공학부 학사과정

관심분야 : 인공지능, 데이터분석, 컴퓨터 비전, 디지털 헬스케어

2006년 12월 : 호주뉴캐슬대학교 컴퓨터공학과(공학사)

2007년 9월 : 호주뉴캐슬대학교 정보공학과(공학석사)

2017년 8월 : 한양대학교 컴퓨터공학과(공학박사)

2021년 9월 ~ 현재 : 경상국립대학교 컴퓨터공학과 조교수

관심분야 : 인공지능, 시멘틱 헬스케어, 데이터마이닝