스펙트로그램 이미지를 활용한 딥러닝 기반의 레이더 신호 탐지 모델 연구

초록

미국의 상업용 민간 광대역 서비스인 CBRS(Citizens Broadband Radio Service)는 연방 기관과 주파수 대역을 공유하여 군사용 장비에 유해한 간섭을 일으킨다. 최근에는 이를 극복하기 위해 인공지능 탐지 방법이 제안되었지만, 민감한 정보를 다루는 군사용 데이터를 구하는데 한계가 있다. 따라서, 본 논문에서는 시뮬레이션으로 생성된 3.5GHz 대역의 스펙트로그램 이미지의 시간 축과 주파수 축에 따라 추출된 특징들을 서로 융합한 레이더 신호 탐지 딥러닝 모델을 제안한다. 실험 결과, 특징 융합을 적용한 합성곱 신경망과 결합된 순환신경망의 제안 모델이 혼동행렬에서 95.89%의 정확도와 99.23%의 정밀도, 그리고 92.91%의 재현율을 달성해 기존 합성곱 신경망 기반 비교 모델에 대비해 가장 우수한 성능을 나타냄을 확인하였다.

Abstract

The Citizens Broadband Radio Service(CBRS) in the U.S. shares frequency bands with federal agencies, leading to harmful interference with military equipment. Recently, AI-based detection methods have been proposed to address this issue, but obtaining sensitive military data is challenging. Therefore, this paper proposes a deep learning model for radar signal detection by fusing features extracted from the time and frequency axes of spectrogram images generated in the 3.5GHz band through simulation. Experimental results show that the proposed model, which combines a Convolutional Neural Network(CNN) with a recurrent neural network and applies feature fusion, achieved superior performance compared to the existing CNN-based model, with an accuracy of 95.89%, precision of 99.23%, and recall of 92.91% in the confusion matrix.

Keywords:

radar signal detection, spectrogram, feature fusion, deep learning, convolutional neural network, recurrent neural networkⅠ. 서 론

미국의 상업용 민간 광대역 무선 서비스인 CBRS(Citizens Broadband Radio Service)는 효율적인 무선 주파수 사용을 위하여 미국의 연방 기관과 동일한 3550-3700MHz의 주파수 대역을 공유하는 규칙이 존재한다. 대표적으로 미국의 해군 항공 교통 통제 레이더인 SPN-43과 동일한 주파수 대역을 공유하고 있는데, 이러한 주파수 대역의 공유로 인해 민감한 정보를 다루는 군사 레이더에 유해한 간섭이 발생할 수 있기 때문에 간섭에 대한 보호가 핵심적인 과제로 대두되고 있다.

인공지능 기술의 발전은 다양한 분야에서 탐지 성능의 향상과 새로운 방법론의 제시를 촉진하고 있다. 특히 전파 분야에서는 인공지능의 활용이 점차적으로 확대되고 있으며, 기존에는 간섭 문제를 극복하기 위하여 기계학습 알고리즘을 이용한 레이더 감지 체계와 센서 네트워크를 활용하여 연방 기관 레이더 신호를 감지하고 경고를 활성화시키는 ESC(Environment Sensing Capability)를 이용하여 레이더 신호를 감지하였다[1].

R. Caromi et al.[2]은 3.5GHz 대역 무선 주파수 내에 존재하는 레이더 신호탐지를 위하여 딥러닝 및 기계학습 알고리즘을 학습하고 테스트하기 위한 ESC 테스트 파형 생성 신호처리 절차 및 소프트웨어 도구를 제시하였으며, R. Caromi et al.[3]의 시뮬레이션을 통해 생성된 레이더 파형으로 이루어진 개방형 데이터를 활용하여 레이더 신호를 감지하고 분류하기 위한 딥러닝 모델을 설계 및 구현하였다.

인공지능 기술의 발전에 따라 이미지 데이터 학습에 효과적인 합성곱 신경망인 CNN(Convolution Neural Network)[4]과 시계열 예측 및 처리에 효과적인 성능을 나타내는 순환신경망인 RNN(Recurrent Neural Network)을 결합한 딥러닝 모델과 같이 G. Lee et al.[5] 및 S.-I. Lee et al.[6]의 두 종류의 딥러닝 모델들을 서로 결합한 연구 또한 활발하게 진행되고 있는 추세이다. C.-H. Hwang et al.[7]은 미세먼지 예측 성능 개선을 위하여 CNN과 순환신경망의 일종인 LSTM(Long-Short Term Memory)[8]를 결합한 딥러닝 모델을 제안하였으며, LSTM을 활용한 미세먼지 오염도 예측 시, CNN의 환경 상황 분류 결과를 반영하는 방법을 통해 CNN과 RNN을 결합하여 성능을 개선하는 결과를 이끌어냈다. 또한, Lee, K. M.[9] 은 CNN과 LSTM의 결합 모델을 활용하여 흔들리는 영상을 안정화 하는 알고리즘을 제안하였다. LSTM은 기존 RNN의 단점인 장기 의존성 문제(Long-term dependency)를 해결하여 길이가 긴 시퀀스 데이터를 효과적으로 학습할 수 있게 되었다. LSTM은 뛰어난 성능을 나타냄으로써 시퀀스 데이터 분석에 대한 문제뿐만 아니라, Lee, M.-W.[10]의 네트워크 침입탐지와 같은 보안 분야 등, 현재까지 여러 분야의 연구에 폭넓게 활용되고 있다.

본 논문에서는 시뮬레이션을 통해 생성된 I(In-phase)/Q(Quadrature-phase) 수신 데이터로부터 max-hold 스펙트로그램 이미지를 생성하고, 이를 활용하여 합성곱 신경망과 순환신경망을 결합한 레이더 신호탐지 모델을 구축한다. 이때, 스펙트로그램이 합성곱 신경망에 입력되어 출력된 최종 특징맵에서 시간 축과 주파수 축의 두 가지 공간적 특징을 동시에 융합하여 순환신경망에 입력되도록 탐지 모델을 구성한다. 본 모델의 순환신경망 층에 두 영역을 기준으로 차원이 축소된 융합된 특징을 입력함으로써, 시간 및 주파수 영역에서 추출된 중요 특징 정보를 효율적으로 활용하면서 학습 시 계산의 복잡성을 완화할 수 있다.

본 연구에서는 합성곱 신경망에 결합되는 순환신경망 종류로, LSTM, 양방향 LSTM(BiLSTM, Bidirectional LSTM), 적층 LSTM(SLSTM, Stacked LSTM), GRU(Gated Recurrent Unit)[11], 양방향 GRU(BiGRU, Bidirectional GRU), 적층 GRU(SGRU, Stacked GRU)의 총 6가지 모델들을 고려하여 레이더 탐지 성능을 상호 비교한다.

Ⅱ. 데이터 수집 및 전처리

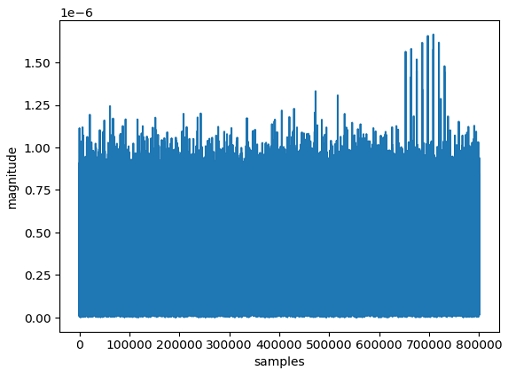

본 연구에서는 모델 학습을 위해 NIST(National Institute of Standards and Technology) Public Data Repository[2]에서 제공하는 CBRS 대역의 RF 데이터 세트를 활용한다. 그림 1의 파형은 레이더 신호를 포함한 3.5GHz 대역에서 ESC 테스트 파형 생성 소프트웨어 도구를 통해 생성되었으며, 잡음 및 간섭과 결합 된 800,000 샘플의 I/Q 복소 신호 형태로 구성되어 있다.

그림 1의 원시 파형 데이터로부터 딥러닝 모델 학습에 적합한 데이터 생성을 위하여 먼저, [1]에서 제시한 신호처리 기법과 동일한 방법을 이용하며, 첫 번째 단계에서 원시 데이터에서 평균을 빼고 표준편차로 나누고 두 번째 단계에서 0과 1사이로 정규화 하는 데이터 전처리를 수행한다.

다음으로, 시계열 신호에 대한 특징 추출을 위한 데이터 신호처리로 널리 활용되고 있는 2차원 스펙트로그램 이미지로 변환한다. 스펙트로그램은 시간 축과 주파수 축의 변화에 따른 전자파 신호 특징을 동시에 관찰하도록 시각화한 기법으로, 식 (1)과 같이 원시 파형 신호에 단시간 푸리에 변환(STFT, Short Time Fourier Transform)[12]을 적용하여 신호를 시간과 주파수 영역으로 변환하여 계산한다.

| (1) |

여기서, x(t)는 I/Q 복소수 신호를, w(τ)은 푸리에 변환을 적용하는 window 함수를 각각 의미한다. STFT 기법은 시간에 따른 신호 데이터를 일정한 길이의 짧은 구간으로 나누어 각 구간마다 푸리에 변환을 적용함으로써 각 구간의 신호의 구성 성분을 분석할 수 있는 장점을 가지고 있다.

마지막으로, 합성곱 신경망과 순환신경망을 기반으로 하는 본 레이더 신호 탐지 모델 학습에 대한 계산 복잡성을 완화하기 위하여, 식 (1)로부터 변환된 스펙트로그램[1]에서 활용된 max-hold 기법을 적용한다. 즉, 시간 차원을 따라 주어진 구간 동안 스펙트럼 크기 신호의 최대 값을 추출하고 이를 구간 내에 유지하도록 하여 스펙트로그램의 시간 축 샘플 개수와 주파수 축 샘플 개수를 서로 동일하게 유지하도록 한다. 따라서, 최종적으로 스펙트로그램의 세그멘테이션 길이는 128, 오버랩 포인트 크기는 24로 설정하여 128×128 크기의 max-hold 스펙트로그램 이미지 데이터를 생성하였다.

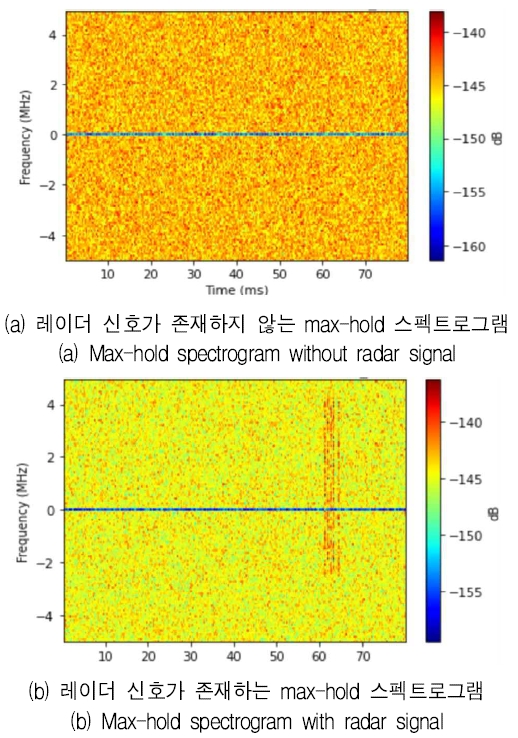

그림 2는 원시 I/Q 신호 파형 데이터로부터 상기에서 기술한 STFT 기법을 활용하여 max-hold 스펙트로그램 이미지를 생성한 결과로써, 그림 2(a)는 레이더 신호가 존재하지 않는 경우이고, 그림 2(b)는 레이더 신호가 존재하는 경우를 각각 나타낸다. 그림의 결과에서와 같이 max-hold 스펙트로그램에 대한 시각화를 통해 레이더 신호 유무에 대한 특징 변화를 용이하게 관찰할 수 있다.

Ⅲ. 레이더 신호 탐지를 위한 제안 모델

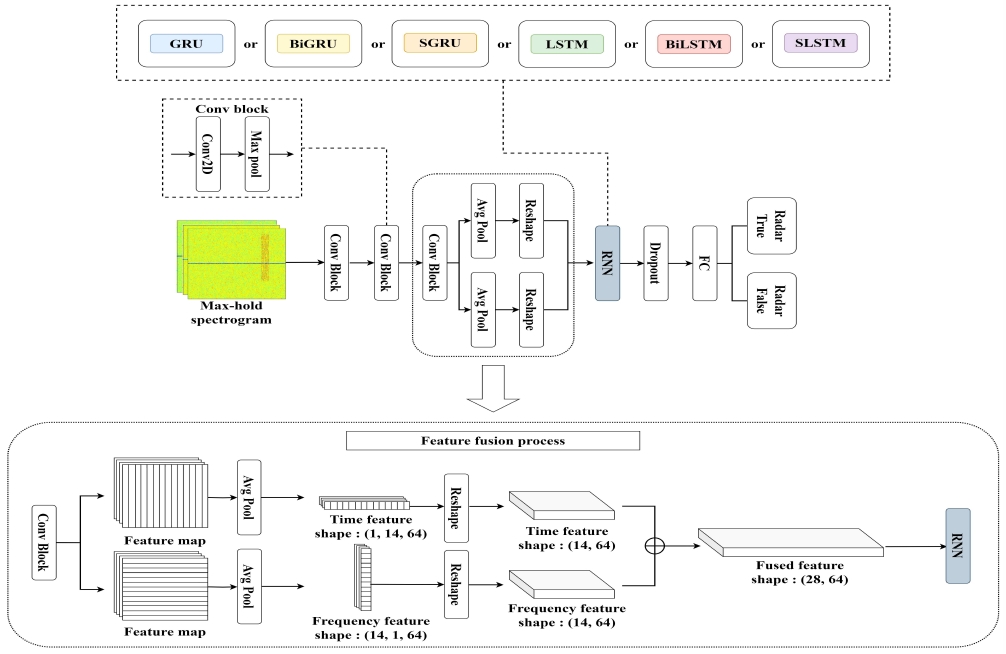

본 연구에서 제안하는 합성곱 신경망과 순환 신경망을 결합한 딥러닝 모델은 기존 CNN 기반 모델에서 스펙트로그램 이미지 특징의 공간적 특징맵을 추출하고, 추출된 특징맵으로부터 시간 및 주파수 축의 특징들을 서로 융합하여 RNN 모델에 연결함으로써, 정확한 레이더 탐지 성능을 목적으로 한다.

합성곱 블록(Convolution block)과 평균값 풀링(Average pooling)을 통하여, max-hold 스펙트로그램의 시간 축과 주파수 축을 기준으로 차원이 축소된 압축 특징이 각각 추출된다. 이후 두 특징을 융합하여 RNN 층과 연결하여 학습함으로써 분류기가 최종적으로 레이더 신호 존재 유무를 판별하도록 한다. 그림 3은 max-hold 스펙트로그램을 활용하여 레이더 신호 탐지를 위한 제안 모델에 대한 아키텍처를 보여준다. 그림 3의 합성곱 블록은 2차원 CNN(Conv2D)과 최대값 풀링(Max pooling)으로 구성되어 있으며, 여러 개로 적층된 합성곱 블록들을 통과하면서 max-hold 스펙트로그램 이미지로부터 중요한 공간적 특징맵을 추출한다. 이후, 추출된 특징맵을 RNN에 입력하기 위하여, 동일한 특징맵을 시간 및 주파수 축을 따라 각각 병렬적으로 평균값 풀링을 적용시킨다. 즉, 두 개의 평균값 풀링 층을 통해 시간 및 주파수에 대한 중요 정보가 보존된 시퀀스 특징이 각각 추출된다. 이 과정을 통해 전체 특징의 크기도 축소되며, 이는 모델 학습 시 과대적합을 억제하는데 도움이 된다. 이때, 시간 축과 주파수 축을 따라 추출된 두 시퀀스 특징은 그림 3과 같이 서로 다른 형태를 가지고 있기 때문에, 이들을 RNN과 연결하기 전에 동일한 특징 형태로 변형하는 과정이 필요하다. 따라서, 각 시퀀스 특징의 차원 형태가 (1, 14, 64) 및 (14, 1, 64)인 두 특징에서 더미(dummy) 축을 제거하고 (14, 64) 형태로 재구성(Reshape)한 후, concatenate 연산을 통해 최종적으로 (28, 64) 형태의 융합된 시퀀스 특징을 생성한다. 마지막으로, LSTM, 양방향 LSTM, 적층 LSTM, GRU, 양방향 GRU, 적층 GRU와 같은 RNN 모델 변형에 융합된 특징을 적용하고, 완전연결 신경망으로 구성된 분류기를 통해 제안된 모델의 최종 학습을 수행한다. 이를 통해 max-hold 스펙트로그램 입력 이미지로부터 레이더 신호의 존재 유무를 판별한다.

Ⅳ. 실험 및 성능 평가

제안 모델의 성능 검증을 위하여 다양한 RNN 모델 변형을 CNN 모델과 결합하여 학습한 후, 그 성능을 서로 비교한다. 실험은 128×128 max-hold 스펙트로그램 이미지 40,000개 중에서 35%인 14,000개를 훈련 데이터로, 15%인 6,000개를 검증 데이터로, 나머지 50%인 20,000장을 시험 데이터로 각각 구성하였다. 또한, 훈련 데이터에 과대적합을 방지하기 위하여, 조기 종료 기법을 적용하여 80 에포크(Epochs) 이하로 모델 학습을 진행하였다. 이와 동시에 40 에포크에서 초기 학습률을 1/10로, 60 에포크에서 1/100로 단계적으로 학습률을 감소시켜 학습이 빠르게 수렴하도록 하였다.

표 1은 상기에서 설정된 하이퍼파라미터가 적용된 CNN과 결합된 6가지 종류의 RNN 모델들에 대한 정확도를 서로 비교한 결과를 보여준다. 이때, 평균 정확도는 5번의 성능 평가 시도에서 얻은 정확도 성능을 내림차순으로 정렬하여 상위 세 개의 정확도 수치들을 평균한 결과이다. 표 1의 결과를 살펴보면 제안 구조에서 CNN과 결합되는 순환신경망으로 LSTM 모델을 선택한 경우가 95.84%로 가장 높은 정확도 성능을 보여주는 것을 실험적으로 관찰할 수 있었다.

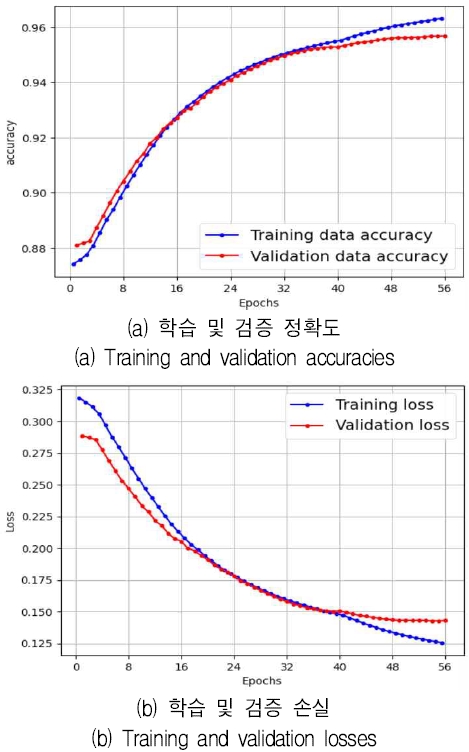

그림 4는 표 1에서 RNN 조합 중 가장 높은 성능을 보인 CNN과 LSTM을 결합한 CNN+LSTM 모델의 학습 그래프를 나타낸 결과로써, 단계적 학습률 조정과 조기 종료를 적용하여 학습이 안정적으로 잘 수행됨을 살펴볼 수 있다.

표 2는 max-hold 스펙트로그램 이미지 데이터를 기반으로, 기본 합성곱 신경망인 CNN 모델, ResNet50[13], Xception[14], MobileNet[15]과 같은 기존 딥러닝 모델들과 제안모델의 성능 비교를 수행한 결과이다. 이때, CNN 모델은 세 개의 합성곱 층과 최댓값 풀링 층 조합으로 구성하였다. 먼저 기존 모델 성능 비교 시, Xception 모델이 94.58%로 가장 높은 레이더 신호 탐지 성능을 나타내었다. 하지만, CNN 모델의 공간적 특징과 LSTM의 시퀀스 특징을 결합한 제안 모델인 CNN+LSTM이 가장 높은 탐지 정확도 성능을 보여주는 것을 관찰할 수 있다. 또한, 모델 복잡도 측면에서 가장 높은 성능을 보여준 Xception 모델의 학습 파라미터(Params.) 개수는 20,862,953인 반면, 제안 모델은 65,313로 가장 적은 학습 파라미터로 평균 95.84%의 가장 우수한 정확도 성능을 제공하였다. 이는 CNN 모델과 LSTM 모델 결합 시, 그림 3에서 제시한 시간 및 주파수 축을 따라 병렬로 압축된 특징을 생성하고 이를 활용한 결과이다.

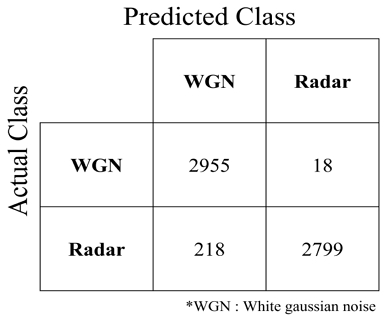

다음으로, 그림 5는 표 2의 제안모델 성능에 대한 혼동행렬(Confusion matrix)을 보여준다. 혼동행렬은 모델의 예측 결과와 실제 클래스 간의 관계를 수치로 나타낼 수 있으며, 실제 클래스가 양성일 때, 모델이 올바르게 예측한 값인 TP(True Positive), 실제 클래스가 음성일 때 올바르게 예측한 값인 TN(True Negative), 실제 클래스가 양성일 때, 잘못 예측한 값인 FP(False Positive), 실제 클래스가 음성일 때 잘못 예측한 값인 FN(False Negative) 네 가지 항목으로 나타낸다. 혼동행렬에 따른 평가 지표에서의 정확도(Accuracy)는 식 (2)와 같이 정의되며, 정밀도(Precision)는 모델이 양성으로 예측한 항목 중 실제로 양성인 비율로 식 (3)과 같이 정의한다. 재현율(Recall)의 경우, 실제 양성 중 모델이 양성으로 올바르게 예측한 비율을 나타내며 식 (4)와 같이 정의된다. 마지막으로, F1 점수(F1-score)는 정밀도와 재현율의 조화 평균으로 식 (5)와 같이 정의한다.

| (2) |

| (3) |

| (4) |

| (5) |

표 3에서 기존 CNN 기반 딥러닝 모델 중, 가장 뛰어난 성능을 나타낸 Xception 모델과 제안 모델인 CNN+LSTM 모델의 분류 성능을 혼동행렬을 기반으로 비교하였다. 여기서, 식 (2)를 통해 계산된 Xception 모델의 정확도는 94.58%인 반면, 제안 모델의 정확도는 95.89%로 제안 모델이 더욱 정확한 판단을 내린다. 식 (3)을 통하여 Xception 모델의 정밀도를 계산한 결과는 98.49%였지만, 제안 모델이 99.23%의 확률로 올바르게 예측할 확률이 더욱 높았다. 또한, 식 (4)를 통하여 모델이 실제 양성인 데이터 중 양성으로 예측한 비율인 재현율은 Xception 모델이 90.55%인 반면, 제안 모델은 92.91으로 더욱 높은 성능을 나타낸다. 식 (5)를 통해 정밀도와 재현율의 조화 평균인 F1 점수를 계산하였을 때, Xception 모델은 94.35%의 결과를 얻었지만, 제안 모델은 96.10%로 Xception 모델의 성능을 능가함을 보여주었다. 따라서, 제안모델인 CNN+LSTM은 기존 CNN 기반 Xception 모델 대비 식 (2)~(4)의 모든 평가지표에서 높은 성능을 나타낸다는 사실을 실험적으로 알 수 있었다.

Ⅴ. 결론 및 향후 과제

본 논문에서는 스펙트로그램 이미지의 시간 축과 주파수 축에 대한 주요 특징을 융합하고 이를 바탕으로 CNN과 RNN을 결합하는 새로운 방법을 제안하였다.

제안된 방법을 통해 CNN+LSTM 모델이 95.89%의 정확도와 99.23%의 정밀도, 그리고 92.91%의 재현율을 달성하여 기존 CNN 기반 딥러닝 모델에 대비하여 가장 우수한 레이더 탐지 정확도를 달성함을 실험적으로 관찰할 수 있었다. 따라서, CNN 기반의 딥러닝 모델에 LSTM 신경망을 결합하여 제안 모델이 스펙트로그램 이미지 데이터의 시간 축과 주파수 축의 시퀀스에 대한 중요 정보를 함께 학습하여 더욱 정확한 판단을 할 수 있다는 점에서 연구에 의의를 찾을 수 있다.

향후에는 이번 연구에서 사용한 신호의 최댓값을 유지하는 max-hold 스펙트로그램 이미지뿐만 아니라, 평균값이나 최소값을 유지하는 스펙트로그램 생성과 같은 다양한 신호 처리 방법을 활용하여 스펙트로그램 이미지 데이터의 주요 정보를 통합한 레이더 탐지 성능을 개선하는 연구를 수행할 계획이다.

Acknowledgments

본 논문은 2023년도 정부(과기정통부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 연구임(2019-0-00964)

본 논문은 2023년도 한국정보기술학회 하계종합학술대회에서 발표한 내용을 확장한 연구 결과임[16].

References

-

W. M. Lees, A. Wunderlich, P. J. Jeavons, P. D. Hale, and M. R. Souryal, "Deep learning classification of 3.5-GHz band spectrograms with applications to spectrum sensing", IEEE transactions on cognitive communications and networking, Vol. 5, No. 2, pp. 224-236, Feb. 2019.

[https://doi.org/10.1109/TCCN.2019.2899871]

- R. Caromi and M. Souryal, "Simulated radar waveform and rf dataset generator for incumbent signals in the 3.5 ghz cbrs band", National Institute of Standards and Technology, Mar. 2020.

-

R. Caromi, A. Lackpour, K. Kallas, T. Nguyen, and M. Souryal, "Deep learning for radar signal detection in the 3.5 GHz CBRS band", 2021 IEEE International Symposium on Dynamic Spectrum Access Networks (DySPAN), Los Angeles, CA, USA, pp. 1-8, Dec. 2021.

[https://doi.org/10.1109/DySPAN53946.2021.9677280]

-

Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard, and L. D. Jackel, "Backpropagation applied to handwritten zip code recognition", Neural computation, Vol. 1, No. 4, pp. 541-551, Dec. 1989.

[https://doi.org/10.1162/neco.1989.1.4.541]

-

G. Lee, S.-H. Lee, A. Nyamdavaa, and S. Song, "Prediction Method for Traffic Speed based on ConvLSTM", The Journal of Korean Institute of Information Technology, Vol. 19 No. 12, pp. 27-33, Dec. 2021.

[https://doi.org/10.14801/jkiit.2021.19.12.27]

-

S.-I. Lee, S.-I. Song, and D.-S. Ko, "Performance Improvement for Automatic Classification of Partial Charge Types using ConvLSTM2D Technique", The Journal of Korean Institute of Information Technology, Vol. 19, No. 4, pp. 19-26, Mar. 2021.

[https://doi.org/10.14801/jkiit.2021.19.4.19]

- C.-H. Hwang and K.-W. Shin, "CNN-LSTM combination method for improving particular matter contamination (PM 2.5) prediction accuracy", Journal of the Korea Institute of Information and Communication Engineering, pp. 57-64. Jan. 2020.

-

S. Hochreiter and J. Schmidhuber, "Long short-term memory", Neural computation, Vol. 9, No. 8, pp. 1735-1780, Nov. 1997.

[https://doi.org/10.1162/neco.1997.9.8.1735]

- K. M. Lee and C. H. Lin, "Video Stabilization Algorithm of Shaking image using Deep Learning", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 19, No. 1, pp. 145-152, Feb. 2019.

- M.-W. Lee, "LSTM Model based on Session Management for Network Intrusion Detection", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 20, No. 3, pp. 1-7, Jun. 2020.

-

K. Cho, B. V. Merriënboer, C. Gulcehre, D. Bahdanau, F. Bougares, H. Schwenk, and Y. Bengio, "Learning phrase representations using RNN encoder-decoder for statistical machine translation", In Proceedings of the 2014 Conference on Empirical Methods in Natural Language Processing (EMNLP), Doha, Qatar, pp. 1724-1734, Oct. 2014.

[https://doi.org/10.3115/v1/D14-1179]

-

D. Griffin and J. Lim, "Signal estimation in IEEE Transactions on Acoustics, Speech, and Signal Processing, Vol. 32, No. 2, pp. 236-243, Apr. 1984.

[https://doi.org/10.1109/TASSP.1984.1164317]

-

K. He, X. Zhang, S. Ren, and J. Sun, "Deep residual learning for image recognition", 2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA, pp. 770-778, Jun. 2016.

[https://doi.org/10.1109/CVPR.2016.90]

-

F. Chollet, "Xception: Deep learning with depthwise separable convolutions", Proceedings of the IEEE conference on computer vision and pattern recognition, Honolulu, HI, USA, pp. 1800-1807, Jul. 2017.

[https://doi.org/10.1109/CVPR.2017.195]

- A. G. Howard, et al., "MobileNets: Efficient Convolutional Neural Networks for Mobile Vision Applications", arXiv:1704.04861, , Apr. 2017.

- D. Roh, M. Lim, J. H. Jung, J. H. Lee, and J.-H. Bae, "Performance comparison of radio frequency sensing deep learning models in the 3.5GHz band", Proceedings of KIIT Conference, Jeju, Korea, pp. 119-121, Nov. 2023.

2023년 2월 : 대구가톨릭대학교 컴퓨터정보학부 인공지능·빅데이터공학전공(공학사)

2023년 3월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 석사과정

관심분야 : 인공지능, 딥러닝/머신러닝

2023년 2월 : 대구가톨릭대학교 컴퓨터정보학부 인공지능·빅데이터공학전공(공학사)

2023년 3월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 석사과정

관심분야 : 인공지능, 딥러닝/머신러닝

1994년 2월 : 경북대학교 무기재료공학과(공학사)

1996년 2월 : 경북대학교 전자공학과(공학석사)

2004년 2월 : 경북대학교 전자공학과(공학박사)

2000년 4월 ~ 현재 : 한국전자통신연구원 책임연구원

관심분야 : RF 시스템, 이동통신 기지국, 전이중방식 통신, 센싱 및 통신 시스템(ISAC)

2004년 2월 : 고려대학교 컴퓨터교육과(이학사)

2006년 2월 : 고려대학교 컴퓨터교육학과(이학석사)

2011년 2월 : 고려대학교 컴퓨터교육학과(이학박사)

2011년 3월 ~ 2011년 10월 : 고려대학교 정보창의교육연구소 연구교수

2011년 11월 ~ 2012년 11월 : University of Houston Post-Doc. 연구원

2012년 12월 ~ 2017년 8월 : 삼성전자 책임연구원

2017년 9월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 조교수

관심분야 : 클라우드 컴퓨팅, 빅데이터, 인공지능

2000년 2월 : 경북대학교 전자·전기공학부(공학사)

2002년 2월 : 포항공과대학교 전자컴퓨터공학부(공학석사)

2016년 2월 : 포항공과대학교 전자·전기공학과(공학박사)

2002년 1월 ~ 2019년 8월 : 한국전자통신연구원 책임연구원

2019년 9월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 조교수

2021년 3월 ~ 현재 : 대구가톨릭대학교 SW중심대학사업단 SW기초교육센터장

관심분야 : 인공지능, 딥러닝/머신러닝, 레이다 영상 및 신호처리, 최적화 기법