딥러닝 기반 사과 이미지에서 무게 및 등급 예측 알고리즘

; Nguyen Bui Ngoc Han**

; Nguyen Bui Ngoc Han** ; Jin Lee**

; Jin Lee** ; Le Bao Thai An**

; Le Bao Thai An** ; Gyeong-Ju Kwon***

; Gyeong-Ju Kwon*** ; Jin-Young Kim****

; Jin-Young Kim****

초록

본 연구에서는 딥러닝 기반 사과 이미지에서 무게 및 등급 예측 알고리즘을 제안한다. 사과의 등급은 국립농산물품질관리원의 농산물 품질규격에서 정량적 평가 기준에 따라 무게로 구분된다. 따라서 딥러닝 기반 무게 예측을 학습하기 위하여 사과 이미지 무게 데이터를 수집하였으며, 실험을 위해 학습 12,932개, 검증 3,695개, 테스트 1,848개를 사용하였다. 무게 예측 실험을 위해 7가지의 머신러닝 기반 회귀 모델과 딥러닝 모델 MobileNetV3을 학습하였으며, 실험 결과는 MobileNetV3의 MAE가 머신러닝 중 성능이 가장 높은 Random Forest보다 37.8715 낮은 59.7430를 달성한다. 테스트 데이터에서 무게 예측에 따라서 등급 분류한 결과 MobileNetV3 모델은 99.8%의 정확도를 달성한다.

Abstract

In this study, we propose a deep learning-based algorithm for predicting the weight and grade of apples from images. The grade of apples is determined by weight according to the quantitative evaluation criteria in the agricultural product quality standards set by the National Agricultural Product Quality Management Service. Therefore, to train the deep learning-based weight prediction model, we collected a dataset of apple images with weight information. For the experiments, we used 12,932 images for training, 3,695 for validation, and 1,848 for testing. For the weight prediction experiments, we trained seven machine learning-based regression models and the deep learning model MobileNetV3. The results showed that MobileNetV3 achieved an MAE of 59.7430, which is 37.8715 lower than the best-performing machine learning model, Random Forest. When classifying the grades based on the predicted weights on the test data, the MobileNetV3 model achieved an accuracy of 99.8%.

Keywords:

smart agriculture, precision agriculture, regression, deep learning, machine learningⅠ. 서 론

21세기에 들어서면서 농업 기술은 급속도로 발전하고 있다. 이러한 발전의 핵심에는 품질 관리, 수확량 예측, 그리고 지속 가능한 농업 실천 방안 모색이 자리잡고 있다. 특히, 정밀 농업(Precision agriculture)과 스마트 농업(Smart farming) 기술의 등장은 농업 생산성 향상에 있어 혁신적인 변화를 가져오고 있다. 이 중에서도 머신러닝(Machine learning) 및 딥러닝(Deep learning) 기술의 활용은 작물의 생육 상태 모니터링, 병해충 진단, 그리고 수확량 예측 등 다양한 분야에서 두각을 나타내고 있다[1]-[5].

과일 산업에 있어서도 이러한 기술의 도입은 매우 중요한 의미를 갖는다. 과일의 품질은 소비자의 선택에 직접적인 영향을 미치는 요소로, 이는 농가의 수익과 직결된다. 따라서 과일의 품질을 정확하게 예측하고 분류하는 것은 농업 경제에 있어 중대한 과제 중 하나이다. 특히, 사과는 전 세계적으로 널리 소비되는 대표적인 과일 중 하나로, 사과 품질 예측을 위한 연구는 활발히 진행되어 왔다[6]-[8].

일반적으로 사과의 품질은 무게, 크기, 색깔, 당도 등 다양한 요소에 의해 결정된다. 국립농산물품질관리원의 농산물 표준규격[9]에 따르면 사과 등급을 분류하기 위한 기준으로는 무게, 색택, 신선도, 중결점과, 경결점과 등이 있다. 그러나 이 중 정량적으로 평가 가능한 항목은 과실의 무게뿐이다. 따라서 본 연구에서는 과실의 무게를 정량적으로 측정하여 등급을 평가하는 것으로 규정하였고, 이를 위해 정상 사과로 구성된 새로운 데이터셋을 구축하였다.

전통적으로 사과의 무게는 수확 이후 무게 감지 센서를 기반으로 측정 된다. 그러나 본 연구에서는 이와 다르게 딥러닝 기반의 접근 방식을 통해 이미지 처리와 패턴 인식을 활용하여 대량의 사과 이미지에서 무게를 신속하고 정확하게 예측할 수 있는 가능성을 제시한다. 이를 통해 예측된 무게를 바탕으로 국립농산물품질관리원의 표준규격에 따라 사과를 3가지 등급(특상, 상, 보통)으로 분류한다.

기존의 연구로는 사과 이미지를 활용하여 약지도학습 기반의 표면 결함 지역화[10], 그래프 트랜스포머 기반 품질 예측[11], 사과 질병 분류[12], 사과 형태 측정[13], 품질 예측을 위한 색상 채널 탐색[14] 등이 있다. 이들 연구는 주로 사과의 품질이나 질병 예측을 위한 이미지 프로세스와 딥러닝 네트워크의 변형을 제안하고 있다. 일부 연구에서는 사과의 무게 예측을 위해 이미지 프로세스[15] 및 3D 재구성 기법[16]을 제안하였으나, 예측 모델로는 머신러닝 기법을 사용하였다.

본 연구에서는 사과 무게 예측을 위해 기존 연구와 달리 전이학습 기반 딥러닝 모델 MobileNetV3를 사용하였다. 이를 위해 사과 이미지를 직접 수집하고 체계적으로 분석한 후, 무게 예측을 위한 MobileNetV3 모델을 학습 및 검증한다. 딥러닝 기반 MobileNetV3 모델의 성능 평가를 위해 머신러닝 기반의 예측 모델과 비교 분석을 수행하였다.

본 연구의 구성은 다음과 같다. 2장에서는 연구에 사용된 데이터셋의 구축 과정에 대해 설명한다. 그리고 데이터셋에 필요한 전처리 과정 및 분석에 관하여 상세히 설명한다. 3장에서는 제안하는 딥러닝 기반의 사과 무게 예측 모델의 구조와 학습 방법에 대해 상세히 설명한다. 4장에서는 제안하는 모델의 성능을 평가하기 위한 실험과 결과를 제시하며, 기존의 머신러닝 기반 모델과의 비교 분석 결과를 보인다. 마지막으로 5장에서는 연구의 의의와 한계점, 그리고 향후 연구 방향에 대해 논의한다.

Ⅱ. 본 론

2.1 데이터셋 구축

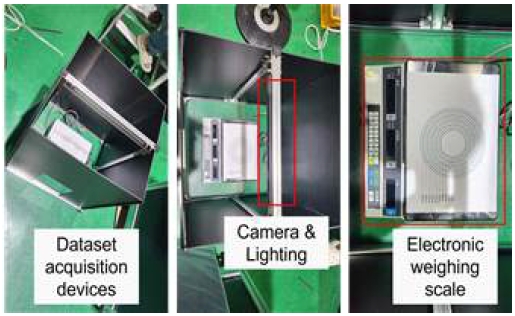

본 연구의 사과 무게 예측을 위해서는 고품질의 사과 이미지 및 사과 무게 데이터에 대한 수집이 필요하다. 따라서 그림 1과 같이 전자저울(Electronic weighing scale), 카메라(Camera), 조명(Lighting) 거치대로 구성된 데이터 수집 환경을 설계하였다. 카메라를 고정 위치에 설치하여 사과 이미지를 일관되게 촬영하고, 동시에 전자저울을 사용하여 각 사과의 무게를 정밀하게 측정하였다. 수집된 이미지 데이터에는 해당 사과의 무게와 직경 정보를 주석(Annotation)으로 포함하였다.

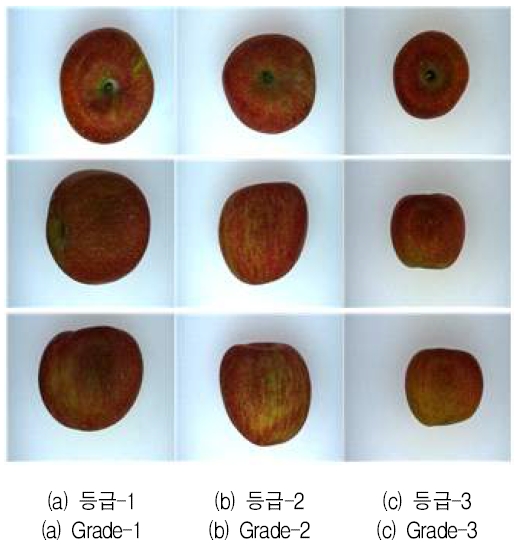

사과 무게는 사과 등급 분류를 위한 기준으로 사용되며 명확한 등급 분류를 위하여 표1의 농촌진흥청에서 제시한 무게 및 직경에 따른 과실 구분 기준을 참고하였다. 이에 따라서 각 사과의 무게와 직경을 기준으로 '특(Grade-1)', '상(Grade-2)', '보통(Grade-3)' 등급으로 분류하였다.

2.2 사과 무게와 크기 상관관계

사과를 다양한 각도에서 촬영할 경우, 일부 각도에서는 사과의 실제 크기보다 작게 촬영될 수 있다. 사과가 완전한 구체의 형태가 아니기 때문에, 이미지 상의 사과 크기와 실제 무게 간의 상관관계를 저해하는 요인이 될 수 있다. 따라서 다양한 각도에서 촬영된 사과 이미지와 실제 무게 간의 상관관계 분석의 검증이 필요하다.

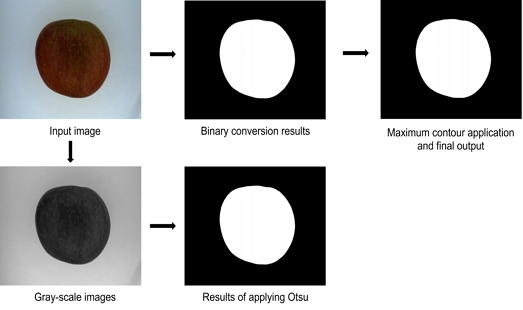

이를 위하여 사과 영역의 픽셀 크기를 계산할 수 있도록 사과 영역을 세분화하는 전처리 방법을 고안하였다. 세분화를 위하여 Otsu thresholding 알고리즘을 사용하여 이미지의 임계값을 자동으로 설정하고, 강도 분포에 따라 사과 객체를 분리하는 이진 마스크를 생성하였다. 구체적인 추출 단계는 다음과 같다.

먼저, 컬러 이미지를 흑백으로 변환하고 Otsu 임계값을 적용하여 이진 이미지를 얻는다. 이후 윤곽선 감지 알고리즘을 사용하여 이진 이미지에서 윤곽선을 찾아내고, 그 중 가장 큰 윤곽선을 선택한다. 선택된 윤곽선은 흰색으로 채워지고, 이미지의 나머지 부분은 검은색으로 채워져 마스크를 만든다. 최종적으로 이 마스크를 원본 컬러 이미지에 적용 하여 사과 객체의 세분화된 영역을 획득한다.

위 추출 단계에 따라 세분화를 수행한 결과, 그림 3과 같이 사과 영역만을 성공적으로 마스크하여 분리할 수 있었다. 이를 통해 세분화된 사과 영역의 픽셀 크기를 정확히 계산할 수 있다.

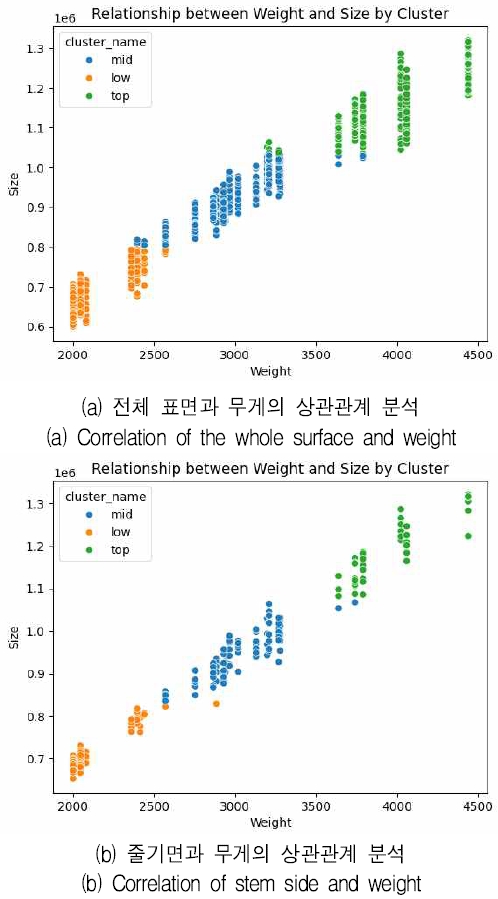

다음으로, 전처리를 통해 모든 사과 영역의 픽셀 크기를 계산하고 무게와의 상관관계를 분석 및 검증하였다. 이를 위해 다양한 각도로 촬영한 ‘전체 표면과 무게와의 상관관계’, 균일한 촬영 각도인 ‘줄기면과 무게의 상관관계’로 구분한다. 그림 4에 따르면 상관관계 분석의 용이함을 위하여 사전 정의한 품질 등급을 사용하여 '특(top)', '상(mid)', '보통(low)'으로 표기하였다.

분석 결과는 촬영 각도와 관계없이 사과의 무게가 증가함에 따라서 픽셀 크기가 일관되게 증가하는 경향을 파악하였다. 즉 사과의 다양한 각도에서 촬영하더라도 고유한 무게와의 상관관계가 저해하지 않는 요인이라는 것을 검증하였다.

2.3 딥러닝 기반 무게 예측 모델

딥러닝 기반 무게 예측을 학습하기 위하여 전이학습[17] 기반으로 학습한다. 전이학습은 대규모 데이터셋을 사용해 사전에 학습되어 있는 모델을 새롭고 관련된 작업에 적용하는 학습 방법이다. 이 방식은 새로운 작업을 학습하는 데 필요한 시간을 크게 단축시킬 뿐만 아니라, 적은 양의 데이터로도 높은 성능을 달성할 수 있다는 장점이 있다.

따라서 본 연구에서는 대규모의 데이터셋 ImageNet[18]으로 사전 학습한 MobileNet-V3[19]을 전이학습한다. MobileNet-V3는 모바일 및 임베디드 비전 애플리케이션을 위해 설계된 경량화된 CNN 아키텍처이다. 전이학습을 위해 마지막 완전 연결 계층을 제거하고, 무게 예측을 위한 선형 계층으로 대체한다. 그리고 수집한 데이터셋을 활용하여 MobileNet-V3를 미세조정하여 이미지로부터 무게를 예측할 수 있도록 학습한다.

Ⅲ. 실 험

3.1 실험 설정 및 평가 방법

수집한 데이터셋의 이미지 총 수량은 18,475장이다. 이를 7:2:1 비율로 나누어 학습 12,932개, 검증 3,695개, 테스트 1,848개로 구분하여 사용한다.

사과 무게 예측을 위한 모델 실험의 평가를 위하여 평균제곱오차(MSE, Mean Squared Error), 평균절대오차(MAE, Mean Average Error)를 사용한다. 그리고 무게 예측을 기반으로 등급을 예측하는데 이를 위해 정확도(Accuracy), 정밀도(Precision), 재현율(Recall), F1Score를 사용한다.

| (1) |

| (2) |

| (3) |

| (4) |

| (5) |

| (6) |

식 (1), (2)에서 n은 총 데이터 개수이고 yi는 모델의 출력, 는 정답 값이다. 식 (3)~(6)의 참양성 (TP, True Positives)는 모델이 올바르게 양성으로 예측한 데이터의 수, 참음성 (TN, True Negatives)은 모델이 올바르게 음성으로 예측한 데이터의 수를 의미한다. 거짓음성 (FN, False Negatives)은 모델이 잘못하여 음성으로 예측한 양성 데이터의 수, 거짓양성 (FP, False Positives)은 모델이 잘못하여 양성으로 예측한 음성 데이터의 수를 의미한다.

3.2 무게 예측 실험 결과

무게 및 등급 예측 실험에서 비교 분석을 위해 머신러닝 회귀 모델로 알려진 Decision Tree, Gradient Boosting, KNN, Logistic Regression, Naive Bayes, Random Forest, SVM 모델을 사용한다. 그리고 딥러닝 모델 MobileNetV와 성능을 비교하였다.

표 2의 무게 예측 실험 결과를 살펴보면, 딥러닝 모델인 MobileNetV3가 MSE 6028.416, MAE 59.743으로 가장 우수한 성능을 보였다. 머신러닝 모델 중에서는 Gradient Boosting이 MSE 14348.9316, MAE 83.8614로 가장 낮은 오차율을 기록했지만, MobileNetV3와 비교하면 여전히 성능 차이가 있음을 알 수 있다.

머신러닝 모델들의 성능을 비교해보면, Gradient Boosting 다음으로 KNN과 Naive Bayes가 각각 MSE 18641.7694, MAE 93.7346와 MSE 18499.9571, MAE 93.5248로 유사한 성능을 나타냈다. 이어서 Random Forest, Decision Tree, SVM 순으로 오차율이 점차 증가하는 경향을 보였다. 특히 Logistic Regression은 MSE 1.83E+06, MAE 1115.1801로 다른 모델들에 비해 현저히 높은 오차율을 기록한다.

3.3 등급 예측 실험 결과

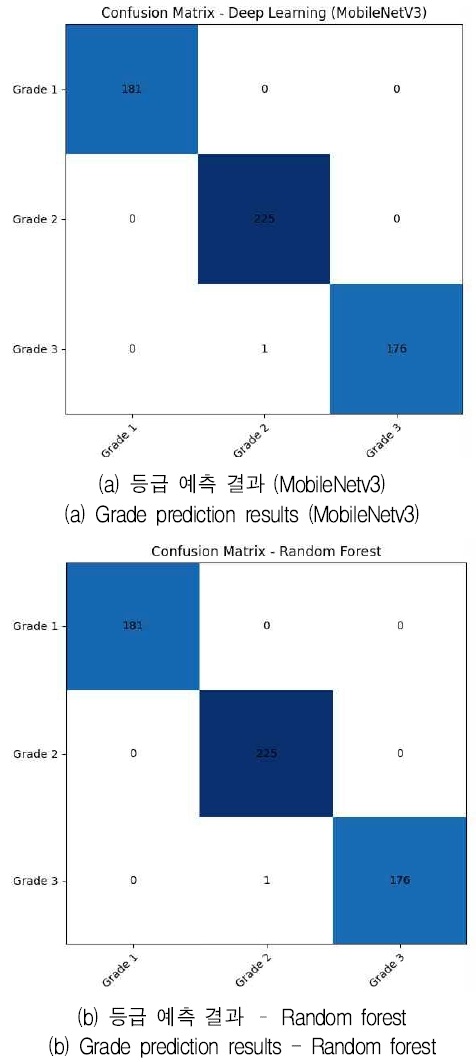

무게 예측을 기반으로 한 등급 예측 실험 결과, Random Forest와 MobileNetV3가 99.8%로 가장 높은 정확도, 정밀도, 재현율, F1 점수를 달성하였다. 이어서 Gradient Boosting과 SVM이 99.5%의 우수한 성능을 보였으며, KNN, Naive Bayes, Decision Tree 역시 98% 이상의 높은 정확도를 나타냈다. 반면, Logistic Regression은 다른 모델들과 달리 30.4%의 낮은 정확도와 14.1%의 F1 점수를 기록하였다.

등급 예측에서 딥러닝 모델인 MobileNetV3와 머신러닝 모델 중 최고 성능을 보인 Random Forest의 성능이 동일하게 나타났다. 이에 따라, 두 모델의 명확한 비교 분석을 위해 다양한 크기와 무게를 균일하게 분포시킨 총 583개의 새로운 테스트 데이터셋을 구성하여 등급 예측 성능을 평가하였다.

그림 5의 실험결과에 따르면, MobileNetV3는 99.8%의 매우 높은 정확도를 보인 반면, Random Forest는 98.8%의 정확도를 기록한다.

이는 MobileNetV3이 무게 예측의 오류가 매우 작게 나타나기 때문에 등급 예측의 일반화 측면에서 성능이 우수함을 의미한다.

종합적으로 딥러닝 모델인 MobileNetV3가 모든 평가 지표에서 가장 우수한 성능을 보였으며, 특히 낮은 오차율과 높은 정확도는 사과 무게 및 등급 예측에 있어 매우 중요한 요소로 나타났다. 이를 통해 MobileNetV3가 사과 무게와 등급 예측에 가장 효과적으로 활용될 수 있음을 확인하였다.

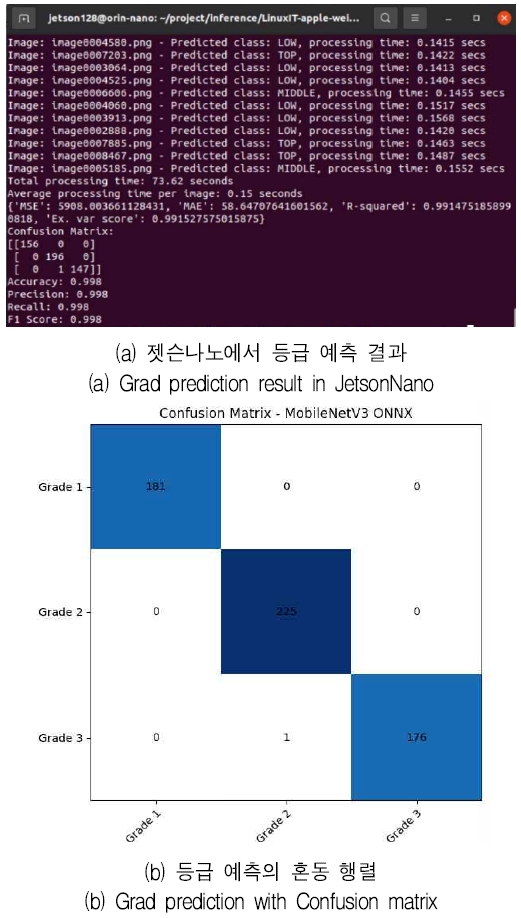

3.4 임베디드 환경에서 성능 평가

스마트팜은 대부분 임베디드 시스템으로 구성되어 있기 때문에, 사과 무게 및 등급 예측을 위해 학습한 MobileNetV3 모델의 실제 적용 가능성을 평가하는 것이 중요하다. 이를 위해 대표적인 임베디드 플랫폼인 Nvidia Jetson Nano[20]에서 모델의 구동 성능을 테스트하였다. 이를 통해 MobileNetV3 모델이 스마트팜의 임베디드 환경에서 효과적으로 동작할 수 있는지 확인하고자 하였다.

임베디드 환경에서의 테스트를 위해 500장의 이미지로 구성된 별도의 테스트 데이터셋을 사용하였다. 그리고 딥러닝 모델을 Nvidia Jetson Nano에 배포하기 위해 ONNX[21] 형식으로 변환하였다.

5회 반복 추론을 수행한 결과, 평균 정확도는 99.8%로 매우 높게 나타났으며, 평균 추론 속도는 0.15초를 기록하였다. 500장의 테스트 이미지에 대한 임베디드 시스템 실험 결과를 혼동 행렬로 분석한 결과, 특상 등급과 상 등급 사이에서 단 1개의 오분류만이 발생하였다.

이러한 실험 결과는 제안된 MobileNetV3 기반 모델이 사과 무게 예측과 등급 분류에서 높은 정확도를 달성할 뿐만 아니라, 실제 임베디드 시스템에서도 빠르고 안정적으로 동작할 수 있음을 보여준다. 따라서 본 연구에서 개발된 모델은 농업 분야에서 품질 관리와 등급 판정 자동화에 효과적으로 활용될 수 있을 것으로 기대된다.

Ⅳ. 결 론

본 연구는 딥러닝 기술을 활용하여 사과의 무게를 예측하고 등급을 분류하는 새로운 접근 방식을 제안하였다. 제안된 모델은 사과 이미지만을 입력으로 사용하여 99.8%의 높은 정확도를 달성하였으며, 이는 기존의 물리적인 측정 방식을 대체할 수 있는 비접촉식 품질 평가 솔루션으로서의 가능성을 보여준다. 그리고 제안된 모델을 임베디드 시스템에 배포하여 실제 농업 환경에서의 적용 가능성을 검증하였다. 높은 예측 정확도와 빠른 추론 속도를 확인함으로써, 본 연구에서 개발한 딥러닝 기반 사과 품질 예측 시스템이 실제 농가에서 안정적으로 활용될 수 있음을 시사하였다.

한편, 본 연구의 한계점으로는 사과의 외관 이미지만을 사용하여 무게 측정 및 품질 등급을 평가하였다. 그러나 사과의 내부 품질, 숙도, 당도, 결함 등은 외관 이미지만으로는 파악하기 어려운 한계가 있다. 이에 따라 후속 연구에서는 RGB 이미지와 근적외선 또는 단파장 적외선 이미지 정보를 결합하여 보다 종합적이고 정밀한 사과 품질 모델을 개발하고자 한다.

또한, 개발한 모델을 다양한 품종의 사과 및 다른 과일로 확장하는 연구, 사용자 인터페이스 개발, 임베디드 시스템 최적화 등의 후속 연구도 필요할 것으로 사료된다.

Acknowledgments

본 연구는 중소벤처기업부의 기술혁신개발사업의 지원에 의한 연구임 [S3294129]

References

-

K. G. Liakos, P. Busato, D. Moshou, S. Pearson, and D. Bochtis, "Machine learning in agriculture: A review", Sensors, Vol. 18, No. 8, pp. 2674, Aug. 2018.

[https://doi.org/10.3390/s18082674]

-

A. Kamilaris and F. X. Prenafeta-Boldú, "Deep learning in agriculture: A survey", Computers and electronics in agriculture, Vol. 147, pp. 70-90, Apr. 2018.

[https://doi.org/10.1016/j.compag.2018.02.016]

-

N. Zhu, X. Liu, Z. Liu, K. Hu, Y. Wang, J. Tan, M. Huang, Q. Zhu, X. Ji, Y. Jiang, and Y. Guo, "Deep learning for smart agriculture: Concepts, tools, applications, and opportunities", International Journal of Agricultural and Biological Engineering, Vol. 11, No. 4, pp. 32-44, Aug. 2018.

[https://doi.org/10.25165/j.ijabe.20181104.4475]

-

S. Hong, T. Park, J. Bang, and H. Kim, "A Study on the Prediction Model for Tomato Production and Growth Using Conv LSTM", The journal of korean institute of information technology, Vol. 18, No. 1, pp. 1-10, Jan. 2020.

[https://doi.org/10.14801/jkiit.2020.18.1.1]

-

K. Lee, "A Study of using Augmented Data with Machine Learning for Growth Detection Under Hydroponic Conditions", The journal of korean institute of information technology, Vol. 21, No. 12, pp. 13-21, Dec. 2023.

[https://doi.org/10.14801/jkiit.2023.21.12.13]

-

Y. Li, X. Feng, Y. Liu, and X. Han, "Apple quality identification and classification by image processing based on convolutional neural networks", Scientific Reports, Vol. 11, No. 1, pp. 16618, Aug. 2021.

[https://doi.org/10.1038/s41598-021-96103-2]

-

S. Fan, J. Li, Y. Zhang, X. Tian, Q. Wang, X. He, C. Zhang, and W. Huang, "On line detection of defective apples using computer vision system combined with deep learning methods", Journal of Food Engineering, Vol. 286, pp. 110102, Oct. 2020.

[https://doi.org/10.1016/j.jfoodeng.2020.110102]

-

N. Stasenko, M. Savinov, V. Burlutskiy, M. Pukalchik, and A. Somov, "Deep learning for postharvest decay prediction in apples", in IECON 2021–47th Annual Conference of the IEEE Industrial Electronics Society, Toronto, ON, Canada, pp. 1-6, Oct. 2021.

[https://doi.org/10.1109/IECON48115.2021.9589498]

- National Agricultural Products Quality Management Service, Agricultural Product Standard Specification, https://www.naqs.go.kr, [accessed: Apr. 24, 2024]

-

N. B. N. Han, J. H. Lee, and J. Y. Kim, "Integration of Multi-scale CAM and Attention for Weakly Supervised Defects Localization on Surface Defective Apple", Journal of Smart Media, Vol. 12, No. 9, pp. 45-59, Sep. 2023.

[https://doi.org/10.30693/SMJ.2023.12.9.45]

-

J. H. Bae, J. Y. Kim, J. H. Lee, K. H. Yoo, and K. J. Kwon, "A Study about Learning Graph Representation on Farmhouse Apple Quality Images with Graph Transformer", Journal of Smart Media, Vol. 12, No. 1, pp. 9-16, Jan. 2023.

[https://doi.org/10.30693/SMJ.2023.12.1.9]

-

J. Y. Kim, T. K. Kim, and H. J. Cho, "Noise-robust Apple Disease Classification with Image Augmentation Methods", The Transactions of the Korean Institute of Electrical Engineers, Vol. 71, No. 9, pp. 1302-1307, Sep. 2022.

[https://doi.org/10.5370/KIEE.2022.71.9.1302]

-

J. I. Yoo, C. W. Lee, S. Y. Lee, Y. W. Kim, N. H. Kim, J. S. Song, J. J. Choi, E. Y. Nam, and K. H. Kim, "Optimization Study of RGB Image-based Apple Fruit Measurement for Digital Breeding", Korean Journal of Breeding Science, Vol. 55, No. 4, Dec. 2023.

[https://doi.org/10.9787/KJBS.2023.55.4.303]

-

E. J. Lee and J. I. Min, "Explore Influential Color Channels for Quality Classification of Apples Based on CNN", Journal of Digital Contents Society, Vol. 23, No. 8, pp. 1477-1484, Aug. 2022.

[https://doi.org/10.9728/dcs.2022.23.8.1477]

-

O. CÖMERT, M. HEKİM, and A. D. E. M. Kemal, "Weight and diameter estimation using image processing and machine learning techniques on apple images", International Journal of Engineering Research and Development, Vol. 9, No. 3, pp. 147-154, Sep. 2017.

[https://doi.org/10.29137/umagd.350588]

-

B. Zhang, N. Guo, J. Huang, B. Gu, and J. Zhou, "Computer vision estimation of the volume and weight of apples by using 3d reconstruction and noncontact measuring methods", Journal of Sensors, Vol. 2020, pp. 1-12, Jul. 2020.

[https://doi.org/10.1155/2020/5053407]

-

F. Zhuang, Z. Qi, K. Duan, D. Xi, Y. Zhu, H. Zhu, H. Xiong, and Q. He, "A comprehensive survey on transfer learning", Proceedings of the IEEE, Vol. 109, No. 1, pp. 43-76, Nov. 2020.

[https://doi.org/10.1109/JPROC.2020.3004555]

-

J. Deng, W. Dong, R. Socher, L. J. Li, K. Li, and L. Fei-Fei, "Imagenet: A large-scale hierarchical image database", in 2009 IEEE conference on computer vision and pattern recognition, Miami, FL, USA, pp. 248-255, Jun. 2009.

[https://doi.org/10.1109/CVPR.2009.5206848]

-

A. Howard, M. Sandler, G. Chu, L. C. Chen, B. Chen, M. Tan, W. Wang, Y. Zhu, R. Pang, V. Vasudevan, Q. V. Le, and H. Adam, "Searching for mobilenetv3", Proceedings of the IEEE/CVF international conference on computer vision, pp. 1314-1324, Seoul, Korea, Oct. 2019.

[https://doi.org/10.1109/ICCV.2019.00140]

- Nvidia Jetson Nano Developer Kit, https://developer.nvidia.com/embedded/jetson-nano-developer-kit, [accessed: Apr. 24, 2024]

- Open Neural Network Exchange, https://onnx.ai/, [accessed: Apr. 24, 2024]

2019년 8월 : 전남대학교 지구환경과학부(이학학사)

2019년 9월 ~ 현재 : 전남대학교 지능전자컴퓨터공학과(석박통합과정수료)

관심분야 : 인공지능, 설명가능한 인공지능, 지식증류

2022년 8월 : Saigon University(공학학사)

2022년 9월 ~ 현재 : 전남대학교 지능전자컴퓨터공학과 석사과정

관심분야 : 디지털신호처리, 영상처리, 머신러닝, 딥러닝

2015년 2월 : 전남대학교(공학학사)

2023년 ~ 현재 : 전남대학교 지능전자컴퓨터공학과 석사과정

관심분야 : 디지털신호처리, 영상처리, 머신러닝, 딥러닝

2022년 8월 : Saigon University(공학학사)

2022년 9월 ~ 현재 : 전남대학교 지능전자컴퓨터공학과 석사과정

관심분야 : 디지털신호처리, 영상처리, 머신러닝, 딥러닝

2015년 2월 : 동신대학교(공학학사)

2023년 ~ 현재 : 전남대학교 지능정보융합학과 석사과정

2001년 ~ 현재 : ㈜리눅스아이티 대표

관심분야 : 농업시스템, 영상처리, 머신러닝, 딥러닝

1986년 2월 : 서울대학교 전자공학과(공학학사)

1988년 2월 : 서울대학교 전자공학과(공학석사)

1994년 8월 : 서울대학교 전자공학과(공학박사)

1995년 3월 ~ 현재 : 전남대학교 지능전자컴퓨터공학과 교수

관심분야 : 디지털 신호처리, 영상 처리, 머신러닝, 딥러닝