ELECTRA 기반 텍스트 증강 기법을 활용한 회계 데이터 분류 모델 개발

초록

국내 미디어 기업의 연구개발 및 기술 혁신을 활성화하기 위해 정부는 ICT 기금을 조성하여 다양한 지원을 하고 있다. 그러나 ICT 기금과 관련한 연구는 주로 기금의 징수 범위에 대한 논의에 집중되어 왔고, 기금의 집행내역에 대한 회계 감사의 효율화나 투명성 확보 방안은 연구되지 않았다. 현재 ICT 기금 집행내역에 대한 감사는 수작업으로 이루어져 효율성이 낮으며 인적 오류로 인해 정확성에서도 한계가 있다. 본 연구는 이를 해결하기 위해 ICT 기금 집행내역을 정상집행과 오집행으로 자동 분류하는 AI 기반 회계 분류 모델을 개발하였으며 불균형 데이터 문제를 해결하기 위해 텍스트 증강기법으로 ELECTRA Tagging을 제안한다. 실험 결과, 기존 증강기법 대비 오집행 분류 성능(Recall, F1-score)이 향상되어, 본 연구의 제안모델은 ICT 기금 회계 감사 과정에 있어서 효율성과 투명성을 제고할 수 있는 기법이 될 수 있을 것으로 기대된다.

Abstract

The media industry is rapidly transforming, with platforms like Netflix and YouTube exerting strong influence on the Korean market. While the ICT Fund supports industry innovation, prior research has focused mainly on levy expansion, lacking measures to improve post-execution auditing. Currently, ICT Fund expenditures are manually reviewed, resulting in inefficiencies. This study proposes an AI-based accounting classification model to automate the categorization of ICT Fund spending. To address severe class imbalance, we introduce ELECTRA Tagging, a text augmentation method based on ELECTRA’s RTD structure. Experimental results show improved Recall and F1-score for detecting disallowed expenditures, demonstrating the method’s practical value for enhancing auditing efficiency and transparency.

Keywords:

ELECTRA, ELECTRA tagging, ICT funds, class imbalance, text augmentation, media industryⅠ. 서 론

글로벌 미디어 산업은 인공지능(AI), 빅데이터, 클라우드 등 첨단 소프트웨어 기술을 기반으로 한 디지털 전환(DX, Digital Transformation)이 가속화되면서 구조적 변화를 겪고 있다[1]. 코로나19 팬데믹 이후 비대면 콘텐츠 소비가 급증함에 따라 넷플릭스와 유튜브와 같은 글로벌 플랫폼의 영향력이 확대되었고, 이는 국내 OTT 시장 및 온라인 광고 시장의 경쟁 구도에 큰 영향을 미치고 있다[2][3].

정부는 방송통신발전기금과 정보통신진흥기금으로 구성된 ICT 기금을 재원으로 국내 미디어 산업의 기술 개발 및 산업 활성화를 지원해왔다. 두 기금은 주파수라는 공공자원의 이용 대가로 조성되어 방송과 통신산업 발전에 기여했으나, OTT 등 주파수를 이용하지 않는 새로운 서비스가 등장하면서 징수 및 지원대상에 대한 재논의가 이루어지고 있다[4]. 또한 글로벌 플랫폼의 시장 지배력 확대 등 산업의 위기로 인해 ICT 기금의 활용 방식, 투명성, 공정을 개선해야 한다는 사회적 요구도 제기되고 있다[5].

그럼에도 기존 연구는 OTT 사업자에 대한 기금 부과, 징수율 개편 논의에 집중되어 왔으며[5][6], ICT 기금의 집행과정을 실제 분석하거나 관련 방안을 제시한 연구는 부재한 상황이다. 현재 ICT 기금으로 지원되는 사업의 감사 과정은 수작업으로 수행되어 업무 부담, 분석의 주관성, 시간 소모 등의 비효율성이 발생하며, 인적 오류(Human error)로 감사 품질을 담보하기 어려운 한계가 있다. 이에 본 연구는 ICT 기금 집행 내역의 정상집행과 오집행 여부를 자동으로 분류하는 AI 기반 분류 모델을 개발함과 동시에 이를 위한 텍스트 증강 기법으로 ELECTRA Tagging 기법을 제안한다.

기존 회계 분류 모델이 주로 긴 문장의 텍스트를 벡터화하여 주요 키워드를 추출하는 기법(TF-IDF, LDA, Word2Vec)을 사용한 반면, ICT 기금 데이터는 짧은 텍스트이기에 문장의 주요 벡터를 도출하는 것이 제한적이다[7][8]. ELECTRA Tagging 기법은 ELECTRA의 Generator와 Discriminator 구조를 활용하여 토큰 단위의 문맥 적합성을 판단하고, 이를 기반으로 증강 기법을 결정하여 기존 텍스트 증강 기법이 갖는 무작위성을 최소화한다.

본 연구는 학술적으로 짧은 문장에 적합한 텍스트 증강기법으로 ELECTRA Tagging 기법을 새롭게 제안하였다. 그리고 ELECTRA의 RTD와 NER 기법을 접목한 텍스트 증강 기법을 개발함으로써 텍스트 증강의 방향성을 확장하였다. 실무적으로 본 연구는 ICT 기금 집행 내역을 대상으로 AI 분류 모델을 개발하여 감사 효율성 및 투명성 제고, 정확성 개선에 기여할 것으로 기대된다.

본 논문의 구성은 다음과 같다. 2장에서는 ICT 기금과 텍스트 증강 기법의 발전 과정을 다루고, 3장에서는 본 연구에서 제안하는 ELECTRA Tagging 기법을 소개한다. 4장과 5장에서는 각각 연구 방법과 실험 결과를 제시 및 분석하며, 6장에서는 결론과 시사점, 향후 연구 방향을 제시한다.

Ⅱ. 관련 연구

2.1 미디어 산업의 특수성과 ICT 기금 운용

과학기술정보통신부는 방송통신발전기금과 정보통신진흥기금을 조성하여, 방송 및 통신 산업의 연구개발, 인력 양성, 미디어 지원 등에 활용하여 왔다[9]. 방송통신발전기금은 1980년대 ‘공익자금’에서 출발하여 방송과 통신의 융합에 따라 재편되었으며, 정보통신진흥기금은 정보통신 기술 개발과 산업 기반 조성을 목적으로 조성되었다. 이 두 기금은 2015년부터 ICT 기금이라는 이름으로 한국방송통신전파진흥원(KCA)이 관리 및 운용하고 있으며 2025년 기준 연간 1조 6천억원 규모의 예산을 지원하고 있다[4][5].

방송통신발전기금과 관련한 선행연구에서는 징수 주체 조정, 재원 배분 구조 개선, 기금 평가 제도 정립 등 다양한 개선방안이 논의되었으나, 논의의 초점은 주로 플랫폼 사업자에 대한 징수 주체 조정에 집중되어왔다[6][10]. 반면에 기금 집행의 적절성을 평가할 수 있는 모델을 제시한 연구는 없었다.

이에 본 연구는 ICT 기금의 집행 적절성을 감사 단계에서 활용할 수 있는 모델을 텍스트 증강 기법과 함께 제안하고자 한다.

2.2 이벤트 탐지 분야의 텍스트 증강

이벤트 탐지(Event detection)는 텍스트 내에서 특정 사건의 발생을 나타내는 단어를 식별하고 해당 유형을 분류하는 자연어처리 분야로, 데이터 클래스 부족 문제가 발생할 수 있다. 이러한 문제를 보완하기 위해 텍스트 증강 기법이 활용되고 있으며, 기존 연구에서는 증강 수준에 따라 문장 수준(Sentence-level) 증강과 단어 수준(Word-level) 증강으로 구분하여 접근하였다[11]. 단어 수준 증강은 말뭉치 기반 방식과 사전학습 언어모델 기반 방식으로 구분할 수 있다. 본 연구에서는 단어 수준 증강을 살펴본 후 ELECTRA Tagging 기법을 제안하고자 한다.

말뭉치 기반 방식 중 가장 많이 활용되는 EDA(Easy Data Augmentation)는 단어 삽입, 삭제, 치환, 유의어 교체 등 단순한 연산을 통해 문장을 변형하는 기본적인 단어 수준 증강 기법이다[12].

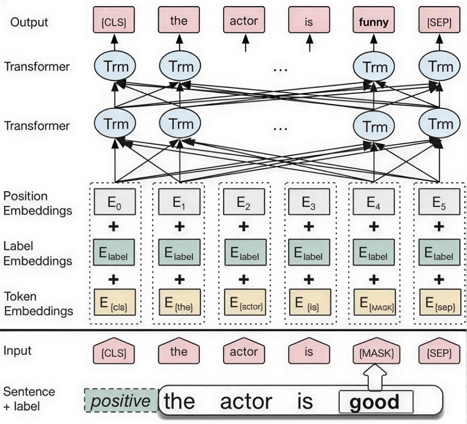

사전학습 언어모델 기반 텍스트 증강은 대규모 말뭉치로 사전학습된 언어모델을 활용하여 새로운 텍스트를 생성하는 방식이다. 이중 대표적인 예시로 MLM(Masked Language Model) 기반 증강 기법을 들 수 있다. MLM 기반 증강은 그림 1과 같이 BERT 등의 모델을 활용하여 문장 내 일부 단어를 [MASK]로 치환한 뒤, 문맥에 적합한 단어를 예측 및 대체하는 방식으로 이루어진다[13].

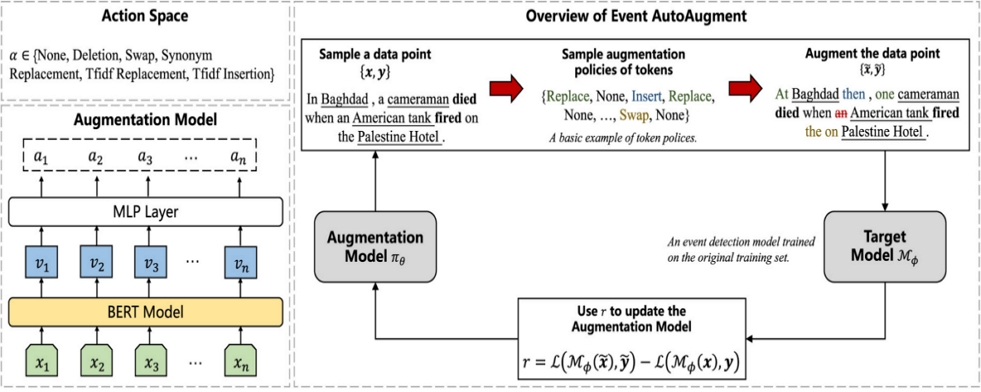

선행연구에서는 말뭉치 기반 방식과 사전학습 언어모델의 무작위성을 지적하며, 이를 보완하기 위해 MLM 기반 증강과 강화학습(RL, Reinforcement learning)을 결합한 EAA(Event Auto Augment)를 제안하였다[11]. EAA는 그림 2와 같이 토큰별 증강 기법을 자동으로 선택하고 증강 전후의 손실을 비교하여 품질이 향상된 텍스트를 생성하는 방법이다. 그러나 이 방식은 강화학습 연산을 위해 자원소모가 크다는 한계를 지닌다.

본 연구는 MLM 기반 무작위성을 완화하고, 컴퓨터 자원을 절약하는 방법으로, ELECTRA의 RTD 구조와 개체명 인식 분야에서 활용되는 로컬 수준의 Tagging 기법을 결합한 ELECTRA Tagging을 제안하고자 한다.

2.3 개체명 인식 분야의 로컬 텍스트 증강

개체명 인식(NER, Named Entity Recognition)은 문서 내에서 의미를 지닌 단어나 구를 추출하고 해당 개체의 유형을 판별하는 자연어처리 분야로, 해당 분야에서도 텍스트 증강 연구가 이루어지고 있다[14]. 선행연구에서는 NER 분야의 증강 연구를 엔티티 처리 범위에 따라 글로벌(Global) 수준의 텍스트 증강과 로컬(Local) 수준의 텍스트 증강으로 구분하였다[14]. 로컬 수준의 텍스트 증강은 기존 문장에서 일부 토큰만을 선택하여 변형하는 방식으로 텍스트를 생성한다.

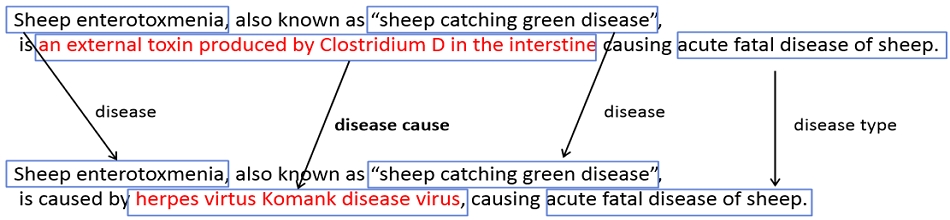

그림 3과 같이 템플릿 기반 치환 방식은 로컬 수준의 텍스트 증강 기법 중 하나이며, 동일한 엔티티 유형 간 치환을 통해 무작위성을 보완할 수 있다. 하지만 치환 결과로 문맥에 부적절한 텍스트가 생성될 경우, 이를 보완할 방안이 없다는 한계를 지닌다[15].

이를 보완하기 위해 본 연구에서는 ELECTRA RTD(Replaced Token Detection) 구조를 활용하여 문맥의 부적절성 등을 판별하고, 토큰 단위로 증강 기법(삭제, 유지, 교체)을 결정 및 적용하여 문장을 재생성하는 ELECTRA Tagging 기법을 제안하고자 한다.

Ⅲ. 제안 기법

3.1 ELECTRA

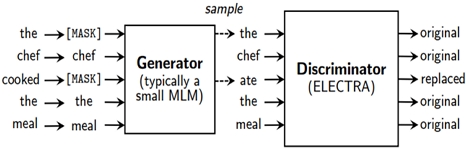

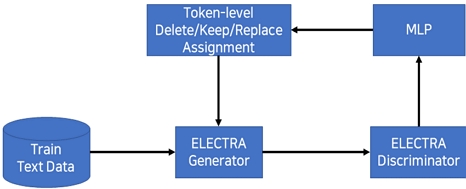

ELECTRA(Efficiently Learning an Encoder that Classifies Token Replacements Accurately)는 Transformer 인코더(Encoder) 기반의 사전학습 언어모델로, Generator(생성자)와 Discriminator(판별자)로 구성된다[16]. 그림 4와 같이 Generator가 토큰을 생성한다면 Discriminator가 각 토큰이 원본인지 대체된 것인지를 판별하면서 학습이 이루어진다.

3.2 ELECTRA tagging

ELECTRA Tagging은 ELECTRA의 RTD(Replaced Token Detection) 구조를 기반으로 각 토큰에 대해 유지·삭제·교체 중 적절한 증강 행동을 결정하는 텍스트 증강 기법이다. 전체 프레임워크는 그림 5에 제시되어있다.

입력 텍스트 X의 일부 토큰을 [MASK]로 치환한 뒤, ELECTRA Generator를 통해 각 마스킹 위치에 문맥적으로 적합한 토큰을 예측한다. 해당 과정은 식 (1)로 정의된다.

| (1) |

식 (1)에서 는 이전 토큰들이 주어졌을 때 해당 위치의 토큰이 생성될 확률을 의미한다. 는 Generator의 은닉층 벡터이며, WG는 해당 은닉 벡터가 출력될 때 지니는 가중치 행렬이다.

이 과정을 통해 [MASK]에 적합한 토큰()을 예측 및 삽입하여 새로운 텍스트(Xcorrupted)를 생성한다. 이는 식 (2)로 정의된다.

| (2) |

이후 생성된 텍스트는 Discriminator에 입력되어 각 토큰의 어색함 정도(Fake score)를 산출한다. 이는 식 (3)으로 정의된다.

| (3) |

식 (3)에서 는 생성된 텍스트가 주어졌을 때 Generator에 의해 대체된 토큰 확률을 의미한다. 는 Discriminator의 은닉층에서 추출된 은닉 벡터이며, WD는 이를 출력하기 위한 가중치 행렬을 의미한다. σ는 sigmoid 함수로 토큰의 판별 결과를 0과 1사이 확률값으로 변환한다.

식 (3)을 통해 생성된 와 Discriminator 은닉층 벡터()를 결합하여 MLP 입력 벡터(vt)를 구성한다. 이는 식 (4)와 같다.

| (4) |

MLP는 토큰별 증강 기법에 대한 확률 분포를 계산하며, 해당 과정은 식 (5)와 같이 정의된다.

| (5) |

식 (5)에서 W1, W2는 가중치 행렬이며, b1, b2는 편향 벡터를 의미한다. 또한 은닉층 과정 중에 σ는 RELU 함수를 활용하였으며, 출력층에서는 softmax 함수를 사용하였다.

이후 도출된 는 가장 높은 확률값을 지니는 행동(유지, 삭제, 교체)을 선택하며, 이는 식 (6)과 같다. 이 중에서 교체는 의미적으로 유사한 5개 후보 중 하나를 무작위 대체하는 것을 의미한다.

| (6) |

선택된 행동에 따라 토큰별 유지, 삭제, 교체가 적용된다. 마지막으로 토큰별 수정된 를 출력하며, 수정된 토큰끼리의 결합으로 새로운 텍스트(xaug)를 재생성한다. 이는 식 (7)과 식 (8)로 정의된다.

| (7) |

| (8) |

Ⅳ. 연구 방법

4.1 데이터

본 연구는 한국방송통신전파진흥원(KCA)이 제공한 2022년 ICT 기금 집행 내역 중 ‘지출비목’이 업무추진비인 자료를 분석 대상으로 사용하였다. 최종 데이터는 총 71,818건으로, 정상집행 70,757건과 불인정 1,061건이어서 불균형이 심한 것을 알 수 있다.

텍스트 변수 18개, 숫자 변수 11개를 주요 특성으로 선정하였고 전체 데이터는 학습, 검증, 테스트 세트로 8:1:1 비율로 분할하였다.

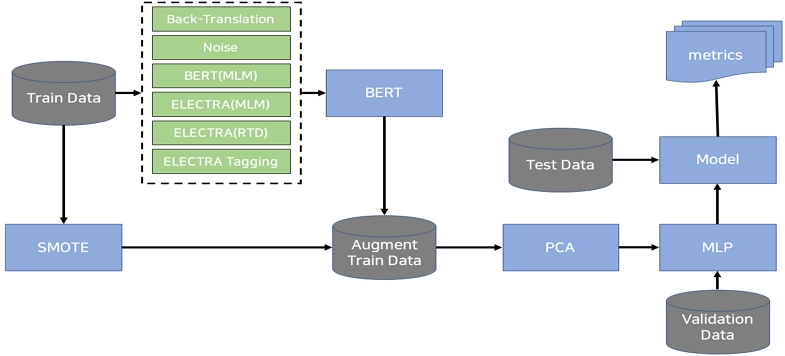

불인정 사례의 데이터 불균형을 완화하기 위해 텍스트 열에는 다양한 증강 기법(역번역, Noise, BERT(MLM), ELECTRA(MLM), ELECTRA(RTD), ELECTRA Tagging을 적용하고, 숫자열에는 SMOTE를 활용하였다. 증강 단계에서는 학습 데이터의 클래스 비율이 1:1이 될 때까지 증강하였다.

일부 카테고리형 변수는 값 변형 시 의미 왜곡 가능성이 있어 원본을 복제하였으며, 나머지 변수는 변형하여 활용하였다. 실험에 활용한 열은 표 1과 같으며, 색상이 있는 열은 원본을 변형하였으며, 없는 열은 원본을 복제하여 사용하였다.

4.2 분류 모델

텍스트 데이터는 모델 입력을 위해 벡터화가 필요하므로, 본 연구에서는 ‘KLUE/BERT-Base’ 모델을 활용하여 각 텍스트 열에서 [CLS] 벡터를 추출하고 이를 결합하여 임베딩 벡터를 구성하였다. 숫자 열은 MinMax 정규화를 적용하였다. 그 후에 텍스트 벡터와 정규화된 숫자 데이터를 결합하여 딥러닝 모델의 입력으로 사용하였다.

각 텍스트 열에 대해 개별적으로 임베딩을 수행하면서 데이터 차원이 크게 증가하여, PCA를 적용하여 최종적으로 150차원으로 축소하였다[17]. 분류 모델로는 입력층과 출력층 사이에 은닉층을 갖는 MLP(Multilayer Perceptron)룰 사용하였다. 본 연구에서는 은닉층을 3개로 설정하여 정상집행과 오집행 사례를 분류하였다.

모델 학습에는 AdmW 최적화 함수(Optimizer)와 Focal Loss 손실함수(Loss function)를 사용하였다. AdamW는 파라미터 크기를 안정적으로 조절하고 과적합을 완화하는 데 효과적이다[18]. Focal Loss는 데이터 불균형이 심할 때 소수 클래스를 효과적으로 학습할 수 있다는 장점을 지닌다[19]. 학습률(Learning rate)은 0.001, 학습 횟수는 100 epoch, 드롭아웃 비율은 0.3으로 적용하였다. 또한 Validation Loss가 3회 연속 개선되지 않는 경우 학습이 종료되는 조기 종료(Early stopping) 조건을 설정하였다.

분석 모델의 지표로는 일반적으로 활용되는 정확도(Accuracy), 정밀도(Precision), 재현도(Recall), F1-score를 활용하였다.

본 연구의 실험 환경은 NVIDIA GeForce RTX 4070 SUPER GPU 1대를 탑재한 기기에서 시스템을 구축하였다. 분석은 Python 언어를 기반으로 Visual Studio Code 환경에서 수행하였으며, PyTorch 2.6.0와 CUDA 12.6을 설치하여 모델 학습 및 실험에 활용하였다. 전체 프레임워크는 그림 6과 같다.

Ⅴ. 실 험

본 연구에서는 ICT 기금 데이터의 텍스트 열에 다양한 증강 기법을 적용하고, 각 기법이 분류 모델 성능에 미치는 영향을 비교하였다. 오집행 사례는 0, 정상집행 사례는 1로 매핑하였다. 각 증강 기법별 분류모델의 성능 결과는 표 2에 제시하였다. 표에서 C는 Class, P는 Precision, R은 Recall, F1은 F1-score, A는 Accuracy를 의미한다.

표 2와 같이 모든 기법에서 정상집행(1) 클래스는 높은 분류 성능을 유지했지만, 소수 클래스인 불인정(0)에서는 기법 간 성능 차이가 나타났다. 이는 데이터 불균형 특성상 다수 클래스에 비해 소수 클래스가 극히 적기 때문으로 해석되며, 본 연구에서는 불인정 클래스를 중심으로 성능을 비교하였다.

무작위 변형 기법인 역번역(Back-Translation)과 노이즈(Noise)를 적용했을 때는 Recall이 각각 0.42, 0.37로 나타났다. BERT(MLM)은 Recall이 0.40으로 나타났다. ELECTRA(MLM)은 0.50으로 개선되었지만, Precision이 낮아져 BERT(MLM)과 F1-score는 같게 나왔다. ELECTRA(RTD)는 Precision 0.85로 가장 높았지만, Recall이 0.38으로 낮게 나왔다. 본 연구에서 제안한 ELECTRA Tagging은 Precision 0.71, Recall 0.52, F1-score 0.60으로 전체 기법 중 가장 높은 Recall과 F1-score를 기록하였다.

금융 및 회계 데이터와 같이 불균형이 심한 영역에서는 모델이 전체 사례를 얼마나 정확히 분류하는지보다 실제 오집행 사례를 누락 없이 찾아내는지가 더욱 중요하다[20]. 이러한 관점에서 Precision보다 Recall이 더욱 중요하다고 할 수 있으며, ELECTRA Tagging은 가장 높은 Recall과 F1-score를 달성하는 등 데이터 불균형과 짧은 문장 구조가 있는 텍스트 환경에서도 적용할 수 있는 증강 기법이라고 할 수 있다.

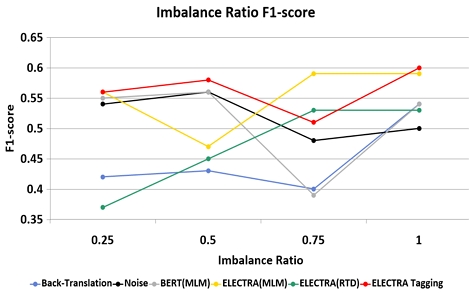

ELECTRA Tagging의 다양한 데이터 불균형 상황에서도 지표가 어떻게 변화하는지 측정하기 위해 다수 클래스와 소수 클래스의 비율에 변화를 주면서 추가 분석을 시행하였다. 추가 분석의 결과는 그림 7과 같다.

다수 클래스 대비 소수 클래스의 비율을 0.25, 0.5, 0.75, 1로 단계적으로 변화시키며 F1-score를 산출하였다. 그 결과, 데이터 불균형 비율이 0.25, 0.5, 1인 조건에서 상대적으로 높은 F1-score가 도출되었다. 반면, 0.75 조건에서는 ELECTRA Tagging의 성능이 다소 감소하는 경향을 보였다. 이는 소수 클래스의 비율이 일정 수준 이상 확보될 경우, 데이터 증강 방식에 따른 성능 차이가 점차 완화되기 때문으로 해석할 수 있다. 종합하면, ELECTRA Tagging 기법은 데이터 불균형 환경에서 특히 효과적으로 작동하며, 텍스트 데이터 증강 기법으로서의 활용 가능성이 크다는 점을 시사한다.

Ⅵ. 결론 및 향후 과제

본 연구는 ICT 기금 집행 내역의 텍스트 열을 대상으로 여섯 가지 텍스트 증강 기법을 적용하고, 소수 클래스인 ‘불인정’탐지 성능을 비교하였다.

역번역과 노이즈 기법은 짧은 문장 구조에서 의미 훼손이 발생하여 Recall이 낮게 나타났다[11]. 사전학습 언어모델인 BERT(MLM), ELECTRA(MLM)는 성능이 개선되는 것으로 나왔다. ELECTRA(RTD)는 높은 Precision을 보였지만 낮은 Recall을 보여 텍스트 증강 측면에선 한계를 보였다. 반면 본연구에서 제안한 ELECTRA Tagging은 Recall 0.52, F1-score 0.60으로 가장 우수한 성능을 보였고, 다양한 불균형 비율에서도 준수한 성능으로 나타났다. 이는 ELECTRA Tagging이 문맥을 고려한 토큰 단위 증강을 통해 학습에 적합한 텍스트를 생성하였고, 실제 회계 감사 절차에 활용할 수 있는 텍스트 증강 기법임을 시사한다.

본 연구는 학술적으로 짧은 문장 기반 텍스트에 적용할 수 있는 새로운 텍스트 증강 기법을 제안하였다. 또한 ELECTRA의 RTD 구조를 임베딩이 아닌 텍스트 증강으로 활용할 수 있는 방향성을 제시하였다[16]. 실무적으로 ICT 기금 집행 내역 중 ‘업무추진비’의 이상 집행 사례를 자동으로 탐지할 수 있는 모델을 제시함으로써, 감사 효율성과 투명성, 정확성 제고에 기여할 수 있다.

마지막으로 본 연구는 새로운 텍스트 증강 기법을 제안하였으나, 다음과 같은 한계를 지닌다. 첫 번째로 짧은 문장의 ICT 기금 데이터에 국한하여 장문 텍스트에 관한 검증을 하지 못하였다. 뉴스 기사 및 SNS 게시물 등 다양한 텍스트를 대상으로 한 검증이 요구된다. 두 번째로 GPU 자원 제약으로 강화학습 기반 증강 기법 등 비교 실험이 이루어지지 않았다. 향후 GPU 자원이 확보된다면 비교 실험 등으로 확장할 수 있을 것이다. 세 번째로 본 연구는 분석 대상을 ‘업무추진비’ 비목으로 한정하였으며, 성능 지표 또한 0.5~0.6 수준에 머물렀다는 한계를 지닌다. 성능 지표의 향상을 위해서는 환급가능한 부가가치세 대상 기업 정보의 확보, 정교한 데이터 입력 과정, 기금 목적 및 인력 정보 등 추가 변수의 확충이 필요하다.

Acknowledgments

본 연구는 제1저자의 석사학위논문(Development of an Accounting Data Classification Model Using ELECTRA-Based Text Augmentation Techniques)[21]을 기반으로 오집행 분류모델 등을 보완‧발전시켜 작성하였음.

References

-

S. Kim, S. Lee, and S. Choi, "A policy study on promoting global distribution of Korean broadcasting and media content through media platforms", Journal of Social Science Studies, Vol. 63, No. 2, pp. 53-81, Aug, 2024.

[https://doi.org/10.22418/JSS.2024.8.63.2.53]

- Korea Creative Content Agency, 2024 Online Video Service Usage Survey, Korea Creative Content Agency, Dec. 2024.

-

S. Lee, "A study on the impact of Netflix on the Korean content industry and media platform industry", Journal of Cultural Industry Studies, Vol. 24, No. 2, pp. 129-138, Jun. 2024.

[https://doi.org/10.35174/JKCI.2024.06.24.2.129]

- W. Choi, "Changes in the media ecosystem and issues in the imposition, use, and management of the Broadcasting and Communications Development Fund", Law and Policy, Vol. 30, No. 1, pp. 371-410, Mar, 2024.

- S. Yun, "Problems and improvements of the Broadcasting and Communications Development Fund system", Broadcasting Culture, No. 425, pp. 37-53, Jun. 2023.

-

G. Kim and J. Lee, "Exploration of advancement methods for collection rate calculation structure of the broadcasting license fees: Focused on the collection model of the Korea Communications Commission", Korean Journal of Broadcasting and Telecommunication Studies, Vol. 38, No. 1, pp. 5-35, Jan. 2024.

[https://doi.org/10.22876/kab.2024.38.1.001]

-

Y. Wang and W. Xu, "Leveraging deep learning with LDA-based text analytics to detect automobile insurance fraud", Decision Support Systems, Vol. 105, pp. 87-95, Jan. 2018.

[https://doi.org/10.1016/j.dss.2017.11.001]

-

L. Yu and J. Wang, "A data mining-based financial audit model for financial multi-type data processing and audit trail discovery", Systems and Soft Computing, Vol. 7, Art No. 200295, Dec. 2025.

[https://doi.org/10.1016/j.sasc.2025.200295]

- J. Park, B. Jang, S. Lee, S. Lee, S. Hong, M. Lee, K. Kwak, S. Kim, Y. Jung, J. Mo, M. Kim, and J. Song, Media Management 5.0 (Hardcover), Hanul Academy, Nov. 2021.

- D. Jung, "Improvement measures for the Broadcasting and Communications Development Fund system in the OTT era: Focusing on expanding the scope of fund contributors", Broadcasting Culture, No. 422, pp. 164-187, Sep. 2020.

-

J. Gao, H. Zhao, W. Wang, C. Yu, and R. Xu, "Event AutoAugment: Word-level data augmentation for textual event detection", Expert Systems with Applications, Vol. 288, Art. No. 127740, Sep. 2025.

[https://doi.org/10.1016/j.eswa.2025.127740]

-

J. Wei and K Zou, "EDA: Easy data augmentation techniques for boosting performance on text classification tasks", arXiv preprint arXiv:1901.11196, , Jan. 2019.

[https://doi.org/10.18653/v1/D19-1670]

-

X. Wu, S. Lv, L. Zang, J. Han, and S. Hu, "Conditional BERT contextual augmentation", International Conference on Computational Science, pp. 84-95, Jun. 2019.

[https://doi.org/10.1007/978-3-030-22747-0_7]

-

Y. Huang, Y. Gao, and C. Ren, "A survey of data augmentation in named entity recognition", Neurocomputing, Art No. 130856, Oct. 2025.

[https://doi.org/10.1016/j.neucom.2025.130856]

-

L. Wang and L. Zhao, "Research on Chinese animal disease text named entity recognition based on data augmentation", Artificial Intelligence Technologies and Applications, IOS Press, pp. 1119-1126, 2024.

[https://doi.org/10.3233/FAIA231415]

-

K. Clark, M.-T. Luong, Q. V. Le, and C. D. Manning, "ELECTRA: Pre-training text encoders as discriminators rather than generators", arXiv preprint, arXiv:2003.10555, , Mar. 2020.

[https://doi.org/10.48550/arXiv.2003.10555]

-

H. Abdelmotaleb, C. McNeile, and M. Wojtyś, "A comparative study of word embedding techniques for classification of star ratings", Expert Systems with Applications, Art No. 129037, Feb. 2025.

[https://doi.org/10.1016/j.eswa.2025.129037]

-

M.-J. Kim, J.-B. Park, and H.-J. Cho, "Development of a deep learning-based dog skin disease diagnosis model using RandAugment and Patterned-GridMask", The Transactions of the Korean Institute of Electrical Engineers, Vol. 74, No. 1, pp. 142-148, Jan. 2025.

[https://doi.org/10.5370/KIEE.2025.74.1.142]

- T.-Y. Lin, P. Goyal, R. Girshick, K. He, and P. Dollár, "Focal loss for dense object detection", Proc. IEEE Int. Conf. Comput. Vis. (ICCV), Venice, Italy, pp. 2980-2988, Oct. 2017.

-

J. Chung and K. Lee, "Credit card fraud detection: An improved strategy for high recall using KNN, LDA, and linear regression", Sensors, Vol. 23, No. 18, Art No. 7788, Sep. 2023.

[https://doi.org/10.3390/s23187788]

-

J. P. Jeon, "Development of an Accounting Data Classification Model Using ELECTRA-Based Text Augmentation Techniques", M.S. thesis, Pukyong National University, Busan, South Korea, 2026.

[https://doi.org/10.14801/jkiit.2026.24.3.23]

2024년 8월 : 국립부경대학교 미디어커뮤니케이션학과(문학사)

2026년 2월 : 국립부경대학교 미디어커뮤니케이션학과(공학석사)

관심분야 : 자연어처리, 텍스트마이닝, 소셜미디어, 데이터시각화

2023년 8월 : 국립부경대학교 미디어커뮤니케이션학과(문학사)

2025년 2월 : 국립부경대학교 미디어커뮤니케이션학과(공학석사)

관심분야 : 개인화 알고리즘, 자연어처리, 소셜미디어

2003년 2월 : 연세대학교 전기전자공학부(공학사)

2005년 2월 : 서울대학교 전기컴퓨터공학부(공학석사)

2017년 2월 : 연세대학교 정보대학원(정보시스템학박사)

2022년 3월 ~ 현재 : 국립부경대학교 미디어커뮤니케이션학부 조교수

관심분야 : 데이터사이언스, 개인화 알고리즘, 디지털미디어, 소셜미디어