Dual-MAB 기반 분산 LoRa 랜덤 액세스 제어: 저지연 초밀집 네트워크의 사용자 비대칭성 대응

초록

대규모 LoRaWAN 환경에서는 노드의 고밀집도로 인한 심각한 패킷 충돌과 노드 위치에 따른 Near-Far 비대칭 링크 문제가 통신 성능을 크게 저하시킨다. 이를 해결하기 위해, 본 논문은 중앙 서버의 개입 없이 노드 단말이 접속 제어(Access control)와 자원 선택(Resource selection)을 유기적으로 동시에 최적화하는 Dual-MAB 기반의 LoRa 랜덤 액세스 기법을 제안한다. 제안 기법은 네트워크 혼잡 상황을 노드가 스스로 인지하여 전송 지연 시간-백오프 윈도우(Wmax)-크기를 동적으로 조절하고, 전송 실패의 원인을 충돌과 링크 품질로 구분하는 차등 보상 체계를 적용하여 학습 효율을 극대화한다. 시뮬레이션 결과, 제안 기법은 기존 방식 대비 시스템 접속 성공률(ASR)을 약 2.1배, 원거리 노드 그룹 성능을 약 3배 향상 보였다. 이를 통해 극한의 혼잡 상황에서 패킷 성공률과 에너지 효율성(저지연성) 측면에서 효과가 있음을 확인할 수 있었다.

Abstract

In large-scale LoRaWAN environments, high node density and Near-Far asymmetry significantly degrade random access performance. This paper proposes a Dual-MAB-based LoRa random access scheme that not only optimizes Access Control but also Resource Selection without a central server. The scheme allows nodes to predict congestion and adjust the backoff window (Wmax), while applying a differential reward system based on the cause of failure (collision or link quality). Simulation results show that the proposed scheme improves the ASR by 2.1 times and far-node performance by 3 times over benchmark methods, ensuring energy efficiency (low latency) under severe congestion.

Keywords:

LoRaWAN, dual-MAB, access control, resource selection, near-far imbalanceⅠ. 서 론

사물인터넷(IoT) 수요의 급증으로 저전력, 장거리 통신 네트워크 LPWAN(Low-Power Wide Area Network)는 4차산업혁명의 여러 분야에서 핵심 연결 기술로 활용되고 있다[1][2]. LPWAN 유형의, LoRaWAN은 저전력 슬롯(Time-slotted) 통신을 지원한다[3].

LoRaWAN의 LoRa 물리계층 기술은 ALOHA 기반 uplink 랜덤 접속 방식을 사용한다. 노드 밀집 환경에서는 패킷 충돌 증가와 간섭 현상으로 재전송이 빈번하게 발생한다[3][4]. 이러한 혼잡과 무선 채널의 불안정성을 해결하기 위해 효과적인 랜덤 접속 제어 연구가 필요하다.

LoRaWAN 선행 연구[5][6]는 LoRa 전송 변수를 제어하여 PHY 계층 링크 품질 변화에 적응(Link adaptation)하는 성능에 집중되어 있다. 즉, LoRa 전송 변수(SF, Spreading Factor), 전송전력(TP, Transmit Power) 선택을 동적으로 제어하여 네트워크 패킷 성공률 향상 가능성을 보였다. 하지만, 최근 고밀도 무선 네트워크 환경에서 대규모 접속(Massive access) 경우 랜덤 패킷 충돌 문제와 물리적으로 한정된 자원 할당 문제를 지원하기 위해 기지국이 접속 차단 확률(Barring rate)을 단말에 방송하여, 단말이 접속 시도 전 확률적으로 전송을 지연 함으로써 혼잡을 제어하는 ACB(Access Class Barring) 기술이 3GPP에서 연구되고 있다[6]. 하지만, LoRa 시스템 환경에서 ACB의 효과성은 상대적으로 조사되지 않았다. 하향링크 용량이 제한적인 LoRaWAN에 중앙 기지국의 제어 메시지 의존도가 필요한 ACB를 직접적으로 적용하는 것은 한계가 있다[3][7]. 따라서 제한적인 피드백 환경에서 노드 주도의 최적화가 가능한 강화학습 활용 대안이 제시된다[6][8].

본 논문은 분산형 강화학습 활용하여 LoRa 랜덤 접속 제어 기술 개발을 제안한다. 구체적으로, 중앙 서버의 개입 없이도 분산된 노드가 자율적으로 자신의 랜덤 접속 신호의 경험을 기반으로 물리계층과 다중 접속 신호를 동시에 제어하기 위한 정책을 최적화하는 기술을 개발한다. 이를 위해 분산된 각 노드는 로컬 환경에서 두 개의 MAB(Multi-Armed Bandit) 알고리즘을 결합한 Dual-MAB 구조를 설계한다. MAB는 에이전트가 제한된 정보에서 여러 선택지(Arms) 중 보상을 최대화할 수 있는 최적의 선택을 탐색(Exploration)과 활용(Exploitation)의 균형을 통해 찾아나가는 통계적 학습 모델이다[9]. 본 논문은 MAB 구조를 활용하여, 두 개의 MAB 에이전트가 각각 LoRa의 동적 자원 선택 문제와 ACB의 backoff window(Wmax) 크기를 결정하도록 설계하여 로컬 환경에 능동적으로 적응하는 랜덤 접속 전략을 도출한다. 이는 노드의 물리적 링크 상태와 네트워크 혼잡을 동시에 고려하여 충돌을 제어하고, 패킷 전송 성공률(ASR, Average Success Rate) 향상을 목표로 한다.

본 논문의 정리된 주요 기여도는 다음과 같다. (1) 고밀도 네트워크 환경에서 분산된 노드에서 분산 강화학습 기반 저지연 LoRa 랜덤 접속 제어 구조를 설계함; (2) 비대칭 네트워크 환경으로 near user group과 far user group을 고려하여, 분산형 다중 에이전트 Dual-MAB 구조를 제안하고 LoRa 랜덤 접속에 적용함. 노드당 최적 backoff window 크기와 이에 따른 최적의 동적 SF 선택 제어 전략을 탐구하는 알고리즘을 제안함; (3) LoRa 기반 랜덤 접속 시뮬레이션 결과를 도출함. 기존 정적 ACB 기반 LoRa 랜덤 접속 기술 대비, 제안된 Dual-MAB 기반 저지연 LoRa 랜덤 접속 기술의 ASR 지표 우수성을 성공적으로 보임. 또한, 제안된 기술은 동적 SF 선택과 충돌 제어 전송 시간을 동시에 노드에서 학습하여 massive access의 혼잡 환경에서 성공률(ASR) 증가시키고, 특히, near-far 그룹별 성능 편차를 정량적으로 감소시켜 Dual-MAB 효과성을 확인하였다.

Ⅱ. 시스템 모델

2.1 네트워크 및 트래픽 모델

본 연구에서는 단일 게이트웨이(GW)와 N개의 노드로 이루어진 LoRaWAN 스타 토폴로지를 대상으로 한다. 특히, N개의 노드는 기지국과의 거리 차이에 따라 비대칭 배치 조건(Near-Far user group asymmetric condition)을 갖고, 이에 따라 평균 SNR이 SNRn인 근거리(Near) 노드 그룹과 평균 SNR이 SNRf인 원거리(Far) 노드 그룹으로 구분하였다. 노드는 GW와 이산 슬롯 단위로 통신한다. 이때 슬롯은 시스템 내 가장 긴 전송 시간(Time-on-Air)을 갖는 SF12 패킷을 수용할 수 있는 길이로 정의된다. 각 노드의 트래픽은 슬롯 단위의 베르누이 과정(Bernoulli process)을 가정하여 매 슬롯 확률 Ptx의 데이터 전송 의향(Intent)을 갖는다.

데이터가 전송 시 노드는 uniform 분포의 난수 u~U(0,1)을 발생한다. 공통으로 주어진 ACB의 차단 확률(Barring rate) b와 비교하여 만약 u ≥ b 경우 전송 시도(Attempt)를 하고, u < b 경우 다음 Wmax 슬롯 동안 전송을 지연한다. 전송 경우(u ≥ b), 각 노드는 채널 집합 C = [c1,...,cA]과 확산 계수(SF) 집합 S = [s1,...,sB]에서 하나의 자산 조합 (ci,si)을 선택하고 패킷 전송에 이용한다.

2.2 분산형 랜덤 접속 구조

각 노드는 매 전송 시 동적 지연시간 Wmax와 하나의 조합 (ci,si)을 선택하여 전송하는 전략을 서버 개입 없이 독립적으로 탐색한다. 이를 위해 이중 MAB(Dual-MAB) 학습 구조, Resource Selection-MAB 와 Backoff-MAB, 개발한다. 두 개의 MAB 학습 구조는 (ci,si)과 Wmax 선택을 각각 학습한다.

(1) Resource Selection-MAB: 총 AB개 LoRa 변수 조합 중 하나 (ci,si)을 선택하는 행위를 action으로 정의한다. 각 노드에서 분산형 MAB 활용하여 반복적인 action 선택과 그에 따른 보상을 측정한다. 매 슬롯 전송 시 주어진 랜덤 접속 환경에서 충돌과 간섭 신호 속에 패킷 수신 확률을 높이는(보상율이 높은) action을 선택하는 전략을 학습한다.

(2) Self(-backoff) ACB MAB: 공통으로 주어진 차단 확률 b의 환경에서, backoff 슬롯 길이 상한값 Wmax을, e.g.,Wmax∈{1, 2, 4, 8, 16}, 각 노드의 비대칭 환경의 동적 변화에 적응하도록 선택하는 전략을 학습한다. 이를 목적으로 다른 하나의 MAB를 설계하여 최적의 Wmax(ACB action) 값을 탐색한다. 이는 비대칭적인 혼잡 네트워크 조건에서 각 노드가 차단 시(u < b) 전송 지연 시점을 학습하여 능동적으로 충돌 제어 및 패킷 지연을 최소화한다.

노드-게이트웨이 링크 모델은 Pathloss와 Rayleigh 페이딩 채널 모델을 고려한다[7]. 수신된 패킷 성공 여부는 SF별 수신 감도(Sensitivity)와 캡처 효과(Capture Effect), e.g., 6dB, 고려하여 판정한다[10].

Ⅲ. Dual-MAB 기반 랜덤 접속 알고리즘

본 장에서는 분산형 랜덤 접속 제어(Access control)와 자원 선택(Resource selection) 전략을 탐색하는 Dual-MAB 기반 학습 구조 및 알고리즘 제안한다.

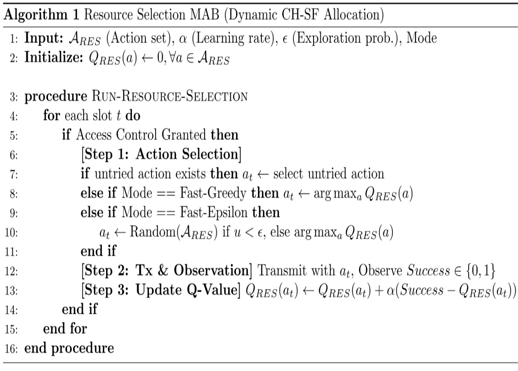

3.1 자원 선택 MAB

LoRa 자원 선택하는 MAB 과정은 알고리즘 1에 정리 하였다. 예로, AB=18개의 자원 조합 중 전송 성공률을 극대화하는 파라미터 조합 (ci,si)을 선택할 수 있는 전략을 학습한다. 즉, 패킷 손실 비용이 큰 통신 환경을 고려하여, 초기 탐색 이후에는 무작위 탐색을 배제하고 기대 성공률(QRES)이 가장 높은 행동을 선택하는 Fast-Greedy 전략 사용하여 빠른 수렴을 유도한다. 전송에 따른 보상 값 (Success ∈ {0, 1})는 비정상(Non-stationary) 환경 적응을 위해 지수 이동 평균(EMA) 방식으로 갱신되며, 접속 제어에 의해 차단(Barred)된 경우에는 학습 데이터 편향 방지를 위해 갱신을 생략한다.

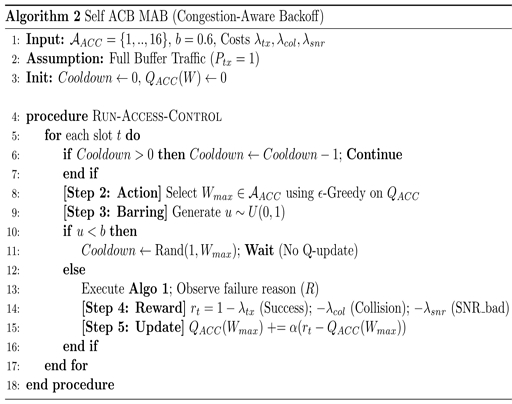

3.2 자가 ACB 제어 MAB

각 노드에서 전송 차단 시(u < b), 로컬 환경에 적합한 백오프 슬롯 길이 Wmax값을 반복적으로 선택하여 ACB 지연 시간을 자가 최적화 하는 MAB(Self-MAB) 단계는 알고리즘 2에 정리 하였다.

각 전송 슬롯에서 노드는 먼저 공통 차단 확률 b의 Barring 과정을 거쳐 전송 차단 여부를 결정하며, 차단 시에는 ϵ-Greedy 정책으로 선택된 백오프 슬롯 길이(Wmax) 기반으로 전송 지연 시간을 지나서 재전송 시도를 한다. 이는 자체적으로 재전송 주기를 제어하여 네트워크의 혼잡을 분산적으로 제어하여 효과를 가져온다. 이는 전체적인 패킷 전송 지연성 향상에 기여한다.

또한, 전송 시 본 기법의 핵심은 전송 실패 원인 분류를 통해 차등 보상(rt) 적용이다. 성공 시 양의 보상(λtx)을 부여하나, 충돌이나 캡처 효과로 인한 실패 시에는 강한 페널티(λcol)를 부여한다. 이는 차단 시 백오프 슬롯 지연 길이 확장을 유도한다. 반면, SNR 부족은 링크 품질 문제이므로 상대적으로 약한 페널티(λSNR)를 적용하여 불필요한 전송 지연을 방지한다.

Ⅳ. 모의 실험 결과 및 분석

컴퓨터 시뮬레이터를 통해 Dual-MAB 성능을 검증하였다. 고밀도 네트워크 혼잡 상태에서 패킷 성공률(ASR)과 처리량(Throughput)을 주요 성능 지표로 측정하였다.

4.1 실험 환경 및 파라미터

단일 게이트웨이와 N=54개 노드가 배치된 LoRaWAN 환경을 가정한다. 물리 계층의 A=3개 채널과 B=6개 확산 계수(SF7~SF12)를 사용한다. 다중 접속의 지연성 제어를 위한 Wmax 는 {1, 2, 4, 8, 16, 32} 중 선택한다. 시뮬레이션 정보는 표 1과 같다.

성능 비교 위해 benchmark 기술로 ACB 부재 LoRa RA 방식을 Classic 방식으로 표기한다. Classic 방식은 충돌 회피를 위한 지연 제어성이 없는 상황(Wmax= 1)을 가정하여 성능 하한선으로 설정한다.

제안 기법은 학습 데이터 부족과 초기 시스템 붕괴 위험 간 트레이드오프를 고려하여 차단 확률 b를 0.35로 선정한다. 이는 사전 실험 통해 도출된 최적값으로, 약 65% 트래픽 허용 통해 MAB의 학습 효율성과 과부하에서 안정성 동시 확보한다.

4.2 결과 분석

표 2에 Dual-MAB의 학습 알고리즘으로 Fast-Greedy와 Fast-Epsilon 구현하여 저지연 LoRa 랜덤 접속 제어 기술의 성공률과 처리량 성능을 정리했다. Classic 기술은 LoRaWAN 과부하 환경에서는 무작위 탐험이 잦은 충돌을 유발해 성능이 낮다. 반면, 제안 기술의 Dual-MAB의 Fast-Greedy는 EMA를 통해 우수한 자원을 빠르게 선점하는 데 유리하다. 표 2에서 Fast-Greedy(44.2%)는 Fast-Epsilon(43.8%)와 유사한 성공률에서 높은 처리량(6.125 packets/slot)을 나타냈다. 표 2의 결과는 Fast-Greedy이용하는 Dual-MAB를 최종 제안 기법으로 채택하여 기존 Classic 시스템과 성능 비교한다.

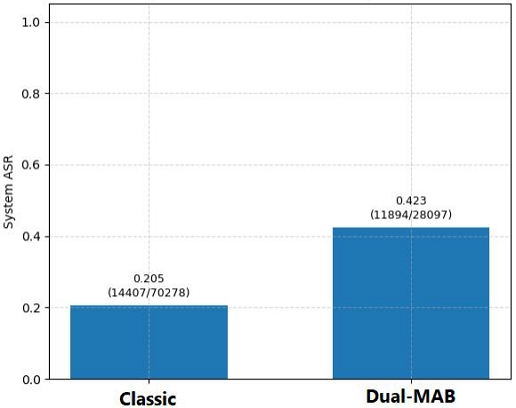

- Dual-MAB 기법의 효율성: 그림 1에서 보듯 Dual-MAB 기법은 기존 랜덤 액세스 대비 처리량을 증가시킨다. 고정된 파라미터로 인해 트래픽 변화에 취약한 기준 시스템(Classic)과 달리, 제안 기법은 b를 통해 트래픽 유입을 1차적으로 제어하고 최적 자원(CH, SF)을 2차 할당하여 충돌 확률을 이중으로 낮춘다. 실험 결과, 제안 기법은 42.3%의 ASR을 기록하여 기준 시스템(20.5%) 대비 2배 이상의 성능 향상을 달성하였으며, 이는 물리적 자원 증설 없이 지능적 분배만으로 네트워크 용량을 증가시켰다.

- 고밀도 네트워크 조건에서 안정성: 그림 1에서 보듯 시스템 용량을 초과하는 고밀도 네트워크 상황(평균적 3 node가 동일 자원 선택: N=54, A·B=18)에서도 Dual-MAB 기법은 기존 기술 대비 더 높은 성공률을 유지한다. Classic 시스템과 달리, Dual-MAB는 충돌 감지 시 백업 슬롯 지연 시간을 확장하여 스스로 부하를 분산시킨다. 특히 전송 전력 소모가 큰 IoT 환경[5]에서, 실패가 예상되는 시도를 사전 차단하는 것은 에너지 효율 유지에 필수적이다. 실험 결과, 기준 시스템(Classic)은 대다수 전송이 실패하여 성공률이 20.5%에 그쳤으나, 제안 기법은 약 35%의 차단 비율을 통해 부하를 효과적으로 조절하며 42.3%의 ASR을 유지하였다.

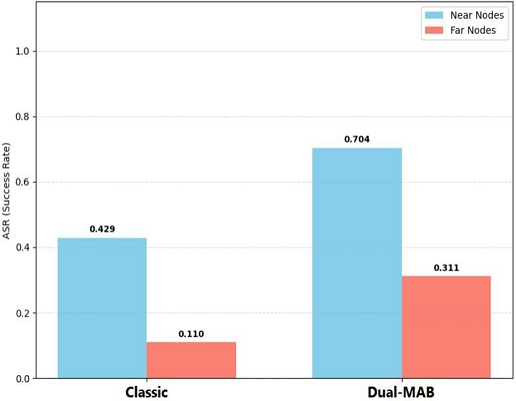

- 노드 비대칭성 대응: 그림 2에서 제안 기법은 LoRaWAN의 구조적 문제인 Near-Far 불균형(근거리 원거리 노드 성능 편차)을 효과적으로 해소한다. 그림2에서 기존 방식(Classic)은 캡처 효과로 인해 원거리(Far) 노드의 패킷이 지속적으로 소실되어 ASR이 10.95%에 불과하였다. 그러나 Dual-MAB 기법 적용 시, 원거리 노드는 충돌 실패를 인지하여 백오프를 수행하거나 충돌이 적은 자원(SF)으로 이동하는 전략을 학습함으로써, ASR이 31.98%로 약 3배(192%) 향상되었다. 이는 근거리 노드(Near)의 성능 향상(71.77%)과 동반된 결과로, 특정 그룹의 손실을 작게하여 네트워크 비대칭성 대응에 효과적임.

Ⅴ. 결 론

본 연구는 대규모 LoRa 랜덤 접속 환경을 고려하여 패킷 충돌 및 비대칭 Near-Far 노드 조건에서 발생하는 전송 지연성 제어 문제를 연구했다. Dual-MAB 알고리즘을 설계하고 모의실험을 통해 성능 분석을 하였다. 모의실험 결과, 기존 정적 방식 대비 접속 성공률(ASR)을 약 2.1배 향상시켰다. 이러한 성능 향상은 노드가 전송 실패의 원인을 충돌과 채널 품질 저하로 구분하여 보상하는 차등 보상 체계를 통해 학습 효율을 극대화했기 때문이다. 특히, 원거리 노드 그룹의 성능이 약 3배 향상된 점은 Dual-MAB 구조가 Near-Far 비대칭 환경에서 링크 불균형 문제를 효과적으로 해소했음을 시사한다. 이는 중앙 서버 개입 없이 노드가 로컬 네트워크의 혼잡도를 감지하여 Backoff 슬롯 시간을 동적 조절하고, LoRa 랜덤 접속 제어를 수행하여 성공률과 혼잡 제어의 효과성을 검증하였다. 향후 연구는 실제 LoRa 하드웨어 기반의 테스트베드 구축하여 제안 알고리즘의 실효성을 검증하고, 동적인 비정상(Non-stationary) 간섭 환경에 대한 적응성을 강화할 계획이다.

Acknowledgments

본 과제(결과물)는 2025년도 교육부 및 대전광역시의 재원으로 대전RISE센터의 지원을 받아 수행된 지역혁신중심 대학지원체계(RISE)의 결과입니다(과제관리번호: 2025-RISE-06-013)

References

-

E. Seo and J. Jang, "Analysis of transmission rate according to LoRaWAN communication distance", The Journal of The Institute of Internet, Broadcasting and Communication (IIBC), Vol. 19, No. 3, pp. 207-211, Jun. 2019.

[https://doi.org/10.7236/JIIBC.2019.19.3.207]

-

S. Mah and B. Kim, "LoRa Technology Analysis and LoRa Use Case Analysis By Country", The Journal of The Institute of Internet, Broadcasting and Communication (IIBC), Vol. 19, No. 1, pp. 15-20, Feb. 2019.

[https://doi.org/10.7236/JIIBC.2019.19.1.15]

-

F. Adelantado, et al., "Understanding the limits of LoRaWAN", IEEE Communications Magazine, Vol. 55, No. 9, pp. 34-40, Sep. 2017.

[https://doi.org/10.1109/MCOM.2017.1600613]

-

T. Polonelli, et al., "Slotted ALOHA on LoRaWAN-Design, Analysis, and Deployment", Sensors, Vol. 19, No. 19, Sep. 2019.

[https://doi.org/10.3390/s19040838]

-

A. Waret, et al., "LoRa throughput analysis with imperfect spreading factor orthogonality", IEEE Wireless Com. Letters, Vol. 8, No. 2, pp. 408-411, Apr. 2019.

[https://doi.org/10.1109/LWC.2018.2873705]

-

L. Acosta-Garcia, et al., "Dynamic transmission policy for enhancing LoRa network performance: A deep reinforcement learning approach", Internet of Things, Vol. 24, No. 100974, Dec. 2023.

[https://doi.org/10.1016/j.iot.2023.100974]

- 3GPP, "TS 22.011: Service Accessibility, Release 13", 3GPP, Dec. 2016.

-

Y. Ko and J. Choi, "Reinforcement Learning for NOMA-ALOHA Under Fading", IEEE Tran on Commu., Vol. 70, No. 10, pp. 6861-6873, Oct. 2022.

[https://doi.org/10.1109/TCOMM.2022.3198125]

- R. S. Sutton and A. G. Barto, "Reinforcement Learning: An Introduction", MIT Press, pp. 25-45, Oct. 2018.

-

D. Ron, C.-J. Lee, K. Lee, H.-H. Choi, and J.-R. Lee, "Performance Analysis and Optimization of Downlink Transmission in LoRaWAN Class B Mode", IEEE IoT Journal, Vol. 7, No. 8, pp. 7836-7847, Aug. 2020.

[https://doi.org/10.1109/JIOT.2020.2994958]

2025년 3월 ~ 현재 : 한남대학교 정보통신공학과 학부연구원

관심분야 : 머신러닝, 초밀도 네트워크, 분산 강화학습, LoRaWAN

2025년 3월 ~ 현재 : 한남대학교 정보통신공학과 학부연구원

관심분야 : 머신러닝, 지능형 네트워크, 강화학습, LoRaWAN

1997년 2월 : 충남대학교 전자공학과(공학사)

1999년 2월 : 충남대학교 의용전자공학(공학석사)

2021년 2월 : 충남대학교 컴퓨터공학과(공학박사)

2002년 3월 ~ 현재 : 한국항공우주연구원 책임연구원

관심분야 : 내장형 소프트웨어, 위성 통신, 심우주통신

1999년 2월 : 한남대학교 정보통신공학과(공학사)

2002년 12월 : 아리조나주립대학교 전기공학과(공학석사)

2006년 12월 : 아리조나주립대학교 전기공학과(공학박사)

2025년 3월 ~ 현재 : 한남대학교 정보통신공학과 부교수

관심분야 : DTN, UDN, 6G TN/NTN, 자율 지능형 Ad-hoc 네트워크, 위성 IoT