이미지 디블러링을 위한 이중 경로 분할 정복 신경망

초록

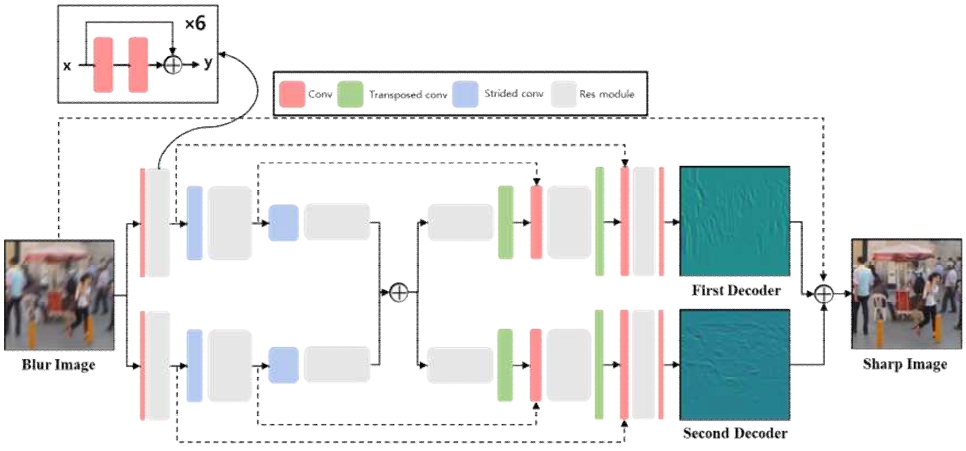

최근 딥러닝 기반 이미지 디블러링 방법들은 일반적으로 단일 인코더–디코더 구조를 사용하지만, 다양한 방향의 블러 성분에 대한 구조적 특징을 복원하는 데 한계가 있다. 이를 해결하기 위해 본 논문에서는 이중 경로 분할 정복(Dual-Path Divide-and-Conquer) 기반의 DPDC-Net을 제안한다. 제안된 모델은 수직 및 수평 방향의 이미지 특징을 각각 추출하는 두 개의 인코더와, 이를 재구성하여 이미지를 복원하는 두 개의 디코더로 구성된다. 또한, 두 방향의 인코더와 디코더 간에 파라미터를 공유함으로써, 단일 인코더-디코더 모델과 동일한 파라미터 수를 유지하면서도 수직 및 수평 방향의 구조적 특징을 효과적으로 학습한다. 다양한 실험을 통해서 제안하는 DPDC-Net은 GoPro 데이터셋에서 가장 최근 방법인 MRDNet 대비 PSNR이 0.15 dB, SSIM이 0.0024 향상된 성능을 보였다.

Abstract

Recent deep learning-based image deblurring methods typically adopt single encoder-decoder architectures. However, they struggle to effectively restore structural features when blur occurs in multiple directions. To address this limitation, we propose a novel Dual-Path Divide-and-Conquer Neural Network (DPDC-Net). The proposed architecture consists of two encoders that extract vertical and horizontal features independently, and two decoders that reconstruct the image from these directional features. Furthermore, by applying a parameter-sharing strategy between the directional branches, DPDC-Net maintains the same number of parameters as conventional single-path models while achieving improved performance. Experimental results demonstrate that the proposed DPDC-Net outperforms the most recent method, MRDNet, on the GoPro dataset, with improvements of 0.15 dB in PSNR and 0.0024 in SSIM.

Keywords:

image deblurring, motion blur, convolutional neural network, CNN, encoder-decoderⅠ. 서 론

카메라의 흔들림이나 피사체의 움직임으로 인해 발생하는 모션 블러는 이미지의 품질을 저하시킬 수 있는 요인 중 하나이다. 이미지 디블러링(Image deblurring)은 이러한 움직임으로 발생한 블러를 제거하여 선명한 이미지를 복원하는 과정이다.

일반적으로 이미지 디블러링 문제는 식 (1)과 같이 정의된다:

| (1) |

x는 블러 이미지, y는 선명한 이미지, k는 블러 커널, n은 추가적인 랜덤 노이즈, *은 2차원 컨볼루션 연산을 나타낸다. 그러나 블러 이미지만 주어진 상황에서는 블러 커널, 원본의 선명한 이미지, 그리고 랜덤 노이즈 중 어느 하나도 알지 못하기 때문에, 완전한 정답(Ground-truth)을 직접 구하는 것은 공학적으로 매우 어려운 문제다. 따라서 이미지 디블러링은 여러 개의 해를 구하는 것이 가능한 대표적인 Ill-posed 역문제(Inverse problem)으로 간주되며, 이를 해결하기 위해서 최적의 해를 구하는 접근방법이 필요하다.

이미지 디블러링 방법은 크게 최적화 기반 방법과 학습 기반 방법으로 구분된다. 최적화 기반 이미지 디블러링 방법은 선명한 이미지와 블러 이미지 사이의 관계를 수학적으로 모델링하여, 블러 커널을 직접 추정하는 방법이다. 이 중에서 블라인드 이미지 디블러링 방법은 블러 커널에 대한 사전 정보 없이 블러 이미지를 입력으로 받아 커널을 추정하고, 이를 통해 선명한 이미지를 복원한다[1]. 반면, 논블라인드 이미지 디블러링 방법은 블러 이미지와 함께 블러 커널이나 블러 종류와 같은 추가적인 정보를 입력으로 받아 이미지를 복원한다[2].

그러나, 현실 세계에서 이러한 사전 정보를 획득하기 어려운 경우가 많아, 블라인드 디블러링 방법이 일반적으로 사용된다. 논블라인드 이미지 디블러링 방법은 블러 커널의 형태나 종류에 대한 정보가 주어지는 특정한 상황에서 활용된다. 그럼에도 불구하고, 블라인드 및 논블라인드 이미지 디블러링 방법들은 다양한 크기와 형태의 블러 커널을 정확히 추정하기 어렵고, 노이즈에 민감하다는 한계를 가지고 있다. 특히, 실제 환경에서는 블러의 형태가 복잡하고 비선형적이기 때문에 기존 방법들은 만족할 만한 복원 성능을 달성하는 데 한계가 존재한다.

최근 컨볼루션 뉴럴 네트워크(Convolutional Neural Network)의 발전으로 다양한 분야에서 많은 연구가 진행되고 있다[30]-[31]. 초기 학습 기반 방법은 뉴럴 네트워크를 활용하여 디컨볼루션 과정을 통해 입력 이미지로부터 블러 커널을 추정하는 접근을 시도하였다[3]. 반면, 최근 학습 기반 방법들 은 블러 커널을 직접 추정하는 대신, 블러 이미지와 그에 대응하는 선명한 이미지를 가지는 데이터셋을 이용하여 뉴럴 네트워크를 학습하는 방식으로 전환되었다[4]-[20]. 이와 같은 접근은 다양한 세기와 방향을 가지는 블러 특징들을 네트워크가 효과적으로 학습함으로써, 기존 방법들보다 더욱 우수한 복원 성능을 달성할 수 있었다.

기존 학습 기반 디블러링 방법들 중 하나인 DeepDeblur는 초기에는 낮은 해상도에서 대략적인 부분의 디블러링을 수행한 후 점진적으로 스케일을 확장해서 이미지의 세밀한 부분을 디블러링 하는 Coarse-to-fine 전략을 이용하여 다양한 크기의 블러를 처리한다[4]. 또한, 잔여 학습에서 배치 정규화를 제거한 변형된 Residual 블록을 반복하여 네트워크를 구성한다[21]. SRN은 ConvLSTM(Convolution Long-Short Term Memory)[22]를 통해 반복적인 구조를 활용하여 이전 스케일에서 학습된 정보를 기억한 후 다른 스케일에서 재사용하는 방법을 활용한 디블러링을 수행하여 경량화된 구조를 제안하였다[6].

MSCAN은 세 가지 스케일과 두 가지 수준(Level)으로 구성된 네트워크 구조를 통해, 각 스케일에서 복원된 이미지와 잔여 이미지를 동시에 생성한다. 또한, Spatial Pyramid Pooling[23] 기반의 Channel Attention 모듈을 적용함으로써 지역(Local) 및 전역(Global) 특징을 활용하여 표현력을 강화하였다[13].

그러나, 이러한 Coarse-to-fine 전략을 사용하는 이미지 디블러링 방법들은 멀티 스케일 이미지를 반복적으로 활용하기 때문에, 네트워크 구조가 복잡하고 연산량이 많다는 단점이 있다. 또한, 이미지의 해상도를 변환하는 과정에서 블러 이미지에 존재하는 텍스처 및 가장자리 정보가 손실될 가능성이 존재한다.

위에서 언급한 방법들과는 대조적으로, 단일 이미지를 사용하는 XYDeblur는 단일 인코더와 듀얼 디코더 구조를 이용해 이미지 디블러링을 수행한다[15]. 여기서 두 디코더는 인코더의 특징 임베딩을 수평 및 수직 방향으로 분리하여 각각의 방향성을 복원하며, 회전된 공간 커널을 활용함으로써 매개변수를 공유하고 상호 보완적으로 작동한다. 이를 통해 파라미터 수 증가 없이 디블러링 성능 향상을 달성하였다.

그러나, 단일 인코더를 사용하는 기존의 이미지 디블러링 방법들은 수평 및 수직 방향의 블러 성분이 혼재된 영역에서 물체의 가장자리 및 구조적인 특징들을 정확하게 추출하지 못한다[8][9], [11][12], [14]-[20]. 이로 인해 디코더가 물체의 세부 정보들을 복원하지 못하여 이미지 디블러링 성능이 저하되는 문제가 존재한다.

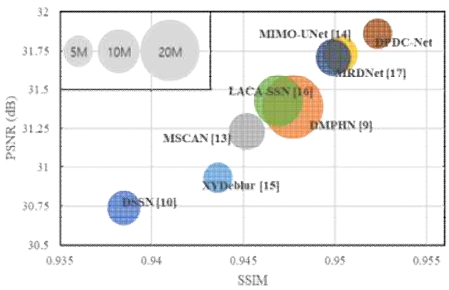

본 논문에서는 이러한 문제점을 해결하기 위해 DPDC-Net(Dual-Path Divide-and-Conquer Neural Network)를 제안한다. 제안하는 방법은 인코더를 사용하여 입력 이미지의 수직 및 수평 방향 특징을 분리하여 추출하며, 이어서, 각 방향의 특징은 대응되는 두 개의 디코더를 통해 상호 보완적으로 블러 이미지를 복원한다. DPDC-Net은 인코더와 디코더 내에서 매개변수를 공유하는 방법을 이용하여, 단일 인코더-디코더 구조와 동일한 수의 매개변수를 가지면서도 입력 이미지의 세부 특징을 나누어서 처리하기 때문에 방향성에 따른 구조적 특징을 독립적으로 처리하고 통합함으로써, 블러 제거 성능을 크게 향상시킨다. 그림 1을 통해 기존의 이미지 디블러링 방법들과 제안된 DPDC-Net의 성능 및 파라미터 비교를 확인할 수 있다.

Comparison of performance and parameters of the proposed DPDC-Net with existing image deblurring methods

이 논문의 구성은 다음과 같다. II장에서는 제안하는 뉴럴 네트워크 구조와 그 구성 요소에 대해 설명한다. III장에서는 실험 환경 및 구현 세부 사항을 기술하고, 다양한 기존 이미지 디블러링 기법들과의 성능 비교를 통해 제안 방법의 효과를 검증한다. 마지막으로, IV장에서는 본 논문의 내용을 요약하고 결론을 제시한다.

Ⅱ. 제안하는 뉴럴 네트워크

2.1 DPDC-Net의 구조

그림 2를 보면 본 논문에서 제안하는 DPDC-Net의 전체적인 구조를 확인할 수 있다. DPDC-Net은 두 개의 인코더와 두 개의 디코더로 구성된다. 인코더는 입력된 블러 이미지를 저차원 표현으로 압축하여, 추출된 특징을 나타내는 특징 임베딩을 생성한다. 이 과정을 통해 입력 이미지에 존재하는 객체들의 가장자리 및 구조적인 특징을 추출한다. DPDC-Net의 인코더 연산은 식 (2)는 다음과 같다.

| (2) |

x는 블러 이미지, θer는 90도 회전된 θe와 동일한 인코더의 매개변수를 나타낸다.

디코더는 인코더에서 추출된 특징 임베딩을 활용하여 원본 이미지와 동일한 해상도를 가지는 선명한 이미지로 복원한다. DPDC-Net의 디코더 연산은 식 (3)은 다음과 같다.

| (3) |

z는 인코더의 출력 이미지, θdr은 θd을 90도 회전시킨 동일한 매개변수를 의미한다. 두 개의 디코더의 출력과 입력 이미지를 더해 DPDC-Net의 최종 복원된 이미지를 생성한다. 이 과정은 식 (4)와 같다.

| (4) |

o는 뉴럴 네트워크가 예측한 최종적인 선명한 이미지이고 x는 입력 이미지, y는 두 개의 디코더에서 출력된 이미지를 요소별 덧셈한 결과를 의미한다. 두 개의 디코더 출력은 객체의 수직 및 수평 가장자리 특징을 가지고 있고, 입력 이미지에 존재하는 객체의 정보를 보존한다. 중간 레이어에 인코더와 디코더 사이 Skip connection은 인코더에서 생성된 특징 임베딩을 디코더 출력과 결합하여 이미지의 세부 정보를 보존한 채로 이미지 디블러링을 수행한다.

그림 2의 회색 블록에 해당하는 잔여 학습은 각 6번씩 반복한다. 잔여 학습 블록의 구조는 그림 2의 왼쪽 상단에 존재한다. 이 과정은 식 (5)와 같다:

| (5) |

x는 입력 이미지, w2와 w1는 각 컨볼루션의 가중치 매개변수 y는 최종 출력을 의미하고, *는 2차원 컨볼루션 연산을 의미한다.

2.2 매개변수 공유

두 개의 인코더는 동일한 매개변수를 통해 이미지 디블러링을 수행한다. 이때, 식 (2)처럼 첫 번째 인코더의 블러 커널을 회전시켜서 두 번째 인코더에 사용한다. 첫 번째 인코더는 수직 가장자리 특징을 집중적으로 추출하고 두 번째 인코더는 수평 가장자리 특징을 추출한다. 이를 통해 블러 영역에 존재하는 수평 및 수직 특징을 효율적으로 추출한다.

두 개의 디코더도 회전된 블러 커널을 활용하여 매개변수를 공유한다. 이 방법을 사용하여 인코더에서 추출된 수직 및 수평 특징 임베딩을 더 선명하게 재구성한다. 제안하는 DPDC-Net의 매개변수 공유 방법은 기존의 단일 인코더-디코더 구조를 사용하는 이미지 디블러링 방법과 비교했을 때, 동일한 매개변수 수를 가지면서도, 객체의 특징들을 정확하게 추출하고 선명하게 복원하여 이미지 디블러링 성능을 높인다.

2.3 손실 함수

이 장에서는 제안하는 DPDC-Net에서 사용하는 손실 함수를 설명하고, 학습에 사용하는 각 손실 함수의 가중치 값을 설명한다. 먼저, 콘텐츠 손실 함수로 절대 차이 평균 손실 함수인 L1 손실 함수를 사용한다. 이 손실은 예측된 이미지와 정답 이미지 간의 픽셀 단위 차이를 절댓값으로 측정하여 전체적으로 평균화한 것으로, 블러 이미지로부터 선명한 이미지를 복원하는 과정에서 구조적 유사성과 시각적 정합성을 유지하는 데 효과적이다. DPDC-Net에서 사용한 콘텐츠 손실 함수는 식 (6)과 같다.

| (6) |

N은 픽셀의 개수이며, Xi는 모델이 예측한 선명한 이미지, Yi는 그에 대응하는 정답 이미지를 의미한다.

두 번째 손실 함수로는 고속 푸리에 변환(FFT, Fast Fourier Transform) 손실 함수를 사용한다[14]. 이 손실 함수는 복원된 이미지와 정답 이미지 간의 주파수 영역 차이를 학습하도록 유도하며, 특히 고주파 성분에서 발생할 수 있는 손실을 효과적으로 감지하고 복원할 수 있도록 돕는다. 공간 도메인에서 이미지의 텍스처나 경계 정보는 고주파 성분에 의해 표현되므로, 이 손실 함수를 활용함으로써 모델은 더 세밀하고 정교한 구조를 재현할 수 있다. 또한, 주파수 영역에서 두 이미지 간의 일관성을 유지함으로써 시각적으로 선명한 복원을 가능하게 한다. 제안된 방법에서 사용하는 고속 푸리에 변환 손실 함수는 다음과 같은 식 (7)로 정의한다:

| (7) |

X는 모델이 예측한 선명한 이미지, Y는 그에 대응하는 정답 이미지, F는 고속 푸리에 변환 함수를 의미한다. 제안하는 DPDC-Net의 전체 손실 함수는 두 손실 함수의 가중치 합으로 식 (8)과 같이 정의한다.

| (8) |

고속 푸리에 변환 손실 함수의 가중치 λ는 0.01로 설정한다.

Ⅲ. 실험 결과

제안된 DPDC-Net을 기존의 존재하던 딥러닝 기반의 이미지 디블러링 방법들과 비교하여 제안된 방법의 우수함을 입증하기 위해서 다양한 실험을 진행한다. 첫째, 성능 평가에 사용한 데이터셋 및 실험 세팅과 실험을 진행한 환경을 설명한다. 둘째, 제안하는 방법과 기존의 존재하던 딥러닝 기반 이미지 디블러링 방법 간의 정량적, 정성적 비교를 진행한다. 마지막으로, 모델의 매개변수 개수와 연산시간을 비교한다.

3.1 구현 사항

데이터셋: GoPro 데이터셋은 총 22개의 장면에서 촬영한 2,103장의 블러 이미지와 선명한 이미지 쌍으로 구성된 학습 데이터를 포함하고 있다[4]. 평가 데이터는 11개의 장면으로부터 촬영한 1,111장의 블러 이미지와 선명한 이미지 쌍으로 구성되어 있다. DPDC-Net은 GoPro 데이터셋을 학습 데이터로 사용하여 제안 기법과 기존 딥러닝 기반 이미지 디블러링 기법들의 성능을 비교 및 평가하였다.

실험 환경: PyTorch 프레임워크에서 실험을 진행하며[22], 배치 사이즈는 4, 학습 반복 횟수는 3,000번, 학습률은 10-4의 값을 사용하면서 500번의 학습 반복 횟수마다 학습률을 절반씩 감소했다. 학습을 진행할 때 뉴럴 네트워크의 과적합을 방지하기 위해 GoPro 데이터셋의 학습 데이터를 256×256 크기로 무작위로 잘라서 사용했다. 최적화 기법은 Adam Optimizer를 사용하고[23], 잔여 학습의 반복 횟수는 모두 6회를 사용했다. 모든 실험 Intel Xeon Gold 5220R × 2, RAM 128GB, NVIDIA Geforce RTX 4090 GPU가 탑재된 딥러닝 전용 서버에서 수행했다.

3.2 기존 이미지 디블러링 방법들과 비교

제안된 방법의 우수성을 입증하기 위해 GoPro 데이터셋에서 기존의 딥러닝 기반 이미지 디블러링 방법들과 정량적 실험 및 정성적 비교 실험을 진행했다. 비교 대상은 기존의 이미지 디블러링 방법 총 14개이며, 이는 표 1을 통해 확인할 수 있다. 각 논문에서 제공하는 코드를 딥러닝 전용 서버에서 실행하여 선명한 이미지를 출력하고, 이를 평가에 사용했다. 정량적인 평가를 진행하기 위해 본 논문에서는 PSNR, SSIM, MS-SSIM, VIF, MSE와 같은 5가지 측정지표를 사용했다[26]-[29]. PSNR, SSIM, MS-SSIM, VIF는 높을수록, MSE는 낮을수록 이미지 디블러링 결과의 품질이 좋음을 나타낸다. 표 1의 정량적 평가 결과에 따르면, 제안된 뉴럴 네트워크는 GoPro 데이터셋에서 PSNR, SSIM, MS-SSIM, VIF 값들이 기존의 딥러닝 방법들 중 가장 최신 방법인 MRDNet보다 0.15 dB, 0.0024, 0.0019, 0.0045 더 높고, MSE 값은 3.10 더 낮았다. 또한, 표 1을 보면, 제안된 방법이 모든 지표에서 기존의 딥러닝 기반 방법들보다 가장 우수한 성능을 보였다.

3.3 모델 용량 비교

이 장에서는 제안한 DPDC-Net의 모델 복잡도를 기존의 딥러닝 기반 이미지 디블러링 방법들과 비교하였다. 표 2에 나와 있는 14개의 이미지 디블러링 방법들과 비교를 수행했으며, 각 방법의 매개변수 개수(Parameters) 및 동작 시간(Processing Time)을 GoPro 데이터셋을 기준으로 측정하였다. 표 2의 결과에서 확인할 수 있듯이, 제안된 DPDC-Net은 기존 방법들에 비해 더 적은 수의 파라미터를 사용하면서도 높은 성능을 달성하였고, 연산시간 또한 상대적으로 빠른 편에 속하여 효율성과 정확도 측면 모두에서 우수한 성능을 보였다.

Comparison of parameters and processing time between existing image deblurring methods and the proposed method

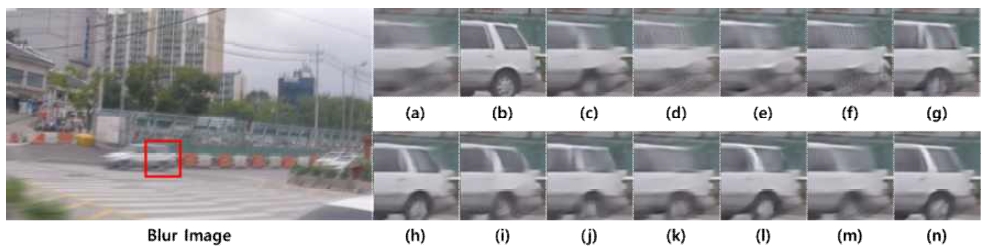

제안된 방법의 이미지 디블러링 성능의 우수함을 시각적으로 증명하기 위해 정성적인 비교를 진행했다. 그림 3에서는 차량 창문의 가장자리 부분과 전체적인 구조를 DPDC-Net이 정답 이미지와 가장 정확하게 복원했다. 이는 두 개의 인코더가 블러 영역에 수평 및 수직 방향으로 존재하는 물체의 가장자리 및 구조적 특징을 정확하게 추출했기 때문이다. 그림 5에서는 차량 앞면 구조를 정답과 가장 명확하게 복원했다. 이는 두 개의 디코더가 동일한 매개변수를 사용하여 상호 보완적으로 동작하여 인코더에서 추출된 수직 및 수평 가장자리 특징을 선명하게 재구성했기 때문이다.

Comparison of results between the proposed method and existing image deblurring methods on the GoPro dataset[4]: (a) Blurred patch, (b) Ground truth patch, (c) DeepDeblur[4], (d) DeblurGAN-v1[5], (e) SRN[6], (f) DeblurGAN-v2[7], (g) PSS_NSC[8], (h) DMPHN[9], (i) DSSN[10], (j) MTRNN[11], (k) MSCAN[13], (l) XYDeblur[15], (m) LACA-SSN[16], and (n) DPDC-Net

Ⅳ. 결 론

본 논문에서는 이미지 디블러링을 수행하기 위해 이중 경로 분할 정복(Dual-Path Divide-and-Conquer Neural Network) 기반의 DPDC-Net을 제안하였다. 제안된 네트워크는 동일한 매개변수를 공유하는 두 개의 인코더를 통해 블러 영역에 존재하는 수직 및 수평 방향의 가장자리와 구조적 특징을 상호 보완적으로 추출하며, 디코더 또한 동일한 방식으로 특징을 복원하도록 설계되었다. 이와 같은 구조는 기존 단일 인코더-디코더 기반의 네트워크와 동일한 파라미터 수를 유지하면서도 복원 성능을 향상시킬 수 있음을 보여준다.

다양한 실험 결과를 통해 제안된 DPDC-Net은 기존의 딥러닝 기반 디블러링 방법들보다 우수한 성능을 보였으며, 특히 GoPro 데이터셋을 기준으로 최신 방법인 MRDNet 대비 PSNR은 0.15 dB, SSIM은 0.0024, MS-SSIM은 0.0019, VIF는 0.0045, MSE는 3.10만큼 개선된 결과를 나타냈다.

Acknowledgments

이 논문은 2025년도 정부 (과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 연구임 (RS-2025-02214672, 모빌리티용 Safety-Critical 기능 구현을 위한 NVM 기반 고속 및 고신뢰 메모리 시스템 기술 개발)

References

-

Y. Bai, H. Jia, M. Jiang, X. Liu, X. Xie, and W. Gao, "Single-image blind deblurring using multi-scale latent structure prior", IEEE Transactions on Circuits and Systems for Video Technology, Vol. 30, No. 7, pp. 2033-2045, Jul. 2020.

[https://doi.org/10.1109/TCSVT.2019.2919159]

-

Y. Bahat, N. Efrat, and M. Irani, "Non-uniform blind deblurring by reblurring", Proc. of the IEEE International Conference on Computer Vision (ICCV), Venice, Italy, pp. 3286-3294, Oct. 2017.

[https://doi.org/10.1109/iccv.2017.356]

-

J. Dong, S. Roth, and B. Schiele, "DWDN: Deep wiener deconvolution network for non-blind image deblurring", IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 44, No. 12, pp. 9960-9976, Dec. 2022.

[https://doi.org/10.1109/TPAMI.2021.3138787]

-

S. Nah, T. Hyun Kim, and K. M. Lee, "Deep multi-scale convolutional neural network for dynamic scene deblurring", Proc. of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, HI, USA, pp. 257-265, Jul. 2017.

[https://doi.org/10.1109/cvpr.2017.35]

-

O. Kupyn, V. Budzan, M. Mykhailych, D. Mishkin, and J. Matas, "DeblurGAN: Blind motion deblurring using conditional adversarial networks", Proc. of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Salt Lake City, UT, USA, pp. 8183-8192, Jun. 2018.

[https://doi.org/10.1109/cvpr.2018.00854]

-

X. Tao, H. Gao, X. Shen, J. Wang, and J. Jia, "Scale-recurrent network for deep image deblurring", Proc. of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Salt Lake City, UT, USA, pp. 8174-8182, Jun. 2018.

[https://doi.org/10.1109/cvpr.2018.00853]

-

O. Kupyn, T. Martyniuk, J. Wu, and Z. Wang, "DeblurGAN-v2: Deblurring (orders-of-magnitude) faster and better", Proc. of the IEEE/CVF International Conference on Computer Vision (ICCV), Seoul, Korea, pp. 8878-8887, Oct. 2019.

[https://doi.org/10.1109/iccv.2019.00897]

-

H. Gao, X. Tao, X. Shen, and J. Jia, "Dynamic scene deblurring with parameter selective sharing and nested skip connections", Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Long Beach, CA, USA, pp. 3848-3856, Jun. 2019.

[https://doi.org/10.1109/cvpr.2019.00397]

-

H. Zhang, Y. Dai, H. Li, and P. Koniusz, "Deep stacked hierarchical multi-patch network for image deblurring", Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Long Beach, CA, USA, pp. 5978-5986, Jun. 2019.

[https://doi.org/10.1109/cvpr.2019.00613]

-

S. Lin, J. Kim, and W. Kim, "Deep spectral-spatial network for single image deblurring", IEEE Signal Processing Letters, Vol. 27, pp. 835-839, May 2020.

[https://doi.org/10.1109/lsp.2020.2995106]

-

D. Park, D. U. Kang, J. Kim, and S. Y. Chun, "Multi-temporal recurrent neural network for progressive non-uniform single image deblurring with incremental temporal training", Proc. of the European Conference on Computer Vision (ECCV), Glasgow, UK, pp. 327-343, Aug. 2020.

[https://doi.org/10.1007/978-3-030-58539-6_20]

-

K. Zhang, W. Luo, Y. Zhong, L. Ma, B. Stenger, W. Liu, and H. Li, "Deblurring by Realistic Blurring", Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Seattle, WA, USA, pp. 2737-2746, Jun. 2020.

[https://doi.org/10.1109/cvpr42600.2020.00281]

-

S. Wan, S. Tang, X. Xie, J. Gu, R. Huang, B. Ma, and L. Luo, "Deep convolutional-neural-network-based channel attention for single image dynamic scene blind deblurring", IEEE Transactions on Circuits and Systems for Video Technology, Vol. 31, No. 8, pp. 2994-3009, Aug. 2021.

[https://doi.org/10.1109/tcsvt.2020.3035664]

-

S. J. Cho, S. W. Ji, J. P. Hong, S. W. Jung, and S. J. Ko, "Rethinking coarse-to-fine approach in single image deblurring", Proc. of the IEEE/CVF International Conference on Computer Vision (ICCV), Montreal, QC, Canada, pp. 4641-4650, Oct. 2021.

[https://doi.org/10.1109/iccv48922.2021.00460]

-

S. W. Ji, J. Lee, S. W. Kim, J. P. Hong, S. J. Baek, S. W. Jung, and S. J. Ko, "XYDeblur: Divide and conquer for single image deblurring", Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), New Orleans, LA, USA, pp. 17421-17430, Jun 2022.

[https://doi.org/10.1109/cvpr52688.2022.01690]

-

H. S. Lee and S. I. Cho, "Locally adaptive channel attention-based spatial-spectral neural network for image deblurring", IEEE Transactions on Circuits and Systems for Video Technology, Vol. 33, No. 10, pp. 5375-5390, Oct. 2023.

[https://doi.org/10.1109/tcsvt.2023.3250509]

-

B. Zhang, J. Sun, F. Sun, F. Wang, and B. Zhu, "Image deblurring method based on self-attention and residual wavelet transform", Expert Systems with Applications, Vol. 224, No. 123005, Jun. 2024.

[https://doi.org/10.1016/j.eswa.2023.123005]

-

W. Zou, M. Jiang, Y. Zhang, L. Chen, Z. Lu, and Y. Wu, "SDWNet: A straight dilated network with wavelet transformation for image deblurring", Proc. of the IEEE/CVF International Conference on Computer Vision (ICCV) Workshops, Montreal, BC, Canada, pp. 1895-1904, Oct. 2021.

[https://doi.org/10.1109/iccvw54120.2021.00216]

-

J. Cai, W. Zuo, and L. Zhang, "Dark and bright channel prior embedded network for dynamic scene deblurring", IEEE Transactions on Image Processing, Vol. 29, pp. 6885-6897, May 2020.

[https://doi.org/10.1109/tip.2020.2995048]

-

K. Purohit, A. Shah, and A. N. Rajagopalan, "Bringing alive blurred moments", Proc. of the IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), Long Beach, CA, USA, pp. 6830-6839, Jun. 2019.

[https://doi.org/10.1109/cvpr.2019.00699]

-

K. He, X. Zhang, S. Ren, and J. Sun, "Deep residual learning for image recognition", Proc. of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA, pp. 770-778, Jun. 2016.

[https://doi.org/10.1109/cvpr.2016.90]

-

X. Shi, Z. Chen, H. Wang, D. Y. Yeung, W. K. Wong, and W. C. Woo, "Convolutional LSTM network: A machine learning approach for precipitation nowcasting", Proc. of the Advances in Neural Information Processing Systems (NeurIPS), Montréal, Canada, Jun. 2015.

[https://doi.org/10.48550/arXiv.1506.04214]

-

K. He, X. Zhang, S. Ren, and J. Sun, "Spatial pyramid pooling in deep convolutional networks for visual recognition", IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 37, No. 9, pp. 1904-1916, Sep. 2015.

[https://doi.org/10.1109/tpami.2015.2389824]

-

A. Paszke, et al., "PyTorch: An imperative style, high-performance deep learning library", Proc. of the Advances in Neural Information Processing Systems (NeurIPS), Vancouver, Canada, Vol. 32, Dec. 2019.

[https://doi.org/10.48550/arXiv.1912.01703]

-

D. P. Kingma and J. Ba, "Adam: a method for stochastic optimization", Proc. of the 3rd International Conference on Learning Representation (ICLR), Banff, AB, Canada, Dec. 2014.

[https://doi.org/10.48550/arXiv.1412.6980]

-

Z. Wang, A. C. Bovik, H. R. Sheikh, and E. P. Simoncelli, "Image quality assessment: from error visibility to structural similarity", IEEE Transactions on Image Processing, Vol. 13, No. 4, pp. 600-612, Apr. 2004.

[https://doi.org/10.1109/tip.2003.819861]

-

Z. Wang, E. P. Simoncelli, and A. C. Bovik, "Multiscale structural similarity for image quality assessment", The Thirty-Seventh Asilomar Conference on Signals, Systems & Computers, Pacific Grove, CA, USA, pp. 1398-1402, May 2004.

[https://doi.org/10.1109/acssc.2003.1292216]

-

H. R. Sheikh and A. C. Bovik, "Image information and visual quality", IEEE Transactions on Image Processing, Vol. 15, No. 2, pp. 430-444, Feb. 2006.

[https://doi.org/10.1109/vcip.2016.7805469]

-

H. L. Tan, Z. Li, Y. H. Tan, S. Rahardja, and C. Yeo, "A perceptually relevant MSE-based image quality metric", IEEE Transactions on Image Processing, Vol. 22, No. 11, pp. 4447-4459, Nov. 2013.

[https://doi.org/10.1109/tip.2013.2273671]

-

M. S. Kim and W. Huh, "A Study on the Development of CNN-based Audio Data Image Transformation and Sound Recognition App for the Deaf", The Journal of The Institute of Internet, Broadcasting and Communication (IIBC), Vol. 25, No. 3, pp. 271-277, Jun. 2025.

[https://doi.org/10.7236/JIIBC.2025.25.3.271]

-

E. Jo and H. J. Lee, "Analysis and Design of AI-based Real-time Gait and HAI Interaction Feedback System", The Journal of The Institute of Internet, Broadcasting and Communication (IIBC), Vol. 25, No. 3, pp. 101-110, Jun. 2025.

[https://doi.org/10.7236/JIIBC.2025.25.3.101]

2024년 2월 : 국립금오공과대학교 전자공학부 반도체시스템전공(공학사)

2024년 3월 ~ 현재 : 국립금오공과대학교 반도체시스템공학부 석사과정

관심분야 : 저조도 이미지 향상, 이미지 디블러링, 컴퓨터 비전, 비디오 아웃페인팅

2014년 2월 : 경북대학교 IT 대학 전자공학부(공학사)

2016년 2월 : 포항공과대학교 전기전자공학(공학석사)

2020년 2월 : 포항공과대학교 전기전자공학(공학박사)

2020년 3월 ~ 2021년 2월 : 경남대학교 전자공학부 조교수

2021년 3월 ~ 2023년 2월 : 대구대학교 전자공학부 조교수

2023년 3월 ~ 현재 : 국립금오공과대학교 전자공학부 반도체시스템전공 조교수

관심분야 : 이미지 분석 및 향상, 비디오 처리, 컴퓨터 비전, 딥러닝