자동화 기계학습을 이용한 노인 우울증 예측

초록

최근 한국에서 급격한 고령화 인구의 증가는 중요한 사회적 문제로 대두되고 있으며, 특히 노인 우울증 환자의 비중이 크게 증가하고 있다. 본 논문은 2020년 노인 실태조사 데이터를 활용해 AutoML(Automated Machine Learning) 기반의 노인 우울증 예측모델을 제시한다. 예측 정확도 향상을 위해 결측값 처리, 원-핫 인코딩, 레이블 인코딩 등의 전처리와 오버샘플링 기법을 적용하였다. AutoML을 통해 최적의 ML 모델을 선정하고 하이퍼파라미터를 조정하여 최종 예측 모델을 도출하였다. 결과에서 최적화된 모델을 기초로 특성 중요도를 산출하였으며, 이를 통해 노인 우울증은 단일 요인에 의해 발생하는 것이 아니라 신체적, 경제적, 심리적 요인들의 복합적인 상호작용에 의해 영향을 받는다는 것을 알 수 있었다.

Abstract

The rapid increase in the aging population in Korea has recently emerged as a significant social issue, with a notable rise in the proportion of elderly patients with depression. This paper presents an Automated Machine Learning(AutoML) based prediction model for geriatric depression using the 2020 Elderly Survey data. To enhance prediction accuracy, preprocessing techniques such as missing value handling, one-hot encoding, and label encoding were applied, along with oversampling to address class imbalance. Through AutoML, the optimal ML model was selected and its hyperparameters were adjusted to derive the final prediction model. Based on the optimized model, feature importance analysis was conducted, revealing that geriatric depression is influenced by a complex interaction of physical, economic, and psychological factors rather than a single cause.

Keywords:

depression, prediction model, machine learning, AutoML, feature importanceⅠ. 서 론

우리나라는 급격한 고령화 현상을 겪고 있으며, 2024년 65세 이상 고령인구는 전체 인구의 19.2%, 고령인구 비중은 계속 증가하여, 2025년에는 20%, 2036년에는 30%, 2050년에는 40%가 될 것으로 전망된다[1]. 건강보험심사평가원 데이터에 따르면, 전체 우울증 환자 중 60대 이상이 333,491명으로 전체 우울증 환자 중 32%로 높은 비율을 차지하고 있다[2]. 본 논문에서는 우울증 진행단계를 세분화하고, 자동화된 머신러닝(AutoML, Automated Machine Learning) 모델을 이용하여, 가장 적합한 예측모델을 설정하고, 최적의 하이퍼파라미터를 조정하여, 우울증을 조기에 판단할 수 있는 중요 요인을 도출하고자 한다.

최근에는 노인 우울증의 사회적 문제에 대응하기 위해 ML 모델을 이용한 다양한 연구가 진행되고 있다[3]-[6]. 기존 연구들은 주로 랜덤 포레스트, 로지스틱 회귀, 의사결정나무와 같은 전통적인 머신러닝 알고리즘을 활용하여 노인 우울증 예측 모델을 구축하였다. [3]에서는 랜덤 포레스트와 로지스틱 회귀를 이용하여 우울증 단계를 우울증, 경도우울, 정상으로 분류하여, 예측 모델을 구현하였다. 그러나 데이터의 불균형이 심한 경우, 소수 클래스의 데이터를 제대로 학습하지 못하여 정확도(Accuracy)를 제외한 정밀도(Precision) 및 재현율(Recall) 등의 성능지표가 낮은 결과를 보여주었다. [5]에서는 딥러닝을 이용하여 우울증을 예측하는 모델을 제안하였다. 예측 모델의 성능은 우수하지만, 복잡도가 증가하고, 하이퍼파라미터의 세부 조절에 의존하여 성능이 낮아질 수 있다.

최근에는 AutoML을 이용한 다양한 연구들이 진행되고 있다[7]-[10]. AutoML은 주어진 문제에 가장 적합한 예측 모델을 자동으로 선택하고 학습하여, 예측 성능을 극대화할 수 있는 접근 방식이다. [7]에서는 Lazypredict와 SHAP를 이용하여 최적의 독립변수를 찾는 접근이 진행되었다. 하지만, 예측모델에 대한 하이퍼파라미터 최적화가 진행되지 않아서, 예측 성능이 낮을 수 있다.

본 논문에서는 우울증 예측을 위해 2개의 AutoML 모델을 이용하여, 다양한 분류 모델 중에 가장 성능이 우수한 예측 모델을 선정하고, 선택된 모델의 하이퍼파라미터를 최적화하여, 우울증 예측 성능에 가장 영향을 미치는 특성인자를 도출한다.

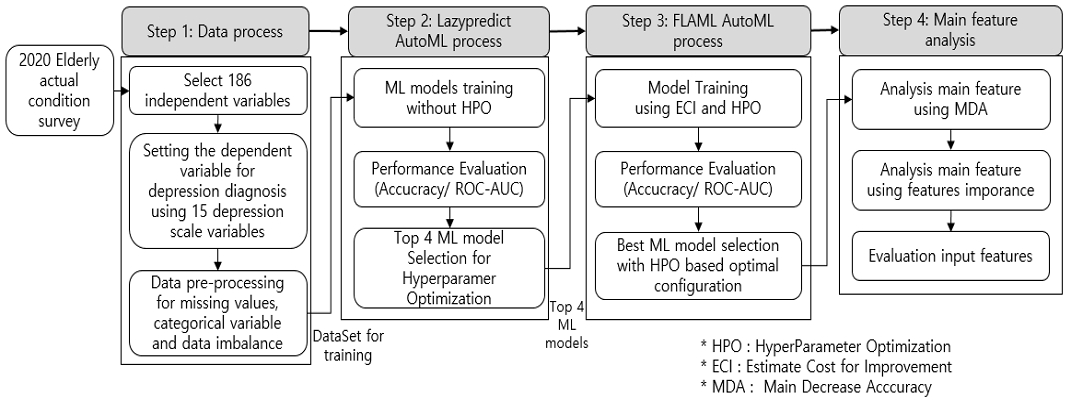

제안된 우울증 예측 모델은 4개의 단계로 구성된다. 첫 번째 단계에서는 종속변수 및 독립변수의 선정 그리고 데이터 전처리 과정으로 구성된다. 종속변수는 우울증에 영향을 미치는 요인으로 밝혀진 선행연구[3-6]들을 기반으로 186개의 독립변수를 선정하였으며, 자세한 내용은 3장에서 다룬다. 우울증 분류를 위한 종속변수는 15개의 우울증 척도 변수를 이용하여, 우울증을 판별한다. 우울증 척도 변수의 합이 0~2점은 정상군, 3~6점은 우울경계군, 7점 이상인 경우 우울군으로 구분하였다[4][5]. 우울경계군은 우울증 판별의 전 단계로 우울증 예방측면을 고려하여 단계를 세분화하여 분석한다. 데이터 전처리 단계에서는 모델의 예측 성능을 향상하기 위해서, 결측값 처리, 데이터 변환과 정규화, 범주형 변수 처리, 클래스 간의 데이터 불균형을 위한 오버샘플링 기법을 사용하였다.

두 번째 단계에서는 Lazypredict AutoML 라이브러리[7]를 이용하여, 하이퍼파라미터 최적화를 거치지 않고, 정확도와 ROC-AUC(Receiver Operating Characteristic Curve-Area Under the Curve)의 성능평가 모델을 이용하여 우수한 모델을 선정한다. 그리고 하이퍼파라미터 최적화 기법을 이용하여 더 정밀한 예측성능 최적화를 위해, 선별된 4개 모델에 대해 FLAML AutoML 라이브러리[8,9]를 세 번째 단계에서 적용한다. 정확도와 ROC-AUC의 성능평가 모델을 이용하여, 최적의 하이퍼파라미터 설정에 따른 가장 성능이 우수한 모델을 선정한다.

마지막 단계에서는 선정된 모델의 우울증 판단에 가장 영향을 주는 독립변수를 분석한다. 분석을 위해서, 평균 정확도 감소(MDA, Mean Decrease Accuracy)와 특성중요도(Feature importance)를 이용한다[10]. 이를 통해 노인 우울증의 발생 요인은 신체적, 경제적, 심리적 요인들의 복합적인 상호작용에 의해 영향을 받음을 알 수 있었다.

본 논문의 구성은 다음과 같다. 2장에서는 기계학습의 전반적인 내용과 최근의 ML 기법인 AutoML에 대해서 설명한다. 3장에서는 본 논문에서 제안된 AutoML 기반의 우울증 예측 모델에 대해서 설명하고, 4장에서 제안된 예측모델에 대한 성능 평가 및 우울증 예측에 중요한 영향을 미치는 독립변수들에 대해서 분석한다. 마지막으로 5장에서 본 논문의 결론을 맺는다.

Ⅱ. 관련 연구

2.1 머신러닝 모델

기계학습(Machine learning)은 컴퓨터 학습 이론으로부터 시작된 연구 분야로, 컴퓨터가 인간의 학습 능력과 같은 기능을 알고리즘과 프로그램을 이용하여 데이터로부터 스스로 배워 새로운 정보를 발견하거나 의사결정을 하는 알고리즘적인 접근 방식이다[3].

기계학습 알고리즘은 데이터 학습방법에 따라 지도학습(Supervised learning), 비지도학습(Unsupervised learning), 강화학습(Reinforcement learning)으로 크게 3가지로 나눌 수 있다. 지도학습은 학습 데이터에 입력 값(독립변수, Independent variable)에 대응되는 결과 값(종속변수, Dependent variable)을 이용하여, 모델을 훈련시킨다[3]. 학습된 모델을 이용하여 입력 값에 대응되는 결과 값을 예측하는 방식이다. 대표적인 알고리즘으로는 로지스틱 회귀(LR, Logistic Regression), 랜덤포레스트(RF, Random Forest), SVM(Support Vector Machine)등이 있다[3]-[5]. 비지도학습은 지도학습과는 달리 결과 값이 없는 데이터를 학습하는 방법으로, 데이터를 이용하여 패턴, 구조, 관계를 찾는 방식이다. 데이터를 그룹화하거나 특성을 추출하는 데 사용된다. 강화학습은 에이전트가 환경과 상호작용하면서 보상을 최대화하는 방향으로 학습하는 방식으로, 주로 게임, 로봇 제어 등에 이용된다. 본 논문에서는 지도학습을 이용하여 우울증을 판별하는 예측 모델을 설계하며, 지도학습 관련 ML 알고리즘에 대해서 좀 더 자세히 알아본다.

로지스틱 회귀(LR) 알고리즘은 이메일이 스팸인지 아닌지 또는 질병이 있는지를 예측하는 문제 등의 이진 분류문제에 사용된다[3]. 출력이 0과 1 사이의 값을 가지도록 시그모이드 함수를 적용하여 확률기반의 예측을 수행한다. 다만, 선형 모델을 이용하기 때문에, 다중 클래스 분류에는 한계가 있을 수 있다.

랜덤 포레스트(RF) 알고리즘은 앙상블 학습 방법의 일종으로, 여러 개의 결정 트리를 생성하고, 그 결과를 종합하여 분류, 회귀, 그리고 다른 작업을 수행하는 기계학습 알고리즘이다[4]. 이 방법은 높은 정확도, 과적합(Overfitting) 방지를 위해서 부트스트랩 샘플링을 통한 다양한 학습 데이터 세트를 생성하는 배깅(Bagging)을 이용한다.

SVM 알고리즘은 고차원 공간에서 데이터 분류를 위한 초평면(Hyperplane)을 찾는 알고리즘이다[11]. 두 클래스 간의 마진을 최대화하는 초평면 탐색, 비선형 분류를 위한 고차원 매핑인 커널 트릭, 오분류와 마진 사이의 간격을 적절히 조절하기 위해서 정규화 파라미터를 이용하여 예측모델을 구현한다.

그래디언트 부스팅(Gradient boosting) 알고리즘은 높은 예측 성능과 계산 효율성으로 인해 데이터 과학 및 기계학습에서 널리 사용되고 있는 알고리즘이다[12][13]. 병렬처리, 정규화, 가지치기 등의 최적화 기법이 적용된다. 뛰어난 예측 성능, 빠른 학습 및 예측 속도가 장점이며, 다양한 하이퍼파라미터 튜닝 옵션이 제공된다. 특히 LGBM(Light Gradient Boosting Machine)은 마이크로소프트에서 개발한 부스팅 프레임워크로, 높은 효율성과 빠른 학습 속도로 인해 대규모 데이터에 강점이 있다[13]-[15].

2.2 AutoML

AutoML은 기계학습 모델의 개발 및 적용 과정을 자동화하는 기술로, 데이터 전처리부터 모델 선택, 하이퍼파라미터 최적화, 그리고 모델 평가에 이르는 전 과정을 포함한다[10]. AutoML의 장점으로는 시간 및 비용을 절감해 효율성 증대 및 고성능의 예측 모델 개발 시에, 다양한 알고리즘을 도입하여 최적의 알고리즘을 선택할 수 있다는 것이 가장 큰 특징이다. 최근에는 Google Cloud AutoML, Lazypredict, FLAML(Fast and lightweight AutoML)[7]-[9]등 다양한 AutoML 도구가 등장하고 있다.

Lazypredict[7]는 여러 모델을 빠르게 훈련시키고, 각 모델의 성능을 비교하여 최적의 모델을 찾는 데 도움을 주는 라이브러리이다. 이 모델은 하이퍼파라미터 튜닝 없이 기본 모델을 사용하여 빠른 실험을 진행할 수 있으며, 학습이 완료되면 각 모델의 성능 지표(정확도, AUC, R2 등)를 이용하여 사용자가 최적 모델을 쉽게 선택할 수 있다.

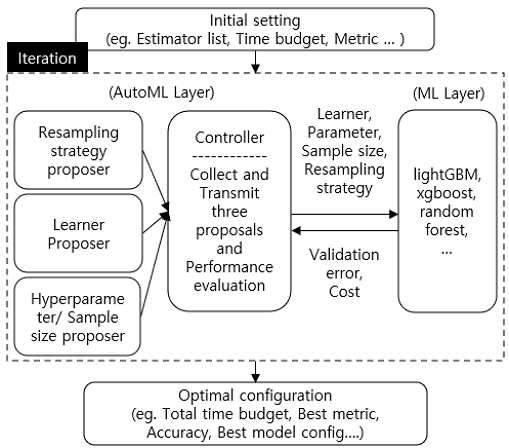

FLAML[8][9]은 마이크로소프트에서 개발한 효율적이고 경량화된 AutoML 라이브러리이며, 주요 특징은 ECI(Estimated Cost for Improvement)와 하이퍼파라미터 최적화(HPO, Hyper Parameter Optimization)에 있다. ECI는 효율적인 ML 모델 탐색 과정에서 사용되는 자원의 비용을 고려하여 최적의 예측 모델을 선택한다[8]. HPO 과정은 기존의 그리드 탐색(Grid search)이나 무작위 탐색(Randomized search)보다 HPO 소요 시간을 단축하고 성능을 높이기 위한 무작위 직접 검색(Randomized direct search) 방법을 이용한다. 본 논문에서는 Lazypredict 모델을 이용하여, 가장 성능이 뛰어난 예측 모델을 선정한다. 그리고, FLAML을 이용하여 선정된 예측모델의 하이퍼파라미터를 조정하여, 최적화된 예측 모델을 선정한다. 자세한 내용은 다음 장에서 설명한다.

Ⅲ. 제안된 AutoML을 이용한 우울증 예측 모델 설계

제안된 AutoML을 이용한 우울증 예측 모델을 그림 1에 나타내었다. 제안된 예측 모델은 4개의 단계로 구성되며, 첫 번째 단계인 데이터 처리(Data Processing)에서는 3개의 단계로 세분화된다. 종속변수의 선정은 앞서 우울증에 영향을 미치는 요인으로 밝혀진 선행연구[3]-[6]들을 기반으로 186개로 선정하였다. 구체적으로 성별, 교육 수준, 배우자 유무, 신체적 건강상태, 생활수준, 일상생활 수행능력(ALD, Activities of daily living), 도구적 일상생활 수행능력(IADL, Instrumental activities of daily living), 여가 활동 및 생활 만족도, 가족 관계 및 사회관계 만족도, 주관적 건강 상태, 삶의 질 등을 포함하였다. 우울증 분류는 15개의 우울증 척도 변수를 이용하여, 우울증을 판별한다. 우울증 척도 변수의 합이 0~2점은 정상군, 3~6점은 우울경계군, 7점 이상인 경우 우울군으로 구분하였다. 우울경계군은 우울증 판별의 전 단계로 우울증 예방측면을 고려하여 단계를 구분하여 분석하였다. 데이터 전처리 단계에서는 모델의 예측 성능을 향상하기 위해서, 결측값 처리, 데이터 변환과 정규화, 범주형 변수 처리, 클래스 간의 데이터 불균형을 위한 오버샘플링 기법을 사용하였다.

두 번째 단계에서는 Lazypredict AutoML 라이브러리[7]를 이용하여, 다양한 ML모델 중에서, 정확도(Accuracy)와 ROC-AUC[7][8]의 성능평가 모델을 이용하여 우수한 모델을 선정한다. 이때 비슷한 성능을 나타내는 모델은 제외하고, 성능 차이가 큰 상위 4개의 모델을 선정하였다.

세 번째 단계에서는 하이퍼파라미터 최적화 기법을 이용하여 더 정밀한 예측성능 최적화를 위해, 선별된 4개 모델에 대해 FLAML AutoML 라이브러리를 적용하였다[8][9]. 정확도와 ROC-AUC의 성능평가 모델을 이용하여, 최적의 하이퍼파라미터 설정에 따른 가장 성능이 가장 우수한 모델을 선정한다. 그림 2는 FLAML AutoML이 작업 순서도를 나타낸다. 초기 설정단계(Initial setting)에서는 ML 모델들의 성능 평가를 위해서, 평가하고 싶은 ML 리스트(Estimator list), 전체 작동시간(Time budget), 성능 평가 도구(Metric)를 설정한다. 반복 단계(Iteration)에서는 크게 AutoML 계층과 ML 계층을 나누어 성능평가를 수행한다. AutoML 계층에서는 3개의 Proposer를 이용하여 샘플크기, 최적화 파라미터, ML 학습모델등을 제안한다. 컨트롤러는 Proposer들의 제안내용을 ML 계층에 전달하고, 성능 결과를 평가하여 반복할지 또는 중단할지를 결정한다. 성능 평가 후에 최적 모델 도출 및 최적 환경을 도출한다.

마지막 단계에서는 선정된 모델의 우울증 판단에 가장 영향을 주는 독립변수에 대한 분석을 한다. 분석을 위해서, 평균정확도감소(MDA)와 특성중요도(FI, Feature Importance) 이용한다[10]. MDA는 특정 변수를 제외했을 때 모델의 정확도가 얼마나 감소하는지를 그리고 특성중요도는 학습 과정에서 사용된 각 변수의 빈도와 그로 인한 성능 향상을 기반으로 계산된다. 다음장에서 실험결과를 살펴본다.

Ⅳ. 실 험

실험 플랫폼은 Google Colab을 사용하였다. 프로그래밍 언어로는 Python(3.10.12), 그리고 주요 라이브러리와 버전은 pandas(2.2.2), numpy(1.26.4), matplotlib(3.8.0), Lazypredict(0.2.13), flaml(2.3.2)를 이용하였다.

그림 1에서, 입력 데이터는 한국보건사회연구원의 노인실태조사(2020년) 자료를 사용하였다[16]. 조사 기간은 2020년 3월부터 11월까지 진행하였고, 전국 969개의 조사구의 거주노인 10,097을 대상으로 f진행되었다. 예측모델은 정상-우울군과 정상-우울경계군의 2개의 그룹으로 나누어 설계하였다.

표 1은 조사 대상의 특성 분포를 연구 대상자 특성을 성별, 학력, 연령, 건강 상태, 사회적 관계, 약물 복용 수, 그리고 인지 기능 점수 등으로 구분하여 나타내었다. 성별은 남성이 40.0%, 여성이 60.0%로 여성의 비율이 더 높았으며, 학력은 초등학교 졸업 이하가 44.7%로 가장 많았다. 연령대는 65~74세가 60.3%로 가장 많았고, 평균 연령은 73.4세였다. 건강 상태는 '대체로 건강함'이 45.4%로 가장 많았으며, 사회적 관계에서는 친밀한 가족 및 친구 수가 0~2명인 경우가 70.8%로 높은 비율을 차지했다.

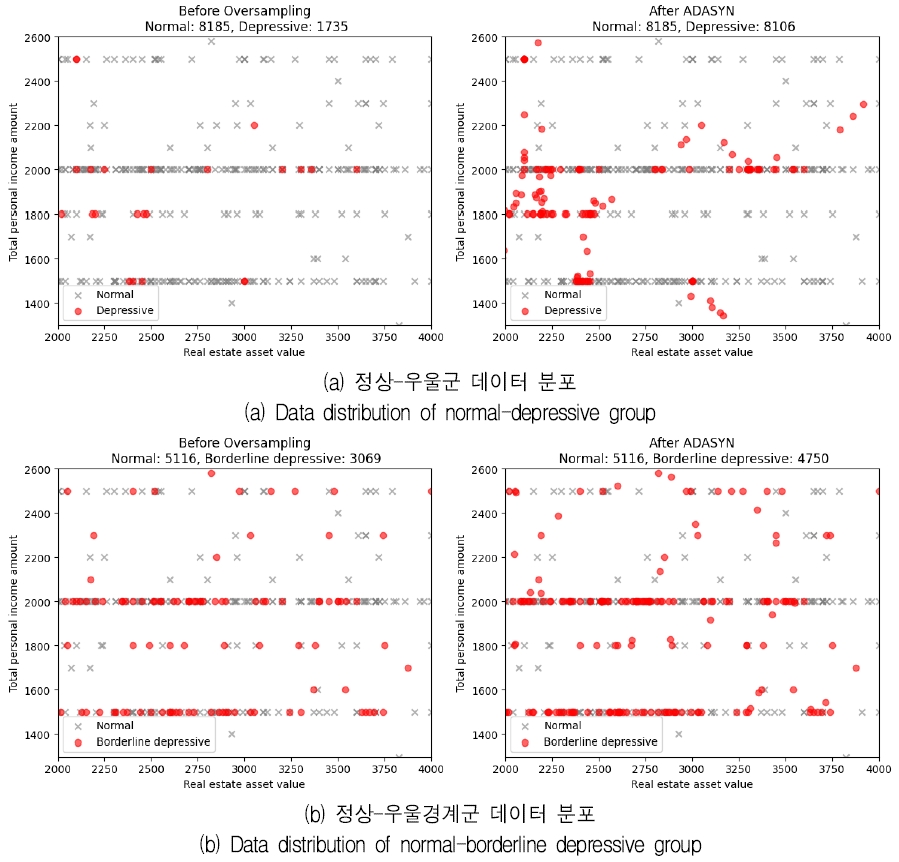

그룹 내의 클래스 간의 데이터 불균형을 해결하기 위해 ADASYN(Adaptive Synthetic sampling) 오버샘플링 기법[17]을 적용하였다, ADASYN은 단순 데이터의 복제가 아닌 주변 데이터의 분포를 고려하여 새로운 샘플을 생성하기 때문에, 과적합 위험을 감소시킬 수 있다. 표 2은 ADASYN 적용 후의 그룹별 종속변수 분포이다. 그림 3은 ADASYN 적용후의 결과를 나타내기 위해서, "본인_총수입액_금액"과 "부동산자산_금액"을 X축과 Y축으로 설정하여, 2개 그룹의 클래스 분포를 나타내었다. 경계를 기준으로 가중치가 분포되기 때문에, 더 현실적으로 생성된 데이터의 분포를 알 수 있다.

우울증 판별을 위한 우울증 척도 변수에 대한 결측값의 응답자는 분석의 정확성을 높이기 위해 완전분석법(Listwise deletion)을 적용하여 해당 행을 제거하였다. 우울증 척도 변수 외의 다른 독립변수들의 결측값에 대해서는 각 열(변수)의 최빈값으로, 결측값을 대체하였다. 범주형 변수의 경우, 순서형 변수는 레이블 인코딩을, 명목형 변수는 원-핫 인코딩을 적용하였다. 독립변수에 대한 분석 평균정확도감소(MDA)와 특성중요도(FI)를 이용한다[10].

표 3은 그림 1의 두 번째 단계인 Lazypredict AutoML을 이용하여 성능차이를 보인 4개의 상위 ML 모델에 대한 성능평가 결과이다. 정상-우울군은 LGBM이 그리고 정상-우울경계군은 SVM이 각각 정확도와 ROC-AUC[7][8]의 평가요소에 대해서 가장 좋은 성능을 나타내고 있다. RF의 경우, 여러 결정 트리를 독립적으로 학습시키지만, LGBM은 트리를 순차적으로 학습하면서 이전 모델의 오류를 개선하면서, 더 높은 예측 성능을 나타낸 것으로 분석된다. SVM의 경우도 비선형 데이터를 잘 처리할 수 있는 커널 트릭(Kernel trick)을 사용하여 고차원 공간에서 최적의 경계를 찾는 방식을 이용하여 가장 높은 성능을 나타낸 것으로 분석된다.

표 4는 기존 ML 모델과 제안된 모델(Lazypredict+FLAML) 과의 성능비교를 나타낸다. 제안된 모델은 기존의 RF[3]와 Lazypredict[7]만 사용한 결과보다, 더 높은 성능을 보여준다. 정상-우울군의 경우, 제안된 방법이 기존의 모델과 비교하여 1~2%, 정상-우울경계군의 경우, 3~5%의 향상을 각각 나타내었다.

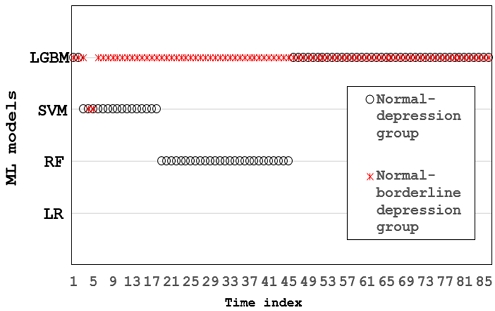

그림 4는 그림 1의 Step 2로부터 전달된 4개의 ML 모델들에 대해서, 각 그룹 내의 FLAML AutoML[9] 이용한 실험 시간당 하이퍼파라미터를 조절하면서 가장 높은 성능을 갖는 ML 모델의 분포를 나타내었다. FLAML AutoML 적용 시, 실험 시간을 30분으로 설정하여 실험을 진행하였으며, 실험결과를 나타내는 시간이 각 그룹별로 상이하여, 시간을 인덱스로 조정하여 표시하였다. 정상-우울군의 경우, 3인덱스까지 LGBM이 선택되다가, 4부터 17 인덱스까지 SVM이 그리고, 18에서 46인덱스는 RF를 선택하고, 그 이후부터는 LGBM이 가장 우수한 ML 모델로 선정되었다. 정상-우울경계군의 경우, 5에서 7인덱스까지 SVM이 선택되었고, 그 이후에는 LGBM이 선택되었다.

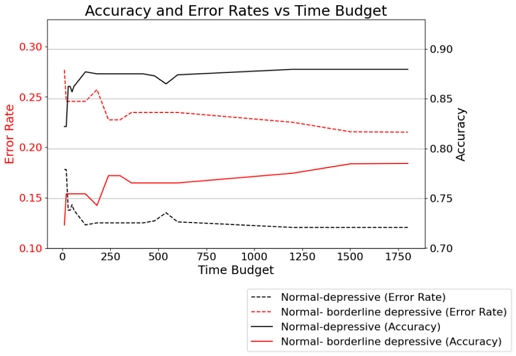

그림 5는 각 그룹의 FLAML AutoML의 성능평가를 시간의 변화에 따른 정확도와 에러율을 이용하여 나타내었다.

정확도 평가에서는 정상-우울군이 정상-우울경계군보다 높은 성능을 나타내고 있으며, 시간에 따라 점점 높은 정확도를 보이고 있다. 에러율의 경우는 정상-우울군이 정상-우울경계군보다 낮은 결과를 보이고 있으며, 시간에 따라 점점 에러율이 낮아짐을 알 수 있다.

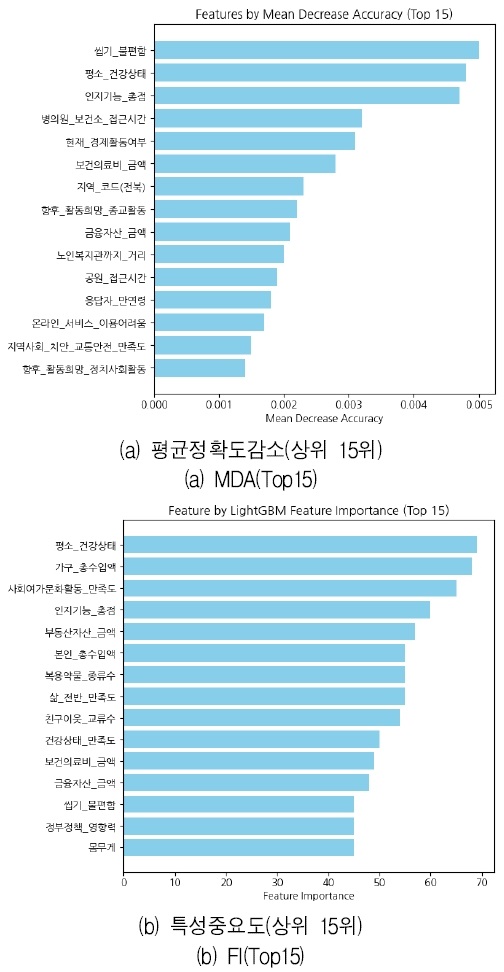

그림 6은 정상-우울군 그룹 내에서 HPO를 통해서 선정된 LGBM 모델의 우울증 판단에 가장 영향을 주는 독립변수에 대한 분석을 실시하였다. 분석을 위해서, MDA와 FI를 이용하였다.

정상-우울군의 경우, MDA의 상위 3개 특성은 ‘일상생활의 불편함_씹기’, ‘평소의 건강상태’, ‘인지기능_총점’으로 나타났다. 반면, FI에서는 ‘평소_건강상태’, ‘가구_총수입액_금액’, ‘만족도_사회·여가·문화 활동’이 상위 3개의 특성으로 나타났다. 특징으로는 '평소의 건강상태' 변수가 두 방법 모두에서 상위 3개 특성에 포함되어 있으며, 이는 해당 독립변수가 모델의 내부 처리와 실제 예측 성능 모두에서 중요한 역할을 한다는 것을 나타낸다.

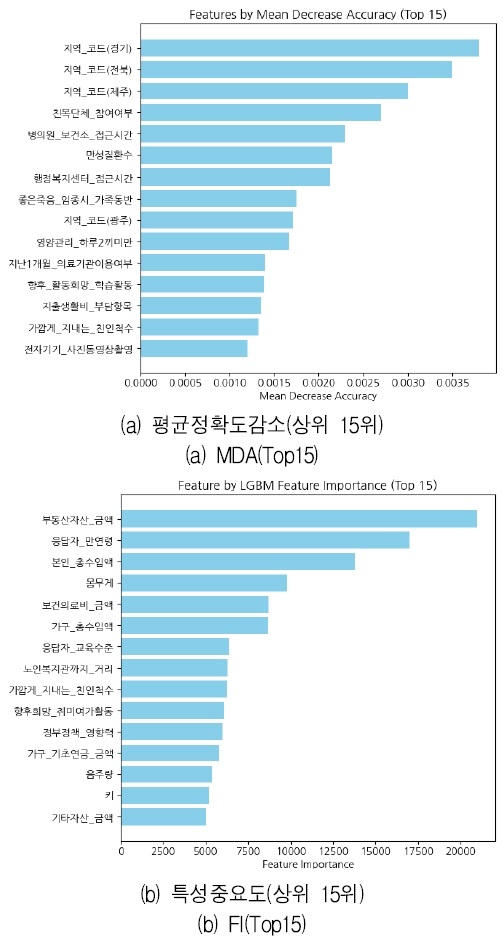

그림 7은 정상-우울경계군 그룹 내에서 HPO를 통해서 선정된 SVM모델의 우울증 판단에 가장 영향을 주는 독립변수에 대한 분석을 실시하였다. 정상-우울경계군의 경우, MDA 기준 상위 3개 특성은 ‘경기’, ‘전북’, ‘제주’로, 모두 지역 변수였다. 반면, 특성 중요도의 경우, 상위 3개 특성은 ‘부동산자산_금액’, ‘노인 조사 대상자 만연령’, ‘본인_총수입액_금액‘으로 나타났다.

그림 6과 7에서, FI 분석 결과, 우울증과 연관이 있는 독립변수의 특징은 재산 및 경제적 상태와 관련된 변수들(‘부동산자산_금액’, ‘본인_총수입액_금액’ 등)이 상위 특성으로 다수 포함되어 있었다. 이는 노인의 경제적 상황이 우울증 발생에 중요한 영향을 미칠 수 있음을 보여준다. 또한 ‘일상생활의 불편함’과 관련된 변수들(‘씹기_불편함’ 그리고 ‘평소건강상태’)과 만족도 관련 변수들(‘사회여가운동_만족도’ 등)이 중요 특성으로 도출되었으며, 이는 신체적 기능과 삶의 질이 우울증과 밀접한 관련이 있음을 알 수 있었다.

Ⅴ. 결 론

최근 한국에서 급격한 고령화 인구의 증가와 노인 우울증 환자의 증가는 중요한 사회적 문제로 대두되고 있다. 본 논문에서는 2020년 노인 실태조사 데이터를 이용하여, 노인 우울증 환자를 조기에 발견할 수 있는 AutoML기반의 우울증 예측모델을 제시하였다. 예측결과의 향상을 위해서, 결측값 처리, 원-핫 인코딩, 레이블인코딩, 그리고 오버샘플링 등의 전처리 과정을 실시하였다. 제안된 우울증 예측모델은 우선, Lazypredict 모델을 이용하여 다양한 ML 모델중에 가장 성능이 우수한 ML 모델을 4개 설정하고, 두 번째 단계에서는 FLAML AutoML 모델을 이용하여 하이퍼파라미터 조정을 통한 최적의 예측 모델을 도출하였다. 특성 중요도 분석에서는 노인 우울증은 단일 요인에 의해 발생하는 것이 아니라 신체적, 경제적, 심리적 요인들의 복합적인 상호작용에 의해 영향을 받는다는 사실을 확인할 수 있었다. 향후 연구에서는 더 큰 규모의 데이터셋과 다양한 지역의 노인 인구 데이터를 포함하여, 우울증 요인들에 대한 더욱 포괄적이고 일반화 가능한 결과를 도출해 보고자 한다.

References

- Statistics Korea, "2024 Statistics on the Aged", https://kostat.go.kr/board.es?mid=a20111030000&bid=11759&act=view&list_no=433631, . [accessed: Jan. 10, 2025]

- Health Insurance Review and Assessment Service, "2023 Statistics on Diseases and Medical Procedures in Daily Life", https://www.hira.or.kr/bbsDummy.do?pgmid=HIRAA020045010000&brdScnBltNo=4&brdBltNo=2399&pageIndex=1&pageIndex2=1, . [accessed: Jan. 10, 2025]

-

B. Seo, E. Suh, and T. Kim, "A study on the prediction model of the elderly depression", Journal of Industrial Distribution & Business, Vol. 11, No. 7, pp. 29-40, Jul. 2020.

[https://doi.org/10.13106/jidb.2020.vol11.no7.29]

-

H. Jeon and C. Jihn, "Identifying the expression patterns of depression based on the random forest", Journal of Korean Society of Industrial and System Engineering, Vol. 44, No. 4, pp. 53-64, Dec. 2021.

[https://doi.org/10.11627/jksie.2021.44.4.053]

-

J. Lim and D. Lim, "Prediction of depression in older adults using wide & deep learning model", Jounal of Health Informatics and Statistics, Vol. 47, No. 4, pp. 339-348, Nov. 2022.

[https://doi.org/10.21032/jhis.2022.47.4.339]

- K. Kim and J. Kim "Assessment of Late-Life Depression Using Eye Movements in Anti-Saccade Tasks", Proceedings of KIIT Conference, Jeju, Korea, pp. 245-245, Nov. 2024.

-

K. Cho and R. Baik, "Optimizing input parameters of paralichthys olivaceus disease classification based on SHAP analysis", Journal of the KIECS, Vol. 18, No. 6, pp. 1331-1336, Dec. 2023.

[https://doi.org/10.13067/JKIECS.2023.18.6.1331]

- K. Lee, "Changes in soil hydraulic properties by different types of forest fire damage and its influence on hydrologic responses", Doctoral Dissertation, Seoul National University, 2022. https://hdl.handle.net/10371/183277, .

-

C. Wang, Q. Wu, M. Weimer, and E. Zhu, "FLAML: A fast and lightweight AutoML library", Proceedings of MLSys, 2021.

[https://doi.org/10.48550/arXiv.1911.04706]

-

H. Han, X. Guo, and H. Yu, "Variable selection using mean decrease accuracy and mean decrease gini based on random forest", 2016 7th IEEE International Conference on Software Engineering and Service Science (ICSESS), Beijing, pp. 219-224, Aug. 2016.

[https://doi.org/10.1109/ICSESS.2016.7883053]

-

C. Corinna and V. Vapnik, "Support-vector networks", Machine Learning, Vol. 20, No. 3, pp. 273-297, Sep. 1995.

[https://doi.org/10.1007/BF00994018]

-

C. Tianqi and C. Guestrin, "XGBoost: A scalable tree boosting system", Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining, San Francisco, California, USA, pp. 785-794, Aug. 2016.

[https://doi.org/10.1145/2939672.2939785]

-

G. Ke, Q. Meng, T. Finley, T. Wang, W. Chen, W. Ma, Q. Ye, and T. Yan, "LightGBM: A highly efficient gradient boosting decision tree", Advances in Neural Information Processing Systems, Long Beach, California, USA, Vol. 30, Dec. 2017. https://dl.acm.org/doi/10.5555/3294996.3295074, .

[https://doi.org/10.5555/3294996.3295074]

- Y. Kim and J. Ham, "A Study on the Forecast of Major Agricultural Production in Korea by Climate Change Using Machine Learning Model", Proc. of KIIT Conference, Jeju, Korea, Nov. 2024.

-

G. Jo, K. Jeong, B. Han, D. Kim, and E. Lee, "A Machine Learning-based Supply Order Prediction System for Small Restaurants", The Journal of KIIT, Vol. 23, No. 3, pp. 67-76. Mar. 2025.

[https://doi.org/10.14801/jkiit.2025.23.3.67]

- Korea Institute for Health and Social Affairs, "Survey on the Elderly", https://www.data.go.kr/data/15004296/fileData.do, . [accessed: Nov. 10, 2024]

-

H. He, Y. Bai, E. A. Garcia, and S. LiHe, "ADASYN: Adaptive synthetic sampling approach for imbalanced learning", 2008 IEEE International Joint Conference on Neural Networks, Hong Kong, pp. 1322-1328, Jun. 2008.

[https://doi.org/10.1109/IJCNN.2008.4633969]

2024년 2월 : 한양여자대학교 스마트IT과(공학전문학사)

2025년 2월 : 한양여자대학교 소프트웨어융합학과(공학사)

관심분야 : 데이터분석

1999년 2월 : 명지대학교 제어계측공학과(공학사)

2000년 2월 : 한양대학교 제어계측공학과(공학석사)

2009년 2월 : 연세대학교 전기전자공학부(공학박사)

2000년 2월 ~ 2011년 8월 : 삼성전자 DMC 연구소 책임연구원

2018년 9월 ~ 현재 : 한양여자대학교 소프트웨어융합과 교수

관심분야 : 멀티미디어 신호처리 및 네트워킹