아크 결함 분류를 위한 다중 수준 이산 웨이블릿 변환 기반의 다중 스케일 잔차 주의 네트워크

초록

본 논문에서는 다양한 전력 부하에서 발생하는 아크 결함을 정확하게 분류하기 위해, 다중 수준 이산 웨이블릿 변환(DWT, Multi-level Discrete Wavelet Transform)과 다중 스케일 잔차 주의 네트워크(MSRAN, Multi-Scale Residual Attention Network)를 결합한 딥러닝 모델을 제안한다. 제안한 모델은 전력 신호의 복잡한 패턴을 효과적으로 학습하기 위해, 다양한 주파수 대역에서 특징을 추출하는 다중 스케일 특징 추출기와 깊은 네트워크에서 정보 손실을 방지하는 잔여 블록을 포함한다. 또한, 자가 주의 집중 메커니즘을 통해 신호 내 중요한 패턴을 강조하여 결함 감지의 정확성을 높인다. 실험 결과, 제안된 모델은 전통적인 접근 방식 및 기존 신경망 모델보다 99.38%의 높은 정확도로 전력 신호의 패턴을 학습하고 결함을 감지할 수 있음을 확인하였다.

Abstract

This paper proposes a deep learning model that combines Multi-Level Discrete Wavelet Transform(DWT) and Multi-Scale Residual Attention Network(MSRAN) to accurately classify arc faults occurring in various power loads. The proposed model effectively learns the complex patterns of power signals by incorporating a multi-scale feature extractor that extracts features from different frequency bands, and residual blocks that prevent information loss in deep networks. Furthermore, the self-attention mechanism emphasizes important patterns within the signals, thereby enhancing fault detection accuracy. Experimental results show that the proposed model can learn power signal patterns and detect faults with a high accuracy of 99.38%, outperforming traditional approaches and existing neural network models.

Keywords:

arc fault classification, multi-level discrete wavelet transform, multi-scale residual attention network, attention mechanismⅠ. 서 론

최근 전력 시스템의 안정성과 효율성을 높이기 위한 연구가 전 세계적으로 활발히 진행되고 있으며, 특히 산업 현장과 농업 분야에서 전력 부하와 결함을 실시간으로 감지하는 기술이 점점 더 중요한 요소로 부각되고 있다[1]. 이에 따라 전기적 결함, 특히 아크 결함(Arc fault)은 전력 분배 시스템에 큰 위협을 가할 수 있으며, 적시에 감지되지 않으면 화재 발생, 장비 손상, 그리고 심각한 생산성 저하와 같은 문제를 초래할 수 있다[2]. 이에 따라 전력 시스템에서 발생하는 다양한 결함을 실시간으로 탐지하고 신속하게 대응할 수 있는 고도화된 자동화 솔루션의 도입이 절실해지고 있다.

기존의 전력 부하 및 결함 감지 시스템은 주로 규칙 기반 접근 방식과 전문가의 경험에 의존해 왔다. 이러한 방식은 전력 신호의 일정한 패턴이나 이상 현상을 탐지하는 데 유용할 수 있지만, 급격한 부하 변동과 복잡한 신호 패턴을 실시간으로 반영하는 데 한계가 있다[3]. 특히, 아크 결함과 같은 예측이 어려운 결함은 빠르게 대응해야 함에도 불구하고, 기존의 방식은 실시간 탐지 및 대응에서 한계를 보였다. 이러한 문제를 해결하기 위해, 최근에는 인공지능(AI)과 딥러닝 기술을 활용한 자동화된 전력 시스템 모니터링 및 결함 감지 기술이 활발히 연구되고 있다[4]-[6]. 대부분의 기존 연구들은 단일 스케일에서 전력 신호의 특징을 추출하는 방식을 채택했으나, 이러한 접근 방식은 다양한 주파수 대역에서 나타나는 전력 신호의 복잡한 변동성을 충분히 반영하지 못했다. 단일 스케일에서 추출된 특징들은 주파수 변화에 민감하지 않으며, 이로 인해 중요한 신호 특성을 놓치는 경우가 발생할 수 있다[7].

이러한 한계를 극복하기 위해 본 논문에서는 다중 스케일에서 정보를 추출하는 다중 스케일 접근 방식을 제안한다. 다중 스케일 특징 추출은 다양한 주파수 대역에서 신호를 분석하여 더욱 정교한 패턴을 학습할 수 있는 능력을 제공한다. 그중 웨이블릿 변환(Wavelet transform)은 신호를 다양한 스케일로 분해하여 각 대역에 맞는 특성을 추출할 수 있어, 고정된 해상도를 가진 푸리에 변환(Fourier transform)보다 복잡한 전력 신호의 변동성을 보다 정교하게 분석한다[8].

이러한 다중 스케일 분석을 효과적으로 활용하기 위해 본 논문에서는 다중 스케일 잔차 주의 네트워크(MSRAN, Multi-scale residual attention network)기반 딥러닝 모델을 제안한다. 이는 전력 신호의 다양한 패턴을 효과적으로 학습할 수 있도록 설계되었으며, 여러 스케일에서 특징을 추출하고 각각의 패턴을 포착하는 다중 스케일 특징 추출기와 깊이 있는 잔여 블록을 결합하여 전력 신호의 복잡한 변동성을 세밀하게 모델링한다. 특히, 확장된 합성곱과 잔여 연결을 활용하여 깊은 네트워크 구조에서도 신호 변형을 방지하고, 정보 손실을 최소화하여 신호 내 중요한 패턴을 강조한다. 이를 통해 다양한 결함 상황에서도 신뢰성 있는 결함 감지가 가능하며, 여러 주파수 대역에서 동시에 신호를 분석하여 더 정교한 특징을 학습한다. 이러한 설계는 특히 다양한 결함 상황에서 신뢰성 있는 성능을 보장하지만, 다중 스케일 분석과 복잡한 네트워크 구조로 인해 적절한 스케일과 파라미터 설정이 성능에 큰 영향을 끼치기 때문에 최적의 파라미터를 찾기 위한 반복적인 실험이 필요하다. 이러한 한계에도 불구하고, 본 연구에서 제안한 방법은 기존의 방법보다 우수한 성능을 입증하였으며, 추가적인 최적화를 통해 실시간 응용이 가능할 것으로 기대한다.

본 논문의 구성은 다음과 같다. 2장에서는 학습을 위한 데이터 수집과 다중 스케일에서 정보를 추출하기 위한 전처리 방법을 설명한다. 3장에서는 아크 결함 분류를 위한 다중 스케일 잔차 주의 네트워크의 구조와 학습 방법을 논의한다. 4장에서는 비교 실험을 통해 본 논문에서 제안한 아크 분류 시스템에 대한 검증 및 분석을 수행하며, 5장에서는 결론을 도출한다.

Ⅱ. 데이터 수집 및 다중 스케일 분석을 통한 전처리 방법

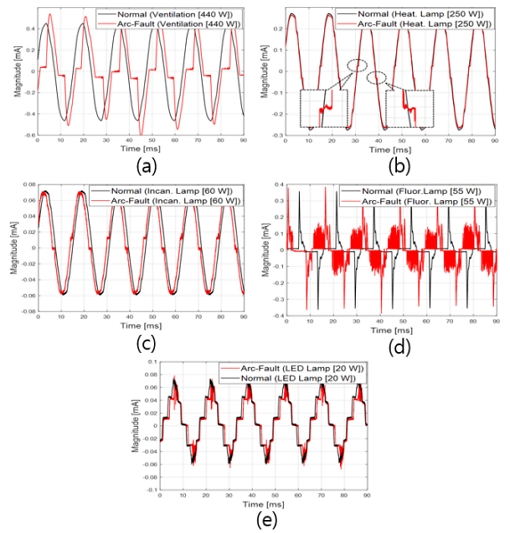

본 논문에서는 그림 1과 같이 축산 농장의 전력 분배 시스템에서 발생할 수 있는 대표적인 5가지 부하(Ventilator, Fluorescent lamp, Heating lamp, Incandescent lamp, LED lamp)를 대상으로 정상 상태와 아크 결함 상태의 데이터를 수집하였다.

Current waveforms at various loads for normal and series arc-fault states (a) Ventilator fan, (b) Fluorescent lamp, (c) Heating lamp, (d) Incandescent lamp, (e) LED lamp

이는 전력 시스템의 안전성과 성능을 평가하는 데 중요한 역할을 하며, UL 1699 표준을 준수하여 수집되었다[9]. 고주파 성분과 미세한 신호 변화를 정확히 포착하기 위해 샘플링 주파수는 1MHz로 설정되었으며, 이를 통해 각 부하 상태에서 18,000개의 정상 및 아크 결함 데이터를 확보하였다. 이를 효과적으로 분석하고 결함을 감지하기 위해 본 연구에서는 다중 수준 이산 웨이블릿 변환(DWT, Multi-level Discrete Wavelet Transform)을 적용한다.

이산 웨이블릿 변환은 신호를 주파수 대역으로 분해하여 시간 및 주파수 영역에서 신호의 특성을 동시에 분석할 수 있는 강력한 도구이다[10]. 이는 고주파 성분을 나타내는 웨이블릿 계수와 신호의 저주파 성분을 나타내는 스케일링 계수를 모두 활용하여 신호를 다각도로 분석한다. 웨이블릿 계수는 신호의 시간과 주파수 영역에서 국지적인 변화를 포착하는 데 매우 중요한 역할을 한다. 웨이블릿 계수 Wj,k는 신호 x(t)와 웨이블릿 함수 ψj,k(t)간의 내적을 통해 특정 시간 구간과 주파수 대역에서 신호의 변동성을 계산하여 신호가 해당 시간 구간에서 어떤 주파수 특성을 가지는지를 나타낸다. 웨이블릿 계수는 식 (1)과 같이 정의된다.

| (1) |

여기서, x(t)는 분석할 신호를 나타내며, ψj,k(t)는 주어진 스케일 j와 시간 위치 k에서 변환된 웨이블릿 함수로, 특정 주파수 대역에서 신호의 변화를 측정하는 역할을 한다. 스케일 j는 웨이블릿 함수의 확장을 나타내며, 시간 위치 k는 신호의 이동을 의미한다. 따라서 웨이블릿 함수 Wj,k는 스케일과 시간에 따라 변형되어, 다양한 주파수 대역에서 신호를 분석할 수 있다.

다음으로, 스케일링 계수는 신호의 저주파 성분을 통해 신호의 전반적인 흐름을 분석하는 데 중요한 역할을 하며, 이는 식 (2)와 같이 정의된다.

| (2) |

여기서, Aj,k는 특정 스케일 j와 시간 위치 k에서의 스케일링 계수를 나타낸다. x(t)는 분석할 신호를 의미하고, ϕj,k는 주어진 스케일과 시간 위치에서 변형된 스케일링 함수이다. 스케일링 함수는 고주파 성분이 놓칠 수 있는 저주파 성분의 변화를 강조한다. 이때, ϕj,k를 활용하여 계산된 Aj,k는 신호의 저주파 대역에서 나타나는 중요한 특성을 포착한다.

웨이블릿 계수와 스케일링 계수는 신호 분석에서 매우 중요한 역할을 하며, 이를 통해 신호의 고주파와 저주파 성분을 각각 포착하여 신호의 급격한 변화(Detail coefficients)와 장기적인 추세(Approximation coefficients)를 동시에 분석할 수 있다[11]. 하지만, 이러한 계수들을 시각적으로나 분석적으로 더 명확하게 표현하기 위해서는 로그 스케일로 변환하는 과정이 필요하다. 식 (3)은 이러한 로그 변환하는 과정을 나타낸다.

| (3) |

여기서, Cj,k는 웨이블릿 계수 Wj,k와 스케일링 계수 Aj,k를 모두 포함하는 값으로, j와 k에서의 특징을 나타낸다. 이 값은 주파수 성분과 시간 영역에서 신호의 변동성을 나타내며, 신호의 크기와 특성을 파악하는데 중요한 정보를 제공한다. 이후 Cj,k에 절댓값을 취하여 그 크기를 나타내며, 이를 로그 스케일로 변환함으로써 신호의 상대적인 크기와 변화를 더욱 명확하게 표현할 수 있다. 로그 변환은 신호 크기의 범위가 큰 경우 작은 변화를 쉽게 감지할 수 있도록 하는 중요한 도구이며, 이는 표준 방식으로 실시한다. 이후, 변환된 웨이블릿 계수의 길이를 원본 신호의 크기와 일치시키는 과정이 필요하다. 변환된 웨이블릿 계수의 길이가 원래 입력 신호보다 작을 경우, 부족한 부분을 상수 값으로 채워 데이터의 일관성을 유지한다. 반면, 웨이블릿 변환 후 데이터가 원본 신호보다 길어질 경우에는 초과된 부분은 잘라내어 동일한 길이로 맞춘다.

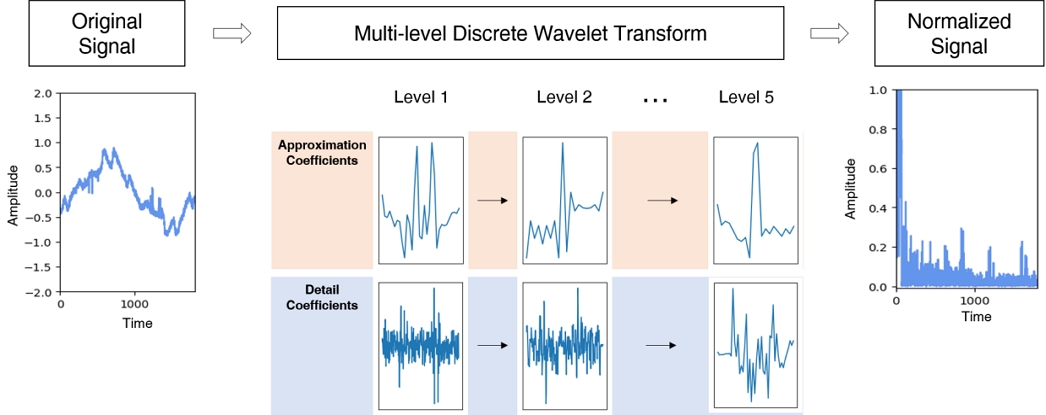

이처럼 본 연구에서는 그림 2와 같이 다중 수준 이산 웨이블릿 변환을 통해 총 5단계로 신호를 분석하고, 각 단계에서 고주파와 저주파 성분을 분리하여 신호 내 다양한 패턴을 더욱 정밀하게 포착한다. Level 1부터 Level 5까지 단계적으로 저주파 성분과 고주파 성분이 분리되며, 이후 원본 신호의 크기와 일치하도록 조정하여 최종 분석 신호를 도출한다.

Ⅲ. 아크 결함 분류를 위한 다중 스케일 잔차 주의 네트워크

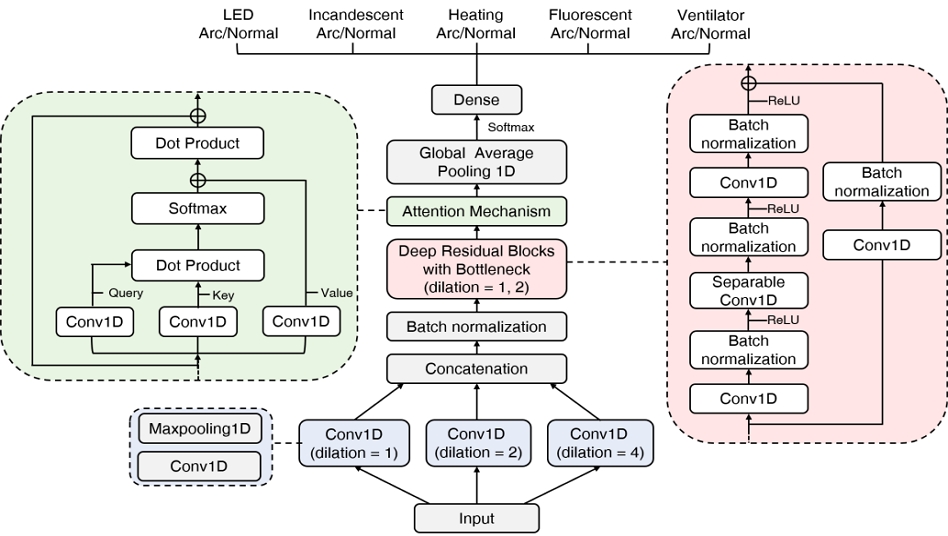

본 연구에서 제안하는 다중 스케일 잔차 주의 네트워크(MSRAN)기반 딥러닝 모델은 전력 신호의 복잡한 패턴을 효과적으로 분석하고, 아크 결함을 정확하게 분류하기 위해 설계된 고도화된 구조이다. 이는 그림 3과 같이 크게 다중 스케일 특징 추출, 잔여 블록, 어텐션 메커니즘 총 3가지 구조로 구성된다.

3.1 다중 스케일 특징 추출

제안하는 다중 스케일 잔차 주의 네트워크 기반 딥러닝 모델은 신호의 서로 다른 시간 범위 내에서 발생하는 변동을 분석하기 위해 각각 다른 확장 비율(Dilation rate=1,2,4)을 3개의 1차원 합성곱 층(1D convolutional layer)에 적용한다. 이때, 합성곱의 커널 크기는 3으로 하였다. 식 (4)는 확장 비율을 입력 신호에 각각 적용하는 1차원 합성곱 층의 과정을 나타낸다.

| (4) |

여기서, x(t)는 입력 신호를, w(t)는 신호에서 특정 특징을 추출하기 위한 합성곱 필터를, N은 해당 필터가 데이터에 적용될 때 고려하는 데이터 포인트(또는 픽셀)의 개수를, r은 확장 비율(Dilation rate)을 의미한다. 이처럼 다양한 스케일에서 신호를 처리함으로써, 고주파 및 저주파 성분을 동시에 분석한다.

입력 신호에 확장 비율을 적용하고 나면, 각각의 합성곱 층의 출력은 최대풀링(Pooling_size=2)을 통해 신호의 핵심 특징을 부각시키며 축소된다. 이후, 모든 병렬 합성곱 층의 출력은 병합되어 하나의 텐서로 결합한다. 이 병합된 텐서는 배치 정규화 과정을 거쳐 신호의 분포를 정규화하고, 두 번째 주요 구성 요소인 잔여 블록으로 전달한다.

3.2 잔여 블록

본 논문에서는 신호의 정보 손실을 줄이고, 신경망의 깊이가 깊어져도 학습 성능을 유지하기 위해 잔차 신경망(ResNet, Resudual network)에서 도입된 잔차 연결(Residual connection) 개념을 적용한다[12]. 제안하는 잔여 블록은 그림 3과 같이 병목(Bottleneck) 구조로 이루어져 있으며, 이는 모델의 계산 복잡도를 줄이면서도 중요한 신호 패턴을 효과적으로 학습한다. 이때, 병목 구조는 입력 신호의 차원을 줄이기 위해 1차원 합성곱 층을 사용하여 불필요한 계산을 줄인다[13]. 다음으로, 분리가 가능한 1차원 합성곱에 서로 다른 확장 비율(Dilation rate=1,2)을 적용하고, 또 한 번 1차원 합성곱 층을 지난다. 이때, 각 합성곱 층 뒤에는 배치 정규화와 ReLU 활성화 함수가 적용된다. 이렇게 병목 구조를 통해 차원을 축소한 신호는 최종적으로 원래 신호와 결합되어 출력된다.

본 논문에서는 이러한 과정을 총 3번 반복하여 신경망이 점점 더 깊어지더라도 학습 성능을 유지하도록 한다.

3.3 어텐션 메커니즘

어텐션 메커니즘은 입력 신호에서 중요한 부분에 가중치를 부여하여, 모델이 신호 내의 중요한 특징을 더 집중적으로 학습할 수 있도록 한다[14]. 본 논문에서는 간단한 형태의 셀프 어텐션 메커니즘을 도입하여 쿼리(Query), 키(Key), 값(Value)이라는 세 가지 주요 개념을 기반으로 작동하며, 신호의 각 부분이 얼마나 중요한지 계산한다. 식 (5)는 이러한 어텐션 메커니즘을 나타낸다.

| (5) |

여기서, Q, K, V는 각각 쿼리, 키, 값을 의미하며, dk는 차원의 크기이다. 이는 신호 간의 상관관계를 기반으로 가중치를 계산하여, 중요한 정보가 강조한다.

본 논문에서는 어텐션 메커니즘 적용을 위해 입력 신호를 1차원 합성곱 층을 통해 쿼리, 키, 값으로 변환한다. 이후, 점곱(Dot product) 방식을 사용하여 쿼리와 키 두 벡터 간의 유사도를 측정하여 softmax 함수를 통해 가중치를 정규화한다. 이렇게 얻어진 결과는 1차원 합성곱 층을 통해 변환된 값과 똑같이 점곱 방식을 사용하여 두 벡터 간의 유사도를 측정한다. 이렇게 강화된 신호는 최종적으로 입력 신호에 더해져 모델이 신호의 중요한 패턴에 더 집중하도록 한다. 어텐션 메커니즘을 통해 신호의 중요한 부분이 강조된 후, 전역 평균 풀링(Global average pooling) 층을 사용하여 전체 시퀀스의 모든 차원의 값을 평균하여 각 특징을 하나의 값으로 압축한다. 이후, 완전 연결 층(Dense)이 적용되며, 이는 아크 결함을 감지하기 위한 최종 예측을 수행한다. 이때, 소프트맥스 활성화 함수가 사용되어, 모델의 출력 값을 각각의 클래스에 대한 확률로 변환하고 그 확률들의 합이 1이 되도록 조정한다. 이를 통해 입력 신호에 대해 아크 결함이 발생했을 확률을 계산하며, 이를 바탕으로 결함 여부를 판단한다.

Ⅳ. 실험 및 결과

4.1 실험 환경

본 연구에서 제안하는 다중 수준 이산 웨이블릿 변환을 적용한 다중 스케일 잔차 주의 네트워크(MSRAN) 기반 딥러닝 모델의 성능을 평가하기 위해 다양한 아크 결함 분류 모델들과 비교 실험을 수행한다. 실험에 사용된 데이터셋은 8:2 비율로 훈련 세트와 테스트 세트로 분할되었으며, 훈련 과정에서는 RMSprop 옵티마이저를 사용하여 제안 모델에 대한 최적화를 수행한다. 학습률(Learning rate)은 초기 값 0.0001로 설정하였고, 총 30 에포크(Epoch)에 걸쳐 학습을 진행하였다. 배치 크기(Batch size)는 32로 설정되었으며, 학습 중 범주형 교차 엔트로피 손실 함수(Categorical crossentropy)를 사용하여 모델을 최적화한다. 학습률 스케줄링은 step decay 방식으로 적용되었으며, 첫 번째 구간에서 학습률을 10배 감소시킨 후, 두 번째 구간에서 다시 10배 감소시키는 방식으로 학습을 진행한다[15]. 이를 통해 모델이 학습의 초기 단계에서 빠르게 수렴할 수 있도록 하며, 후반부에서는 안정적인 학습이 이루어지도록 조정한다.

4.2 실험 결과

제안된 다중 수준 이산 웨이블릿 변환을 적용한 다중 스케일 잔차 주의 네트워크 기반 딥러닝 모델의 성능을 평가하기 위해, 동일한 데이터를 활용하여 기존의 대표적인 아크 결함 분류 모델들과 성능을 비교하였다. 이때, 1차원 합성곱 신경망 네트워크(1D CNN, 1D Convolutional neural network)[16]는 커널 크기 3을 사용하며, 필터 개수 각각 64, 128, 256, 512로 구성된 총 4개의 층으로 설계되었다. 장단기 메모리(LSTM, Long Short-Term Memory)[17]는 32개의 유닛(Unit)을 갖는 1개의 층으로 구성하였으며, 시계열 합성곱 신경망(TCN, Temporal Convolutional Network)[18]은 서로 다른 확장 비율(Dilation rate=1,2,4)이 적용된 총 4개의 1D 합성곱으로 구성하였다. 잔여 네트워크(ResNet, Residual Network)[19]는 총 8개의 잔여블록(Residual block)으로 구성하였다. 각 모델은 총 5회씩 학습한 후, 테스트 정확도 값을 평균하여 최종 성능을 도출하였으며, 결과는 표 1과 같다.

실험 결과, 제안된 다중 수준 이산 웨이블릿 변환을 적용한 다중 스케일 잔차 주의 네트워크 기반 딥러닝 모델은 99.12%의 높은 정확도를 달성하였다. 특히, ResNet이나 TCN과 같은 고도화된 모델들과 비교하여도 우수한 성능을 보여주었으며, 표 2와 같이 상대적으로 적은 파라미터 수로 모델의 효율성도 뛰어남을 확인하였다.

Comparison of training time and inference time for multi-level discrete wavelet transform-based models

여기서, total parameters는 딥러닝 모델에서 사용되는 전체 파라미터 수를 말하며, 해당 값이 커질수록 훈련 과정의 최적화 과정에 더 많은 연산이 필요하게 되며 GPU 메모리 등의 자원 소모가 커진다. 이에 따라, 본 논문에서 제안하는 다중 스케일 잔차 주의 네트워크 기반 딥러닝 모델은 다중 스케일 특징 추출과 잔여 블록, 주의 메커니즘을 적절히 결합하여 높은 정확도와 효율적인 성능을 동시에 달성함을 실험을 통해 보여준다.

4.3 성능 시각화 및 분석

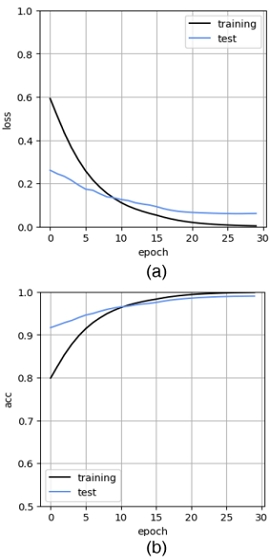

그림 4(a)와 (b)는 제안 모델 학습 시 각각 훈련 및 테스트 데이터에 대한 손실 함수(Loss)와 정확도(Accuracy)의 변화를 나타낸 그래프이다. 실험 결과, 본 연구의 제안 모델은 훈련과 테스트 모두에서 손실이 에포크가 진행됨에 따라 안정적으로 감소하였으며, 정확도는 지속적으로 상승한다. 특히, 테스트 정확도는 에포크 20 이후 99% 이상의 높은 성능을 기록하며, 훈련 정확도와 거의 동일한 수준으로 수렴하는 것을 관찰할 수 있다.

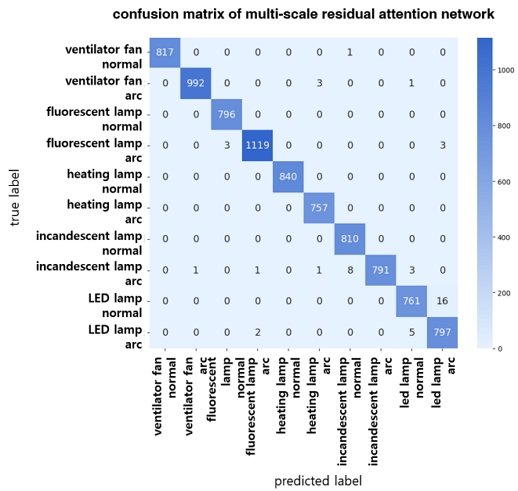

그림 5는 본 연구에서 제안하는 모델의 각 클래스에 대한 예측 결과와 실제 값 간의 일치도를 나타내는 혼동 행렬(Confusion matrix)[20]을 시각화한 것이다. 이를 통해 대부분의 클래스에서 매우 높은 성능을 보여주는 것을 확인할 수 있다.

표 3는 각 클래스 별로 normal과 arc로 구분한 10개의 클래스로 구성하여 판별한 혼동 행렬을 기반으로 한 주요 성능 지표인 정밀도(Precision), 재현율(Recall), f1-score를 평가한 결과를 보여준다. 정밀도는 모델이 특정 클래스로 예측한 샘플 중 실제로 해당 클래스에 속하는 샘플의 비율을 의미하며, 재현율은 실제로 해당 클래스에 속하는 샘플 중 모델이 올바르게 예측한 샘플의 비율로 모델이 해당 클래스를 얼마나 잘 분류했는지를 나타낸다. f1-score는 정밀도와 재현율의 조화평균으로, 두 지표 간의 균형을 평가하는 데 유용하다. 본 연구의 다중 스케일 잔차 주의 네트워크 기반 딥러닝 모델은 대부분의 클래스에서 f1-score가 0.99 이상의 성능을 제공하였다. 이는 전반적으로 높은 분류 성능을 나타내고, 각 클래스별로 편차 없이 일관된 높은 성능을 실험적으로 확인할 수 있었다.

Ⅴ. 결 론

본 논문에서는 다중 수준 이산 웨이브릿 변환과 다중 스케일 잔차 주의 네트워크를 결합한 아크 결함 분류 모델을 제안하였다. 실험 결과, 제안한 모델은 CNN, LSTM, ResNet 등과 같은 기존 딥러닝 모델 대비 아크 결함 분류 정확도가 99.38%로 높은 정확도 성능을 제공하는 것을 확인하였다. 또한, 비교 모델들보다 적은 수의 파라미터를 사용하면서도 뛰어난 정확도를 달성하였으며, 학습 시간 및 추론 시간 면에서도 효율적임을 확인하였다. 이를 통해 본 연구는 아크 결함 분류 분야에서 새로운 방향성을 제시하였으며, 더욱 효율적이고 정밀한 결함 분류 시스템 구축에 기여할 수 있음을 확인하였다.

향후 연구에서는 제안한 모델의 성능을 더욱 고도화하기 위해 다른 신경망 구조와의 결합, 다양한 데이터셋에 대한 적용, 그리고 실시간 아크 결함 분류 시스템으로의 확장 및 경량화 가능성에 대해 연구를 수행할 예정이다[21].

Acknowledgments

본 결과물은 농림축산식품부 및 과학기술정보통신부, 농촌진흥청의 재원으로 농림식품기술기획평가원과 재단법인 스마트팜연구개발사업단의 스마트팜다부처패키지혁신기술개발사업의 지원을 받아 연구되었음(RS-2024-00399033)

References

-

C.-R. Kim and S. Kim, "Smart Livestock Research and Technology Trend Analysis based on Intelligent Information Technology to improve Livestock Productivity and Livestock Environment", The Journal of The Institute of Internet, Broadcasting and Communication, Vol. 22, No. 4, pp. 133-139, Aug. 2022.

[https://doi.org/10.7236/JIIBC.2022.22.4.133]

-

H.-U. Seo and G.-H. Choe, "Analysis of Arc Characteristics in Power Conversion Systems", Journal of the Korean Institute of Illuminating and Electrical Installation Engineers, Vol. 27, No. 7, pp. 8-16, Jul. 2013.

[https://doi.org/10.5207/jieie.2013.27.7.008]

-

S. A. Aleem, N. Shahid, and I. H. Naqvi, "Methodologies in power systems fault detection and diagnosis", Energy Systems, Vol. 6, No. 1, pp. 85-108, Mar. 2015.

[https://doi.org/10.1007/s12667-014-0129-1]

- E. Choi, W. Yang, and J. Park, "A study on the use of artificial intelligence in the electric power industry", Proceedings of the Korean Information Processing Society Conference, Busan, Korea, pp. 690-693, Oct. 2018. https://scienceon.kisti.re.kr/srch/selectPORSrchArticle.do?cn=NPAP12897124, .

-

Y. Yoon, "Status Diagnosis Algorithm for Optimizing Power Generation of PV Power Generation System due to PV Module and Inverter Failure, Leakage and Arc Occurrence", The Journal of The Institute of Internet, Broadcasting and Communication (IIBC), Vol. 24, No. 4, pp. 135-140, Aug. 2024.

[https://doi.org/10.7236/JIIBC.2024.24.4.135]

- J.-H. Yoon, "A Study on the Utilization of Big Data in the Power Industry", M.S. thesis, Graduate School of Information, Yonsei University, Seoul, pp. 1-100, Feb. 2017.

-

W. Wang, Z. Guo, J. Yang, Y. Zhang, L. Durand, and M. Loew, M., "Analysis of the first heart sound using the matching pursuit method", Medical & Biological Engineering & Computing, Vol. 39, pp. 644-648, Nov. 2001.

[https://doi.org/10.1007/BF02345436]

-

R. K. Yadav, Abhishek, P. Shukla, N. Jaiswal, B. K. Chaurasia, and S. Verma, "Graph Convolutional Neural Network Using Wavelet Transform", Communications in Computer and Information Science, Vol. 1502, pp. 199-210, Jan. 2022.

[https://doi.org/10.1007/978-981-16-8896-6_18]

- Underwriters Laboratories Inc. (UL), UL Standard for safety for Arc-fault Circuit-Interrupters, ANSI UL 1699, Second Edition, 2008.

-

S. Mallat, "A Wavelet Tour of Signal Processing", Academic Press, pp. 50-53, Jan. 2008.

[https://doi.org/10.1016/B978-0-12-374370-1.X0001-8]

-

M. Vannucci and F. Corradi, "Covariance Structure of Wavelet Coefficients: Theory and Models in a Bayesian Perspective", Journal of the Royal Statistical Society Series B: Statistical Methodology, Vol. 61, No. 4, pp. 971-986, Nov. 1999.

[https://doi.org/10.1111/1467-9868.00214]

-

K. He, X. Zhang, S. Ren, and J. Sun, "Deep Residual Learning for Image Recognition", arXiv preprint, arXiv:1512.03385, , Dec. 2015.

[https://doi.org/10.48550/arXiv.1512.03385]

-

S. Kim and W. H. Lee, "Accelerating 3D Convolutional Neural Network with Channel Bottleneck Module for EEG-Based Emotion Recognition", MDPI Sensors, Vol. 20, No. 10, pp. 1-20, May 2020.

[https://doi.org/10.3390/s20102957]

-

S. Mekruksavanich, W. Phaphan, N. Hnoohom, and A. Jitpattanakul, "Attention-Based Hybrid Deep Learning Network for Human Activity Recognition Using WiFi Channel State Information", Applied Sciences, Vol. 13, No. 8884, pp. 10-15, Aug. 2023.

[https://doi.org/10.3390/app13158884]

- R. Ge, S. M. Kakade, R. Kidambi, and P. Netrapalli, "The Step Decay Schedule: A Near Optimal, Geometrically Decaying Learning Rate Procedure for Least Squares", NeurIPS, Vol. 32, No. 6, pp. 1-18, Dec. 2019.

-

S. Kiranyaz, T. Ince, and M. Gabbouj, "1D Convolutional Neural Networks for time series classification", Expert Systems with Applications, Vol. 149, pp. 113252, Aug. 2016.

[https://doi.org/10.1016/j.eswa.2020.113252]

-

S. Hochreiter and J. Schmidhuber, "Long Short-Term Memory", Neural Computation, Vol. 9, No. 8, pp. 1735-1780, Nov. 1997.

[https://doi.org/10.1162/neco.1997.9.8.1735]

-

S. Bai, J. Z. Kolter, and V. Koltun, "An Empirical Evaluation of Generic Convolutional and Recurrent Networks for Sequence Modeling", arXiv preprint arXiv:1803.01271, , Mar. 2018.

[https://doi.org/10.48550/arXiv.1803.01271]

-

K. He, X. Zhang, S. Ren, and J. Sun, "Deep Residual Learning for Image Recognition", Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, USA, pp. 770-778, Jun. 2016.

[https://doi.org/10.1109/CVPR.2016.90]

-

K. M. Ting, "Confusion Matrix", Encyclopedia of Machine Learning, pp. 209, Nov. 2011.

[https://doi.org/10.1007/978-0-387-30164-8_157]

-

Y. Yoon, "Development of DC Arc Generator to Protect Against Malfunctions and Fires Caused by Arcing", The Journal of The Institute of Internet, Broadcasting and Communication (IIBC), Vol. 21, No. 6, pp. 123-128, Dec. 2021.

[https://doi.org/10.7236/JIIBC.2021.21.6.123]

2024년 8월 : 대구가톨릭대학교 컴퓨터정보학부 인공지능·빅데이터공학전공(공학사)

2024년 9월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 석사과정

관심분야 : 딥러닝, 빅데이터, 신호처리, 컴퓨터 비전

1999년 2월 : 경희대학교 전파공학과(공학사)

2001년 2월 : 경희대학교 전자정보학부(공학석사)

2018년 8월 : 경희대학교 전자공학과(공학박사)

2001년 2월 ~ 현재 : 한국전자통신연구원 책임연구원

관심분야 : 무선통신, 인공지능, 임베디드 AI, 빅데이터

2023년 2월 : 대구가톨릭대학교 컴퓨터정보학부 인공지능·빅데이터공학전공(공학사)

2023년 3월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 석사과정

관심분야 : 인공지능, 딥러닝/머신러닝

2004년 2월 : 고려대학교 컴퓨터교육과(이학사)

2006년 2월 : 고려대학교 컴퓨터교육학과(이학석사)

2011년 2월 : 고려대학교 컴퓨터교육학과(이학박사)

2011년 3월 ~ 2011년 10월 : 고려대학교 정보창의교육연구소 연구교수

2011년 11월 ~ 2012년 11월 : University of Houston Post-Doc. 연구원

2012년 12월 ~ 2017년 8월 : 삼성전자 책임연구원

2017년 9월 ~ 현재 : 대구가톨릭대학교 AI빅데이터공학과 부교수

관심분야 : 클라우드 컴퓨팅, 빅데이터, 인공지능

2000년 2월 : 경북대학교 전자·전기공학부(공학사)

2002년 2월 : 포항공과대학교 전자컴퓨터공학부(공학석사)

2016년 2월 : 포항공과대학교 전자·전기공학과(공학박사)

2002년 1월 ~ 2019년 8월 : 한국전자통신연구원 책임연구원

2019년 9월 ~ 2024년 8월 : 대구가톨릭대학교 AI빅데이터공학과 조교수

2021년 3월 ~ 2024년 8월 : 대구가톨릭대학교 SW중심대학사업단 SW기초교육센터장

2024년 9월 ~ 현재 : 한국교원대학교 컴퓨터교육과 조교수

관심분야 : 컴퓨터 교육, 임베디드 AI, 인공지능, 딥러닝/머신러닝