가상현실 직업훈련 과정에서 발달장애인 행동의 가시화 방법

초록

발달장애인은 인지 능력이 저조하여 가상환경에서 직업훈련을 원활히 수행하는데 비장애인에 비해 다수의 어려움이 발생할 수 있다. 발달장애인의 가상직업훈련 효과를 높이기 위해서는, 훈련 도중에 더 이상의 진행이 불가한 상황이 발생하면 훈련콘텐츠에서 이러한 상황을 파악하여 발달장애인이 가상직업훈련을 올바르게 수행할 수 있도록 도움을 주는 중재(intervention)를 제공하는 것이 필요하다. 중재의 종류에는 사람의 직접적인 도움 또는 콘텐츠에서 제공하는 도우미의 음성 또는 동영상 등이 있다. 본 논문은 중재가 필요한 시점을 콘텐츠에서 판단하는 기준을 도출하기 위한 연구의 일환으로 발달장애인이 가상환경에서 훈련을 수행하는 과정에서 수집된 시선추적 정보를 가시화하는 방안을 제안한다. 본 논문에서 제안하는 가시화 방법은 직관적으로 이해하기 난해한 행동 데이터를 탐색적으로 분석하는 방안을 제공하여 이후의 정량적 분석을 보완하기 위한 추가 정보를 제공하기 위한 목적으로 활용될 수 있다.

Abstract

People with developmental disabilities may be challenged by their intellectual abilities and thus may experience problems in being trained in a virtual environment compared to non-disabled people. In order to increase the effectiveness of virtual training for people with developmental disabilities, it is necessary that training programs identify the proper timing of any necessary intervention. An intervention involves a human’s assistance or a virtual helper’s voice/video provided by the program. Using eye tracking data, this paper presents a way of visualizing the behavior characteristics of people with developmental disabilities during virtual reality-based training. The visualization method proposed in this paper can be used for the purpose of providing additional information to supplement the quantitative analysis, by providing a method for exploratory analysis of behavioral data that is difficult to understand intuitively.

Keywords:

virtual reality, developmental disabilities, behavior analysis, visualization, job trainingⅠ. 서 론

발달 장애란 신체적, 정신적인 영역에서 발달이 지체되어 언어, 감각, 신체활동뿐만 아니라 전반적인 인지 능력에 어려움을 겪는 상태를 의미한다. 발달장애인의 수는 전 세계적으로 2009년에는 6.9%, 2015년에는 8.2%, 2018년에는 9%로 매년 증가 추세에 있으며 국내의 경우는 2022년에 26만 명에 이를 것으로 전망된다. 다른 장애인의 숫자가 정체된 반면, 발달장애인은 매년 6천 명에서 7천 명 수준으로 꾸준히 증가하고 있다.

발달 장애는 특징적인 증상들이 대부분 만 3세 이전부터 나타나기 시작하여 일상생활이나 사회생활에 상당한 제약을 받음으로써 일생의 지속적인 사회적 돌봄이 필요하므로 사회적 비용이 매년 증가할 것으로 예상한다. 따라서, 발달장애인에 대한 사회적 비용을 낮추고 발달장애인의 사회적 통합을 위해서는 수동적인 돌봄의 대상에서 능동적인 역할을 수행하는 대상으로의 변화가 필요하다. 이를 위해 전국에 설립된 발달장애인 훈련센터에서는 개인별 지원계획을 수립하고 학령기에는 직업체험훈련 강화를 통한 직무 및 취업 역량 향상을 추진하고 있다. 특히, 도서관 사서, 바리스타, 간병 등 단순하고 반복적인 업무는 직업훈련을 통해 취업까지도 연계되고 있다.

최근에는 가상현실(Virtual reality) 기술을 활용하여 몰입감을 제공하고 지속적인 관심을 유도하는 콘텐츠들이 개발되고 있다[1][2]. 특히, 발달장애인을 대상으로 자발적으로 흥미를 느낄 수 있도록 유도하는 직업 훈련 콘텐츠의 연구도 활발하다. 발달장애인의 가상현실 프로그램의 사용에 있어서 일반적인 선입견은 장애로 인하여 가상현실 콘텐츠를 활용하기 힘들 것이며 HMD(Head Mounted Display)에 대한 거부감이 존재할 것이라는 점이다. 그러나 발달장애인들도 일반인들과 마찬가지로 HMD나 가상현실 콘텐츠를 조작하기 위한 컨트롤러에 대한 사전 교육을 받으면 가상현실 콘텐츠를 충분히 조작할 수 있고 이러한 조작 활동을 통해 오히려 수업에 대한 높은 관심을 가진다는 점이 많은 연구를 통해 증명되고 있다[3]-[5].

가상현실 기술을 활용한 직업훈련 콘텐츠 중에서 바리스타 훈련은 발달 장애인을 대상으로 주목받는 콘텐츠이다. 대전복지재단의 ‘장애 유형별 일자리 수요조사 및 확대방안 연구’에 따르면 장애 학생과 장애 학생 부모님이 원하는 직업순위 1위가 바리스타로 선정되었으며[6], 커피숍으로 취업하는 발달장애인의 인구 또한 지속해서 증가하고 있다. 이에, 한국장애인개발원에서는 ‘발달장애인을 위한 쉬운 바리스타 업무 매뉴얼’과 같은 자료를 제작하여 배포하여 바리스타 교육을 적극적으로 지원하고 있다[7].

그러나 단순히 바리스타 교육을 받는 것으로 끝나지 않고 현장에서 실습과 훈련을 반복해보는 것이 학습에 있어서 중요한 역할을 차지하는데 관련 시설들이 매우 부족한 상황이다. 교육부의 ‘2019년 특수교육통계’ 보고서에 의하면 177개의 특수학교와 8200개의 일반 학교 중 전공과를 포함하는 학교의 수는 각각 147개와 18개뿐이며 이중 바리스타 훈련이 가능한 곳은 매우 제한적이다[8]. 이와 같은 이유로 바리스타 교육을 가상직업훈련 콘텐츠로 제작하는 것은 매우 의미 있는 작업이다.

발달장애인은 인지 능력의 한계로 인해 가상환경에서 직업훈련을 원활히 수행하는데 비장애인보다 다수의 어려움이 발생할 수 있다. 발달장애인의 가상직업훈련 효과를 높이기 위해서는, 직업훈련과제를 수행하는 도중에 더 이상의 진행이 불가한 상황이 발생하면 훈련콘텐츠에서 이러한 상황을 파악하여 발달장애인이 가상직업훈련을 올바르게 수행할 수 있도록 도움을 주는 중재(Intervention)를 제공하는 것이 필요하다. 중재의 종류에는 사람의 직접적인 도움 또는 콘텐츠에서 제공하는 도우미의 음성 또는 동영상 등이 있다. 기존에 수행된 발달장애인 대상의 가상직업훈련 콘텐츠와 관련된 대부분의 국내외 연구들은 가상환경에서 직업훈련의 효과를 검증하기 위해 훈련 전후의 차이를 비교한 경우가 대부분이므로 관련 연구는 매우 부족한 상황이다[9][10].

본 논문은 가상현실 기반의 바리스타 훈련을 수행할 때 주어진 작업을 수행하면서 발달 장애인이 어려움을 겪는 시점, 즉 중재가 필요한 시점을 콘텐츠에서 판단할 방안을 도출하기 위해 시선 추적 정보를 기반으로 한 가시화(Visualization) 방법을 이용한다. 시선 추적은 인간의 행동을 분석하는 데 중요한 역할을 담당하여 왔다. 시선 추적 데이터의 분석은 통계적 방법을 이용하여 정량적으로 수행될 수도 있지만 최근에는 가시화 기술을 이용한 정성적 분석 방법을 활용하는 추세이다. 통계 분석은 정량적인 결과를 제공하지만 가시화를 통해 시선 추적 데이터의 다른 측면을 정성적인 방법으로 분석할 수 있다. 가시화는 데이터 내의 시간과 공간적 측면, 그리고 데이터 내의 복잡한 관계를 이해하는데 도움을 주고 이후에 통계적 방법으로 분석할 수 있는 연구 가설을 찾는데도 유용하다. 또한, 시선 추적 실험의 복잡성이 증가함에 따라 정량적 분석을 보완하기 위한 중요한 역할을 수행하고 있다[11]. 본 논문에서는 바리스타 훈련을 수행하는 상황에서 발달장애인의 시선을 추적한 데이터를 수집하고 타임라인(Timeline) 그래프를 이용하여 가시화하고 정성적인 분석을 수행한다.

Ⅱ. 연구 방법 및 절차

2.1 연구대상

본 연구는 가상현실기술을 활용한 바리스타 직업훈련 중에 발달장애인에게 중재를 제공해야 할 시점을 판단하기 위해 대조군 없이 단일 실험군을 대상으로 수행하였다. 연구대상자는 한국전자통신연구소와의 업무협약을 바탕으로 발달장애인훈련센터에 재학하고 있는 지적장애 학생 21명을 선정하였다.

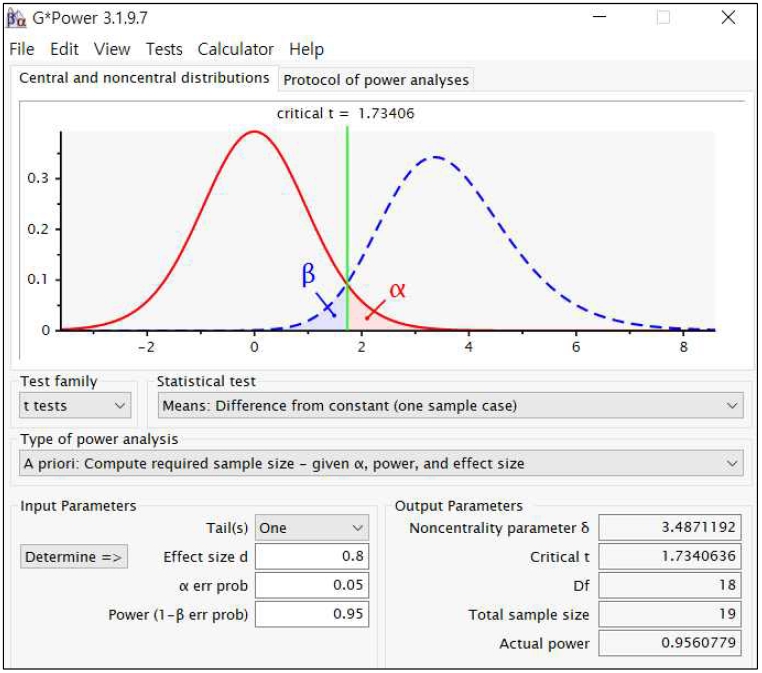

연구대상자의 산출근거는 다음과 같다. 단일집단으로 G*power 프로그램을 사용하여 t-test를 위해 0.8의 effect size, 0.95의 power value, 0.05의 alpha를 적용하였을 때 샘플수는 그림 1과 같이 19명으로 산출되었다. 연구대상자가 발달장애인이고 실험 도중 이탈 가능성을 충분히 고려하여 10%를 상향한 21명으로 선정하였다.

연구대상자의 모집방법은 다음과 같다. 모집공고문을 발달장애인훈련센터의 게시판에 공고하고 센터의 협조를 통해 수업시간에 모집에 대한 안내를 설명하였다.

발달장애인이 참여를 희망하는 경우에 먼저 보호자와 대면 또는 전화통화로 모집공고문 및 동의서를 설명하였고, 보호자는 연구목적과 방법에 대해 충분한 설명을 듣고 참여 여부를 판단하였으며, 보호자의 허락을 받은 경우에 한해서 해당 발달장애인을 연구대상자로 최종 선정하였다. 실험에 참여하기 전에 발달장애인 본인과 보호자로부터 서면으로 동의를 받았으며, 만약 보호자의 서면 동의가 어려울 때는 전화로 동의를 받고 음성 녹음으로 서명을 대신하도록 하였다. 연구대상자의 선정기준과 제외기준은 표 1, 표 2와 같다.

2.2 연구도구

연구에 사용된 도구로는 가상현실 기반의 바리스타 훈련콘텐츠, 뇌파측정 및 시선추적을 위한 상용 HMD, 가상현실 콘텐츠를 조작하기 위한 컨트롤러가 있다. HMD는 룩시드랩스에서 개발한 상용 제품을 사용하였다[12]. 그림 2는 바리스타 훈련 콘텐츠, 그림 3은 HMD, 그림 4는 컨트롤러이다.

바리스타 훈련콘텐츠는 용어교육과 바리스타 교육으로 구성된다. 먼저, 용어교육을 시행하여 콘텐츠에 등장하는 단일 바리스타 객체(예: 에스프레소 머신)에 대한 인지 훈련을 수행한 후, 다수의 바리스타 객체들을 복합적으로 다루어야 하는 본격적인 바리스타 교육을 시행한다. 용어교육을 통해 연구대상자들이 인지하도록 훈련받는 객체들은 에스프레소머신, 그라인더, 그룹헤드, 포타필터, 템퍼, 템퍼 받침대, 샷잔, 넉박스, 스팀밀크피쳐, 스팀 밸브, 스팀 노즐, 마른 리넨 천, 그리고 젖은 리넨 천이다.

용어교육이 시작되면 콘텐츠에서는 “에스프레소 머신을 찾아서 손으로 만져볼까요?”라는 음성 안내를 제공한다. 연구대상자가 에스프레소 머신을 찾아서 터치하면 ‘에스프레소 머신’ 단어가 가상공간상의 에스프레소 머신의 근처에 잠깐 나타나고 곧이어 “그라인더를 찾아서 손으로 만져볼까요?”라는 음성 안내가 제공된다.

이와 같은 흐름으로, 콘텐츠가 음성으로 안내하는 객체를 찾아서 성공적으로 터치하면 다음 객체에 대한 음성 안내가 이어지고 용어교육에 포함된 마지막 객체가 터치됨과 동시에 용어교육이 종료된다. 그림 5는 연구대상자가 음성 안내에 따라 스팀밀크피쳐를 찾아서 터치한 직후의 화면캡쳐이다.

바리스타 교육도 용어교육과 흐름은 유사하게 진행된다. 시작과 동시에 “포타필터를 장착 해제해주세요” 라는 음성 안내가 제공된다. 연구대상자가 포타필터를 에스프레소 머신으로부터 성공적으로 분리하면 곧이서 “마른 린넨천으로 포타필터를 닦아주세요”라는 다음 미션에 대한 음성 안내가 제공되고 모든 미션이 종료될 때까지 이 흐름은 반복된다.

본 논문은 발달장애인들의 용어교육 과정에서 생성되는 시선 데이터를 대상으로 가시화 작업을 수행하였다. 용어교육의 경우에는 각 미션과 관련된 객체가 단일 객체이므로 데이터를 가시화하였을 때 해당 미션을 수행하기 위해 터치가 필요한 관심 객체와 시선이 머무르는 객체간의 확연한 구별이 가능하지만, 바리스타 교육의 경우에는 각 미션마다 복수의 객체들이 관여되어 있고 각 미션이 의도하는 대로 이들 객체가 복합적으로 다루어져야 비로소 해당 미션이 성공하므로 복잡성이 높다. 따라서 바리스타 교육 과정에 대한 분석은 용어교육을 대상으로 분석된 시선추적결과를 기반으로 향후 연구로 수행할 예정이다.

2.3 연구절차

실험 시작 전, 연구원은 연구 수행 방법 및 절차에 대한 안내를 연구대상자가 이해하기 쉬운 용어를 사용하여 설명하였다. 연구대상자는 HMD를 착용하고 가상현실 콘텐츠를 조작하기 위한 컨트롤러를 이용하여 연구진이 가상현실 기술을 기반으로 개발한 바리스타 직업훈련 과제를 수행하였다. 이때, 총 실험시간은 1시간 내외로 소요되었다.

연구대상자가 바리스타 직업훈련 과제를 수행하는 도중에 더 이상의 진행이 불가한 상황이 발생하면 사전에 약속한 방법으로 (버튼 누르기, 손들기, 말하기 등) 중재를 요청하였다. 연구대상자가 중재를 요청한 시점은 가상 직업훈련 과정에서의 중재 시점 판단을 위한 기준자료(Ground truth)로 사용되었다.

중재 요청이 들어오면 가상현실 콘텐츠에서는 어려움을 겪은 작업에 대한 도우미 동영상 (예: 포타필터를 머신과 분리하는 동영상)을 연구대상자에게 제공하였다. 연구대상자가 도우미 동영상을 시청한 후에도 해당 단계를 진행하기 어려운 상황에는 연구자의 도움을 받아 해당 단계를 완료하였다.

실험종료 후에 연구자는 인터뷰를 통해 미리 준비된 질문을 연구대상자에게 실시하였다. 연구책임자는 연구대상자의 반응을 관찰하고, 실험환경에서 기록되는 데이터를 수집하였다.

연구대상자는 HMD를 착용하고 가상과제를 수행하므로 예외적으로 어지러움에 특별히 예민한 연구대상자가 존재할 가능성을 완전히 배제할 수 없다. 이를 고려하여 한국 가상증강현실 산업협회와 한국전자통신연구원에서 제작한 연구보고서인 ‘VR AR 이용 및 제작 안전 가이드라인’에 근거하여 HMD를 30분 동안 착용 시 10~15분 정도의 휴식을 취하도록 하고, 원하면 언제든 실험을 중단하도록 하였다[13]. 휴식 후에도 어지러움이 안정되지 않으면 발달장애인훈련센터와 연계된 의료기관으로 이송해 조치하도록 하였으나 실험 중에 이러한 상황은 발생하지 않았다.

Ⅲ. 데이터 분석

3.1 데이터 수집

연구대상자의 시선 데이터는 HMD에 부착된 아이트래커(Eye Tracker)를 이용하여 연구대상자가 바리스타 훈련을 수행하는 과정에서 시선이 머무르는 가상공간상의 객체의 정보를 수집하였다.

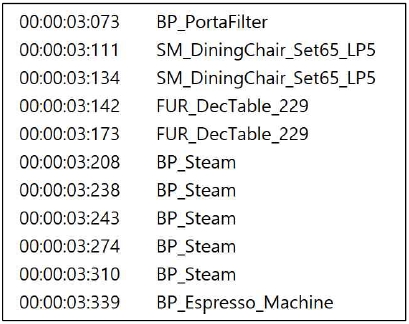

그림 6은 HMD에서 수집된 시선 데이터의 원본이며 수집 간격은 약 8~38ms이다. 첫 번째 칼럼은 시간 정보를 의미하여, 두 번째 칼럼은 그 시점에서 시선이 머무르는 가상 콘텐츠 공간상의 객체 명이다. BP_PortaFilter는 포타필터를, SM_DiningChair는 의자를, FUR_DecTable은 테이블을, BP_Steam은 스팀벨브를, BP_Espresso_Machine은 에스프레소머신을 의미한다.

3.2 데이터 정제

인지 과정은 복잡하여 시선이 머무르는 대상에 실제로 관심이 있는지는 항상 일치한다고 단정할 수는 없다. 그러나 많은 연구 결과에 따르면 특정 시점에서 개인의 관심과 생각은 해당 시점에서 시선이 머무르는 대상과 일치할 가능성이 큰 것으로 증명되었다[14][15].

시선의 움직임을 기반으로 인지 특성 및 행동 특성을 분석하고자 하는 연구에서는 시선의 고정(Fixation) 정보를 일반적으로 활용한다. 시선의 고정은 최소한 100~200ms 동안 특정 지점을 응시할 때 발생한다. 이에, 시선 데이터를 분석하여 의미 있는 결과를 도출하기 위해서 HMD에서 수집된 원본 데이터를 정제하여 시선의 고정 정보를 추출하였다.

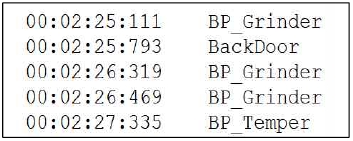

그림 7은 정제 작업을 통해 추출된 시선의 고정 데이터의 일부이다. BP_Grinder는 그라인더를, BackDoor는 가상공간상의 문을, BP_Temper는 템퍼를 의미한다. 의미를 해석하면, 바리스타 훈련이 시작된 후 2분 25초 111밀리 초에 연구대상자의 시선은 그라인더에 머물렀다가 2분 25초 793밀리 초에 문으로 이동하였다. 그리고 2분 26초 319밀리 초에 다시 그라인더로 돌아왔다가 2분 27초 335밀리 초에 템퍼로 이동하였다.

3.3 데이터의 가시화

가시화는 직관적으로 이해하기 어려운 복잡한 데이터를 효율적으로 탐색하기 위한 이상적인 수단이다[16]-[18]. 본 논문에서는 발달장애인들이 가상현실 기반의 바리스타 훈련을 수행할 때의 인지 및 행동 특성을 분석하고자 타임라인 가시화 방법을 사용한다. 이 방법은 시선이 머무르는 객체의 순서, 특정 객체에 시선이 얼마나 오랫동안 머무르는지, 바리스타 훈련의 단계별로 소요되는 상대적인 시간의 길이 등의 정보를 직관적으로 파악할 수 있도록 한다. 가시화 작업을 위해서는 표 3과 같이 가상공간상의 객체명을 단순화한 코드가 필요하다.

본 논문에서는 영문과 숫자의 조합으로 코드를 생성하였으며 이를 ‘매핑코드’라고 정의하였다. 바리스타 용어교육에는 약 85개의 가상 객체들이 포함된다. 이들 중 바리스타 작업과 관련있는 객체들 중에 주요 객체들이 용어교육에 포함된다. 나머지는 가상 공간상의 천장, 바닥, 창문과 같이 바리스타 작업과는 관계가 없는 객체들이다. 표 3의 첫 번째 칼럼은 각 가상객체를 의미하는 매핑코드이며, 두 번째 칼럼은 해당 코드로 대표되는 가상객체를 의미한다.

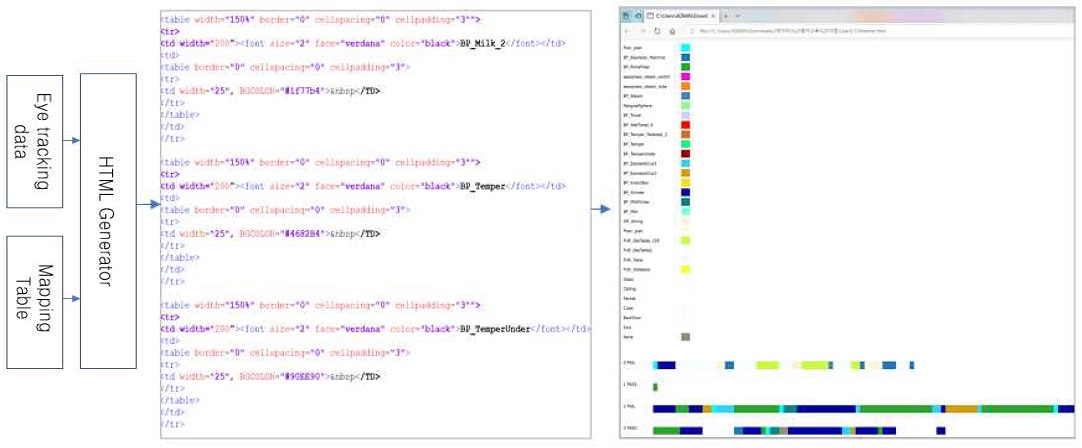

표 4는 매핑코드를 기반으로 생성된 매핑 테이블의 예시이다. 시선의 고정 데이터는 CSV 파일 형태로 저장되어 있다. 이 데이터는 가시화를 위해 매핑 테이블을 기반으로 영숫자의 문자열로 변환된다. 예를 들어, 그림 7의 시선 데이터에 대한 영숫자 문자열은 F1Z1F1F1C2 이다. 이러한 과정을 통해 생성된 영숫자 문자열을 기반으로 타임라인 가시화를 생성하기 위한 과정은 그림 8과 같다.

HTML Generator 모듈은 시선 데이터와 매핑 테이블을 입력 받아서 구글에서 제공하는 가시화 API를 이용하여 시선 데이터를 웹 기반의 타임라인 그래프로 생성하는 역할을 담당한다. 이 과정에서 매핑 테이블은 그래프의 범례로, 영숫자 문자열은 타임라인 그래프로 변환된다.

Ⅳ. 분석 결과

표 5는 10명의 연구대상자에 대한 용어교육의 성공과 실패의 결과를 보인다. 연구대상자들이 가장 많이 성공한 바리스타 객체는 템퍼, 템퍼받침대, 샷잔이고, 성공률이 가장 낮은 바리스타 객체는 용어교육의 첫 번째 객체인 에스프레소 머신이다.

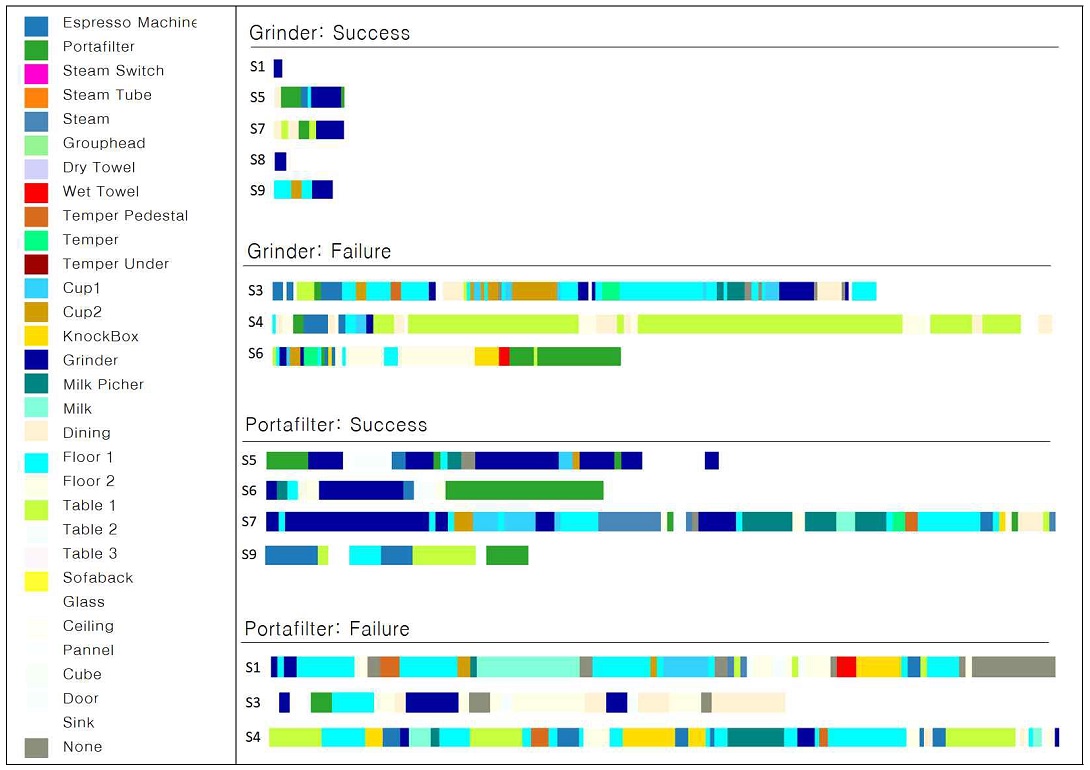

본 논문에서 제시한 방법으로 생성한 타임라인 그래프를 이용하여 발달장애인 행동 분석이 가능함을 보이기 위해 ‘그라인더’ 와 ‘포타필터’ 용어교육 수행 중에 수집된 시선 추적 데이터로 생성한 가시화 그래프를 이용한다.

두 객체를 선정한 이유는 성공과 실패가 비교적 고르게 분포되었으므로 두 그룹간의 비교가 가능하기 때문이다. 그림 9는 ‘그라인더’와 ‘포타필터’ 용어교육 중에 수집된 시선 추적 데이터로 생성한 가시화 그래프이다.

그라인더의 경우, 10명 중 5명(S1, S5, S7, S8, S9)의 발달 장애 학생들이 중재 없이 성공하였고 3명(S3, S4, S6)의 학생들은 중도에 포기하여 실패하였다. 나머지 2명은 아이트래커가 정상적으로 동작하지 않아서 분석에서 제외되었다. 그래프에 의하면, 성공한 그룹 중에 S1과 S8은 미션 안내를 받고 곧장 그라인더로 시선이 집중되었고, S5, S7, S9은 최소 3개, 최대 5개의 다른 객체들을 거쳐서 그라인더에 시선이 도달하였다. 실패한 그룹은 성공한 그룹에 비하여 상대적으로 훈련에 긴 시간을 소요했으며 시선이 집중된 객체의 수는 최소 9개, 최대 14개이다.

포타필터의 경우, 10명 중 4명(S5, S6, S7, S9)의 발달 장애 학생들이 중재 없이 성공하였고 3명(S1, S3, S4)의 학생들은 중도에 포기하여 실패하였다. 나머지 3명은 아이트래커가 정상적으로 동작하지 않아서 분석에서 제외되었다.

그래프에 의하면, 그라인더의 경우와 마찬가지로 실패한 그룹은 성공한 그룹에 비하여 상대적으로 훈련에 긴 시간을 소요했으며, 시선이 집중된 객체의 수는 성공한 그룹은 최소 5개, 최대 15개이고 실패한 그룹은 최소 10개, 최대 15개이다. 단, 성공한 그룹의 S7은 같은 그룹에 속한 S5, S6, S9과 비교하면 훈련 시간이 예외적으로 길어서 해당 장면을 녹화해둔 비디오를 확인해보니, 해당 학생이 에스프레소 머신의 다른 부분을 만져보다가 우연히 포타필터에 손이 스치게 되어서 본인의 의도와는 상관없이 해당 미션을 통과하게 된 예외적인 경우임을 알 수 있었다.

결론적으로, 그라인더와 포타필터 경우 공통적으로 성공한 그룹에 비하여 실패한 그룹이 훈련에 소요된 시간이 길었다. 특히, 그라인더의 경우는 포타필터보다 두 그룹 간의 시간차가 월등히 컸다. 원인 파악을 위해 해당 장면을 녹화해둔 비디오를 확인해보니, 그라인더의 경우는 기계의 부피가 하나의 테이블을 차지할 만큼 크고 다량의 커피 원두가 기계 내부에 저장되어 있음이 확연히 보이므로 인지하기가 쉽지만, 포타필터의 경우는 부피가 작고 에스프레소 머신의 한쪽 구석에 장착이 되어 있어서 인지하기가 쉽지 않음을 발견하였다. 따라서 성공한 집단이라도 객체의 종류와 특성에 따라 훈련을 통과하는 시간은 차이가 있을 수 있음을 알 수 있었다.

또한, 그라인더와 포타필터 경우 모두 훈련중에 시선이 집중된 객체의 종류가 훈련에 실패한 그룹이 성공한 그룹에 비하여 상대적으로 많았다.

표 6에 의하면, 그라인더의 경우는 실패한 그룹이 성공한 그룹보다 시선이 집중된 객체의 종류가 평균적으로 약 4배, 포타필터의 경우는 약 2배가 많았다. 괄호안의 % 값은 그림 9에서 아이트래커의 오류인 “None” 인 경우를 제외한 30개의 객체들을 대상으로 한 상대적인 수치이다.

Ⅴ. 결론 및 향후 과제

본 논문은 시선추적 데이터를 가시화하기 위해 가상객체들에 대한 매핑코드를 생성하여 시선 데이터를 영숫자 문자열로 변환하여 HTML 포맷의 타임라인 그래프로 생성하는 방안을 제안하였다. 미션을 성공적으로 수행하여 중재가 필요 없는 그룹과 미션 수행을 도중에 포기하여 중재가 필요한 그룹 간의 차이를 그래프를 이용하여 분석이 가능함을 보이기 위해, 본 논문에서는 그라인더와 포타필터 용어교육 수행 중에 수집된 시선 추적 데이터로 타임라인 그래프를 생성하였다. 이를 기반으로, 중재가 필요한 그룹은 필요 없는 그룹에 비하여 훈련에 소요되는 평균 시간이 길고 훈련 중에 시선이 집중된 가상 객체의 종류 또한 다양함을 유추할 수 있었다. 이는, 이후에 모든 연구대상자와 가상공간상의 객체들을 대상으로 정량적 방법으로 분석할 수 있는 의미있는 연구 가설 중의 하나로 사용될 수 있음에 본 연구의 의의가 있다.

Acknowledgments

본 연구는 한국전자통신연구원 연구운영비지원사업의 일환으로 수행되었음. [21ZH1230, 초실감 입체공간 미디어·콘텐츠 원천기술 연구]

References

-

M. K. Choi and J. Y. Kim, "Analysis of a Cognitive Training based on Virtual Reality Contents for the Elderly", Journal of KIIT, Vol. 18, No. 10, pp. 139-147, Oct. 2020.

[https://doi.org/10.14801/jkiit.2020.18.10.139]

-

H. J. Ha, S. J. Park, and S. K. Lee, "Design of Mobile Application for Virtual Reality-based Tour Information Using Leap-Motion and Unity 3D", Journal of KIIT, Vol. 15, No. 10, pp. 135-142, Oct. 2017.

[https://doi.org/10.14801/jkiit.2017.15.10.135]

- T. S. Lee, "The Effect of Virtual Reality based Intervention Program on Communication Skills in Cafe and Class Attitudes of Students with Intellectual Disabilities", Journal of the Korea Convergence Society, Vol. 10, No. 3, pp. 157-165, Mar. 2019.

-

S. J. Kim, T. Y. Kim, and C. S. Lim, "Mixed-Reality Based Situation Training System for the Developmental Disabled", Journal of the Korea Computer Graphics Society, Vol. 14, No. 2, pp. 1-8, Jun. 2008.

[https://doi.org/10.15701/kcgs.2008.14.2.1]

-

S. R. Lee and Y. S. Lee, "Wearable Technology Use for People with Developmental Disabilities: Exploring Research Trends and Program Characteristics", Special Education Research, Vol. 19, No. 2, pp. 55-74, May 2020.

[https://doi.org/10.18541/ser.2020.05.19.2.55]

- K. S. Kim, C. S. Lee, and J. H. Cho, "Research on job demand and expansion plans for each type of disability", Daejeon Welfare Foundation, pp. 1-366, Nov. 2016.

- KODDI(Korea Disabled people’s Development Institute), "Easy barista work manual for people with developmental disabilities", https://www.koddi.or.kr/data/manual01_view.jsp?brdNum=7406648, . [accessed: Dec. 31, 2020], pp. 1-86, Dec. 2018.

- Ministry of Education, "2019 Special education statistics", https://www.moe.go.kr/boardCnts/view.do?boardID=316&lev=0&statusYN=W&s=moe&m=0302&opType=N&boardSeq=77872, [accessed: Dec. 31, 2020], pp. 1-198, Jun. 2019.

- Y. T. Kim and Y. K. Lee, "Vocational education for people with developmental disabilities Sequential Job Training Effectiveness of Virtual Reality Contents", Proceedings of KIISE, pp. 1510-1512, Jan. 2018.

-

J. I. Choi, K. R. Kim, and T. Y. Kim, "A Situational Training System based on Augmented Reality for Developmentally Disabled People", Journal of Korea Multimedia Society, Vol. 16, No. 5, pp. 629-636, Jan. 2013.

[https://doi.org/10.9717/kmms.2013.16.5.629]

-

T. Blascheck, K. Kurzhals, M. Raschke, M. Burch, D. Weiskopf, and T. Ertl, "Visualization of eye tracking data: A taxonomy and survey", Computer Graphics Forum, Vol. 36, No. 8, pp. 260-284, Dec. 2017.

[https://doi.org/10.1111/cgf.13079]

- Looxid Link, https://looxidlabs.com/looxidlink/product/looxid-link-package-for-vive-pro, . [accessed: Dec. 31, 2020]

- VRAR usage guidlines v3.0, http://kvra.kr/kovra-VR%ED%9C%B4%EB%A8%BC%ED%8C%A9%ED%84%B0/vrar-%EC%9D%B4%EC%9A%A9-%EB%B0%8F-%EC%A0%9C%EC%9E%91-%EC%95%88%EC%A0%84-%EA%B0%80%EC%9D%B4%EB%93%9C%EB%9D%BC%EC%9D%B8-v3-0/, [accessed: Dec. 31, 2020]

-

M. A. Just and P. A. Carpenter, "A theory of reading: From eye fixations to comprehension", Psychological review, Vol. 87, No. 4, p. 329, Jan. 1980.

[https://doi.org/10.1037/0033-295X.87.4.329]

-

H. Deubel, K. O’Regan, and R. Radach, "Attention, information processing and eye movement control", Reading as a perceptual process, pp. 355-374, Elsevier, Oxford, 2000.

[https://doi.org/10.1016/B978-008043642-5/50017-6]

-

J. M. Penrose, "Annual report graphic use: A review of the literature", Journal of Business Communication, Vol. 45, No. 2, pp. 158-180, Apr. 2008.

[https://doi.org/10.1177/0021943607313990]

- B. B. Bederson and B. Shneiderman, "The craft of information visualization: Readings and reflections", Morgan Kaufmann, 2003.

-

B. O. Oh, "Map Detection Using Deep Learning", JAITC, Vol. 10, No. 2, pp. 61-72, Dec. 2020.

[https://doi.org/10.14801/JAITC.2020.10.2.61]

1999년 2월 : 부산대학교 컴퓨터공학과(공학사)

2001년 2월 : 부산대학교 컴퓨터공학과(공학석사)

2005년 2월 : Carnegie Mellon University, 한국과학기술원(소프트웨어공학석사)

2014년 7월 : University of Massachusetts Amherst, Computer Science(공학박사)

2005년 7월 ~ 2019년 8월 : 한국전자통신연구원, 책임연구원

2019년 9월 ~ 현재 : 부산교육대학교, 컴퓨터교육과, 조교수

관심분야 : 컴퓨터교육, 인공지능, 인간공학, 헬스케어