사전 학습된 네트워크 모델을 이용한 심전도 신호 기반 개인 식별 성능 분석

초록

기존 개인 식별 방법은 다양한 범죄에 취약한 문제점이 있어 이를 보완하기 위해 신체 내부 특징인 바이오 신호를 활용한 연구가 진행되고 있다. 그중 심전도 신호는 심장의 크기와 위치에 따라 개인마다 고유한 특성이 있어 개인 식별에 적합하며, 딥 러닝과 접목하여 많은 연구가 진행되고 있다. 본 논문에서는 2차원 심전도 이미지를 이용한 사전 학습된 네트워크 모델에 따른 개인 식별 성능을 분석한다. 심전도 데이터 세트를 학습시키기 위한 사전 학습된 네트워크 모델은 Inception, ResNet의 11개 네트워크를 사용한다. 네트워크의 학습 데이터는 심전도 신호의 한 주기로 생성한 2차원 이미지 데이터를 이용하며, 실험은 학습 횟수를 변경하며 진행한다. 사전 학습된 네트워크 모델을 이용한 심전도 신호 기반 개인 식별 실험 결과 Inception 네트워크에 비해 ResNet 네트워크의 성능이 높게 나타났으며, Inception 네트워크에선 Inception-ResNet-V2가 96.18%, ResNet 네트워크에선 ResNet-V2-152가 99.12%의 성능으로 가장 높음을 확인하였다.

Abstract

The existing personal identification method has a problem that is vulnerable to various crimes, and researches using biosignals, which are internal characteristics of the body, are being conducted to compensate for this. Among them, ECG signals are unique to each person according to the size and location of the heart, which makes them suitable for personal identification, and many studies are being conducted in conjunction with deep learning. In this paper, we analyze the performance of personal identification according to the pre-trained network model using 2-D ECG images. The pre-trained network model for training ECG data sets uses 11 networks of Inception and ResNet. The training data of the network uses 2-D image data using one period of the ECG signal, and the experiment is performed by changing the number of learning. Inception-ResNet-V2 is the highest in the Inception network with 96.18% performance, ResNet-V2-152 is the highest in the ResNet network with 99.12% performance.

Keywords:

electrocardiogram signal, deep learning, convolutional neural network, personal identificationⅠ. 서 론

바이오 인식 기술이란 신체의 고유한 특징을 이용해 개인을 식별하는 기술로, 신체 외부 특징을 이용한 방법과 신체 내부 특징(바이오 신호)을 이용한 방법으로 나뉜다. 신체 외부 특징을 이용한 방법은 얼굴, 홍채, 지문 등이 있으며, 현재 금융 분야, 보안 분야 등 다양한 분야에 활용되고 있다. 그러나 신체 외부 특징을 이용한 개인 식별 방법은 생동감이 없는 데이터로 위조가 가능해 범죄에 취약하며, 외부 조명 변화 및 빛 반사로 인해 확인하기 어려운 문제점이 있다[1][2].

이에 따라 위조 및 변조에 강인한 신체 내부 특징인 바이오 신호를 이용한 개인 식별 연구가 활발히 진행되고 있다[3]. 바이오 신호는 신체 내부에서 발생하는 데이터로, 심전도, 뇌전도, 근전도 신호 등이 있다. 이중 심전도 신호는 심장의 박동을 전압의 형태로 기록한 신호로 위변조가 어려우며 심장의 크기와 위치 등에 의해 개인마다 고유한 신호를 나타내 개인 식별에 적합하다[4][5].

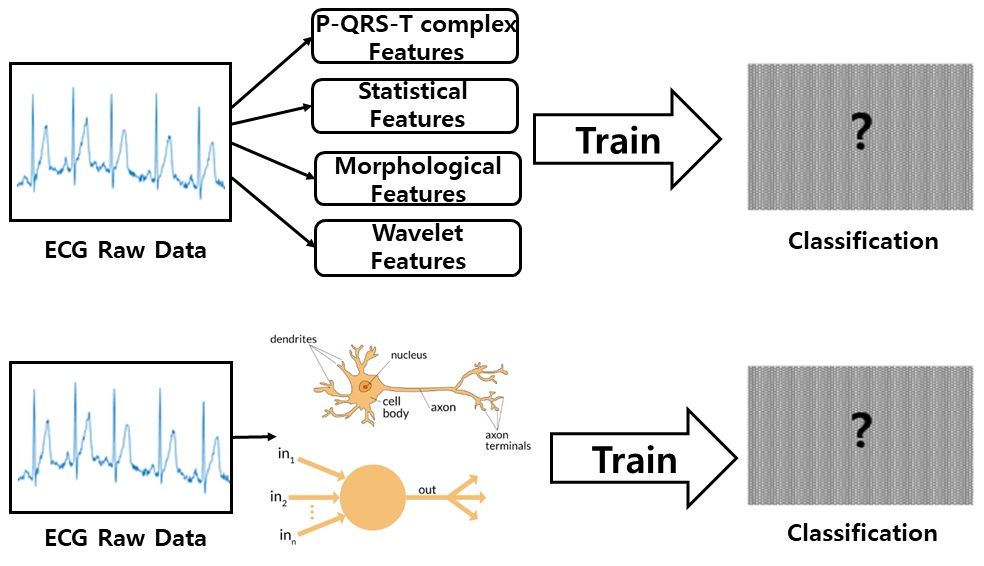

심전도를 이용한 개인 식별 연구는 알파고로 인해 관심이 증가한 딥 러닝을 활용하여 진행되고 있다[6][7]. 딥 러닝이란 컴퓨터가 스스로 사람처럼 학습할 수 있는 인공지능 기술로 이미지 분류, 음성 인식, 자연어 처리, 의학 분야 등에서 널리 사용되고 있다[8]. 딥 러닝은 그림 1과 같이 일반적인 기계학습 방법과 다르게 인간의 뇌에서 일어나는 의사결정 과정을 모방한 깊은 인공신경망 구조를 통해 학습이 진행된다.

그러나 딥 러닝 기반의 합성곱 신경망 구조를 설계하고 학습하기 위해서는 제약이 많다. 첫째, 합성곱 신경망은 많은 양의 학습 데이터가 필요하다. 둘째, 학습을 진행하려면 계산량과 메모리 부족 문제를 생각해야 한다. 셋째, 학습 과정에서 발생할 수 있는 오버피팅 문제를 해결해야 한다.

본 논문에서는 이러한 문제점을 보완하기 위해 사전 학습된 네트워크 모델을 이용해 전이학습 방법으로 개인 식별 성능 분석 실험을 진행한다. 사전 학습된 네트워크 모델은 Inception과 ResNet의 11개 네트워크를 사용하며, 학습 횟수를 변경하며 성능을 확인한다.

본 논문의 구성은 다음과 같다. Ⅱ장에서는 실험에 사용된 각 네트워크의 구조 및 특성, 기존 성능과 비교 결과에 대해 설명하며, Ⅲ장에서는 사전 학습된 네트워크를 이용한 개인 식별 방법을 설명한다. Ⅳ장에서는 실험 결과를 설명하며, Ⅴ장에서는 결론으로 논문을 마무리한다.

Ⅱ. 사전 학습된 네트워크 모델의 구조 및 특성

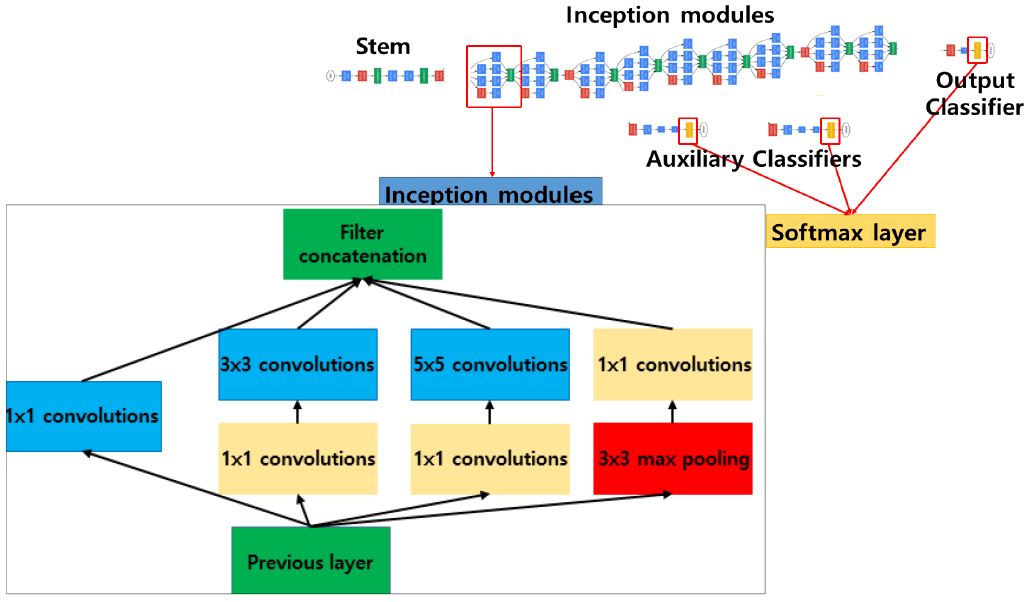

사전 학습된 네트워크로 많이 사용되는 Inception 네트워크와 ResNet 네트워크는 다양한 특징이 있다. Inception 네트워크는 그림 2와 같이 인셉션 모듈에서 다른 네트워크와 차이점이 있다. 대부분 큰 크기의 합성곱 필터를 이용해 처리하는 방식과 달리 작은 크기의 합성곱 필터 다수를 한 층에 구성하는 형태를 취하며, 위와 같은 방식을 사용하여 연산 속도를 향상시키는 특징이 있다.

Inception V1은 인셉션 모듈 방식을 처음으로 도입한 모델이다. 일반적인 네트워크는 출력 레이어 부분에 소프트맥스 레이어 한 층으로 구성되어 있지만, Inception V1은 그림 2와 같이 앞 단 레이어에서 2개의 소프트맥스 레이어가 추가된 형태로, 총 3개의 소프트맥스 레이어로 구성되어 있다. 이와 같은 방식은 레이어가 깊어질 때 발생하는 문제를 방지하고자 하였다[9].

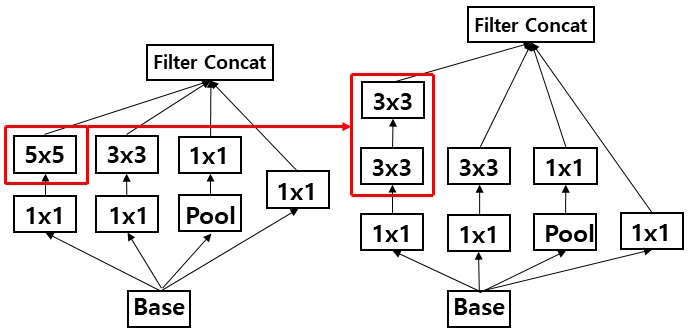

Inception V2는 Inception V1에서 사용했던 인셉션 모듈의 구조를 그림 3과 같이 변경한 점과 출력 레이어 부분을 제외한 소프트맥스 레이어를 제거한 차이점이 있다[10].

이와 같은 방법으로 연산속도 및 연산량을 33% 줄였다. Inception V3는 Inception V2의 구조에서 RMSProp, Label Smoothing 등의 옵션을 바꾸어 실험하면서 성능이 향상된 부분을 합쳐 만든 것으로, 네트워크의 구조는 동일한 형태를 나타낸다[11].

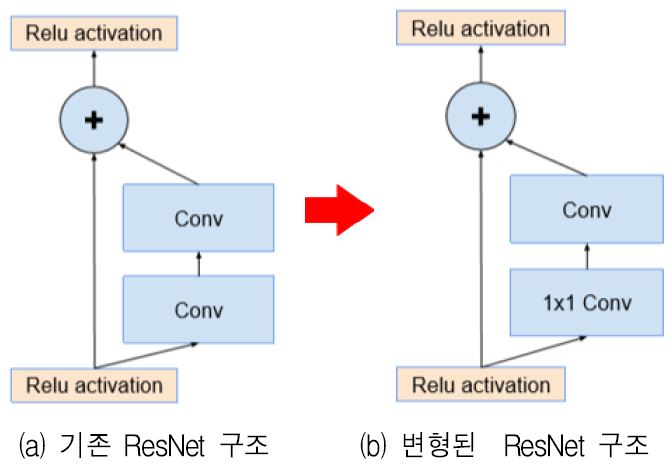

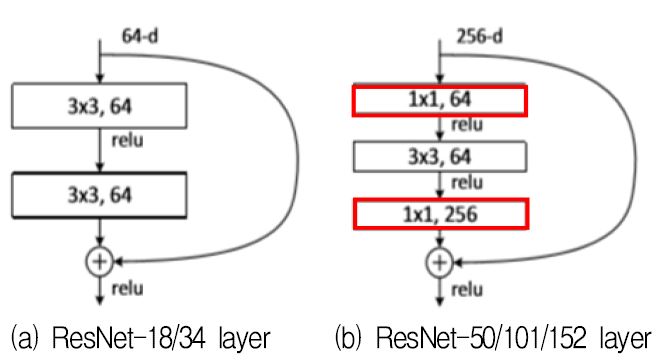

Inception-ResNet-V2는 Inception V4와 ResNet 구조를 변경해 합친 구조로, 기존의 ResNet 구조는 그림 4와 같이 합성곱-합성곱 형태이지만, 1*1 합성곱-합성곱 구조로 변경한다. 이와 같은 형태로 변경하는 이유는 ResNet 구조에 맞게 특징 맵 차원을 변형시키며, 연산량을 줄이기 위함이다.

ResNet 네트워크는 2015년 발표된 모델로, 네트워크의 각 숫자는 레이어 개수를 의미한다[12]. 레이어 50, 101, 152는 Deeper Bottleneck Architecture라고 부르며 레이어 18, 34와 다르게 구조를 변경한다. 이는 Inception-ResNet-V2의 네트워크 구조와 비슷하게 차원을 줄이기 위해 1*1 합성곱을 이용한 방법이다.

대부분 네트워크들은 업데이트될 때마다 연산량과 연산 시간을 줄이며 성능을 높이기 위해 다양한 방법을 적용한다.

실험에 사용한 Inception 네트워크와 ResNet 네트워크 또한 레이어가 깊어질수록 발생하는 연산량과 연산 시간 및 오버피팅 문제를 해결하기 위해 각 옵션 값들을 바꾸거나 레이어 구조를 변형하는 등 다양한 방법들을 적용하고 있다.

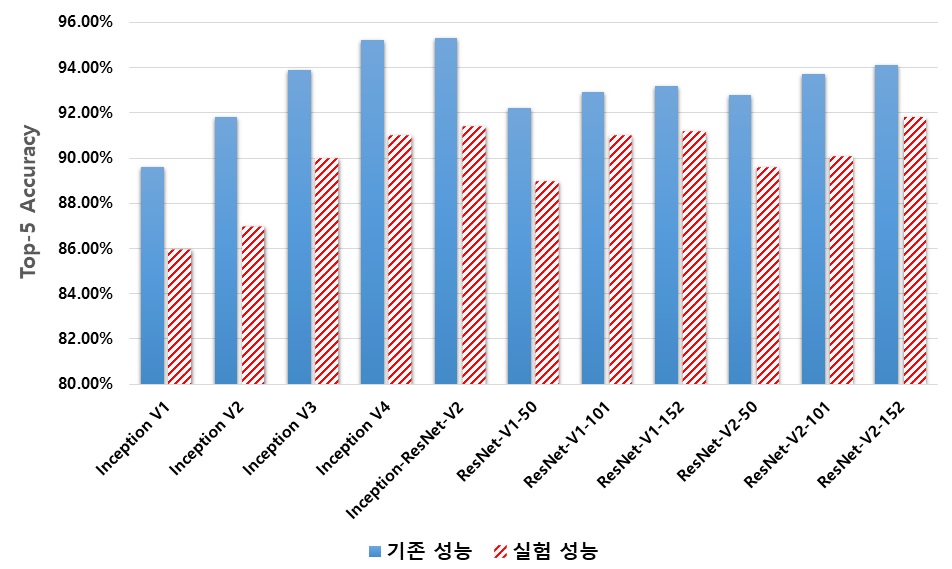

본 논문에서는 심전도 데이터를 사전 학습된 네트워크 모델에 사용하기 전 ImageNet 데이터를 사용하여 실험에 사용할 네트워크의 기존 성능과 비교하였으며, 실험 결과는 그림 6과 같다. 성능 비교는 Top-5 Accuracy를 사용하여 비교한다. Inception과 ResNet의 11개 네트워크를 사용하였으며, 기존 성능에 비해 최대 5%의 오차 성능을 보임을 확인하였다. 네트워크에 적용된 옵션 값들은 실험에 사용한 컴퓨터 환경에 맞춰서 진행하였기 때문에 성능이 다소 떨어졌으며, 네트워크의 레이어가 깊어질수록 기존성능과 차이가 있음을 확인하였다.

Ⅲ. 심전도 신호를 이용한 개인 식별 방법

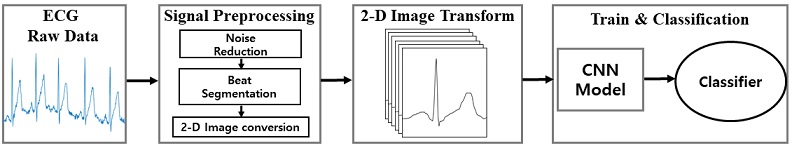

사전 학습된 네트워크를 이용한 개인 식별 방법은 그림 7과 같다. 전처리 과정으로 심전도 신호 데이터에 포함되어 있는 다양한 잡음을 제거하고, 신호를 한 주기로 분할한다. 그 후 2차원 이미지 변환과정을 통해 심전도 신호 형태를 투영한 이미지 데이터로 변환한다. 실험은 네트워크 모델 11개를 이용하며, 학습시키고자 하는 데이터가 적을 경우 사용하기 적합한 전이학습 방법을 적용하여 학습을 진행한다.

3.1 심전도 신호 전처리

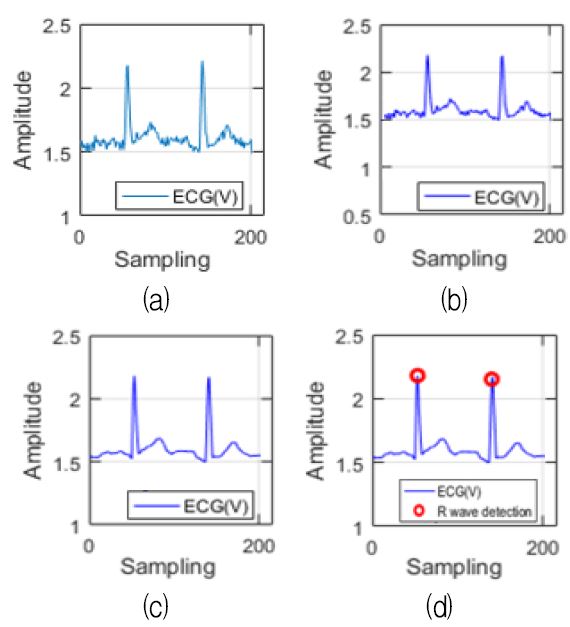

심전도 신호는 심장의 박동과 관련되어 전압의 형태로 측정되는 신호로 전력선 잡음, 움직임에 의한 근 잡음, 호흡에 의한 기저선 변동 잡음 등 다양한 잡음이 있어 전처리 과정이 필요하다. 본 논문에서는 심전도 신호의 잡음 제거를 위해 대역 통과 필터를 이용하며, 결과는 그림 8(b)와 같다. 대역 통과 필터 후 신호에 남아있는 미세한 잡음을 제거하기 위해 평균 이동 필터를 이용하며, 결과는 그림 8(c)와 같다.

잡음 제거가 완료된 신호를 P, QRS Complex, T파로 구성된 한 주기로 분할하기 위해 Pan&tompkins 알고리즘을 사용하여 R파 정점을 검출한 후 신호를 분할하며, 검출된 R파 정점은 그림 8(d)와 같다[13][14].

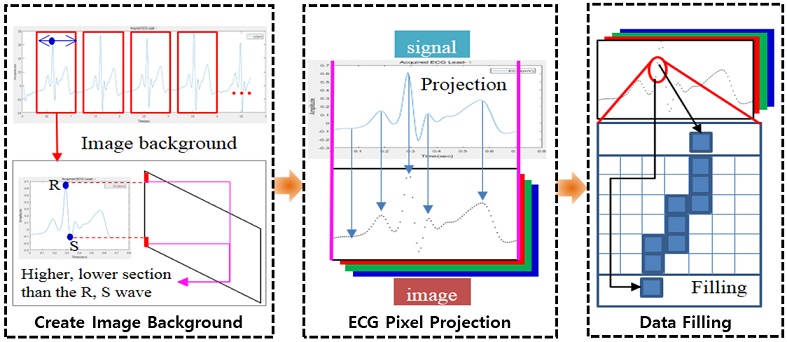

3.2 2차원 데이터 변환

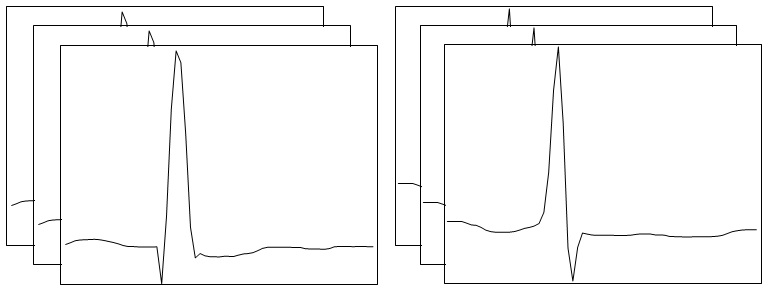

본 논문에서는 합성곱 신경망 기반 네트워크 모델 따른 개인 식별 성능을 확인하기 위해 입력 데이터로 2차원 이미지 데이터를 사용한다. 2차원 이미지 데이터는 심전도 신호 한주기의 모양을 투영한 형태로, 그림 9와 같이 생성한다.

전처리가 완료된 심전도 신호 한 주기에서 정점(R파)과 최저점(S파) 위치를 검색한 후 배경 이미지 높이를 정규화하며, 한 주기의 시작점(P파)과 끝점(T파)을 이용해 이미지 폭을 정규화한다. 그 후 심전도 신호에 있는 진폭 값을 이미지 픽셀에 투영해 심전도 신호 파형의 기준점을 생성한다. 마지막으로 각 기준점 픽셀 사이의 데이터를 채워줌으로써 2차원 심전도 이미지를 생성한다.

3.3 사전 학습된 네트워크를 이용한 학습 및 분류

2차원 심전도 이미지 데이터를 이용해 네트워크의 학습을 위해 텐서플로우(Tensorflow) 기반의 TF-Slim 라이브러리를 사용하여 실험을 진행한다. TF-Slim은 텐서플로우에서 복잡한 모델을 정의, 학습 및 평가할 수 있는 경량 라이브러리로, TFRecord 형식으로 학습데이터를 변경하여 사용한다. TFRecord 형식이란 텐서플로우의 학습데이터 등을 저장하기 위한 바이너리 데이터 포맷으로, 이미지 다수를 입·출력하여 학습 시간이 길어지는 현상을 줄여주는 역할을 한다.

또한 ImageNet 데이터 세트를 기반으로 사전 학습된 네트워크를 제공하며 전이학습하는 과정이 단순화되어있다. ImageNet 데이터 세트를 사용해 학습된 네트워크는 총 1,000 클래스를 분류하기 때문에 18 클래스를 분류하는 심전도 데이터 세트에 맞추어 전이학습한다. 학습 횟수는 1,000번에서 5,000번까지 변경하며 진행한다. 배치 사이즈는 16을 기본값으로 설정하였고 레이어가 깊은 Inception V4, ResNet-V2-152, Inception-ResNet-V2, ResNet-V1-152는 메모리 용량을 고려하여 각각 15, 13으로 설정하여 실험을 진행한다.

Ⅳ. 실험 결과

본 논문에서는 2차원 심전도 이미지를 이용하여 네트워크에 따른 개인 식별 성능을 비교한다. 실험에 사용한 컴퓨터는 CPU: i7-4770, RAM: 32GB, GPU: GTX 970을 사용하였다. 실험에 사용한 네트워크는 Inception 네트워크 5개와 ResNet 네트워크 6개를 사용하며, 학습 횟수 1,000회~5,000회로 변경하면서 진행한다. 실험에 사용한 심전도 신호는 표 1과 같은 공용 데이터베이스인 MIT-BIH Normal Sinus Rhythm 데이터를 사용하였다[15][16].

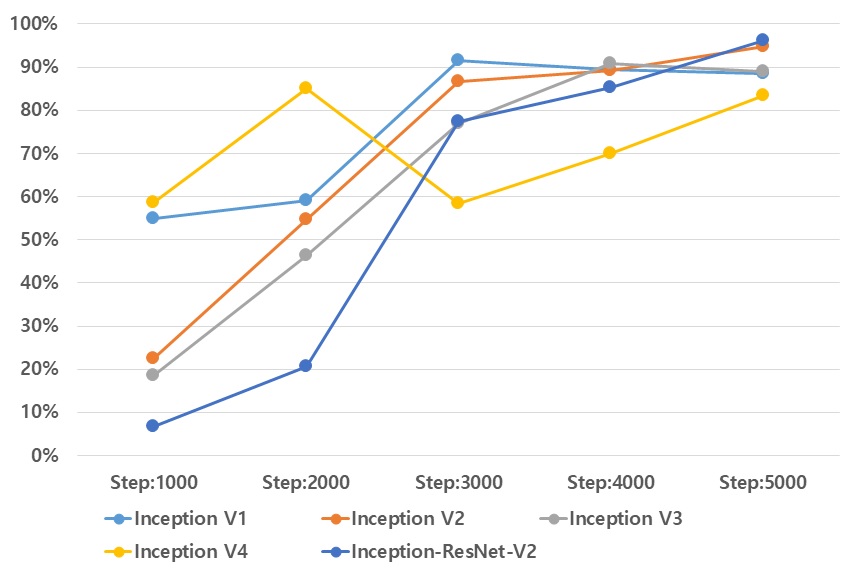

그림 11은 Inception 네트워크 기반 2차원 심전도 이미지 데이터를 입력으로 이용한 실험 결과를 나타낸다. 실험 결과 학습 횟수가 1,000회에서 5,000회로 증가함에 따라 대부분 네트워크에서 개인 식별 성능이 향상되었다. 가장 높은 인식 성능은 학습 횟수 5,000회 일 때 Inception-ResNet-V2 네트워크가 96.18%로 나타났으며, 다음으로 Inception V2, Inception V3, Inception V1, Inception V4 순으로 나타남을 확인하였다.

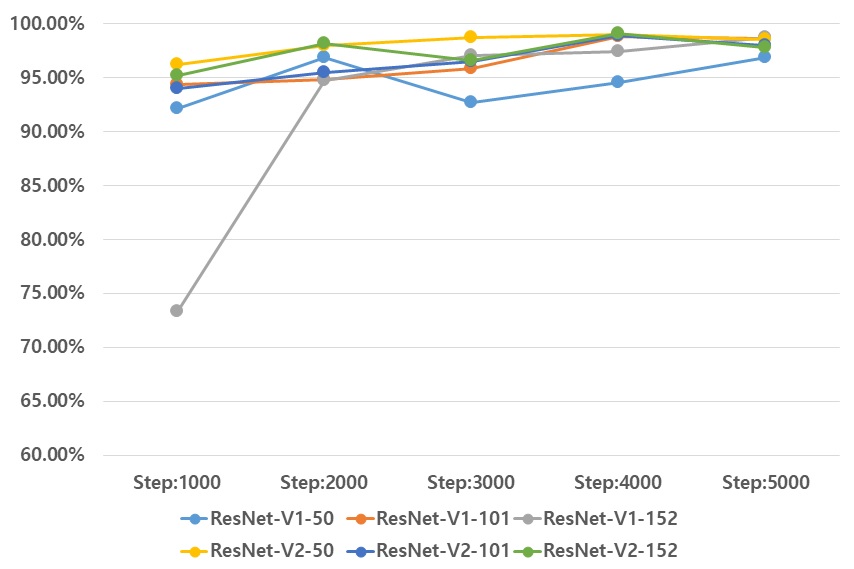

그림 12는 ResNet 네트워크 기반 2차원 심전도 이미지 데이터를 입력으로 이용한 실험 결과를 나타낸다. 실험 결과 학습 횟수 1,000회에서 ResNet-V1-152 네트워크 성능이 73.29%로 나타난 경우를 제외하고는 90% 이상의 개인 식별 성능을 나타냈다. 가장 높은 인식 성능은 학습 횟수 4,000회 일 때 ResNet-V2-152 네트워크가 99.12%로 나타났으며, 다음으로 ResNet-V2-50가 99%로 나타남을 확인하였다.

사전 학습된 네트워크를 이용한 개인 식별 성능 비교 실험 결과 Inception 네트워크는 학습 횟수가 1,000회 일 때 최고 성능(Inception V2: 60%)이 ResNet 네트워크 최저 성능(ResNet-V1-152: 73.29%)에 비해 낮게 나타남을 확인하였다. 또한 ResNet 네트워크는 Inception 네트워크에 비해 개인 식별 성능이 최대 2% 이상 차이남에 따라, 2차원 심전도 이미지를 이용한 개인 식별은 ResNet 구조의 네트워크가 적합함을 확인하였다.

Ⅴ. 결론 및 향후 계획

본 논문에서는 사전 학습된 네트워크 모델(Inception과 ResNet의 11개)로 개인 식별 성능을 분석하였다. 심전도 신호를 이용한 개인 식별 실험은 1차원 심전도 신호를 2차원 이미지로 변환하여 실험을 진행하였으며, 레이어가 깊은 네트워크에서는 메모리 용량을 고려하여 배치 사이즈 및 학습속도를 조정해 성능을 확인하였다.

2차원 심전도 이미지를 학습 데이터로 사용하여 실험 성능을 분석한 결과 Inception 네트워크의 경우 Inception-ResNet-V2가 96.18%로 높게 나타났다. ResNet 네트워크의 경우 대부분 90%이상의 성능을 달성하였으며 ResNet-V2-152가 99.12%로 가장 높은 성능을 달성함에 따라, 2차원 심전도 이미지를 이용한 개인 식별 방법은 Inception 네트워크에 비해 ResNet 네트워크가 적합함을 확인하였다. 향후에는 심전도의 한 주기가 아닌 다수의 주기를 사용한 실험을 진행하여 성능 분석을 할 예정이며, 사전 학습된 네트워크 모델이 아닌 심전도 데이터 세트에 특화된 합성곱 신경망 구조를 설계하여 심전도 기반 개인 식별 시스템에 관해 연구할 계획이다.

Acknowledgments

이 논문은 2017년도 정부(교육부)의 재원으로 한국연구재단의 기초연구사업(No. NRF-2017R1A6A1A03015496)과 2018년도 정부(과학기술정보통신부)의 재원으로 한국연구재단의 지원을 받아 수행된 연구임 (No. NRF-2018R1A2B6001984)

References

- J. S. Kim and S. B. Pan, "A study on EMG-based biometrics", Journal of Internet Services and Information Security, Vol. 7, No. 2, pp. 19-31, May 2017.

- Z. Y. Ong, A. Saidatul, and Z. Ibrahim, "Power spectral density analysis for human EEG-based biometric identification", International Conference on Computational Approach in Smart Systems Design and Applications, Kuching, Malaysia, pp. 1-6, Aug. 2018.

-

S. Gutta and Q. Cheng, "Joint feature extraction and classifier design for ECG-based biometric recognition", Journal of Biomedical and Health Informatics, Vol. 20, No. 2, pp. 460-468, Mar. 2016.

[https://doi.org/10.1109/JBHI.2015.2402199]

-

J. S. Kim, S. H. Kim, and S. B. Pan, "Personal recognition using convolutional neural network with ECG coupling image", Journal of Ambient Intelligence and Humanized Computing, pp. 1-10, Jul. 2019.

[https://doi.org/10.1007/s12652-019-01401-3]

- Seok-Joo Yoon, Gwang-Jun Kim, and Chang-Soo Jang, "Individual Identification of Electrocardiogram using Discrete Wavelet Transform", Journal of KIIT, Vol. 10, No. 8, pp. 181-187, Aug. 2012.

-

R. D. Labati, E. Muñoz, V. Piuri, R. Sassi, and F. Scotti, "Deep-ECG: convolutional neural networks for ECG biometric recognition", Pattern Recognition Letters, Vol. 126, pp. 78-85, Sep. 2019.

[https://doi.org/10.1016/j.patrec.2018.03.028]

- B. Pourbabaee, M. Howe-Patterson, E. Reiher, and F. Benard, "Deep convolutional neural network for ECG-based human identification", The 41st Conference of Canadian Medical and Biological Engineering Society, Prince Edward Island, Canada, Vol. 41, pp. 1-4, May 2018.

-

M. Taherisadr, P. Asnani, S. Galster, and O. Dehzangi, "ECG-based driver inattention identification during naturalistic driving using mel-frequency cepstrum 2-D transform and convolutional neural networks", Smart Health, Vol. 9-10, pp. 50-61, Dec. 2018.

[https://doi.org/10.1016/j.smhl.2018.07.022]

-

C. Szegedy, et al., "Going deeper with convolutions", The IEEE Conference on Computer Vision and Pattern Recognition, pp. 1-9, Sep. 2014.

[https://doi.org/10.1109/CVPR.2015.7298594]

- S. Ioffe and C. Szegedy, "Batch normalization: accelerating deep network training by reducing internal covariate shift", International Conference on Machine Learning, pp. 448-456, Mar. 2015.

-

C. Szegedy, V. Vanhoucke, S. Ioffe, J. Shlens, and Z. Wojna, "Rethinking the inception architecture for computer vision", The IEEE Conference on Computer Vision and Pattern Recognition, pp. 2818-2826, Dec. 2016.

[https://doi.org/10.1109/CVPR.2016.308]

- K. He, X. Zhang, S. Ren, and Jian Sun, "Deep residual learning for image recognition", The IEEE Conference on Computer Vision and Pattern Recognition, pp. 770-778, Dec. 2016.

-

G. Choi, J. Jung, H. Moon, Y. Kim, and S. Pan, "User authentication system based on baseline-corrected ECG for biometrics", Intelligent Automation and Soft Computing, Vol. 25, No. 1, pp. 193-204, Jan. 2019.

[https://doi.org/10.31209/2018.100000055]

-

J. Pan and W. J. Tompkins, "A real-time QRS detection algorithm", IEEE Transactions on Biomedical Engineering, Vol. BME-32, No. 3, pp. 230-236, Mar. 1985.

[https://doi.org/10.1109/TBME.1985.325532]

-

A. L. Goldberger, et al., "Physiobank, physiotoolkit, and physionnet: components of a new research resource for complex physiologic signals", Circulation, Vol. 101, No. 23, pp. 215-220, Jun. 2000.

[https://doi.org/10.1161/01.CIR.101.23.e215]

- Physionet MIT-BIH Normal Sinus Rhythm Database, https://www.physionet.org/content/nsrdb/1.0.0, /. [accessed: Oct. 11. 2019]

2016년 2월 : 조선대학교 제어계측로봇공학과 공학사

2018년 2월 : 조선대학교 제어계측공학과 공학석사

2018년 3월 ~ 현재 : 조선대학교 제어계측공학과 박사과정

관심분야 : 영상처리, 임베디드 시스템, 바이오인식, 딥 러닝

2017년 2월 : 조선대학교 전자공학과 공학사

2019년 2월 : 조선대학교 소프트웨어융합공학과 공학석사

2019년 3월 ~ 현재 : 빛가람정보㈜ 연구원

관심분야 : 딥 러닝, 바이오인식

1999년 서강대학교 전자공학과 공학박사

1999년 ~ 2005년 : 한국전자통신 연구원 정보보호연구단 생체인식기술연구팀 팀장

2005년 ~ 현재 : 조선대학교 전자공학과 교수

관심분야 : 영상처리, 바이오인식, VLSI 신호처리