개선된 이미지 대비 조정을 통한 향상된 다중모드 객체 탐지 기법

초록

최근 심층 신경망 기반 객체 탐지 기술이 발전됨에 따라 객체 탐지는 지능형 교통 시스템, 도로 모니터링 시스템 등 다양한 분야에서 활용되고 있다. 이러한 시스템들은 주간은 물론 야간과 같은 환경에서도 항상 동작되어야 한다. 그러나 현재까지 연구된 객체 탐지 기술은 주간 환경을 대상으로 설계되어 있어 야간과 같은 저조도 환경에서는 만족스럽게 동작하지 못한다. 본 논문에서는 야간 환경에서의 안정적인 객체 탐지를 위해 저조도 이미지 대비 향상 기반 객체 탐지 기술을 제안한다. 제안하는 기술은 이미지의 Entropy와 Fidelity 기반 대비 조정 기법을 통해 야간의 저조도 이미지의 대비를 향상시킨다. 이후 적응형 2차원 위너 필터와의 결합을 통해 대비 조정 과정에서 증폭된 노이즈를 억제시킴으로써 객체 탐지 성능을 향상시켰다. 시험 평가 결과 기존의 객체 탐지 기술 대비 최대 9.5% 높은 탐지 성능을 확인하여 제안된 기술의 효용성을 입증한다.

Abstract

Recently, with the development of deep neural network-based object detection technology, object detection is being used in various fields such as intelligent transportation systems and road monitoring systems. These systems must operate at all times, both day and night. However, the object detection technologies studied to date are designed for daytime environments and do not work well in low-light environments such as at night. In this paper, we propose an object detection technique based on low-light image contrast adjustment for stable object detection in a nighttime environment. The proposed technology improves the contrast of nighttime low-light images through image entropy and fidelity-based contrast adjustment techniques. Subsequently, through combination with an adaptive two-dimensional Wiener filter, noise amplified during the contrast adjustment process was suppressed and object detection performance was improved. As a result of the test evaluation, the detection performance was improved by up to 9.5% compared to the existing object detection technology, proving the effectiveness of the proposed technology.

Keywords:

deep learning, object detection, low light enhancement, adaptive 2D wiener filterⅠ. 서 론

심층 신경망을 기반으로 한 객체 탐지 모델은 지능형 교통 시스템, 긴급 차량 인식, 도로 상황 모니터링 등 다양한 교통 응용 분야에서 점차 중요성을 높이고 있다. 이러한 시스템은 낮과 밤 더불어 비 오는 등의 다양한 환경 조건에서도 안정적으로 작동해야 할 필요가 있다. 그러나 현재까지의 객체 탐지에 대한 연구는 주로 밝은 주간 환경에서의 탐지 성능에 중점을 두고 있어, 야간이나 저조도 환경에서는 미흡한 성능을 보여주고 있다.

특히 저조도 환경에서 촬영된 이미지는 대비가 낮아, 객체와 배경 사이의 경계가 불명확해져 탐지 성능이 저하된다. 이에 따라 많은 연구가 이미지 대비 조정에 집중하였으나, 단순히 대비를 향상시키는 것만으로는 객체 탐지 성능이 크게 개선되지 않았다. 더욱이 저조도 환경에서는 밝은 광원 또는 낮은 대비로 인해 노이즈가 발생하기 쉬우며 이미지 대비를 조정시키는 과정에서 노이즈가 강화된다. 강화된 노이즈는 딥러닝 기반의 객체 탐지 네트워크를 지날수록 컨볼루션 연산, 최대값 풀링과 같은 연산에 의해 크기와 강도가 증가하며 최종적으로 객체를 가리게 되어 객체 탐지 성능을 더욱 악화시킨다.

본 연구는 저조도 환경에서 객체 탐지의 성능을 향상시키기 위해, 반전된 영상의 대비 향상과 적응형 2차원 위너 필터를 이용한 노이즈 제거 기법을 통합한 새로운 접근 방식을 제안한다. 제안한 기술은 먼저 반전된 저조도 영상에 Entropy와 Fidelity 측정을 기반으로 한 대비 조정 기술을 통해 이미지의 세부 정보와 대비를 명확하게 개선한다. 다음으로 적응형 2차원 위너 필터를 통해 노이즈를 효과적으로 줄이고 객체의 형상을 보존한다. 이러한 접근은 객체 탐지의 정확도를 개선하고, 결과적으로 신뢰성 있는 탐지 성능을 제공한다.

본 논문은 다음과 같이 구성되어 있다. 2장에서는 대비 조정과 노이즈를 고려한 대비 조정 기법에 관한 관련 연구를 소개하고, 3장에서는 본 연구에서 제안하는 구조에 대해 상세히 설명한다. 4장에서는 제안된 기술의 효과를 검증하기 위한 실험과 그 결과를 제시, 분석하며 5장에서는 본 논문의 결론과 향후 연구 방향을 서술한다.

Ⅱ. 관련 연구

2.1 이미지 대비 향상 기술

저조도 환경에서 객체 탐지 성능을 향상시키는 방법은 크게 두 가지로 나뉜다.: 전처리를 통한 이미지 대비 개선과 딥러닝 레이어 설계에 의한 검출율 향상. 전처리를 통한 접근법은 입력 이미지의 선명도를 높여 모델의 일반화를 도모하나, 과도한 처리로 인해 이미지 특성의 왜곡을 초래할 수 있다. 반면, 딥러닝 레이어 설계는 특정 문제에 모델을 최적화할 수 있으나, 입력 데이터의 질에 크게 의존하며 제한된 데이터에서는 과적합의 위험을 내포하고 있다. 저조도 환경의 경우 데이터 셋이 매우 제한적이며 모델 학습을 위한 양질의 데이터를 확보하기 어렵다. 따라서 본 연구에서는 학습 비용 절감을 위해 전처리를 통한 이미지 대비 향상 방법에 중점을 둔다.

히스토그램 평활화는 대비 조정을 위한 고전적인 접근 방식 중 하나로 알려져 있다. 일반적으로 저조도 이미지에서 픽셀 값은 낮은 수준에 집중되어있어 픽셀간의 대비가 낮다. 히스토그램 평활화는 집중되어있는 픽셀 값을 고르게 분포시킴으로써 픽셀의 대비를 향상시키는 방법으로 간결한 알고리즘을 사용하여 쉽게 구현할 수 있다는 장점이 있다. 그러나 밝은 영역이 포화되기 쉽고 이미지의 색상 대비가 과도하게 증가하는 단점을 가지고 있다. 또 다른 고전적인 접근 방식은 Retinex 이론을 기반 대비 조정 기술이다. 이론에 따르면 컬러 이미지는 조명 맵과 반사 맵 두 가지 요소로 구성된다. Retinex 이론 기반 대비 조정 기술은 기본적으로 저조도 이미지를 조명 맵과 반사 맵으로 분리한 후 조명 맵의 색상 보정을 통해 이미지 대비를 향상시켰다[1][2]. D. J. Jobson et al.[1]은 가우시안 필터를 통해 조명 맵을 보정하는 SSR(Single-Scale Retinex)을 제안하였고, 다중 스케일 가우시안 필터와 색상 복원을 통해 SSR을 확장하여 이미지 대비를 향상시키는 MSR(Multi-Scale Retinex)을 제안했다[2]. 그러나 이러한 시도에도 불구하고 여전히 색상 왜곡 문제를 해결하지 못하였다.

딥러닝의 발전으로 인해 딥러닝 기반의 auto-encoder를 활용한 새로운 접근 방식이 등장하였다[3][4]. K. G. Lore et al.[3]은 딥러닝 기반의 적응형 auto-encoder를 통해 밝은 부분을 과도하게 증폭하지 않도록 하는 방법을 제안했다. L. H. Pham et al.[4]은 Retinex 이론을 바탕으로 한 two-stage 방식의 대비 조정 네트워크를 제안했다. 첫 번째 단계에선 저조도 이미지를 조명 맵과 반사 맵으로 분할한다. 두 번째 단계에선 조명 맵을 세부 조정하면서 이미지 대비를 향상시킨다. 이러한 딥러닝 기반의 방법들은 탁월한 대비 조정 성능을 보였지만, 모델의 훈련 과정에서 저조도 이미지와 함께 그에 해당하는 밝은 이미지가 필요한 점으로 인해 데이터 확보 및 학습 비용이 상대적으로 높다는 단점이 있다.

최근 연구에서 대비 조정 기술에 대한 새로운 방법이 등장했다. X. Dong et al.[5]는 반전된 저조도 이미지가 안개 이미지와 유사하다는 점에 주목하여 반전된 저조도 이미지에 DCP(Dark Channel Prior) 기반 안개 제거 알고리즘을 적용하여 이미지의 대비를 높이는 새로운 접근 방식을 제안했다. 이 방법은 기존의 대비 조정 기법에 비해 우수한 성능을 보였지만, 하얀색 객체나 건물과 같이 일부 밝은 색상을 가진 영역에 의해 색상 왜곡 현상이 발생하는 문제가 있다.

여러 연구가 대비 조정 기법을 통한 대비 향상을 위해 진행되어 왔으나, 대부분이 사람의 시각적인 만족도를 중점으로 둔 것으로, 실제 객체 탐지 모델과의 연계성에는 큰 관심을 기울이지 않았다[6][7]. 또한, 대비 향상 성능을 평가하는 데 사용된 데이터 셋은 대부분 인위적으로 어둡게 조절된 이미지로 구성되어 있어, 실제 저조도 환경의 복잡한 노이즈 특성을 반영하지 못하고 있다. 이로 인해 실제 상황에서의 적용 시, 대비 조정 과정에서 노이즈 증폭 문제가 발생하여 객체와 배경의 구분을 애매하게 만들어 실제 응용 시스템에서 객체 탐지 성능을 저하시키는 주요 요인이 된다.

2.2 노이즈를 고려한 대비 향상

Z. Zhao et al.[8]은 노이즈가 추가된 Retinex 이론을 활용한 딥러닝 기반 auto-encoder를 통해 이미지 대비를 향상시켰다. F. Zhou et al.[9]은 Low-Exposure Denoiser를 통해 저조도 이미지의 노이즈를 제거하는 대비 조정 기술을 제안하였다. X. Zhang et al.[10]은 X. Dong et al.[5]의 DCP 기반 저조도 대비 조정 기술에 Bilateral 필터를 활용하여 노이즈를 억제하고 이미지 대비를 향상시켰다.

이들 방법처럼 저조도 환경에서 발생할 수 있는 노이즈를 고려해 대비 조정 모델을 설계 하였지만, 대부분의 성능 평가는 인공적으로 생성된 데이터 셋 위에서 이루어졌다. 이로 인해 실제 환경에서 발생되는 노이즈의 영향은 고려되지 않아 실제 환경에서의 정확한 성능은 검증되지 않았다. 더불어, 이러한 대비 조정 기술들이 객체 탐지 네트워크와 통합될 경우 탐지 성능이 향상될 것이라는 보장은 하지 않는다.

Ⅲ. 객체 탐지 향상을 위한 개선된 저조도 이미지 대비 조정 기법

일반적으로 조도가 높은 환경에서는 배경과 객체 사이의 색상 대비가 뚜렷하지만, 저조도 환경에서는 낮은 조명과 높은 노출 값으로 인해 색상 대비가 낮아지고 노이즈가 발생한다. 이는 같은 색상 영역의 미세한 차이를 발생시키며, 대비 조정 과정에서 이러한 색상 차이를 더욱 심화시킬 수 있다. 기존의 대비 조정 기법들은 대부분 노이즈를 고려하지 않고 시각적 이미지 품질 향상에만 초점을 맞추었다. 이러한 접근은 시각적으로 향상될 수 있으나, 야간 객체 탐지와 같은 실제 응용 분야에서 객체 탐지 모델의 연산에 의해 노이즈가 함께 증폭되어 객체와 배경의 구분을 모호하게 만들어 결과적으로 객체 탐지 성능을 저하시킨다. 이에 따라 본 연구에서는 단순한 시각적 품질 향상을 넘어서, 객체 탐지 모델의 성능에 실질적으로 기여할 수 있는 저조도 환경에서의 대비 조정 기술을 제안한다.

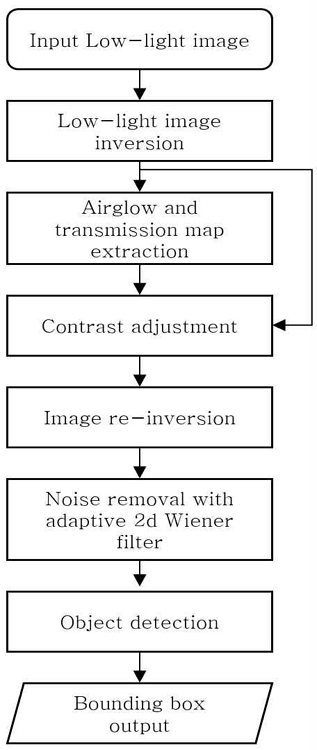

제안하는 기술의 플로우차트는 그림 1과 같다. 먼저 제안한 기술은 입력 이미지를 반전시키고 안정적인 대비 조정과 낮은 학습 비용을 위해 D. Park et al.[11]에서 제안된 Entropy & Fidelity에 기반한 대비 조정 기법을 통해 저조도 이미지의 대비를 향상시킨다.

[11]에서 제안된 기술은 이미지에서 대비 정도를 측정하는 Entropy와 대비 조정 결과의 신뢰도를 나타내는 Fidelity에 기반한 목적 함수를 통해 객체의 색상에 상관없이 [5]에서 제안된 DCP 기반의 대비 조정 기법보다 안정적으로 이미지 대비를 향상시켰다. 이후 대비가 향상된 이미지는 재반전 시켜 원래의 색상으로 복원시킨다. 복원된 이미지는 대비 조정 과정에서 노이즈도 함께 증폭되어 객체 탐지 모델에 바로 입력될 시 객체와 배경의 구분이 모호하여 탐지 성능이 저하될 수 있다. 따라서 제안한 기술은 복원된 이미지에 J. S. Lim et al.[12]에서 제안된 적응형 2차원 위너 필터를 이용하여 객체의 형상을 유지하면서 노이즈를 제거한 후 객체 탐지 네트워크에 입력시켜 객체 탐지 성능을 향상시키도록 하였다. 적응형 2차원 위너 필터의 경우 이미지의 전체 분산과 국소 분산을 비교하여 국소 분산이 작은 경우 국소 영역을 평활화하고 그렇지 않으면 그대로 유지함으로써 적응적으로 노이즈를 제거한다.

3.1 개선된 저조도 이미지 대비 조정 기법

D. Park et al.[11]에서 제안된 기법은 안개 제거 알고리즘으로 흐릿한 이미지를 모델링한 대기 산란 모델을 기초로 하여 이미지의 대비를 조정하였다. 그림 2와 같이 반전된 저조도 이미지는 안개 이미지와 유사하게 색상 대비가 낮으며 픽셀 값이 특정 영역에 집중되는 특징이 있다. 따라서 대기 산란 모델의 흐릿한 이미지는 반전된 저조도 이미지로 표현될 수 있으며 이를 활용하여 대비가 향상된 이미지(C)는 다음과 같이 표현할 수 있다.

| (1) |

여기서 H는 흐릿한 이미지를 나타내며 반전된 저조도 이미지를 뜻한다. 는 빛이 도달하는 정도를 나타내는 전송 맵을, 는 대기의 빛의 강도를 나타내는 대기광을 나타낸다. 제안된 기술은 반전된 저조도 이미지로부터 대기광와 전송 맵을 추출하고 식 (1)을 통해 대비가 향상된 이미지를 추출하게 된다.

저조도 이미지의 대비 조정을 위해선 먼저 반전된 저조도 이미지로부터 대기광을 추출해야한다. 반전된 저조도 이미지에서 대기광은 색상 대비가 낮고 국소 지역에서 강도가 높다. 이러한 특징을 이용해 쿼드 트리 세분화를 통해 대기광을 추출할 수 있다. 먼저 반전된 저조도 이미지를 회색조 이미지로 변환한 후 M × M크기의 블록으로 이미지를 세분화한다. 세분화된 블록 중 가장 작은 값을 가지는 블록을 대기광 후보 영역으로 지정한다. 위 과정을 통해 [5]에서 제안된 DCP 기반의 대비 조정 기법에서 발생한 조명이나 흰색 객체에 의한 추정 오류를 개선할 수 있다. 대기광 후보 영역을 다시 M × M크기로 세분화를 진행하고 더 이상 대기광 후보 영역을 세분화할 수 없을 때까지 위 과정을 반복하면 최종적으로 대기광 영역을 나타내는 국소 블록을 얻을 수 있다. 국소 블록에 속해 있는 픽셀 중 강도가 가장 강한 픽셀을 대기광으로 선택함으로써 대기광을 추출할 수 있다.

두 번째로 반전된 저조도 이미지로부터 전송 맵을 추출하는 방법은 다음과 같다. 전송 맵은 객체로부터 나온 빛이 카메라까지 전달되는 정도를 나타낸 것으로 Entropy와 Fidelity를 나타내는 두 가지 목적 함수를 이용해 추출할 수 있다. 일반적으로 대비가 낮은 이미지는 Entropy가 낮은 상태로 간주할 수 있으며 식 (2)와 같이 표현할 수 있다.

| (2) |

여기서 N은 이미지의 전체 픽셀 수이고 GCj(τ)는 τ의 전송 파라미터로 대비가 조정된 이미지에서, 회색조 이미지의 j 픽셀 강도를 가지는 픽셀의 개수를 나타낸다. τ가 매우 작게 되면 식 (1)에 의해 색상 왜곡이 발생할 수 있다. 이와 같은 현상을 방지하고자 대비 조정 결과의 신뢰도를 나타내는 Fidelity 목적 함수를 식 (3)와 같이 표현할 수 있다.

| (3) |

여기서 FCc(τ)는 τ의 전송 파라미터로 대비가 조정된 이미지에서, 각 색상 채널의 0에서 255 사이의 픽셀 강도를 나타내며 색상 왜곡이 일어나지 않을수록 높은 값을 나타낸다. 결과적으로 Tent(τ)와 Tfid(τ)를 동시에 최대화 하는 전송 파라미터 τ를 추출함으로써 전송 맵을 추정할 수 있다. 그러나 이미지 내에서 대비가 낮은 구역은 불규칙하기 때문에 식 (4)와 같이 이미지를 세분화하여 안정적으로 전송 맵을 추출한다.

| (4) |

최종적으로 앞서 추출된 대기광과 전송 맵을 이용해 식 (1)을 통해 이미지의 대비를 조정 시킨 후 이미지를 재반전 시켜 그림 3과 같이 원래의 색상 영역으로 복원시킨다.

3.2 적응형 2차원 위너 필터를 활용한 노이즈 제거

야간에 촬영된 이미지는 밝은 광원, 많은 노출 시간 등의 요인으로 쉽게 노이즈에 노출된다.

이러한 노이즈는 Computer Vision과 같이 이미지를 사용하는 응용 작업에서 알고리즘에 부정적인 영향을 준다.

일반적으로 이미지의 국소적인 분산이 크면 객체의 가장자리와 같은 세부 정보를 나타내며, 분산이 작으면 이미지의 전반적인 배경 정보를 의미한다. 적응형 2차원 위너 필터는 이미지의 전역적인 분산과 국소적인 분산의 비율을 통해 분산이 작은 영역의 노이즈를 제거하면서, 높은 분산을 가진 영역의 세부 정보를 적응적으로 보존한다. 위너 필터를 통해 노이즈가 제거된 이미지(CD)는 식 (5)와 같이 표현된다.

| (5) |

여기서 (x,y)는 이미지의 국소 지역을 나타내고, CE는 대비가 조정된 이미지를, μ와σ2은 각각 국소 지역의 평균과 분산을 나타낸다. v2는 이미지에 존재하는 잡음의 분산이고 주어지지 않을 경우 모든 국소 분산의 평균을 사용한다. 적응형 2차원 위너 필터는 식 (5)의 두 번째 항을 기반으로 동작한다. 국소 지역의 분산이 잡음 분산보다 크면 해당 지역이 객체의 세부 정보가 포함되어 있다고 판단하고 필터링을 최소화하여 이미지를 최대한 보존하게 된다. 반대로 국소 지역의 분산이 작으면 그 지역이 배경과 같이 상대적으로 중요하지 않은 지역으로 판단하여 노이즈 제거 강도를 높인다. 결과적으로 적응형 2차원 위너 필터는 국소 분산을 통해 세부 정보의 유무를 판단하여 세부 정보가 존재하는 곳은 조심스럽게 노이즈를 제거하고 세부 정보가 존재하지 않는 곳은 필터의 강도를 높여 노이즈의 영향을 최대한 억제하는 동작을 통해 중요한 정보를 손상시키지 않으면서 효과적으로 노이즈를 제거한다.

3.3 딥러닝 기반 객체 탐지 모델

객체 탐지란 이미지 속에서 어떤 객체가 어느 위치에 존재하는지 찾아내는 작업으로 Computer Vision의 주된 연구 주제이다. CNN(Convolutional Neural Network)의 등장으로 객체 탐지 성능은 눈에 띄게 향상되었으며 딥러닝 기반의 객체 탐지는 이 분야에서 확증된 방법으로 자리 잡았다. 딥러닝 기반 객체 탐지는 크게 two-stage 탐지와 one-stage 탐지로 분류할 수 있다. two-stage 탐지는 객체의 대략적인 위치를 찾은 후 객체를 분류하는 두 단계로 이루어져 있으며 높은 정확도를 보장하였지만 계산량이 많아 실시간 작업에 적합하지 못하는 경향을 보여준다. one-stage 탐지는 객체의 위치와 분류를 동시에 처리하는 탐지 방식으로 빠른 탐지 속도를 보장하지만 다소 낮은 정확도를 가진다.

A. Bochkovskiy et al.[13]에서 제안된 YOLO(You Only Look Once) v4는 Mean Square Error 기반 손실 함수에 Intersection over Union 기반 손실 함수를 더한 새로운 손실 함수와 Activation Function, Skip Connection 등의 최신 딥러닝 기법들의 조합을 통해 기존의 one-stage 탐지 방식의 한계인 낮은 정확도를 보완하여 two-stage 탐지 방식보다 높은 정확도를 보임과 동시에 압도적인 빠른 실행 속도를 보여주어 실시간 객체 탐지의 가능성을 보여주었다. YOLO v4는 크게 백본 네트워크, Neck 네트워크, Head 네트워크 세 가지로 구성되어 있다.

백본 네트워크에는 CSPDarknet53이 사용되며, 이는 CSP(Cross Stage Partial) 구조를 통해 특징 맵을 분할하고 다시 병합함으로써 특징 맵을 효율적으로 재사용한다. 이러한 과정은 높은 계산 효율성과 우수한 성능을 제공하며, 이미지의 특징 추출에 사용된다. Neck 네트워크에서는 PANet(Path Aggregation Network) 구조를 사용하여 특징 맵을 다양한 스케일로 나누고 결합함으로써 다양한 크기의 객체를 더 정확하게 탐지할 수 있도록 설계되었다. 마지막으로 Head 네트워크는 앞서 추출된 특징 맵을 통합하여 객체의 위치, 크기 및 분류 정보를 통합적으로 예측하고, 이미지 내의 모든 객체에 대한 종합적인 탐지 결과를 제공하도록 한다.

제안된 기술은 지능형 교통 시스템, 도로 상황 모니터링과 같이 빠른 탐지 속도가 요구되는 상황임을 가정하여 앞서 추출된 노이즈 제거된 이미지 CD를 YOLO v4에 입력으로 사용하여 저조도 상황에서 객체를 찾도록 하였다.

Ⅳ. 실험 및 성능 평가

4.1 실험 환경

제안된 기술은 NVIDIA RTX 3060, Intel Core i7-12700F CPU에서 구현되었으며 지능형 교통 시스템임을 가정하여 대표적인 차량 탐지 데이터셋인 FLIR RGB/Thermal Dataset[14]을 이용해 객체 탐지 모델이 차량을 탐지하도록 학습하였다. 공정한 검증을 위해 야간에 촬영된 BDD100k[15], Zju[16]을 이용해 기존의 대비 조정 기법들과 노이즈 제거 필터들의 영향을 비교하였다.

제안된 기술은 가로등과 같은 밝은 광원이 있는 환경에서도 효과적으로 대비를 조정시키고, 노이즈 제거를 통해 저조도 조건에서도 높은 정확도로 객체를 탐지할 수 있다는 장점을 가지고 있다. 그러나 노이즈 제거 필터의 특성상 입력 이미지의 해상도에 따라 성능이 달라질 수 있으므로, 적합한 필터 크기의 선정이 필요하다는 단점이 있다. 따라서 4절에서는 다양한 크기의 필터를 실험하고, 이를 통해 가장 효율적인 필터 크기를 결정하는 방법을 제시한다. BDD100k 데이터 셋은 광원의 영향을 크게 받지 않는 어두운 환경에서 촬영되었으며 1280×720의 해상도를 가지고 있다. Zju 데이터 셋은 가로등과 같은 광원의 영향이 더 크게 작용하여 상대적으로 밝은 환경에서 촬영되었으며 1920×1080의 높은 해상도를 가지고 있다.

대비 조정의 품질을 평가하기 위한 방법으로는 Full Reference 방식과 No Reference 방식이 있다. 대부분의 대비 조정 연구에서는 Full Reference 기반 품질 평가인 PSNR(Peak Signal to Noise Ratio)와 SSIM(Structural Similarity Index Map)을 사용한다. Full Reference로 평가하기 위해선 깨끗한 이미지가 Reference로 필요하며, 이는 이 연구의 전제 조건인 저조도 환경에서 구현되기 어려운 상황이다. 따라서 본 연구에서는 Reference가 필요 없는 No Reference 방식인 PIQE(Perception based Image Quality Evaluator)[17]를 사용하여 대비 조정의 품질을 평가하였다. PIQE는 이미지의 핵심 영역에서 잡음을 추정하고, 이미지를 16 × 16 크기의 블록으로 나누어 잡음 정도를 계산하여 품질을 평가한다. 최종적으로 낮은 점수는 더 나은 이미지 품질을 나타내며 높은 점수는 나쁜 이미지 품질을 나타낸다.

본 연구에서는 제안된 기술이 실제 객체 탐지에 주는 영향을 평가하기 위해 AP(Average Precision)를 기반으로 객체 탐지 성능을 평가하였다. AP 성능 평가는 Precision-Recall 곡선의 면적을 의미하며 면적이 넓을수록 모델의 탐지 신뢰도가 높음을 나타낸다. Precision은 탐지 결과 중 옳은 탐지 비율이고 Recall은 탐지해야 하는 객체 중 제대로 탐지된 비율을 의미하며, 각각 식 (6) 및 식 (7)과 같이 표현된다.

| (6) |

| (7) |

여기서 TP는 옳게 탐지된 경우를, FP는 잘못 탐지된 경우를, FN은 찾아야할 객체를 찾지 못한 경우를 나타낸다.

4.2 이미지 대비 조정 기법을 통한 품질 비교

본 연구에서 제안한 기술은 Entropy와 Fidelity에 기반한 안개 제거 알고리즘을 사용하여 저조도 이미지에서 대비를 조정시키는 방법을 제안했다. 이어서 대비 조정 과정 중 예상치 못하게 강화된 노이즈를 약화시키기 위해 적응형 2차원 위너 필터를 사용하였으며 이를 통해 객체와 배경 간의 대비를 강화했다. 적응형 2차원 위너 필터의 노이즈 제거 영향을 확인하기 위해 다양한 크기의 위너 필터를 사용하여 비교하였고 추가로 대표적인 노이즈 제거 필터인 Gaussian, Median과 함께 비교 평가하였다.

이미지 품질을 비교하기 위해 PIQE를 활용하여 표 1과 같이 요약하였다. 표 1에서와 같이 저조도 이미지에 대비 조정 기법을 적용했을 때 노이즈가 증가되어 PIQE가 높아지는 것을 확인할 수 있다. 선형 필터인 Gaussian과 Median 필터를 사용했을 때, 이미지의 세부 정보가 사라지면서 노이즈가 더욱 두드러져 PIQE 점수가 높아지는 것을 확인할 수 있다. 반면에 적응형 2차원 위너 필터의 경우 객체의 형상을 보존하면서 노이즈를 효과적으로 제거하여 DCP 기법에 비해 최대 16.01, 저조도 이미지에 비해 9.05만큼 낮은 PIQE를 달성하였다.

Comparison of image quality performance evaluations for image contrast adjustment techniques and noise removal filters

또한 위너 필터의 경우 필터 크기에 상관없이 다른 노이즈 제거 필터보다 우수한 노이즈 제거 성능을 보여주었다. 먼저 3 × 3크기의 위너 필터의 경우 DCP 기법에 비해 약 5.53 정도 낮은 PIQE를 보였지만 여전히 높은 PIQE를 보였다. 5 × 5크기 이상의 위너 필터의 경우 어두운 환경의 BDD100k 데이터 셋에서 효과적으로 동작하여 저조도 이미지보다 개선된 이미지 품질을 보여주었다. 반면 상대적으로 밝은 환경의 Zju 데이터 셋에서는 7 × 7크기 이상의 위너 필터에서 개선된 이미지 품질을 보여주었다. Zju 데이터 셋은 BDD100k 데이터 셋에 비해 해상도가 높아 객체가 차지하는 픽셀 크기 대비로 볼 때, 3 × 3과 5 × 5 크기의 작은 필터는 노이즈 제거 성능이 떨어져 기존 이미지 대비 낮은 이미지 품질을 확인할 수 있다. 반면에 7 × 7 이상의 크기를 가진 필터는 더욱 효과적으로 노이즈를 제거하여 향상된 이미지 품질을 확인할 수 있다.

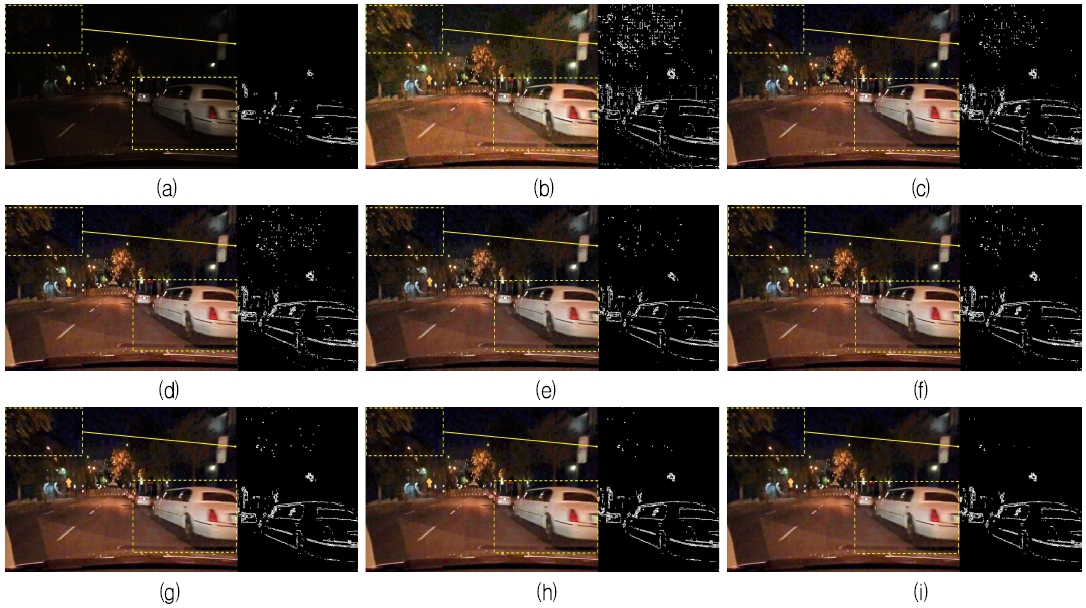

대비 조정을 통해 강화된 노이즈는 작은 블록 형태로 이미지의 모든 영역에 퍼져있어 눈으로 확인하기 어렵다. 노이즈가 객체와 배경에 미치는 영향을 쉽게 확인하기 위해 그림 4처럼 각 이미지에 로버츠 필터를 통과시켜 이미지의 경계선을 검출하고 Dilation을 통해 경계선을 강화하였다.

Edge detection results based on contrast adjustment and noise removal filters for low-light images (a) Low-light images, (b) DCP, © Entropy, (d) Entropy+Gaussian, (e) Entropy+Median, (f) Entropy+Wiener(3 × 3), (g) Entropy+Wiener(5 × 5), (h) Entropy+Wiener(7 × 7), (i) Entropy+Wiener(9 × 9)

그림 4의 (b),(c)에서 확인할 수 있듯이 대비 조정을 통해 전체적인 색상 대비가 높아짐과 동시에 객체의 경계선이 명확히 보이는 것을 확인할 수 있다. 하지만 배경에 대한 노이즈가 증가하고 객체 주변에서 노이즈가 발생되는 것을 추가로 확인할 수 있다. Gaussian과 Median를 사용하였지만 여전히 배경에 의한 노이즈가 영향을 끼치는 것을 확인할 수 있다. 적응형 2차원 위너 필터의 경우 5 × 5크기 이상의 필터에서 노이즈를 효과적으로 제거하면서 객체의 형상을 유지하는 것을 확인할 수 있다.

4.3 객체 탐지 성능 비교

제안된 방법의 실제 객체 탐지에 대한 유용성을 검증하기 위해 AP 성능 지표를 통해 표 2와 같이 요약하였다. 이미지 속 작은 노이즈는 딥러닝 기반 객체 탐지 네트워크의 컨볼루션 연산, 최대값 풀링 등의 연산에 의해 강도가 강해지며 객체를 가려 모델의 객체 탐지 성능을 약화시키는 주요 요인이 된다. 표 2에서 볼 수 있듯이, 이미지 대비를 조정시키면서 노이즈가 강화되어 대비를 조정하기 전 보다 탐지 성능이 저하되는 것을 확인할 수 있다. 선형 필터인 Gaussian과 Median 필터를 사용하여 객체 탐지 성능을 향상시켰지만, 기법을 적용하기 전과 유사한 수준으로 만족스럽지 못한 결과를 확인할 수 있다. 적응형 2차원 위너 필터의 경우 어두운 환경인 BDD100k에서 필터 크기와 상관없이 향상된 탐지 성능을 보여주었다. 하지만 9 × 9크기 이상의 경우 과도하게 노이즈를 제거함으로 인해 객체의 형상도 지워지게 되어 탐지 성능이 감소하는 것을 확인할 수 있다. 밝은 환경인 Zju에서는 BDD100k에 비해 해상도가 높아 3 × 3크기와 같이 작은 크기의 필터에선 낮은 탐지 성능을 보였다. 9 × 9크기의 필터와 같이 필터 사이즈가 커질수록 노이즈를 효과적으로 제거하여 탐지 성능이 향상되는 것을 확인할 수 있다. 최종적으로 BDD100k에선 기존 탐지 기법 대비 8.76% 높은 탐지 성능을 보여주었고 Zju에선 9.56% 높은 탐지 성능을 보여주어 객체 탐지 성능 향상에 도움이 되었음을 확인하였다.

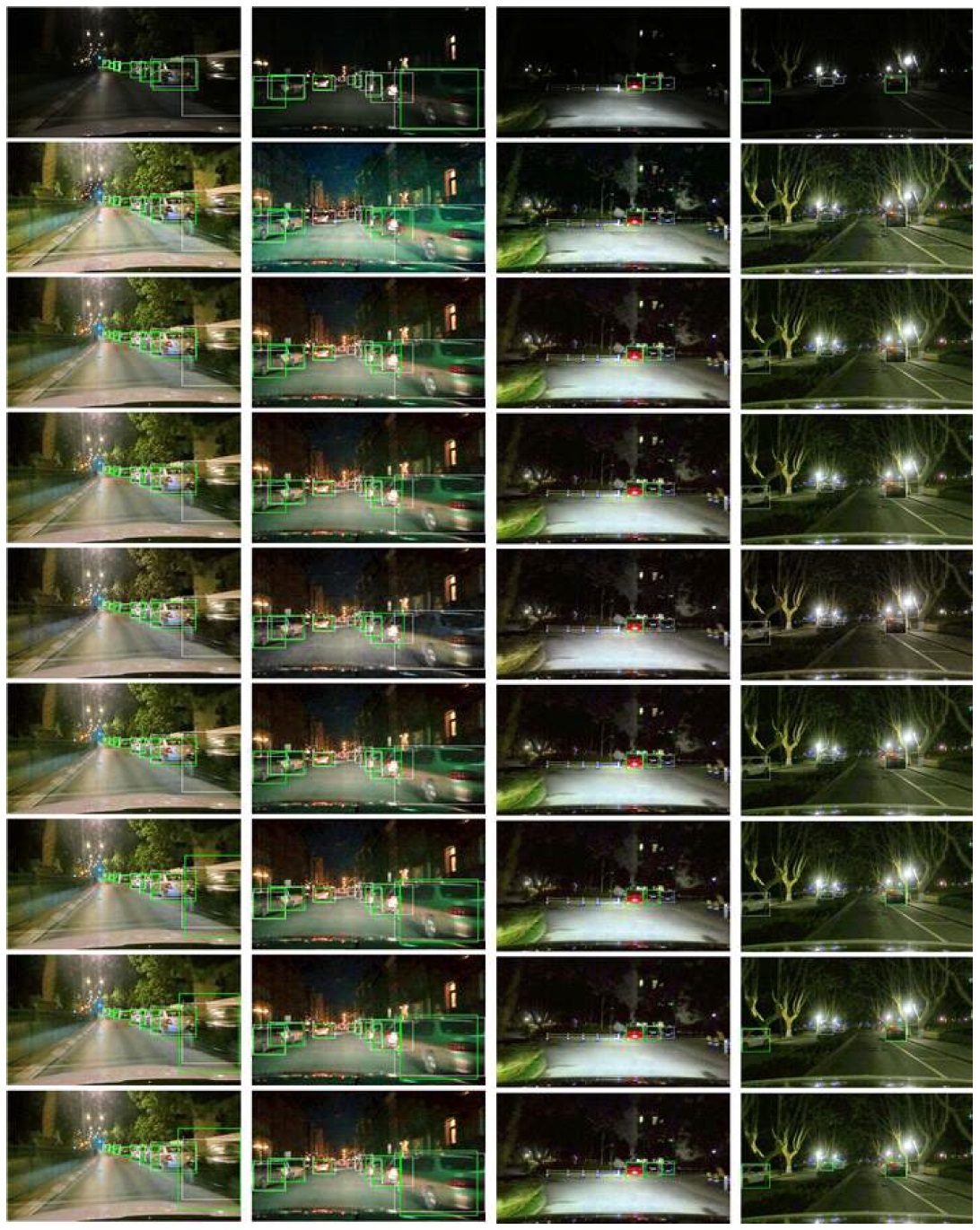

그림 5의 왼쪽 두 열과 오른쪽 두 열은 각각 BDD100k과 Zju에 대한 객체 탐지 결과를 비교한 것이다. 그림 5의 두 번째와 세 번째 행에서 볼 수 있듯이 대비 조정을 통해 시각적으로 이미지 품질이 향상되어 객체가 명확히 보이게 되었지만, 노이즈도 함께 증강되어 일부 객체가 탐지되지 못하게 된다. 네 번째와 다섯 번째 행과 같이 선형 필터를 사용하였지만 노이즈 제거 효과가 미미하여 탐지되었던 객체를 찾지 못하게 되는 것을 확인할 수 있다.

Object detection results based on contrast adjustment and noise removal filters (from the top, low-light images, DCP, Entropy, Entropy+Gaussian, Entropy+Median, Entropy+Wiener(3 × 3), Entropy+Wiener(5 × 5), Entropy+Wiener(7 × 7), Entropy+Wiener(9 × 9)); Green box: Detection Result; White box: Ground-Truth

제안하는 기술인 적응형 위너 필터의 경우 3 × 3 및 5 × 5크기의 필터를 사용한 경우 대비 조정으로 인해 놓치거나 탐지하지 못한 객체를 최대 2개를 추가로 찾아내었지만, 여전히 저조도 이미지에서 탐지한 결과와 유사한 성능을 보이는 것을 확인할 수 있다. BDD100k의 경우 7 × 7크기의 필터를 사용하였을 때 최소 1개의 객체를 제외하고 모두 찾아내어 가장 높은 탐지 성능을 보여주었다. 하지만 9 × 9크기 이상의 필터를 사용하였을 때 노이즈를 과도하게 제거하여 객체의 형상까지 손상되어 탐지 성능이 저하되는 것을 확인할 수 있다. 반대로 Zju의 경우 BDD100k에 비해 해상도가 높아 큰 크기인 9 × 9크기의 필터에서 모든 객체를 찾아냄으로써 가장 높은 탐지 성능을 보여주었음을 확인할 수 있다. 이러한 결과를 바탕으로 제안된 기법이 이미지 해상도에 따라 적절한 크기의 필터 크기를 적용하였을 때 대비 조정과 노이즈 감소를 통해 객체 탐지 성능 향상에 효과적임을 확인하였다.

Ⅴ. 결론 및 향후 과제

최근 CNN 기반 객체 탐지 기술은 일반적인 낮 환경에서 뛰어난 성능을 보여 지능형 교통 시스템, 자율주행 및 도로 모니터링과 같은 다양한 시스템에서 사용된다. 그러나 이러한 시스템들은 야간과 같은 저조도 환경에서도 안정적인 탐지 성능이 필연적이다. 이러한 이유로 저조도 환경에서 이미지의 대비를 향상시키는 기술이 요구되었다. 많은 연구들이 대비 조정에 집중하였지만 실제 객체 탐지 작업까지의 연결로 확장되지 않아 효용성을 입증하지 못하였다. 실제 야간에서 촬영된 이미지는 빛의 반사와 같은 여러 요인으로 인해 노이즈가 발생하며 이는 대비 조정 과정에서 많은 노이즈를 생성 또는 과장시킬 수 있다. 이러한 노이즈는 객체 탐지 성능을 저하시키는 주요 요인이 된다.

따라서 본 연구에서는 저조도 환경에서 객체 탐지 성능 향상을 위한 기법을 제안하였으며, 이 기법은 반전된 저조도 이미지에 대비 조정 알고리즘을 적용시켜 저조도 이미지의 대비를 조정한다. 또한, 대비 조정 과정에서 이미지 대비와 함께 강화된 원치 않는 노이즈를 줄이기 위해 적응형 2차원 위너 필터를 적용하여 객체와 배경 간의 경계를 강화하였다. 탐지 성능을 평가하기 위해 제안된 대비 조정 및 노이즈 감소 기술을 YOLO v4의 객체 탐지 모델에 전처리기로 연결하여 탐지 성능을 크게 향상 시켰음을 보여주었다.

그러나 제안된 방식은 이미지 향상을 위해 예상보다 많은 처리 시간이 필요하여 교통사고 위험 감지, 무단횡단 감지 및 차선 위반 감지와 같이 빠르게 변하는 상황에서의 실시간 사용에는 적합하지 않을 수 있다. 따라서 향후 연구를 통해 이미지 향상 과정을 최적화하여 계산 복잡도를 줄이고 처리 시간을 단축하여 고속 모니터링 시스템에 적용할 수 있도록 할 계획이다.

Acknowledgments

이 논문은 2023년도 정부(교육부)의 재원으로 한국연구재단 기초연구사업(No.2021R1I1A3055973)의 지원을 받아 수행되었으며 2023학년도 순천향대학교 교수 연구년제에 의하여 연구하였음.

References

-

D. J. Jobson, Z. Rahman, and G. A. Woodell, "Properties and performance of a center/surround Retinex", IEEE Transactions on Image Processing, Vol. 6, No. 3, pp. 451-462, Mar. 1997.

[https://doi.org/10.1109/83.557356]

-

D. J. Jobson, Z. Rahman, and G. A. Woodell, "A multiscale retinex for bridging the gap between color images and the human observation of scenes", IEEE Transactions on Image Processing, Vol. 6, No. 7, pp. 965-976, Jul. 1997.

[https://doi.org/10.1109/83.597272]

-

K. G. Lore, A. Akintayo, and S. Sarkar, "LLNet : A deep autoencoder approach to natural low-light image enhancement", Pattern Recognition, Vol. 61, pp. 650-662, Jan. 2017.

[https://doi.org/10.1016/j.patcog.2016.06.008]

-

L. H. Pham, D. N.-N. Tran, and J. W. Jeon, "Low-light image enhancement for autonomous driving systems using DriveRetinex-Net", IEEE International Conference on Consumer Electronics, Seoul, Korea, pp. 1-5, Nov. 2020.

[https://doi.org/10.1109/ICCE-Asia49877.2020.9277442]

-

X. Dong, et al., "Fast efficient algorithm for enhancement of low lighting video", IEEE International Conference on Multimedia and Expo, Barcelona, Spain, pp. 1-6, Jul. 2011.

[https://doi.org/10.1109/ICME.2011.6012107]

- S. H. Lee, D. M. Son, and T. Y. Jung, "Visible and NIR Image Blending for Improving Object Recognition at Night Time", KIIT Conference, Daejeon, Korea, pp. 95-97, Jun. 2019.

- Y. M. Kim, C. W. Park, D. K. Shin, K. T. Park, and Y. S. Moon, "Real-time color image enhancement method in CCTV system", KIIT, Vol. 9, pp. 201-206, May 2011.

-

Z. Zhao, B. Xiong, L. Wang, Q. Ou, L. Yu, and F. Kuang, "RetinexDIP: A Unified Deep Framework for Low-Light Image Enhancement", IEEE Transactions on Circuits and Systems for Video Technology, Vol. 32, No. 3, pp. 1076-1088, Apr. 2021.

[https://doi.org/10.1109/TCSVT.2021.3073371]

-

F. Zhou, X. Sun, J. Dong, and X. X. Zhu, "SurroundNet: Towards effective low-light image enhancement", Pattern Recognition, Vol. 141, pp. 109602, Sep. 2023.

[https://doi.org/10.1016/j.patcog.2023.109602]

- X. Zhang, P. Shen, L. Luo, L. Zhang, and J. Song, "Enhancement and noise reduction of very low light level images", International Conference on Pattern Recognition, Tsukuba, Japan, pp. 11-15, Nov. 2012.

-

D. Park, H. Park, D. K. Han, and H. Ko, "Single image dehazing with image entropy and information fidelity", IEEE International Conference on Image Processing, Paris, France, pp. 27-30, Oct. 2014.

[https://doi.org/10.1109/ICIP.2014.7025820]

- J. S. Lim, "Two-Dimensional Signal and Image Processing 1st Edition", Prentice Hall: Hoboken, Sep. 1989.

-

A. Bochkovskiy, C. Y. Wang, and H. Y. M. Liao, "YOLOv4: Optimal Speed and Accuracy of Object Detection", arXiv:2004.10934, , Apr. 2020.

[https://doi.org/10.48550/arXiv.2004.10934]

- FLIR. Free, Thermal dataset for algorithm training, https://www.flir.com/news-center/camera-cores--components/flir-open-source-starter-thermal-dataset-for-autonomous-vehicle-testing/, [accessed: Apr. 08, 2022]

- BDD100k, A diverse driving dataset for heterogeneous multitask learning, https://doc.bdd100k.com/download.html, [accessed: May 01, 2022]

- ZJU Day and Night Driving Dataset, https://github.com/elnino9ykl/ZJU-Dataset, [accessed May 10, 2022]

-

N. Venkatanath, D. Praneeth, M. C. Bh, S. S. Channappayya, and S. S. Medasani, "Blind image quality evaluation using perception based features", National Conference on Communications, Mumbai, India, pp. 1-6, 27 Feb. 2015.

[https://doi.org/10.1109/NCC.2015.7084843]

2021년 2월 : 순천향대학교 전기공학과(공학사)

2023년 3월 : 순천향대학교 전기통신시스템공학과(공학석사)

2023년 3월 ~ 현재 : 순천향대학교 전기통신시스템공학과 박사과정

관심 분야 : 컴퓨터 비전, 영상처리, 딥 러닝

1992년 8월 : 고려대학교 전기공학과(공학박사)

1997년 ~ 1998년 : Univ. of Saskatchewan, Visiting Professor

2005년 ~ 2006년 : Univ. of Ottawa, LG연암문화재단 해외연구교수

1992년 ~ 현재 : 순천향대학교 전기공학과 교수

관심분야 : 지능제어, 비선형견실제어, 가상실험실

2004년 12월 : Univ. of Florida 컴퓨터및전기공학과(공학박사)

2005년 ~ 2006년 : Univ. of Florida 의용공학과 박사후연구원

2006년 ~ 2007년 : 삼성전자 책임연구원

2007년 ~ 2014년 : 한국항공우주 연구원 선임연구원

2017년 3월 ~ 현재 : 순천향대학교 전기공학과 부교수

관심분야 : 시스템 FDE, 적응신호처리, 기계학습