영상 데이터 획득을 위한 최적 샘플링 기법

초록

디지털 트윈 구현을 위해 객체의 삼차원 영상 정보를 획득하는 것은 필수적인 요소들 중 하나이다. 삼차원 정보 획득 기술 중 하나인 SFF를 활용하기 위해 특정 객체를 광축을 따라 이동시킴으로써 다양한 초점 레벨을 가진 2D 영상들이 얻어져야 한다. 2D 영상들의 획득 간격은 삼차원 형상 복원의 성능에 영향을 끼치기 때문에 적절한 간격으로 설정하는 것이 중요하다. 본 논문에서는 소량의 2D 영상들을 가지고 객체의 삼차원 형상 정보를 얻기 위해 가우시안 프로세스 회귀(GPR) 방법이 제안된다. 제안된 방법은 초점 측정 연산자들 중 하나를 사용함으로써 얻어지는 초기 초점 커브들에 적용된다. 실험 결과들을 통해 제안된 방법의 효율성을 증명한다.

Abstract

In order to implement the digital twin, obtaining the 3D image of an object is one of the essential elements. In order to utilize SFF, which is one of the acquisition techniques of 3D information, a sequence of 2D images with various focus levels should be achieved through movement in the direction of the optical axis of an object on the translational stage. Since the acquisition interval of 2D images affects the performance of 3D shape recovery, it is important to set an appropriate interval. In this manuscript, a Gaussian process regression(GPR) method is proposed to obtain the 3D shape of an object with the small amount of 2D images. It is applied to fit the initial focus curves, which are obtained by using one of focus measure operators. Experimental results demonstrate the effectiveness of the proposed method.

Keywords:

Shape From Focus(SFF), acquisition interval, focus curve, Gaussian Process Regression(GPR)Ⅰ. 서 론

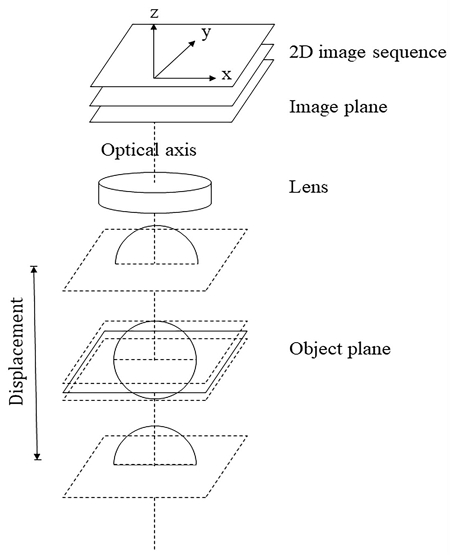

디지털 트윈 구현을 위해 객체의 3D 모델링은 중요한 요소 중 하나이다[1]. 삼차원 정보를 획득하는 방법 중에 SFF(Shape From Focus)는 그림 1과 같이 객체를 광축을 따라 사전에 결정된 샘플링 스텝 사이즈로 이동시킴으로써 다른 초점 레벨을 가지는 2D 영상들을 획득한다[2].

그리고 초점 연산자들 중 하나를 획득된 이미지 시퀀스의 각 픽셀에 적용한다. 마지막으로, 광축을 따라 초점값을 최대화함으로써 초기 깊이 맵이 획득된다. SFF는 2개의 연속적인 영상 프레임들 사이에 정보 손실을 최소화하기 위해 다른 초점 레벨들을 가지는 많은 2D 영상들이 필요한 근본적인 문제점을 가지고 있다[3]. 이는 다른 초점 정도를 가지는 많은 2D 영상들을 가지고 삼차원 형상을 복원할 때 많은 계산 시간이 필요하기 때문에 시스템의 복잡성을 증가시킬 뿐만 아니라 SFF 시스템의 응용을 제한한다. 본 논문에서는 초점 커브들을 피팅하기 위해 가우시안 프로세스 회귀(GPR, Gaussian Process Regression) 기술이 적용된다. GPR 방법은 훈련 데이터를 기반으로 가능한 함수들에 대한 확률 분포를 갱신한다. 제안된 방법은 두가지 단계를 거친다.

첫 번째로, 훈련 데이터 획득을 위해 초점 측정 연산자들 중 하나를 적용함으로써 초점 커브들이 획득된다. 그러고 나서 정확한 3D 형상 획득을 위해 최소의 2D 영상들을 결정하도록 GPR 모델이 사용된다. 즉, 제안된 방법을 통해 일정한 샘플링 스텝 사이즈로 일련의 2D 영상들을 획득할 필요가 없어진다. 실험 결과들을 통해 제안된 방법의 효율성을 증명한다.

Ⅱ. 제안된 방법

초점 측정 연산자들 중 하나를 적용함으로써 얻어지는 초점 커브들을 피팅하는 GPR 방법은 2D 영상들의 수를 최소화함으로써 SFF의 근본적인 문제점을 해결하기 위해 제안된다. GPR 방법은 회귀를 위한 비모수 베이시안 접근이다. SFF 적용을 위해 훈련 데이터는 초점 측정 연산자들 중 하나를 적용함으로써 얻어지는 초점값으로 정의하고, 회귀 함수는 훈련 데이터 기반의 추정되는 초점 커브로 정의한다. 본 논문에서는, SML(Sum of Modified Laplacian)이 이미지 시퀀스에서 각 픽셀에 대하여 초점 품질을 측정하기 위해 자주 사용되기 때문에 SML을 적용함으로써 훈련 데이터가 획득된다[4]. 가능한 함수들의 갱신된 확률 분포를 구하기 전에, 적절한 커널 함수를 정해야 한다. 커널 함수는 대칭 및 정치 특성을 가지고 있어야 한다. 제곱 지수 커널, 라플라스 커널, 선형 커널과 같은 많은 종류의 커널 함수들이 있다. 본 논문에서는 식 (1)과 같이 제곱 지수 커널이 사용된다[5].

| (1) |

i와 i'는 제곱 지수 커널 함수의 입력을 나타내고, ∥•∥는 유클리디안 거리를 나타낸다. 가능한 함수들의 갱신된 확률 분포는 식 (2)와 (3)과 같이 평균 함수 mg(xo)와 커널 함수 kg(xo, xo′)를 가진 가우시안 프로세스이다.

| (2) |

| (3) |

xo와 는 목표 데이터의 x축 값들의 집합을 나타내고, xt와 yt는 훈련 데이터의 x축과 y축 값들의 집합을 나타낸다. 초기화를 위해 mg(xo)와 kg(xo, xo′)는 0과 k(xo, xo′)로 각각 설정한다. SFF를 위해 x축과 y축은 2D 영상 획득 위치와 초점값을 각각 나타내고, 목표 데이터는 초점 커브가 GPR에 의해서 피팅되도록 하는 mg(xo)에 있는 일련의 점들을 나타낸다. 목표 데이터는 2D 영상 획득의 시작 위치부터 최종 위치까지 특정 간격으로 샘플링함으로써 얻어지는 점들로 구성된다. 본 논문에서는 샘플링 간격을 반복된 실험을 통해 0.15로 설정한다. 실험들은 0.1과 1 사이의 다양한 간격값들을 사용하여 수행하였다. 표 1과 같이 샘플링 간격 0.15가 본 논문에서 실험을 위해 사용된 3개의 가상 객체들 중 하나에 대하여 가장 좋은 삼차원 형상 성능을 제공하였다. 나머지 2개의 가상 객체들도 표 1에 제시된 경향과 비슷한 결과를 제공하였다.

Quantitative comparisons for 3D shape recovery of simulated wave according to change of sampling interval

SML 커브를 위해 사용되는 전체 2D 영상들로부터 무작위로 2D 영상들을 선정한 후에 광축을 따라 GPR에 의해서 피팅되는 초점 커브들을 최대화함으로써 최종 깊이 맵이 획득된다.

Ⅲ. 실험 결과

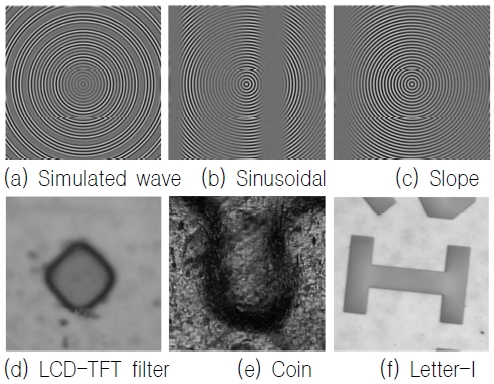

제안된 방법의 성능을 평가하기 위해 가상 객체인 Simulated wave, Sinusoidal, Slope를 사용하였다[6]. 360×360×80 차원을 가지는 가상 객체 영상들은 카메라 시뮬레이션 소프트웨어를 사용함으로써 얻어진다. 제안된 방법을 실제 환경에서 테스트하기 위해 실제 객체인 LCD-TFT filter, Coin, Letter-I를 사용하였다[7]. 실제 객체들의 영상들은 미세 제어 시스템(MCS)에 의해서 획득된다[8]. LCD-TFT filter는 300×300×60, Coin은 300×300×68, Letter-I는 300×300×60 차원을 가진다.

그림 2는 가상 및 실제 객체들의 각 이미지 시퀀스에서 30번째 영상 프레임을 보여준다.

정량적인 비교를 위해 평균 제곱근 오차(RMSE), 상관 계수(Correlation), 최대 신호 대 잡음비(PSNR)의 측정 방법들이 사용된다[9]. RMSE는 값이 작을수록, 상관 계수와 PSNR은 값이 클수록 더 정확한 삼차원 형상 복원 결과를 제공한다는 것을 의미한다.

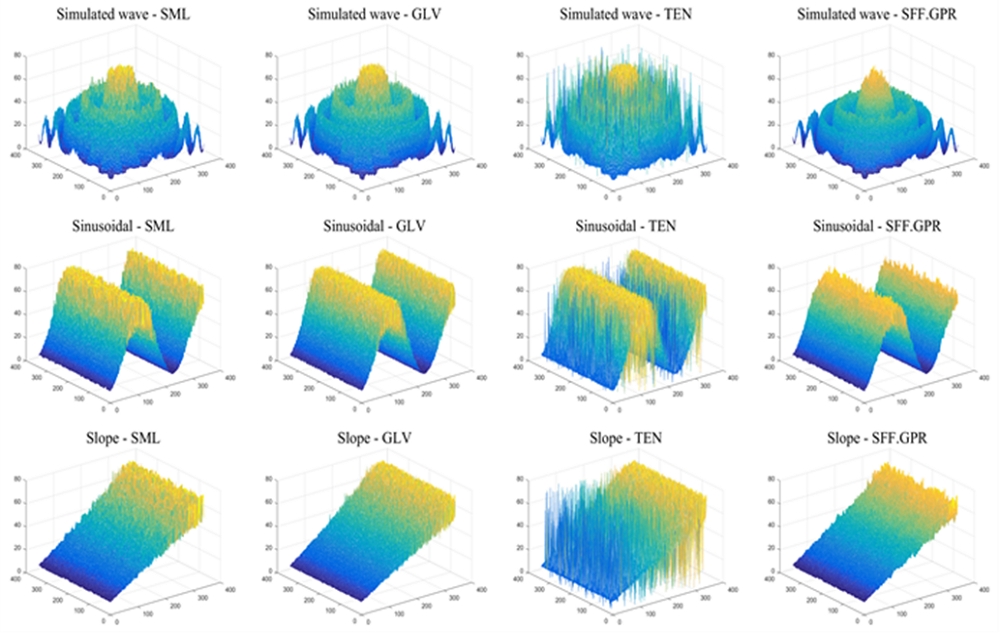

표 2, 3, 4는 Simulated wave, Sinusoidal, Slope에 대하여 다양한 초점 측정 연산자와 제안된 방법(SFF.GPR)을 사용함으로써 얻어지는 삼차원 형상 복원의 정량적인 성능 비교 결과를 제공한다. 본 논문에서는 SFF에서 자주 사용되는 SML, GLV(Grey Level Variance), TEN(TENenbaum)을 초점 측정 연산자로써 사용하였다[10]. 초점 측정 연산자들은 각 픽셀에 대하여 초점 품질을 측정하기 위해 7×7 영상 윈도우를 사용하였다.

SFF에서 너무 적은 수의 2D 영상들을 사용하는 것은 2D 영상들 사이에 정보 손실이 크기 때문에 에러가 많은 3D 형상 복원 결과를 제공한다.

그리고 너무 많은 2D 영상들을 사용하는 것은 지터 노이즈 영향으로 인해 삼차원 형상 복원의 정확성을 떨어뜨린다[11]. 따라서, 삼차원 형상 복원을 위해 적절한 수의 영상들이 사용될 필요가 있다. 본 논문에서는 반복된 실험들을 통해 각 가상 객체들에 대하여 가장 좋은 삼차원 형상 복원 성능을 제공하는 최소한의 2D 영상들의 수가 결정되었다. 표 5, 6, 7을 통해 가상 객체들에 대하여 50개의 2D 영상들을 통해 복원된 삼차원 형상이 가장 최적의 결과를 제공하는 것을 알 수 있다.

표 2와 3을 통해 50개의 2D 영상들의 수를 사용한 제안된 방법이 가장 성능이 좋고, SML, GLV, TEN 순으로 성능이 뛰어나다는 것을 알 수 있다.표 4에서는 GLV가 SML보다 성능이 더 좋다는 것을 제외하고는 표 2, 3과 성능 순위가 동일하다. 그림 3은 다양한 초점 측정 연산자와 제안된 방법을 사용하여 가상 객체들의 삼차원 형상 복원의 정성적인 결과를 보여준다.

그림 3을 통해 제안된 방법을 사용함으로써 복원된 객체 표면이 다른 초점 측정 연산자들을 사용함으로써 복원된 객체 표면들보다 잡음이 적고 매끄럽다는 것을 알 수 있다.

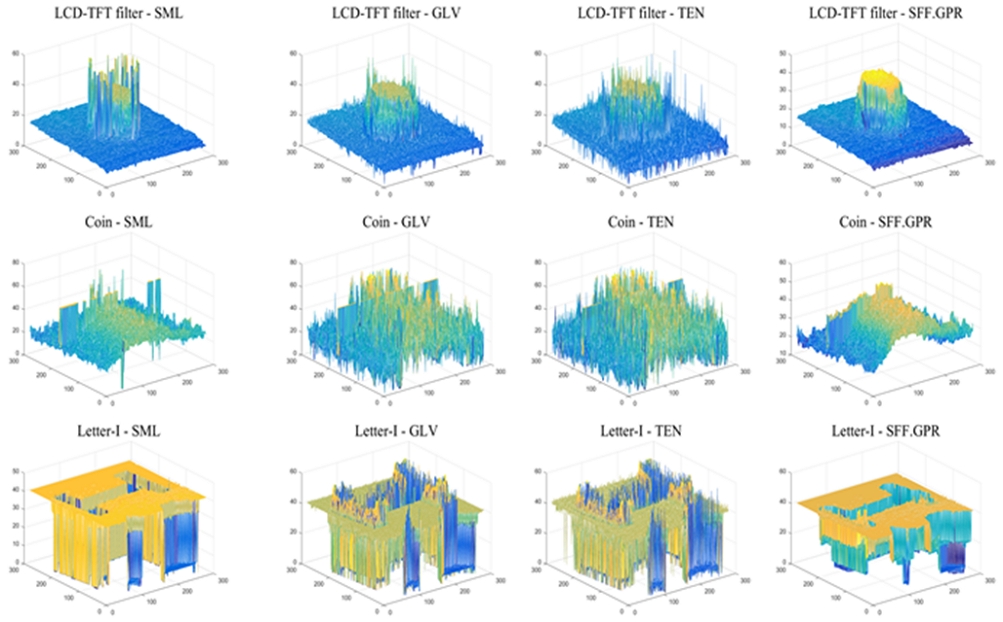

그림 4는 다양한 초점 측정 연산자들과 제안된 방법을 사용하여 실제 객체들의 삼차원 형상 복원의 정성적인 결과를 보여준다. 그림 4에서 제안된 방법을 위해 사용되는 2D 영상들의 수는 가상 객체들에 대하여 2D 영상들의 최소 수와 전체 수의 비율을 기반으로 결정하였다. 즉, Coin은 43개의 영상, LCD-TFT filter와 Letter-I는 38개의 영상들을 사용하였다. 그림 4를 통해 제안된 방법이 다른 초점 측정 연산자들보다 잡음이 적고 매끄러운 깊이 맵을 제공한다는 것을 알 수 있다.

Ⅳ. 결 론

SFF에서 정확한 삼차원 형상 복원을 위해 다른 초점 레벨을 가지는 많은 2D 영상들이 필요하다. 이 조건은 SFF 시스템의 응용을 어렵게 하기 때문에 본 논문에서는 이 조건을 완화하기 위해 새로운 초점 커브 피팅 방법인 GPR이 제안된다. 제안된 방법은 기존의 초점 측정 연산자들을 위해 사용되는 전체 영상들로부터 무작위로 영상 획득 위치를 샘플링한다. 그러고 나서 샘플링된 영상들을 사용하여 회귀 프로세스가 적용된다. 실험 결과들을 통해 제안된 방법의 효율성을 증명하였다. 향후 딥러닝을 이용한 신경 프로세스가 사용될 필요가 있다. 이를 통해 삼차원 형상 복원 성능을 떨어뜨리지 않고 2D 영상들의 수를 더 줄이는 것이 가능할 것으로 예상된다.

Acknowledgments

이 논문은 2021년도 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 연구임(No.2021-0-00751, 0.5mm 급 이하 초정밀 가시·비가시 정보 표출을 위한 다차원 시각화 디지털 트윈 프레임워크 기술 개발)

이 논문은 2020 IEEE International Conference on Consumer Electronics (ICCE)에서 발표한 논문 “Optimal Sampling for Shape from Focus by Using Gaussian Process Regression” [12]의 기술 적용 및 확장을 통한 연구 성과물임.

References

-

C. Verdouw, B. Tekinerdogan, A. Beulens, and S. Wolfert, "Digital twins in smart farming", Agricultural Systems, Vol. 189, pp. 103046, Apr. 2021.

[https://doi.org/10.1016/j.agsy.2020.103046]

-

S. K. Nayar and Y. Nakagawa, "Shape from focus", IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 16, No. 8, pp. 824-831, Aug. 1994.

[https://doi.org/10.1109/34.308479]

-

M. S. Muhammad and T. S. Choi, "Sampling for Shape from Focus in Optical Microscopy", IEEE Transactions on Pattern Analysis and Machine Intelligence, Vol. 34, No. 3, pp. 564-573, Jan. 2012.

[https://doi.org/10.1109/TPAMI.2011.144]

-

H. S. Jang, M. S. Muhammad, and T. S. Choi, "Removal of jitter noise in 3D shape recovery from image focus by using Kalman filter", Microscopy Research and Technique, Vol. 81, No. 2, pp. 207-213, Feb. 2018.

[https://doi.org/10.1002/jemt.22966]

-

J. Y. Yang, "Adaptive Back Propagation-based Neural Network for Gaussian Process Regression and Its Stability Model", Journal of KIIT, Vol. 15, No. 12, pp. 1-7, Dec. 2017.

[https://doi.org/10.14801/jkiit.2017.15.12.1]

-

H. J. Kim, M. T. Mahmood, and T. S. Choi, "An Efficient Neural Network for Shape from Focus with Weight Passing Method", Applied Sciences, Vol. 8, No. 9, pp. 1648, Sep. 2018.

[https://doi.org/10.3390/app8091648]

-

S. A. Lee, H. S. Jang, and B. G. Lee, "Jitter Elimination in Shape Recovery by using Adaptive Neural Network Filter", Sensors, Vol. 19, No. 11, pp. 2566, Jun. 2019.

[https://doi.org/10.3390/s19112566]

-

M. T. Mahmood, W. J. Choi, and T. S. Choi, "PCA-based method for 3D shape recovery of microscopic objects from image focus using discrete cosine transform", Microscopy Research and Technique, Vol. 71, No. 12, pp. 897-907, Dec. 2008.

[https://doi.org/10.1002/jemt.20635]

-

H. S. Jang, M. S. Muhammad, and M. K. Kang, "Removal of Non-Gaussian Jitter Noise for Shape From Focus Through Improved Maximum Correntropy Criterion Kalman Filter", IEEE Access, Vol. 8, pp. 36244-36255, Feb. 2020.

[https://doi.org/10.1109/ACCESS.2020.2975274]

-

S. Pertuz, D. Puig, and M. A. Garcia, "Analysis of focus measure operators for shape-from-focus", Pattern Recognition, Vol. 46, No. 5, pp. 1415-1432, May 2013.

[https://doi.org/10.1016/j.patcog.2012.11.011]

-

H. S. Jang, M. S. Muhammad, and T. S. Choi, "Removal of jitter noise in 3D shape recovery from image focus by using Kalman filter", Microscopy Research and Technique, Vol. 81, No. 2, pp. 207-213, Feb. 2018.

[https://doi.org/10.1002/jemt.22966]

-

H. S. Jang, G. Yun, M. T. Mahmood, and M. K. Kang, "Optimal Sampling for Shape from Focus by Using Gaussian Process Regression", 2020 IEEE International Conference on Consumer Electronics (ICCE), Las Vegas, NV, USA, pp. 1-4, Jan. 2020.

[https://doi.org/10.1109/ICCE46568.2020.9043150]

2014년 8월 : 광주과학기술원 기전공학과(공학석사)

2019년 2월 : 광주과학기술원 기전공학과(공학박사)

2020년 2월 ~ 현재 : 한국전자기술 연구원 선임연구원

관심분야 : 신호 및 영상처리, 증강 및 혼합 현실, 기계 및 심층 학습