신경회로망을 이용한 퍼지 IF–THEN 규칙 정제 방법

초록

지식 획득 또는 추출은 인공지능 분야에서 전문가 시스템 개발의 장애로 여겨진다. 퍼지 IF-THEN 규칙들은 불확실한 지식의 가장 흔히 사용되는 표현 도구이며, 인공지능에 널리 적용된다. Training data의 불충분과 규칙추출 방법의 한계와 같은 불확실한 요인들 때문에, 데이터로부터 추출된 퍼지 IF-THEN 규칙들은 만족한 성능을 갖지 못한다. 이 경우에 하나의 방법은 추출된 퍼지 IF-THEN 규칙들을 정제하는 것을 생각할 수 있다. IF-THEN 규칙들 내의 파라메타들은 신경회로망의 연결 가중치들에 해당한다. 따라서 IF-THEN 규칙들의 정제는 신경회로망 학습에 의해 완성되어 질 수 있다. 그 파라미터들은 선형 삼각형 멤버십 함수의 중심과 폭이다. 본 연구에서는 두 개의 전건부와 하나의 후건부가 신경회로망에 의해 동조되어 진다.

Abstract

Knowledge acquisition or extraction is regarded as the bottleneck of expert system development in the artificial intelligence field. Fuzzy IF–THEN rules are the most commonly used representation tools of knowledge with uncertainty and have wide applications to artificial intelligence. Due to many uncertain factors such as the insufficiency of training data and limitations of the methods of rule extraction, fuzzy IF–THEN rules extracted from data by using the previous methods are not likely to have a satisfying performance. In this case, one can consider that the extracted fuzzy IF–THEN rules require a refinement. The parameters in the IF–THEN rules correspond to connection weights of the neural network, and therefore, the refinement of IF–THEN rules can be completed by training the neural network. The parameters are center and width of membership function with linear triangle shape. In this study, two antecedent parts and a consequent part are tuned by neural networks.

Keywords:

artificial intelligence, fuzzy IF–THEN rules, refinement, neural networksⅠ. 서 론

비선형시스템의 제어대상에 대한 확실한 지식 정보를 획득 또는 추출하는 과정은 연구자들의 어려운 장애 요인 중의 하나이다. 지식은 맵핑, 그래픽스, 테이블, 신경회로망, 퍼지 IF-THEN 규칙 등으로 표현되어 질 수 있다. 특히 퍼지 IF-THEN 규칙들은 불확실한 지식의 가장 흔히 사용되는 표현 도구이며, 인공지능 분야에 널리 적용된다[1][2]. 멤버십함수(Membership Function: MF)의 폭은 모호한 정도를 결정하기 때문에 퍼지 제어시스템의 성능에 중요한 영향을 미친다. Matos 등[3]은 IF-THEN 규칙의 추론을 위해 유전 알고리즘을 이용 하였으며, 그 밖의 연구자들은 퍼지 추론 방법을 적용하는 연구를 수행하였다[4][5]. Training 데이터의 불충분과 규칙 추출 방법의 한계를 비롯한 여러 가지 불확실한 요인들 때문에, 데이터로부터 추출된 퍼지 IF-THEN 규칙들은 만족한 성능을 갖지 못한다. 따라서 추출된 퍼지 IF-THEN 규칙들의 정제가 필요하다. 이러한 문제를 해결하기 위해 본 논문에서는 일련의 퍼지 IF-THEN 규칙들을 신경회로망(Neural Networks: NN)으로 학습하여 합리적인 규칙들을 생성하는 방법을 연구한다. IF-THEN 규칙들 내의 파라미터들은 신경회로망의 연결 가중치(Weight)들에 해당하며 따라서, IF-THEN 규칙들의 정제는 신경회로망 학습(Training)에 의해 완성되어 질 수 있다[6][7].

이러한 목적을 달성하기 위해 퍼지추론과 학습 성능을 갖는 신경회로망을 결합하는 뉴로-퍼지 추론시스템을 구현하는 연구를 수행한다. 본 연구에서는 IF-THEN 규칙들의 전건부는 삼각형 멤버십함수로 구성하였으며 후건부는 실수 값으로 설정한다. 삼각형 멤버십함수의 폭과 중심 값 그리고 후건부의 실수 값을 동조하는 IF-THEN 규칙을 생성하는 것이 본 연구의 목적이다. Roslina 등[8]과 Sung-Wook Park 등[9]은 종 모양(Bell shape)의 비선형멤버십 함수를 사용하여 중심, 폭, 기울기 등 3개의 변수를 적용하였으나 본 연구에서는 선형인 삼각형 멤버십함수를 사용하여 중심과 폭 두 개의 변수만을 적용하도록 단순화하였다. 전건부 멤버십함수는 두 부분인데, 한 부분당 7개의 삼각형 형태로 구성되어 있으며, 후건부는 실수 값이다. 따라서 49개의 IF-THEN 규칙들을 갖는다. 학습 이전의 초기 상태의 전건부는 폭과 형태가 동일한 삼각형으로 초기화하고 후건부는 0(Zero)으로 초기화한다. 이 규칙들을 신경회로망에 맵핑(Mapping)하고 학습시킴으로써 파라미터들을 정제하여 목표치에 적응할 수 있는 합리적인 IF-THEN 규칙들을 생성하는 방법을 제안한다.

본 논문의 구성은 2장에서는 퍼지 IF-THEN 규칙들을 신경회로망에 맵핑하여 학습을 통해 멤버십함수들을 정제함으로써 새로운 퍼지 IF-THEN 규칙을 생성하는 뉴로-퍼지 추론시스템을 설계하였다. 3장에서는 학습을 통해 얻은 결과들을 공신력 있는 두 개의 DB를 이용하여 모의실험으로 확인하였고, 4장에서는 연구결과와 향후 과제에 대하여 언급하였다.

Ⅱ. 뉴로-퍼지 추론시스템

뉴로-퍼지 추론은 퍼지 IF-THEN 규칙들의 파라미터들에 해당하는 연결 가중치들을 생성하기 위해 설계된 구조이다. 오차역전파(Error back propagation) 알고리즘에 의한 학습을 통해 퍼지규칙들을 인식하고 멤버십함수들을 정제하여 새로운 퍼지 IF-THEN 규칙을 생성한다. 신경회로망은 퍼지추론의 구조를 하고 있기 때문에 신경회로망에 의해 얻어진 퍼지 모델은 퍼지제어기의 설계나 rule-to-rule mapping에 이용될 수 있다. 설계된 퍼지 제어규칙들 역시 학습에 의해 개선될 수 있다.

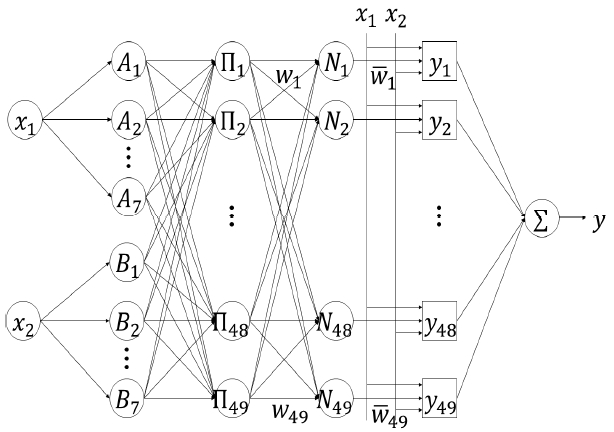

그림 1은 본 연구에 적용된 뉴로-퍼지 추론시스템의 구성도이다. 퍼지 IF-THEN 규칙은 삼각 형태 멤버십함수를 갖는 두 개의 전건부와 실수로 표현된 하나의 후건부로 구성된다. 그림 1은 두 개의 입력 x1, x2와 하나의 출력 y 그리고 각 전건부에 7개의 삼각형 형태의 멤버십함수를 갖는다. 하나의 전건부는 오차 입력 신호로서 7개로 구성되며, 또 다른 전건부는 오차 변화량 입력 신호로서 7개이다. 따라서 본 추론시스템은 49개의 규칙을 갖는다. 그림 1에서 원과 네모들은 뉴로-퍼지 추론시스템의 units을 의미하며, w1… w49는 연결 가중치들이다.

다음은 뉴로-퍼지 추론시스템의 각 층(Layer)에 대한 설명이다. 종 모양의 멤버십함수는 비선형이며 중심, 폭, 기울기 등 3개의 변수를 적용하지만. 본 연구에서는 선형인 삼각형 멤버십함수를 사용하여 중심과 폭 두 개의 변수만을 적용하도록 단순화하였다.

1층은 입력 계층(Input layer)으로서 오차와 오차 변화량으로 실수이며 x1과 x2로 표현한다.

2층은 퍼지화 계층(Fuzzification layer)으로서 뉴런의 퍼지화를 수행하며 삼각형 활성화 함수를 사용한다. 식 (1)의 는 2층에 있는 뉴런 i의 입력이며, 는 출력이고 ai, bi는 뉴런 i에 대한 삼각 활성화 함수의 중심과 폭이다.

| (1) |

3층은 규칙 계층(Rule layer)이다. 퍼지화 뉴런에서 입력을 받아 그것이 표현하는 규칙의 수행 강도를 식 (2)로 계산한다. 는 2층에 있는 뉴런 j에서 3층에 있는 규칙 뉴런 i의 입력이다.

| (2) |

4층은 정규화 계층(Normalization layer)이다. 4층에 있는 뉴런은 규칙 계층에 있는 모든 뉴런에서 입력을 받아 식 (3)으로 그 규칙의 정규화 수행 강도(Normalized firing strength)를 계산한다. 규칙의 정규화 수행 강도는 해당 규칙의 수행 강도 대 모든 규칙의 수행 강도를 합한 값의 비율이며 해당 규칙의 최종 결과에 기여하는 정도를 나타낸다. 은 3층에 있는 뉴런 j에서 4층에 있는 뉴런 i로 들어가는 입력이며, n은 규칙 뉴런의 개수이다.

| (3) |

5층은 비퍼지화 계층(Defuzzification layer)이며 식 (4)에 의해 수행된다. 5층에 있는 뉴런은 각 정규화 뉴런에 연결되어 초기 입력을 받는다. 비퍼지화 뉴런은 각 규칙의 후건부 값을 계산한다. 는 5층에 있는 비퍼지화 뉴런 i의 입력이며, ki0, ki1, ki2는 규칙 i의 후건부 값이다.

| (4) |

6층은 합계 계층(Summation layer)이며 식 (5)를 이용한다. 모든 비퍼지화 뉴런의 출력을 합산하여 전체 출력을 계산한다.

| (5) |

Ⅲ. 모의실험

3.1 Concrete DB를 이용한 퍼지추론 예측 성능

실험에 사용된 concrete compressive strength 데이터는 콘크리트 압축 강도에 대한 데이터이며 age와 ingredients에 대한 고도의 비선형 함수이다[10]. 데이터의 크기는 1030×9이며, 입력 변수 8개와 출력 변수 1개로 구성되어 있다. 본 실험에서는 전체 입력 변수를 사용하지 않고 영향력이 강한 2개의 입력 변수(Cement, age)를 선택하여 데이터를 1030×3으로 재구성한 후 실험에 사용하였다. 실험은 퍼지 IF-THEN 규칙들에 학습을 1000회 반복 수행하였다. 그 결과 IF-THEN 규칙들에 대한 파라미터의 변화(그림 3∼그림 6)와 예측 성능(그림 7)을 확인하였다. 성능 평가방법은 RMSE(Root Mean Square Error) 값을 사용하였다.

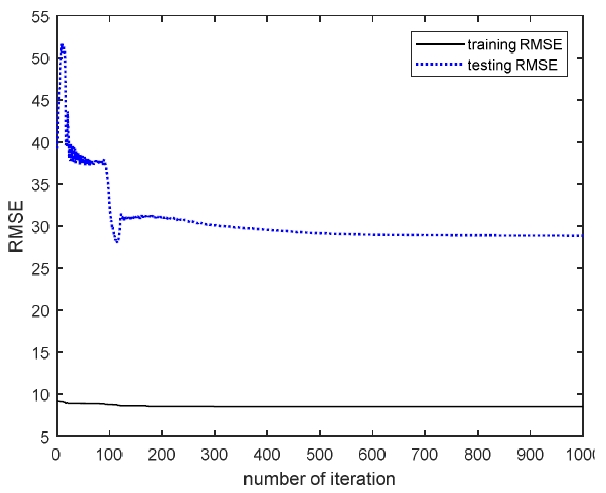

그림 2는 콘크리트(Concrete) 데이터에 대한 신경회로망의 검증 결과를 나타낸 것이며 1000회 반복 실행되는 동안 출력된 RMSE 값을 보여주고 있다. 실선은 학습 데이터에 대한 RMSE 값이고 점선은 검증 데이터에 대한 RMSE 값이다. 그림 2와 같이 실행 횟수가 1회일 때 검증 데이터에 대한 RMSE 값이 약 50 정도인데, 실행 횟수가 115회일 때 검증 데이터 RMSE 값이 약 28로서 최솟값이다. 따라서 그때 학습이 가장 잘 수행되었음을 의미하므로 115회 실행한 결과들을 적용하여 전건부와 후건부 파라미터들을 정제하고 퍼지 IF-THEN 규칙들을 재생성한다.

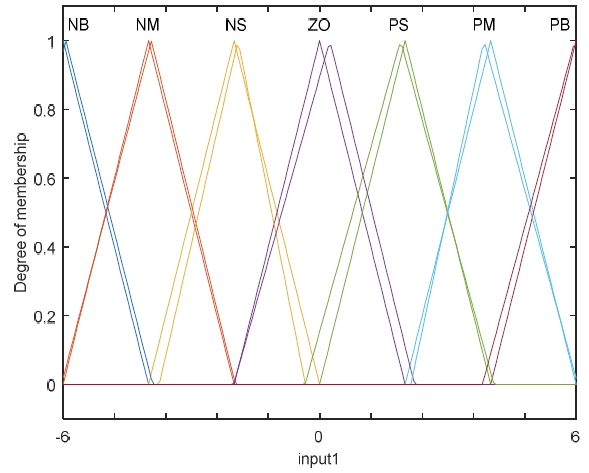

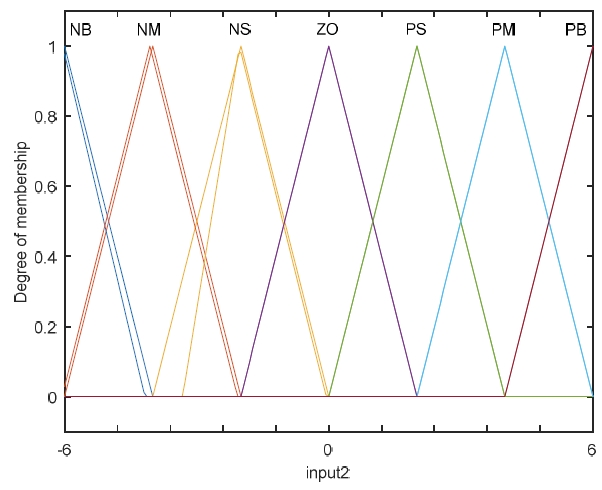

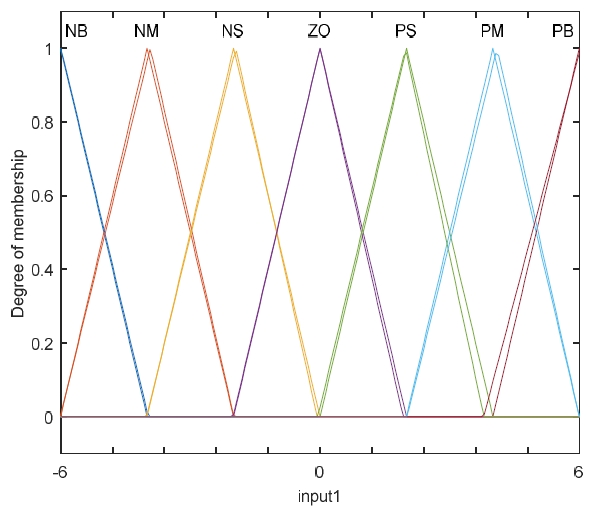

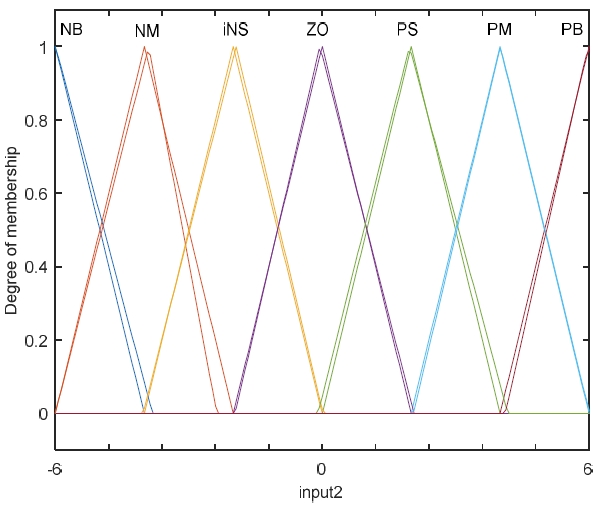

그림 3과 그림 4는 퍼지 IF-THEN 규칙들의 전건부 멤버십함수들이다. 전건부 멤버십함수는 두 부분이며 그림 3은 첫 번째이고 그림 4는 두 번째 멤버십함수들이다. 학습 전 초기 멤버십함수는 일정한 폭과 일정한 중심 값을 갖는데, 반복 실행하는 학습 과정에서 각 멤버십함수의 폭과 중심 값이 변화하는 것을 확인할 수 있다. 각각의 그림에 학습 전과 학습 후의 멤버십함수를 함께 나타내어 변화를 비교하였다.

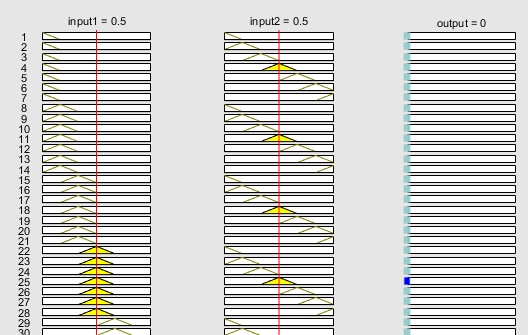

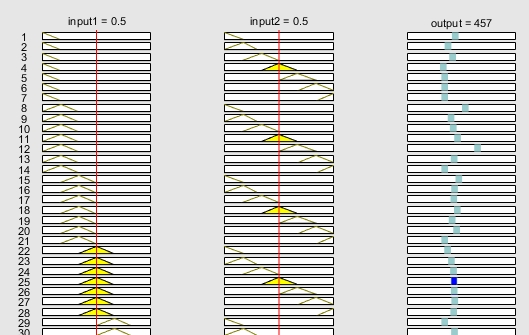

그림 5는 학습 전 퍼지 IF-THEN 규칙들이며 두 개의 전건부와 하나의 후건부로 구성된 49개 규칙들의 멤버십함수 중 일부인 30개를 나타낸 것이다. 후건부 파라미터는 모두 0(Zero)으로 초기화되어 있다.

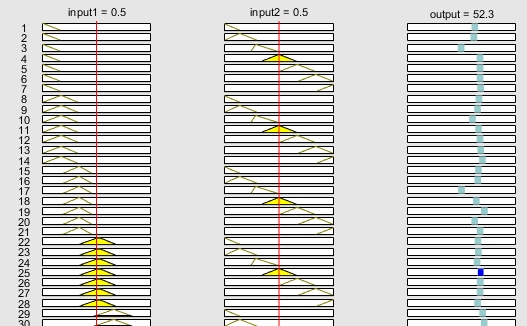

그림 6은 학습 후 정제된 IF-THEN 규칙들이다. 두 개의 전건부는 그림 3과 그림 4와 같이 변화되었으며, 0(Zero)으로 초기화한 후건부 파라미터는 각각의 규칙에 해당하는 값을 갖는 것을 확인할 수 있다.

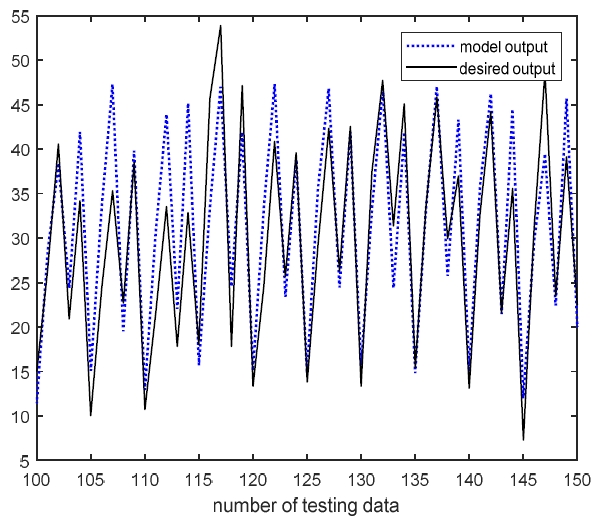

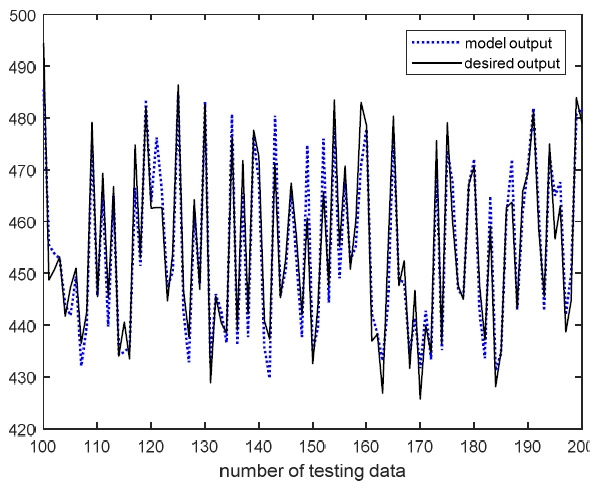

그림 7은 콘크리트 데이터 출력과 학습된 퍼지추론의 예측값을 비교한 것으로서 실선은 콘크리트 데이터의 출력 값(Desired output)이고 점선은 예측값(Model output)을 나타낸다. 두 값이 부분적으로 약간의 차가 있지만 대체로 데이터 출력과 유사한 값을 나타내는 것을 확인할 수 있다.

3.2 CCPP DB를 이용한 퍼지추론 예측 성능

실험에 사용된 데이터는 combined cycle power plant로서 컴퓨터 성능에 대한 데이터이다[11]. 데이터의 크기는 9568×5이며, 입력 변수 4개와 출력 변수 1개로 구성되어 있다. 본 실험에서는 전체 입력 변수를 사용하지 않고 영향력이 강한 2개의 입력 변수(Temperature, ambient pressure)를 선택하여 데이터를 9568×3으로 재구성한 후 실험에 사용하였다. 퍼지 IF-THEN 규칙들에 학습을 1000회 반복 수행하여, 멤버십함수 파라미터의 변화(그림 9~그림 11)와 예측 성능을 비교(그림 12)하였다. 성능 평가방법은 RMSE 값을 사용하였다.

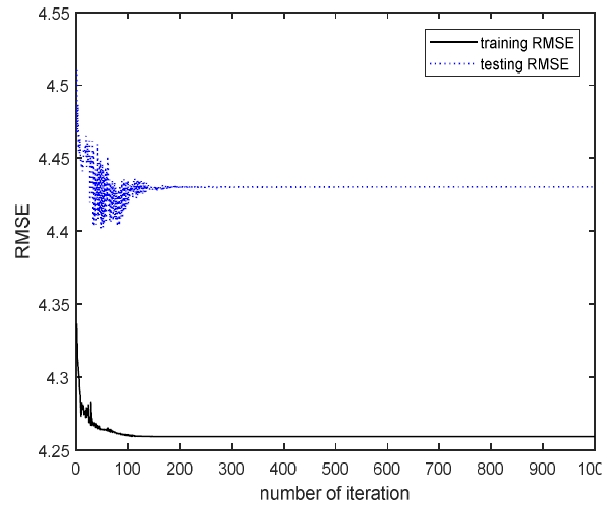

그림 8은 신경회로망이 1000회 실행되는 동안 출력된 RMSE 값을 보여주고 있다. 그림 8에 나타난 바와 같이 실행 횟수가 1회일 때 RMSE 값이 약 4.47인데, 실행 횟수 48회일 때 RMSE 값이 약 4.40으로 최솟값을 나타내므로 48회에서 가장 우수한 학습 결과를 얻었음을 알 수 있다. 따라서 48회 실행한 결과들을 적용하여 전건부와 후건부 파라미터를 정제하고 퍼지 IF-THEN 규칙들을 재생성한다.

그림 9와 그림 10은 퍼지 IF-THEN 규칙들의 전건부 멤버십함수들이다. 전건부 멤버십함수는 두 부분이며 그림 9는 첫 번째이고 그림 10은 두 번째 멤버십함수들이다.

학습 이전의 초기 멤버십함수는 일정한 폭과 중심 값을 갖도록 구성되었는데, 학습을 반복 수행하는 과정에서 부분적으로 멤버십함수의 폭과 중심 값이 변화한 것을 확인할 수 있다. 그리고 각각의 그림에 학습 전과 학습 후의 멤버십함수를 함께 나타내어 변화를 비교하였다.

그림 11은 그림 5의 초기 규칙들을 CCPP 데이터로 학습한 후 변화된 퍼지 IF-THEN 규칙들이다. 두 개의 전건부는 그림 9와 그림 10과 같이 변화되었으며, 0(Zero)으로 초기화한 IF-THEN 후건부 파라미터는 정제되어 각각의 규칙에 해당하는 값으로 변화하였다.

그림 12는 CCPP 데이터 출력과 학습된 퍼지추론의 출력을 비교한 것으로서 실선은 CCPP 데이터의 출력 값이고 점선은 예측값을 나타낸다. 부분적으로 약간의 오차가 있지만 대체로 실제 출력과 유사함을 확인할 수 있다.

Ⅳ. 결 론

본 연구는 퍼지 IF-THEN 규칙들의 정제를 위해 퍼지 추론시스템과 신경회로망을 융합한 뉴로-퍼지 추론시스템을 적용하여 학습을 수행하였으며, 수행 결과에 대한 타당성을 확인하기 위해 두 개의 공신력 있는 데이터를 이용하여 퍼지추론 예측 성능을 분석하였다. 데이터의 출력 값과 퍼지추론 예측값을 비교한 결과 두 개의 데이터 모두 유사하게 예측하는 것을 확인할 수 있었다. 초기 멤버십함수들의 폭과 중심의 위치 또한 학습을 통해서 정제되는 것을 확인하였고, 후건부 값을 0(Zero)으로 초기화한 후 학습을 통해 추론한 결과 합리적인 값을 찾아내어 멤버십함수의 후건부의 값을 동조할 수 있었다. 비선형 멤버십함수는 중심, 폭, 기울기 등 3개의 변수를 적용하지만. 본 연구에서는 선형인 삼각형 멤버십함수를 사용하여 중심과 폭 두 개의 변수만을 적용하도록 단순화하였으며 유용한 결과를 얻을 수 있었다. 따라서 제어대상에 대한 지식을 추출하는 과정에서 장애 요인 중 하나인 퍼지 IF-THEN 규칙들에 포함된 오류들을 뉴로-퍼지 학습을 통해 정제하는 방법을 제시하였다. 향후 계획으로 데이터의 출력 값과 퍼지추론 예측값의 오차를 줄이기 위해 최적화할 수 있는 연구를 수행하고자 한다.

Acknowledgments

이 논문은 2016학년도 조선대학교 학술연구비의 지원을 받아 연구되었음.

References

- D. Ruan, and E. Kerre, Eds."Fuzzy IF–THEN Rules in Computational Intelligence", Norwell, MA, Kluwer, (2000).

- Xi-Zao Wang, and Chun-Ru Dong, "Improving Generalization of Fuzzy IF-THEN Rules by Maximizing Fuzzy Entropy", IEEE Trans., 17(3), p556-567, Jun), (2009.

-

M. D. S. Matos, and L. R. d. Amaral, "Multiple Disjunctions Rule Genetic Algorithm (MDRGA): Inferring Non-Linear IF-THEN Rules in Non-Linear Datasets", 2018 IEEE Congress on Evolutionary Computation (CEC), Rio de Janeiro, Brazil, Jul. 2018.

[https://doi.org/10.1109/CEC.2018.8477690]

- F. L. Chung, Z. H. Deng, and S. T. Wang, "From minimum enclosing ball to fast fuzzy inference system training on large data sets", IEEE Trans. Fuzzy Syst., 17(1), p173-184, Feb), (2009.

-

Y. J. Liu, W. Wang, S. C. Tong, and Y. S. Liu, "Robust adaptive tracking control for nonlinear systems based on bounds of fuzzy approximation parameters", IEEE Trans. Syst., Man, Cybern. A, Syst., Humans, 40(1), p170-184, Jan), (2010.

[https://doi.org/10.1109/tsmca.2009.2030164]

-

E. C. C. Tsang, X. Z. Wang, and D. S. Yeung, "Improving learning accuracy of fuzzy decision trees by hybrid neural networks", IEEE Trans. Fuzzy Syst., 8(5), p601-614, Oct), (2000.

[https://doi.org/10.1109/91.873583]

-

E. C. C. Tsang, D. S. Yeung, J. W. T. Lee, D. M. Huang, and X.Z. Wang, "Refinement of generated fuzzy production rules by using a fuzzy neural network", IEEE Trans. Syst., Man Cybern., B, 34(1), p409-418, Feb), (2004.

[https://doi.org/10.1109/tsmcb.2003.817033]

-

Roslina M. Zarlis, I. T. R. Yanto, and D. Haryama, "A Framework of Training Anfis Using Chicken Swarm Optimization for Solving Classification Problems", 2016 International Conference on Informatics and Computing (ICIC), Mataram, Indonesia, Oct. 2016.

[https://doi.org/10.1109/IAC.2016.7905759]

- Sung-Wook Park, Jong-Wook Park, Dong-Won Kim, Woo-Young Ohm, Chong-Ho Yi, and Chang-Hwan Ahn, "A Study on the Synergy Effect Between Neuro-fuzzy and Genetic Algorithms for Non-linear System Modeling", Journal of KIIT, 11(1), p9-17, Jan), (2013.

- Concrete DB, http://archive.ics.uci.edu/ml/datasets/Concrete+Compressive+Strength [accessed: May 05, 2019].

- CCPP DB., http://archive.ics.uci.edu/ml/datasets/Combined+Cycle+Power+Plant [accessed: May 05, 2019].

2016년 2월 : 조선대학교 제어계측공학과 졸업(공학사)

2017년 8월 : 동대학원 석사과정 졸업(공학석사), 현재 동대학원 박사과정 중

관심분야 : 계산지능, 입자컴퓨팅

1982년 8월 : 조선대학교 대학원 전기공학과 석사

1994년 8월 : 전북대학교 대학원 전기공학과 박사

1984년 3월 ~ 현재 : 조선대학교 교수

관심분야 : 퍼지이론, 신경회로망, 인공지능