다단 형판 정합에 기반한 손 숫자 제스처 인식

초록

중국식 한 손 숫자 제스처는 중국에서 자주 사용되는 의사소통 수단이다.한 손으로 10가지 제스처를 표현하기 때문에 5,6가지 제스처 인식을 위해 제안된 기존 방법들은 제약이 있으며,문헌상 보고된 관련 연구 인식률도 86.3%로 저조하다.이에 본 논문은 별도 특징점 추출 없이 피사체의 형태를 활용하는 일반적인 형판 정합을 개선하여 각 제스처가 갖는 내접원과 외접원의 비율을 토대로 손가락을 편 그룹과 손가락을 모두 접은 그룹으로 우선 분류 후 그룹 내에서 형판 정합을 실시하는 다단 형판 정합을 제안한다.크기,방향,조명이 다양한 2000개 손 제스처 영상에 대해 성능 검증을 실시한 결과 제안하는 방법은 기존 방법보다 11.2%개선된 91.15%의 인식률을 기록한다.

Abstract

Chinese one-handed number gestures are a common means of communication in China. Because of the representation of 10 gestures with one hand, conventional methods proposed for recognizing 5 or 6 gestures are limited, and the recognition rate reported in the literature is also low at 86.3%. In this paper, we propose multi-stage template matching where the classification of template groups based on the diameter ratio of inscribed circle and circumscribed circle of each gesture precedes the individual template matching that utilizes the shape of the object without additional feature extraction within the both groups. As a result of performance verification with 2000 hand gesture images with various scales, orientations, and lights, the proposed method finally records 91.15% recognition rates improved by 11.2 % than the conventional.

Keywords:

chinese number gesture, gesture recognition, template matching, image processingⅠ. 서 론

손 제스처는 사람이 사용하는 가장 기본적인 의사소통 방법 중 하나이며 손 제스처 인식은 인간과 기계 간 상호작용을 위해 지속적으로 연구되어온 분야이다. 흔히 영상 속 손의 형태나 손가락의 특징을 분석 후 해당하는 동작을 실행시켜 가상공간 제어[1], 스마트TV제어[2], 게임 제어[3] 등을 처리한다.

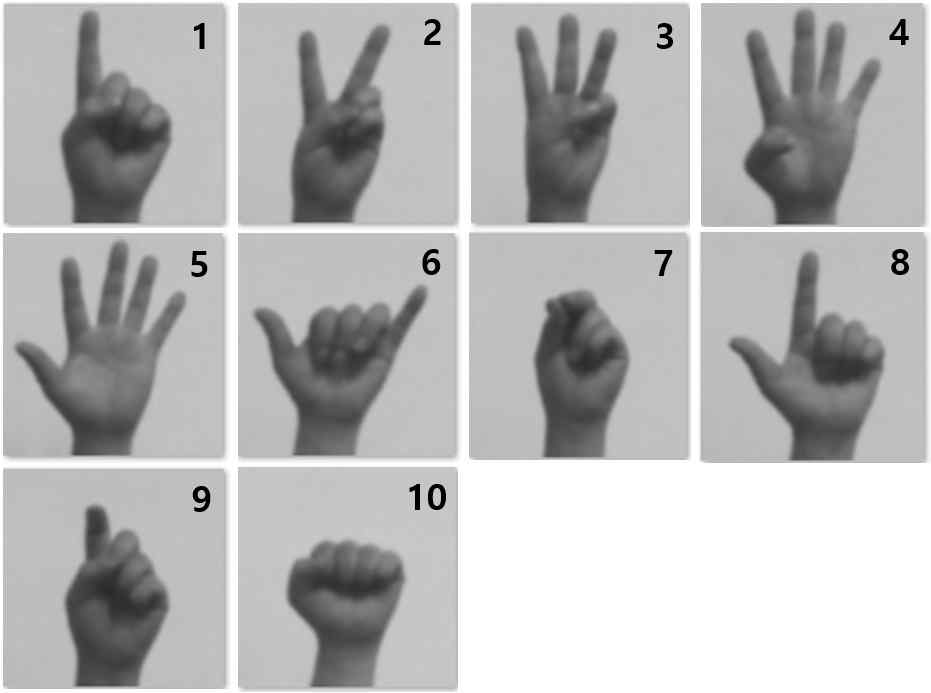

우리는 손 제스처의 새로운 사용 실례로서 일반적인 한 손 숫자 제스처에 비해 표현할 수 있는 숫자 정보가 많은 중국식 손가락 숫자에 주목한다. 4와 10의 발음이 비슷하고, 지역에 따른 방언 때문에 중국인들은 의사소통 시 한 손 숫자 표현을 즐겨 사용한다. 그림 1에서 보듯 한 손으로 1-5까지 표현하는 일반적인 제스처와 달리 1-10까지 표현한다. 기존 국내에 소개된 각종 손가락 제스처 인식 연구는 대개 1-5까지 혹은 10을 포함한 6개 동작에 대한 인식인 것과 달리 중국식 숫자 제스처는 추가되는 4가지 동작과 1과 9, 7과 10 손 모양의 유사성이 더 난해한 문제를 야기한다.

우리는 본 논문에서 중국 실생활에서 폭넓게 사용되는 중국식 손 제스처에 대한 다단 형판 정합(Multi-stage Template Matching)을 제안한다. 형판 정합은 영상 인식에서 사용되는 가장 단순한 형태의 인식기로서 형판과 영상 간 픽셀 단위 비교 오차를 최소화하는 형판을 근거로 물체를 인식하는 방법이다.

일반 형판 정합은 중국식 손 숫자 인식에서 발생하는 낮은 인식률을 해결하기에 역부족이라 형판 정합 전 10개의 클래스를 두 개의 그룹으로 분류하는 단계와 각 그룹 내 줄어든 클래스에 대해 형판 정합을 시도하는 단계로 인식률 개선을 시도한다.

Ⅱ. 관련 연구

동심원을 이용한 손 제스처 인식은 가장 일반적인 방법이다. 이 방법은 손바닥의 중심에 대한 손의 내접원과 외접원을 계산하고 두 원의 반지름 사이 임의 값을 반지름으로 삼는 가상의 원을 상정한다. 이때, 펼쳐진 손가락과 이 가상의 원 둘레의 교차점을 확인, 손가락 개수를 확인한다[4]. 정교함을 더하기 위해 2개의 가상 원을 이용하기도 한다[5]. 또 다른 방법은 손끝을 검출함으로써 펼쳐진 손가락 개수를 추정하는 방법이다. 손끝 검출 방법에 따라 다양해지는데, 손의 윤곽에 대해 convex hull 알고리즘을 적용하거나[6], 손끝 부분을 형판으로 저장해 형판 정합을 시도하거나[7], 윤곽을 구성하는 세 연속점으로 각도를 계산, 특정 각도를 손끝으로 검출한다[8]. 위 방법을 심화 시킨 방법으로서 손끝 정보 외에 거리/ 각도 변화 그리고 손 영역의 화소 면적 등을 추가하거나[9], 손바닥 중심에서 윤곽을 구성하는 화소간 거리를 2차 좌표공간으로 변환시키는 거리 그래프를 이용해 펼쳐진 손가락 개수를 확인한다[10].

문헌상 확인되는 중국식 숫자 인식 연구가 몇 소개되나 부분적인 성과거나 낮은 인식률을 보인다. [11]이 중국식 숫자 중 1과 9를 길이 정보를 통해 인식하는데 두 클래스에 대한 인식률은 97.71%이다. [12]가 손가락의 각도를 이용해 2, 6, 8을 판별하며 세 클래스에 대해 평균 95.83%의 인식률을 기록한다. 뒤이어 [6]이 손의 윤곽에서 convex hull 알고리즘으로 검출한 손끝과 손목 중심점의 상대적 위치를 특징점으로 지지 벡터 머신(Support Vector Machine)에 입력하여 10개 클래스에 대해 평균 86.30%의 인식률을 보고한다.

따라서 본 논문은 5, 6가지 손가락 제스처를 인식하는 기존 방법의 설계상 제약을 극복하고, 현재 86.30%로 보고된 중국식 한 손 숫자 인식률을 개선하는 새로운 인식 방법을 제안한다. 문헌 조사에서 발견되는 중국식 숫자 제스처 인식 연구 중 측면에서 촬영한 영상이나, RGBD 카메라의 깊이 정보를 활용하는 연구는 논외로 한다[13].

Ⅲ. 중국식 숫자 제스처 인식을 위한 다단 형판 정합

기존에 제안된 대다수의 연구가 펼친 손가락의 개수를 통해 이를 달성하므로 10가지 제스처를 표현하는 중국식 숫자에 대한 적용은 한계가 명확하다. 따라서 대부분의 연구는 중국식 숫자를 대상으로 한 성능을 제시하지 않는다. 반면에 우리는 영상 인식에서 가장 기본적인 방법인 일반적인 형판 정합을 기준선으로 삼고, 비교 클래스의 수를 줄여 성능 향상을 꾀하는 다단 형판 정합을 제안 후 결과를 확인한다. 둘째, 펼쳐진 손가락의 개수 파악으로는 동일한 손가락 개수를 갖는 중국식 숫자 1과 9를 구별하기 힘들며, 2, 6, 8도 역시 판별해 낼 수 없다. 또한 손가락을 모두 접는 7과 10의 구분도 불가능하다. 반면에 우리는 형판정합을 적용함으로써 손의 전체 형태를 이용하므로 오인식을 막는다. 또한 형판정합 직전에 손가락을 모두 접은 경우와 펼친 경우를 우선 분리함으로써 7과 10을 위한 별도 2 클래스 인식을 시도, 오인식을 최소화한다.

3.1 형판 제작

형판 정합이란 식 (1)에서 j개의 클래스별 형판, Tj 와, 입력되는 i개의 영상, Xi 간 화소 단위 편차의 절대값을 합산해 각 형판에 대한 오차, Ej 를 계산하고 최소 오차를 보이는 클래스를 판별하는 방법이다. 다량의 영상에 대해 두드러진 특징이 없거나, 별도 특징점 추출 없이 피사체의 형태를 활용하는 경우 효과적이다. 이때, 영상의 해상도 및 샘플링 포인트, 피사체의 크기 비율과 회전 정도를 동일화시켜야 한다.

| (1) |

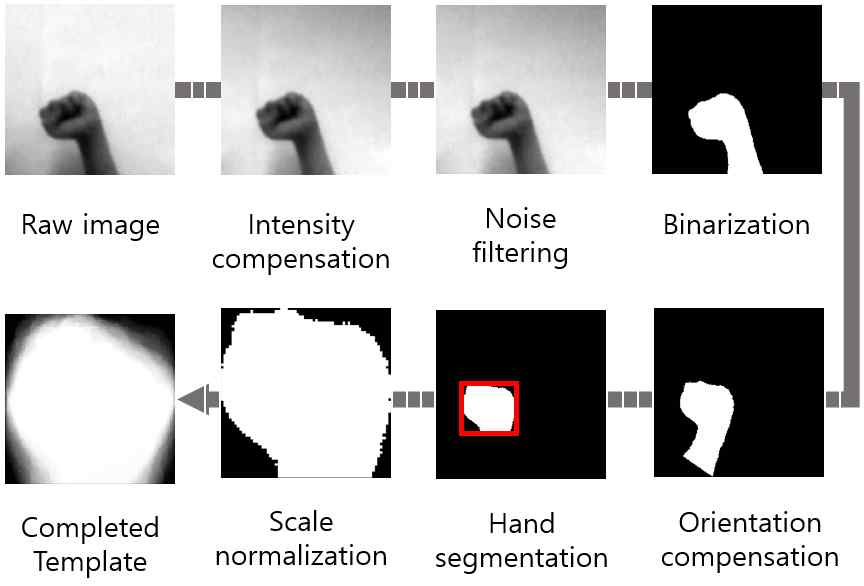

형판 정합에 있어서 핵심은 타 클래스와 변별되는 클래스별 형판 제작이다. 형판 제작을 위한 전처리 과정이 그림 2에서 제시된다. 각 단계의 자세한 설명은 다음과 같다.

다양한 조명 방향에 의한 밝기 그라데이션을 최소자승법을 통해 추정, 이를 원래 영상에서 제거하여 배경 조명을 균일화 시킨다.

Sobel filtering으로 미세한 잡음을 제거한다. 이후 최소 교차 엔트로피 문턱값을 이용[14], 전역 이진화를 실시하고 3x3 침식/ 팽창 연산을 실행한다. 끝으로 연결 성분 찾기를 통해 이진화시 발생한 오류를 보정한다. 이를 통해 손영역을 검출한다.

자세 각도 보정은 두 단계로 실시된다. 우선 영상의 네 변을 탐색하여 손목 시작 지역의 중앙점, 를 찾고, 거리변환 행렬을 이용하여 손의 중심, 를 검출한다. 식 (2)(3)을 이용, θ1을 계산 후 이를 보정한다. θ1은 대략적인 손의 자세 각도이며 θ1의 보정을 통해 영상 속 손의 국지 좌표 수직축을 영상의 전역 좌표 수직축과 일치시킨다. 이후 보정된 영상에 대해 주성분 분석을 실시, 주성분 축의 각도 θ2를 보정한다.

| (2) |

| (3) |

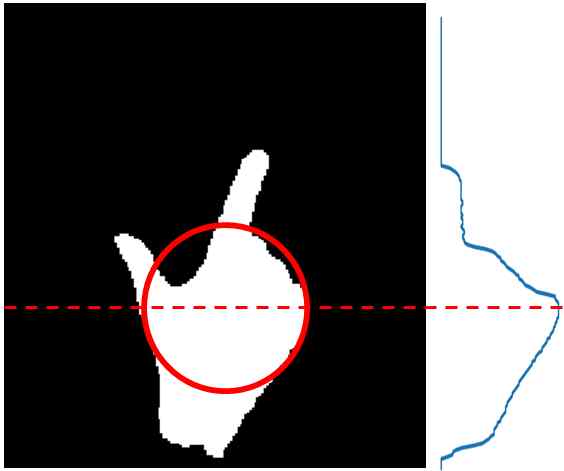

이진화를 통해 구한 손 영역에서 형판 정합시 불필요한 손목 영역을 제거한다. 그림 3은 가장 폭이 넓은 손바닥 구간을 수평 투사 막대 그래프 상 최대값으로 검출하는 과정을 설명한다. 이후 이 간격을 지름으로 하는 원을 그려 이를 손바닥 영역으로 간주하고 손목을 제거한다.

다양한 크기로 입력되는 손바닥 영역의 크기를 200 x 200으로 정규화시킨다. 크기/ 각도가 정규화된 이 손바닥 이진화 영상을 각 클래스별로 평균 내 클래스를 대표하는 형판으로 삼는다. 이를 통해 동일 클래스 내 발생하는 특이 영상에 대한 민감도를 감소시킨다. 가령 손가락 길이와 간격, 혹은 조명에 의한 그림자 등에 의해 왜곡된 영상의 오인식을 방지한다.

3.2 다단 형판 정합

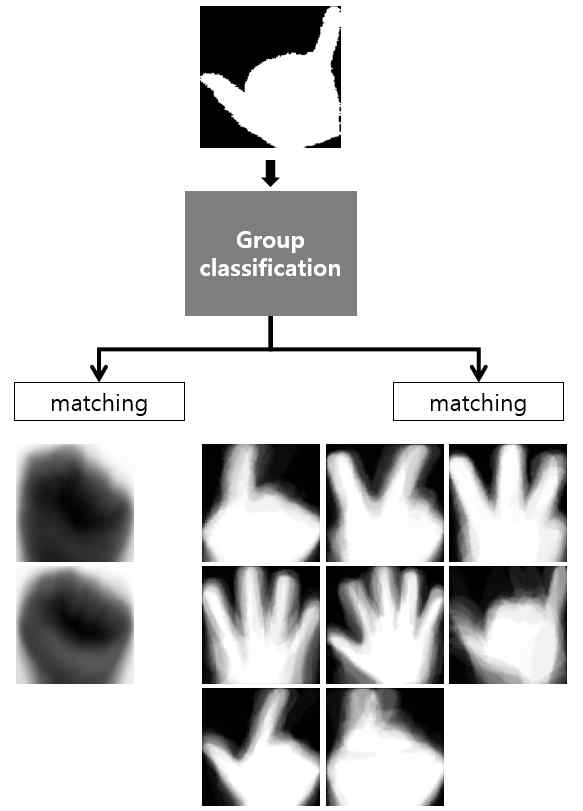

중국식 숫자 인식에 일반적인 형판 정합을 적용시, 모든 손가락이 접힌 7과 10 제스처가 오인식의 주요 원인이다. 왜냐하면 그림 2의 완성된 형판에서 보듯 다양한 손의 크기를 획일적으로 통일시키면서 가장 넓은 화소 면적을 손바닥 영역으로 갖는 7과 10이 타 클래스의 개별적 특징 발현을 억누른다. 특히 검지를 반으로 접은 9, 혹은 대다수 손가락을 편 4와 5가 자주 7과 10으로 오인식된다. 이를 위한 해결책으로써, 그림 4에서 보듯 손가락이 펼쳐진 Major 그룹(1, 2, 3, 4, 5, 6, 8, 9)과 손가락이 모두 접힌 Minor 그룹(7, 10)으로 형판을 분리시킨 후 해당 그룹 내에서 형판 정합을 실시하는 다단 형판 정합을 설계한다.

입력 영상은 그림 2처럼 크기/ 각도 보정 이진화 영상으로 변환되는데, 이때, 크기 정규화 직전에 계산된 손바닥 영역의 세로/가로 비율 혹은 외접원과 내접원의 반지름 비율에 근거하여 해당 제스처를 두 가지 그룹으로 분류한다. 세로/가로 비율은 손바닥 영역의 화소 좌표로 구한 공분산 행렬의 두 고유치 비율로 계산하며, 손에 대한 외/내접원 반지름 비율은 거리변환으로 구한 중점과 손 윤곽 간 거리 최대치와 최소치의 비율로 계산한다. Minor 그룹의 형판은 거시적 형태가 유사하나 국지적 패턴이 다른 7과 10의 특징을 활용하기 위해, 이진 영상 대신 그레이 스케일로 평균을 낸다.

다단 형판 정합을 통해 그룹을 우선 분할할 경우 7과 10이 별도로 묶여 사실상 2 클래스 인식 문제가 되므로 이들의 오인식 개선이 기대된다. 또한 7과 10이 4, 5, 9클래스와 분리됨으로써 이들의 오인식 개선 역시 가능하다. 끝으로 그룹 내에서 비교할 형판이 줄어 인식률의 전반적 향상이 기대된다.

Ⅳ. 실험 및 결과

4.1 실험 설계

우리가 제안하는 다단 형판 정합을 검증하기 위해, 기존에 제안된 방법과 일반적인 형판 정합, 다단 형판 정합의 성능을 비교한다. 이때, 그룹 분류의 기준으로서 세로/가로 비율과 외/내접원 반지름 비율 모두에 대해 인식 성능을 확인한다.

실험에 사용하는 영상은 피험자 17명으로부터 획득한 10개의 클래스에 대해 200장씩, 총 2000장의 중국 숫자 손 제스처이다. 200×200의 그레이 영상이며, 그림 5에서 보듯 손의 크기와 방향, 조명이 다양하며 손목의 노출 정도도 제각각이다.

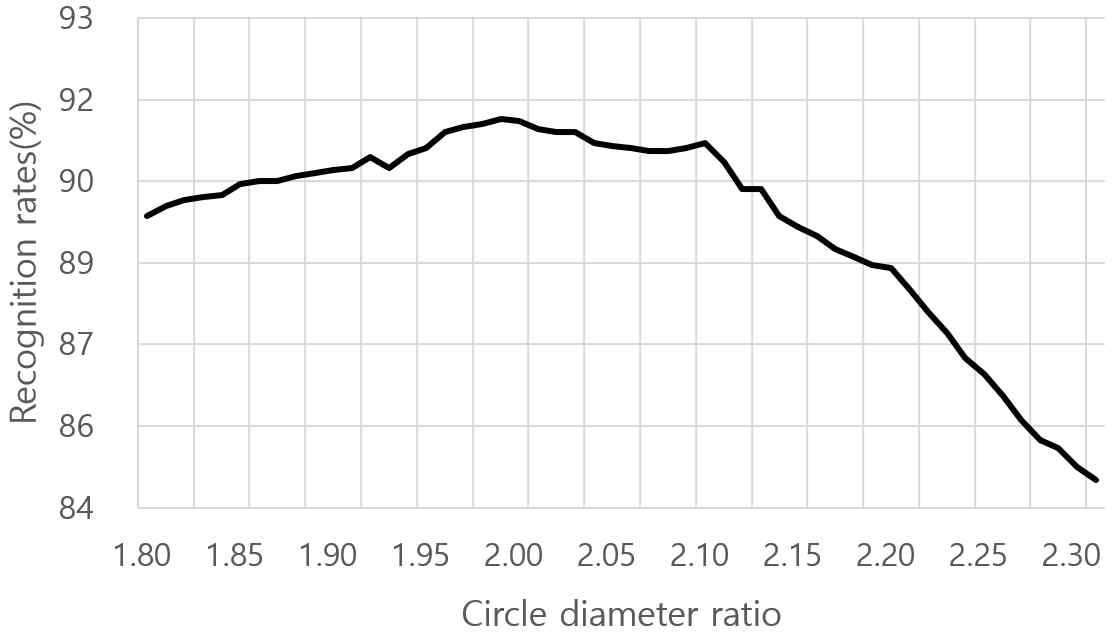

다단 형판 정합의 학습 단계에서 비율별 그룹 분류 최적 문턱값이 탐색된다. 비율별 최적 문턱값은 원 비율의 경우 1.72 - 2.31, 세로/가로 비율의 경우 1.1-1.41의 범위에서 0.01 간격으로 전역 검색된다. 이때 비용함수는 그림 6에서 보듯 각 문턱값에 의한 인식률이다. 이 과정에서 문턱값이 변할 때마다 계산되는 해당 비율의 클래스별 평균에 근거해 형판이 분류된다. 이후, 시험 단계에서 영상이 들어오면 입력 영상의 해당 손 비율에 따라 그룹 분류 과정과 그룹내 형판 정합 과정이 실행된다.

4.2 실험 결과 및 분석

우선적으로 성능 평가 실험에서 원 비율 다단 형판 정합이 세로/가로 비율 다단 형판 정합에 비해 10.35%, 일반 형판 정합에 비해 4.75% 높은 인식율을 기록한다. 표 1에서 세로/가로 비율 다단 형판 정합은 12.7%의 그룹 오분류율 포함 총 19.2%의 오인식율기록한 반면 원 비율 다단 형판 정합은 1.1%의 그룹 오분류율 포함 총 8.85%의 오인식율을 보인다. 오인식은 인식에 실패한 총 사례를, 오분류는 오인식 사례 중에서 Major/ Minor 그룹분류 실패로 인해 오인식한 경우이다.

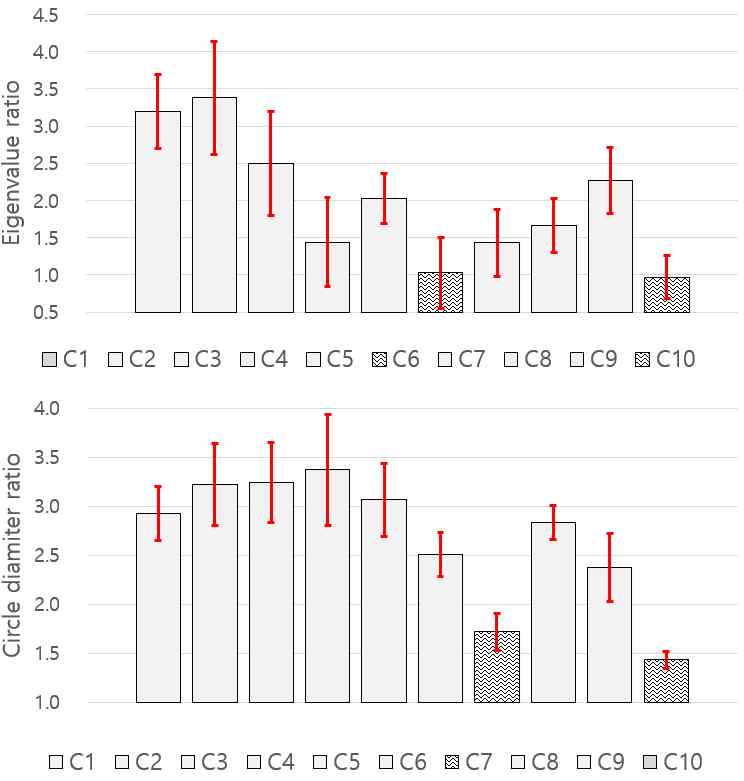

세로/가로 비율 다단 형판 정합이 그룹 내 형판 정합 인식율은 1.25% 높은 반면, 그룹 분류 성공률에서 원 비율 다단 형판 정합이 11.5% 높아, 인식률 격차를 벌인다. 주요한 원인이 그림 7에서 분석된다. 우선, 세로/가로 비율의 클래스 별 편차가 커 통계적으로 유의미한 그룹 분류가 난해하다. 둘째, 세로/가로 비율을 사용하면, 우리가 의도한 7과 10이 아닌 6과 10이 Minor 그룹으로 분류된다. 이럴 경우, 6과 10의 차별화된 손 형태로 인해 Minor 그룹 내 변별력은 1.65% 향상되나, Major 그룹 내 인식율이 7 클래스의 영향으로 0.4% 줄어, 총 형판정합 인식률이 1.25% 향상에 그친다.

표 2에서 손끝과 손목 중심점의 상대적 위치에 근거하여 지지 벡터 머신으로 분류하는 기존 방법과 우리가 제안하는 방법의 클래스 별 인식률을 제시한다. 원 비율 다단 형판 정합과 일반 형판 정합 간 최대 클래스 별 인식율 격차는 4번 클래스에서 나타난다. 그룹 분류로 인해 형판 비교군에서 7과 10이 제거되면, 전술하였듯 4, 5, 9의 손 영역 화소 면적 외 개별적 특성이 강화되기 때문이다. 이들은 모두 각각 26%, 10%, 5%씩 인식률이 향상된다. 유일한 7번 클래스의 10% 성능 하락은 10번 클래스의 16.5% 성능 향상과 결부된다. 원 비율 다단 형판 정합에서 7과 10은 그레이 스케일 형판을 사용하여 2 클래스 인식을 수행한다. 오차 분석결과는 두 경우 모두 7과 10은 타 클래스로 오인식된 경우가 없으며 두 클래스를 종합한 오인식은 일반 형판정합 67개에서 원 비율 형판정합 42개로 줄어든다.

Ⅴ. 결론 및 향후 과제

한 손으로 10개의 수를 표현하는 중국식 숫자 제스처 인식은 5, 6 개 클래스를 인식하는 기존 방법으로는 처리가 힘들며, 제스처 간 형태적 유사성으로 인해 낮은 인식률을 보인다. 본 논문은 이를 위해 두 단계에 걸쳐 진행하는 다단 형판 정합을 제안한다. 첫 단계에서 손 영역의 외/내접원 반지름 비율에 근거, 손가락을 편 제스처 그룹과 모든 손가락을 접은 제스처 그룹으로 분류하고 이후 각 그룹 내에서 독립적인 형판 정합을 실시한다. 피험자 17명으로부터 획득한 10개의 클래스, 2000장의 영상으로 검증한 성능은 평균 인식률은 91.15%이며, 이는 기존에 보고된 방법으로 획득한 인식률 79.95% 보다 11.2% 향상된 기록이다. 전반적인 성능 향상에도 불구하고 형태적 유사성에서 오는 고질적인 1과 9, 7과 10 혼동쌍 문제와 자세 각도 보정 실패로 인한 6번 클래스의 인식률 개선은 향후 과제로 남긴다.

References

-

Jeong-Hwan Hyun, and Dae-Seong Kang, "A Study on Hand Gesture Recogntion Algorith for Immersive Interface Implementation based on DTV and HNN", Journal of Korean Institute of Information Technology, 15(3), p99-104, (2017, Mar).

[https://doi.org/10.14801/jkiit.2017.15.3.99]

- Wonjong Yoon, Haengson Son, Seonyoung Lee, and Kyoungwon Min, "A Study on the Usability Test of Gesture Recognition for Smart TV", Proceedings of the Korean Institute of Communication Sciences Conference, 7A-1, p302-303, (2016, Jan).

- Seok-Woo Jang, "Developing Game Interface Using Robust Hand Segmentation", Journal of Korean Institute of Information Technology, 9(3), p57-65, (2011, Mar).

- Shin Jeong Hoon, "Finger Counting Using Computer Vision", Conference of the Korean Institute of Communication Sciences, p657-658, (2013, Jan).

-

Dong-Hyun Hwang, and Kyung-Sik Jang, "Finger-Gesture Recognition Using Concentric- Circle Tracing Algorithm", Korea Institute of Information and Communication Engineering, 19(12), p2956-2962, (2015, Dec).

[https://doi.org/10.6109/jkiice.2015.19.12.2956]

- Sang-Mu Lee, Mi-Hye Kim, and Jong Gwan Lim, "Finger Counting Recognition Using Hand Skeleton Model", HCI, p873-875, (2014, Feb).

- Jaewan Park, Dae Hyen Song, and ChilWoo Lee, "Real-time Finger Gesture Recognition", HCI, p847-850, (2008, Feb).

-

DoYeob Lee, DongKyoo Shin, and DongIl Shin, "A Finger Counting Method for Gesture Recognition", Journal of Korean Society for internet Information, 17(2), p29-37, (2016, Apr).

[https://doi.org/10.7472/jksii.2016.17.2.29]

- Ha-eun Ahn, and Jisang Yoo, "Finger Shape Recognition Algorithm in Geometrical Ways", Proceedings of the Korea Telecom Society Conference (Fall), p742-743, (2013, Nov).

-

Ji-Woo Song, and Jeong-Su Oh, "Finger Detection using a Distance Graph", the Korea Institute of Information and Communication Engineering, 20(10), p1967-1972, (2016, Oct).

[https://doi.org/10.6109/jkiice.2016.20.10.1967]

-

Ping Lee, Hee-seong Lee, and Mi-hye Kim, "Classification Method of Chinese a Hand Numeric Representation to No.1 and No.9 Using Length Information", Korea Entertainment Industry Association, 6(4), p129-135, (2012, Dec).

[https://doi.org/10.21184/jkeia.2012.12.6.4.129]

-

Ping Lee, Mi-hye Kim, and Hee-seong Lee, "Recognition Method of Chinese Finger Number 2, 6, 8 Using Angle Information", Journal of Korea Game Society, 12(6), p121-130, (2012, Dec).

[https://doi.org/10.7583/jkgs.2012.12.6.121]

-

Zhao Qian, Li Yawei, Zhu Mengyu, Yang Yuliang, Xiao Ling, Xu Chunyu, and Li Lin, "Max-Pooling Convolutional Neural Network for Chinese Digital Gesture Recognition", Information Technology and Intelligent Transportation Systems, Springer, p79-89, (2017).

[https://doi.org/10.1007/978-3-319-38771-0_8]

-

Mateusz Malik, Przemyslaw Spurek, and Jacek Tabor, "Cross-Entropy Based Image Thresholding", Schedae Informaticae, 24, p21-29, (2015).

[https://doi.org/10.4467/20838476SI.15.002.3024]

2018년 2월 ~ 현재 : 목원대학교 지능로봇공학과(재학중)

관심분야 : HRI, 머신러닝, 로봇 제어

2018년 2월 ~ 현재 : 목원대학교 지능로봇공학과(재학중)

관심분야 : HRI, 머신러닝, 영상처리

2016년 2월 : KAIST 기계공학(공학박사)

2017년 3월 ~ 현재 : 목원대학교 지능로봇공학과 교수

관심분야 : HRI, 영상/신호처리