웨이블릿 변환 영역의 부대역 정보를 이용한 가시광 및 근적외선 영상 합성

초록

본 논문에서는 가시광 및 근적외선 영상을 촬영하고 Cohen-Daubechies–Feauveau 9/7을 이용한 웨이브릿(wavelet) 변환영역에서 부대역(subband) 에너지 분포를 이용하여 두 영상을 합성하는 방법을 제시한다. 제안한 영상 합성 방법은 영상 부대역 변환, 계층 분할, 다중 대역 합성 후 색채 보상 단계로 이루어지고, 가시광 및 근적외선의 다중 대역 영상 합성을 위한 부대역 가중치 맵을 제안한다. 제안한 방법은 실험결과에서 자연스러운 경계 표현에서 기존의 방법보다 우수함을 나타내었다. 또한 특수 센서를 사용하지 않고 나란하게 연결한 듀얼 카메라를 사용하여 실시간 영상 촬영 및 합성이 가능하다는 점에서 빠른 처리 속도와 활용도 면에서 강점을 보인다.

Abstract

In this paper, we propose the method of taking visible light and near-infrared images and synthesizing the components of images using the subband energy distribution of Cohen-Dauvechies–Feauveau 9/7 wavelet transform. The proposed image synthesis method consists of wavelet subband transform, layer separation, multi-layer image synthesis, and color compensation stages. Moreover the subband weight map is proposed for image synthesis of visible light and near-infrared multiple bands. It is shown that the proposed method is superior to the existing method in natural boundary expression. In addition, it shows its strength in fast processing speed and utilization in that it is possible to shoot and synthesize images in real time using side by side dual cameras without using special sensors.

Keywords:

image fusion, visible and near-infrared image, tone compression, high dynamic rangeⅠ. 서 론

CCTV(Closed Circuit Television)는 감시 역할을 온전히 수행하기 위해 어떠한 상황, 공간, 조명 상황에서도 충분한 영상 정보를 제공해야한다. 지금까지의 감시카메라는 성능 향상을 위해 적외선 보조램프, 고해상도 및 고감도 이미지 센서 등 다양한 기술들을 활용하고 있다. 그러나 이러한 방법들은 고비용이 들고 추가적인 장치가 필요하기 때문에 구현성 및 활용성 면에서 불리한 단점이 있다. 또한, CCTV는 일반적으로 가시광이 충분한 낮과 같은 상황에서는 렌즈에 들어오는 적외선을 차단 필터로 제거한 가시광 영상만을 촬영한다. 반대로 가시광이 충분하지 않은 밤의 경우 적외선 보조광을 이용하여 적외선 영상을 촬영한다. 근적외선은 가시광선보다 산란성이 적기 때문에 근적외선 영상은 가시광 영상보다 안개, 그늘진 곳에서 더 선명하고 경계가 뚜렷한 영상을 얻을 수 있다[1]. 따라서 가시광 대역의 영상에서 촬영하지 못하는 많은 정보를 포함하고 있는 근적외선 영상을 이용하여 더 선명하고 질 높은 영상을 얻을 수 있지만, 근적외선 영상은 색채정보를 담고 있지 않다.

본 논문은 나란하게 연결한 듀얼 카메라를 이용하여 취득한 근적외선 영상과 가시광 영상의 합성을 통해 선명도와 색표현력이 우수한 영상을 만드는 알고리즘을 제안한다. 제안하는 알고리즘은 특수한 센서를 사용하지 않고 고품질의 영상을 얻을 수 있기 때문에 접근성과 활용도가 높다. 또한 웨이블릿(Wavelet) 변환 영역의 정보를 이용해 실시간으로 빠르게 결과 영상을 합성 할 수 있다[2]. 그러나 나란하게 연결한 듀얼 카메라를 이용하면서 두 카메라의 시야각의 차이가 발생하는 단점이 있다. 카메라 시야각의 차이는 가시광 영상과 근적외선 영상의 일치도를 낮추는 문제를 발생시킨다. 이러한 문제는 두 영상의 호모그래피 매칭(Homography matching)을 통한 정합 과정을 거치면서 개선 될 수 있다[3]. 최종적으로 합성된 영상은 자연스러운 경계 표현과 사물인식 부분에서 강점을 가진다.

본 논문은 2장에서 관련 연구에 대하여 소개하고, 3장에서 제안한 영상 취득 방법, 영상 정합 방법, 웨이블릿 변환을 이용한 영상 분해, 가중치를 이용한 합성, 및 채도 보상과 선명도 개선 방법을 설명한다. 마지막으로 4장에서 제안 방법에 대한 검증 및 성능 평가를 위한 실험 결과를 제시하고 기존의 Vanmali 등이 제안한 합성 방법과 비교 평가를 통해 제안 방법의 우수함을 확인한다[4].

Ⅱ. 관련 연구

2.1 가시광 영상과 근적외선 합성

가시광 영상과 근적외선 영상의 합성은 주로 디헤이즈(Dehaze)를 위해 연구된다. 안개에 의한 빛의 산란은 영상의 경계를 무너뜨리고 영상의 세부 정보를 손실시킨다. 감마 보정이나 히스토그램 평활화등의 단일 영상을 이용한 후보정 방식을 이용해 영상의 가시성을 향상시킬 수 있다. 그러나 이러한 방법은 근본적으로 입력 영상에 세부 정보가 잘 담겨있지 않기에 성능이 제한적이다. 이러한 문제를 해결하기 위해 근적외선 영상과 가시광 영상의 합성을 이용한 디헤이즈에 관한 연구가 활발하게 진행되고 있다[5]-[7]. 700 ~ 1400nm에 해당하는 파장 대역을 가지는 근적외선은 가시광선보다 안개 입자에 대한 침투성이 더 강하다. 따라서 안개나 연기가 많은 조건에서 근적외선 영상과 가시광 영상의 합성을 통해 선명하고 가시성이 좋은 영상을 재생할 수 있다. Vanmali 등은 국부 대비와 국부 엔트로피 및 가시성을 측정하여 가중치 맵을 만들어 가시광 영상과 근적외선 영상을 합성한 후 색상 및 선명도 보정의 과정을 거쳐 결과 영상을 합성하였다[4]. 본 논문에서는 웨이블릿 변환을 이용해 입력 영상을 기저성분과 세부성분으로 나눈 후, 가중치 맵을 이용해 영상을 합성하는 방법을 제시한다.

2.2 웨이블릿 변환

웨이블릿 변환은 음성, 통신, 영상처리 등의 다양한 분야에서 신호분석 처리를 위해 신호를 부대역(Subband) 성분으로 변환하여 다양한 분석 및 합성, 처리를 할 수 있게 한다[8]. 웨이블릿 변환과 푸리에(Fourier) 변환은 기저 함수들의 집합으로 신호를 분해하는 방법이라는 공통점을 가지지만 주기 함수를 기저함수로 사용하는 푸리에 변환과 달리 웨이블릿 변환은 국부적으로 존재하는 웨이블릿 패턴을 기저 함수로 사용한다. 영상에 웨이블릿 변환을 활용하기 위해서는 2차원 웨이블릿 변환을 활용해야한다. 2차원 웨이블릿 변환은 식 (1)로 표현된 1차원 웨이블릿 변환의 확장이라고 할 수 있다.

| (1) |

여기서 l(n)는 영상의 화소를 나타내고, h(k)는 고역통과 웨이블릿 필터를, g(k)는 저역통과 웨이블릿 필터를 나타낸다. N과 M은 저역통과와 고역통과 필터 계수의 개수를 각각 나타낸다.

식 (1)로 표현된 웨이블릿 변환 필터를 입력 영상에 열 방향, 행 방향에 각각 수행하는 것이 2차원 웨이블릿 변환이다. 2차원 웨이블릿 변환이 수행된 영상은 각 행과 열에 적용된 필터에 따라 4종류의 부대역 영상으로 나눌 수 있다.

공간 주파수의 영역에서 행과 열에 저역 통과 혹은 고역 통화 필터를 적용하며 4가지 대역 특성 영상을 표현 할 수 있으며, 그 중 행과 열에 모두 저역통과 필터가 적용된 부대역 영상은 세부 성분이 제거되고 대부분 기저성분만 포함하는 부대역 영상이 된다. 본 논문에서는 2차원 웨이블릿 변환을 이용해 입력 영상을 기저 성분과 세부 성분으로 분리한다.

Ⅲ. 제안 알고리즘

3.1 라즈베리파이 카메라 모듈(Raspberrypi camera module)을 이용한 영상 취득

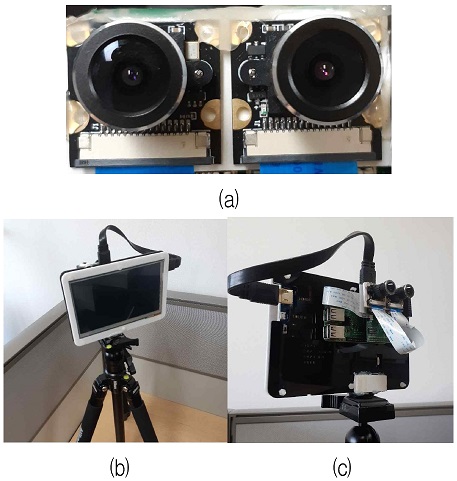

가시광 영상과 근적외선 영상의 취득에 있어 단일 카메라 시스템의 경우 영상 간 촬영 시간차가 발생할 수 있고, 피사체의 이동 등의 이유로 인해 두 영상의 일치도가 떨어질 수 있다. 이 경우 영상을 합성했을 때 피사체의 경계가 불분명해지고 블러링 문제가 발생하게 된다. 제안하는 알고리즘에서는 일치도가 높은 가시광 영상과 근적외선 영상을 동시에 취득하기 위해 그림 1과 같이 두 개의 나란한 라즈베리파이 카메라 모듈을 사용한다. 전체적인 구성에서 두 개의 라즈베리 카메라 모듈과 라즈베리파이 보드에 영상 디스플레이를 위한 모니터를 연결하였다. 가시광 영상과 근적외선 영상을 각각 얻기 위해 카메라 가시광 대역 렌즈와 근적외선 대역 렌즈를 각각 사용한다. 그림 2는 가시광과 근적외선 영상을 구현 장치로 촬영 후 합성 결과를 디스플레이하는 모습을 보여준다.

Implementation of a multi-camera system, (a) Two camera lenses placed side by side, (b) a monitor connected to dual camera, and (c) the rear view of the implementation device

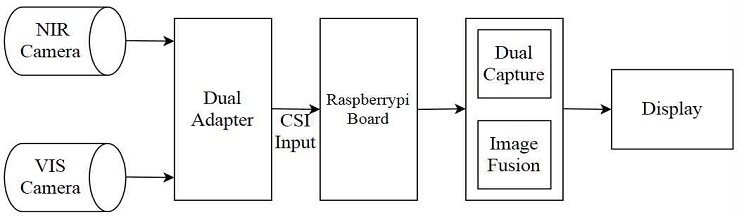

구현 장치의 동작 흐름은 그림 3과 같다. 각각의 카메라 센서에서 촬영된 가시광 영상과 근적외선 영상은 듀얼 어댑터(Dual adapter)를 통해 라즈베리파이 보드로 전달된다. 전달된 영상은 라즈베리파이 보드 내에서 성분 분리 및 합성이 이루어지고 합성된 영상은 장치의 디스플레이를 통해 송출된다.

3.2 호모그래피 매트릭스(Homography matrix)와 레티넥스 알고리즘(Retinex algorithm)을 이용한 영상 정합

두 입력 영상은 카메라의 광경로 차이로 인해 바로 합성 시 정합 오차가 발생하게 된다. 따라서 이 차이를 보상하기 위해서 호모그래피 매칭 기반의 알고리즘을 사용한다. 호모그래피 매칭은 3차원 공간상의 평면을 다른 시점에서 바라봤을 때 획득되는 영상의 관계를 특징점을 통해 파악해 호모그래피 매트릭스를 만들고, 이를 이용하여 두 영상의 정합을 맞추는 과정을 의미한다. 이는 식 (2)와 같이 표현할 수 있다[3].

| (2) |

여기서 H는 호모그래피 매트릭스를 의미한다.

식 (2)는 H로 표현된 호모그래피 매트릭스를 이용하여 입력 영상의 점 (x2,y2,1)을 (x1,y1,1)로 새롭게 매핑(Mapping)하는 과정을 나타낸다. ORB (Oriented FAST and rotated BRIEF) 알고리즘을 사용하여 특징점을 검출하고 이를 이용해 호모그래피 매트릭스를 만든다[9].

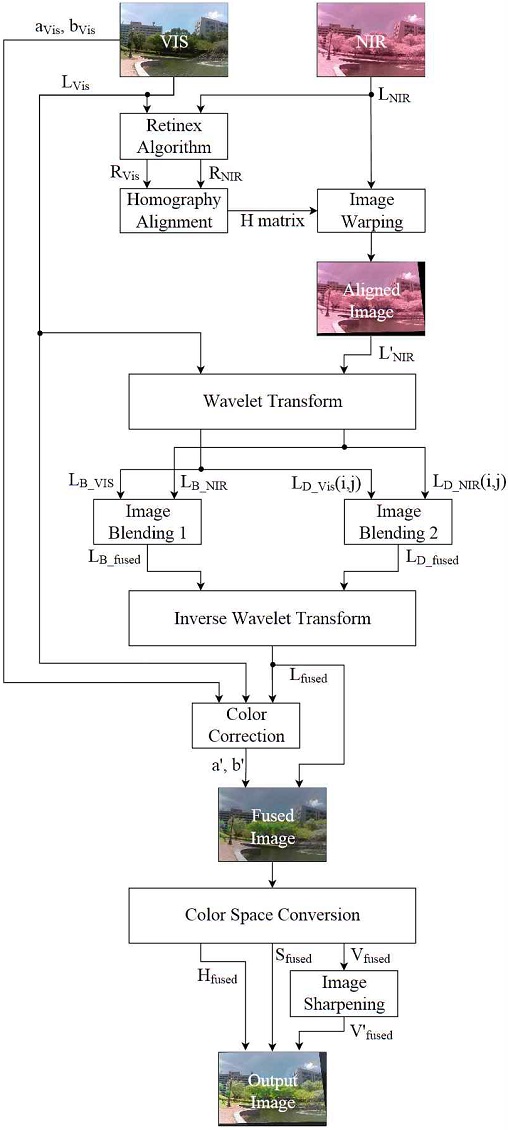

그림 4는 라즈베리파이 보드로 전달된 가시광과 근적외선 영상을 합성하는 과정을 나타내고 있다. 영상의 휘도, 채도 성분 분해, 공간 정합, 웨이블릿 변환, 기저 정보 및 세부 정보 융합, 웨이블릿 역변환, 색 보상, 및 색 공간 변환 과정으로 구성된다.

먼저, 취득한 가시광과 근적외선 영상을 CIELAB 색공간 변환을 통해 휘도 채널 L과 색 채널 a, b로 분리한다. 가시광 영상의 색 채널 aVis,bVis는 보존되어 색 보정(Color correction)을 거친 후 합성 영상의 색 채널로 사용된다. 두 영상의 공간적 시각차이 보상을 위한 영상 정합은 두 영상의 휘도 채널에서 이루어진다. ORB 알고리즘을 통해 두 영상의 휘도 채널의 특징점을 찾아 상호 비교를 통하여 good match points를 정한 후, 이를 이용하여 호모그래피 매트릭스를 구한다. 다음, 호모그래피 매트릭스를 이용해 근적외선 영상의 휘도 채널의 3차원 공간의 점을 이동시켜 정합된 영상을 생성한다.

호모그래피 매핑 시 두 영상의 특징점을 찾아 정확하게 비교하기 위해서는 영상의 밝기에 의한 영향을 최소화하는 것이 바람직하다. 따라서 레티넥스 알고리즘을 통해 영상의 국부 대비(Contrast)를 향상시키는 영상 전처리 과정을 거친다[10]. 식 (3)은 레티넥스 알고리즘을 나타낸다.

| (4) |

여기서 L(x,y)는 영상의 휘도 채널을 뜻하고 R(x,y)은 레티넥스 알고리즘을 적용한 결과 휘도 채널이다. G(x,y)는 가우시안 블러(Gaussian blur) 함수를 나타낸다[11]. K는 가우시안 함수의 최댓값의 크기를 1로 만들어 주기 위한 정규화계수이고 σ는 표준편차로서 영상의 블러 양을 조절한다. σ의 크기가 작을수록 영상의 디테일이 향상하지만 노이즈가 증가하며 영상 화질의 저하가 나타난다.

레티넥스 알고리즘은 가우시안 블러링을 거쳐 취득한 영상의 배경성분에 log를 취한 후 원 영상의 log를 취한 값에서 빼줌으로서 원 영상에서 배경성분을 제거할 수 있다. 레티넥스 알고리즘의 적용을 통해 영상의 정합 정확도를 높일 수 있다.

3.3 웨이블릿 변환을 이용한 휘도 영상 분해

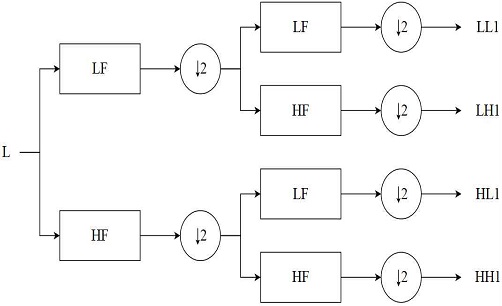

정합된 영상의 두 휘도 채널은 웨이블릿 변환된 영역에서 합성된다. 2차원 영상에 웨이블릿 변환을 구현 하는 방법을 그림 5에서 나타내고 있다.

그림 5에서 L은 일반적인 휘도 채널을 뜻하고 LF(lowpass Filter)는 저역통과 필터, HF(Highpass Filter)는 고역 통과 필터를 뜻한다. ↓2로 표현된 블록은 입력 영상이 각 필터를 거치며 픽셀의 개수를 절반으로 줄이는 것을 나타낸 것이다. LL1, LH1, HL1, HH1은 결과 부대역 영상을 나타낸다. 공간 주파수의 영역에서 LL1은 2차원 영상의 행과 열에 저역통과 필터를 적용한 것을, LH1은 행에는 저역 통과 필터를 열에는 고역 통과 필터를 적용한 것을, HL1은 열에는 저역 통과 필터를 행에는 고역 통과 필터를 적용한 것을, HH1은 2차원 영상의 행과 열에 고역통과 필터를 적용한 부대역 영상을 의미한다.

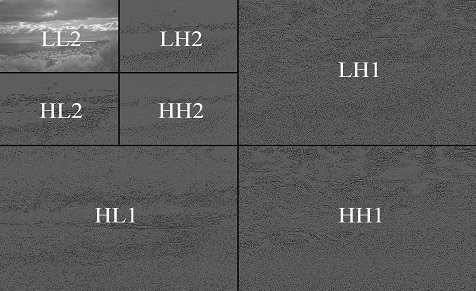

여기서 입력 영상의 세부(detail) 성분과 기저(base) 성분을 더 세밀하게 분리하기 위해 웨이블릿 변환의 첫 단계 부대역 영상 중 LL1에 2단계 웨이블릿 변환을 실행하여 LL2, LH2, HL2, HH2의 결과 영상을 얻는다. 결과 영상은 그림 6과 같다. 본 논문에서 가시광 영상과 정합된 근적외선 영상의 휘도 합성을 위해 Cohen- Daubechies–Feauveau 9/7 웨이블릿 변환을 이용한다. 분해된 기저 영상과 세부 영상은 다음 단계에서 각 휘도 채널은 가중치 맵을 통해 합성된다[12]-[14].

그림 4에서 웨이블릿 변환된 휘도 채널이 LB_Vis, LB_NIR, LD_Vis(i,j), LD_NIR(i,j)로 표기되었다. LB는 가시광과 근적외선 영상의 기저층(base layer)에 해당하는 휘도 채널로서 그림 6의 LL 부분에 해당한다. LD_Vis(i,j) 와 LD_NIR(i,j)는 가시광과 근적외선 영상의 세부층(detail layer)부분이다. 여기서 i는 부대역 depth number로 0과 1의 값을 가진다. i=0은 그림 4에서 LH1, HL1, HH1 등 1단계 웨이블릿 변환 층(layer)을 i=1은 LH2, HL2, HH2 등 2단계 웨이블릿 변환 층을 나타낸다. j는 대역 필터 종류를 나타내며 0, 1, 2 값은 각각 LH, HL, HH를 의미한다.

3.4 가중치 맵을 이용한 휘도 영상 합성

근적외선 영상과 가시광 영상의 부대역 합성을 위해 웨이블릿 계수 가중치 맵을 사용한다. LL을 제외한 모든 세부층은 계수 정보량에 따라 가중치를 두어 합성한다. 식 (4)와 같이 가중치 맵을 정의한다.

| (4) |

여기서 가시광(Vis, visible) 및 근적외선(NIR, near infrared)에 대한 국부적인 정보맵 wmap은 각각의 세부층에 가우시안 블러링을 적용하여 정의된다.

가중치 wmap은 세부층에 국부적으로 detail 정보가 더 많이 포함될 경우 값이 높아진다. 합성 영상의 세부층에서 LD_fused(i,j) 는 wmap값을 이용하여 식 (5)와 같이 합성한다.

| (5) |

웨이블릿 변환된 LD_Vis(i,j) 와 LD_NIR(i,j) 의 국부 정보량에 비례하여 LD_fused(i,j) 이 합성된다.

반면, 가시광 영상과 근적외선 영상의 베이스층(LB)에 대해서는 평균 합성을 사용한다. 휘도 채널의 합성 기저층 LB_fused 는 식 (6)과 같이 합성된다.

| (6) |

다음, 합성 기저층인 LB_fused 와 합성 세부층인 LD_fused 로부터 역 웨이블릿 변환(Inverse wavelet transform)을 통해 합성 휘도 채널 Lfused 로 결과영상이 변환된다.

3.5 휘도 변조 비를 이용한 채도 보상

두 영상의 휘도 채널을 합성에 의해 입력대비 출력 휘도가 변화할 경우, 채도 채널과의 불균형이 발생해 색 표현이 부자연스러워진다. 따라서 가시광 영상의 채도 채널(aVis, bVis)에 대해 합성 휘도 채널(Lfused)과 가시광 영상의 휘도 채널(LVis)의 비를 이용해 다음과 같이 채도 보상을 실행한다.

| (7) |

| (8) |

여기서 CC는 가시광 휘도 채널에 대한 합성 휘도 채널의 비이다. 식 (7)에서 블랙레벨(Lfused= 0)의 경우 보상 채도 성분은 없으나 CC 값이 발산되는 것을 막아주기 위해 분모에 채도 보상 값에 크게 영향을 주지 않는 임의의 값(0.001)을 더해준다.

식 (8)처럼 가시광 영상의 채도 채널(aVis, bVis)에 CC를 곱해서 휘도 변조에 대한 채도 보상을 수행한다. 이 때 채도 채널 범위의 중앙값을 0으로 만들기 위해 128을 빼준 후 CC를 곱하며 다시 128을 더하여 중앙값이 128인 균일하게 분포된 채도 채널을 얻을 수 있다. 채도보상을 통해 얻어낸 채도 채널(aʹ,bʹ)과 합성 휘도 채널(Lfused)로 부터 합성 영상을 도출한다.

3.6 영상 선명도 개선

영상 합성 이후 영상 선명도 개선을 위해 마스크필터를 적용하였다. 먼저 합성 영상의 명도(Value) 성분 처리를 위해 색공간 변경(Color space conversion)을 통해 합성 영상을 HSV(Hue-Saturation-Value) 채널로 변환한다. 영상은 색상(Hue), 채도(Saturation), 명도의 3채널로 분해되며 합성 명도 성분인 Vfused에 대해 다음 선명도 개선을 수행한다.

| (8) |

샤프닝 마스크와 합성 영상의 컨볼루션(Convolution) 연산을 통해 샤프닝 처리된 영상의 명도 채널 Vʹfused 를 구한다. 합성 영상의 색상 채널 및 채도 채널과 샤프닝 처리된 명도 채널을 결합하여 최종 결과 영상을 도출한다.

Ⅳ. 실험 결과

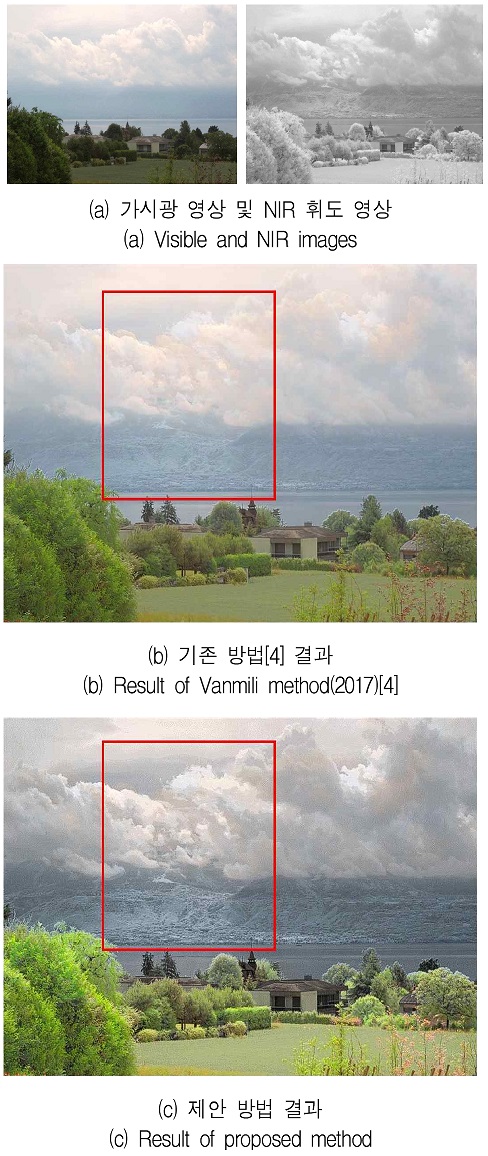

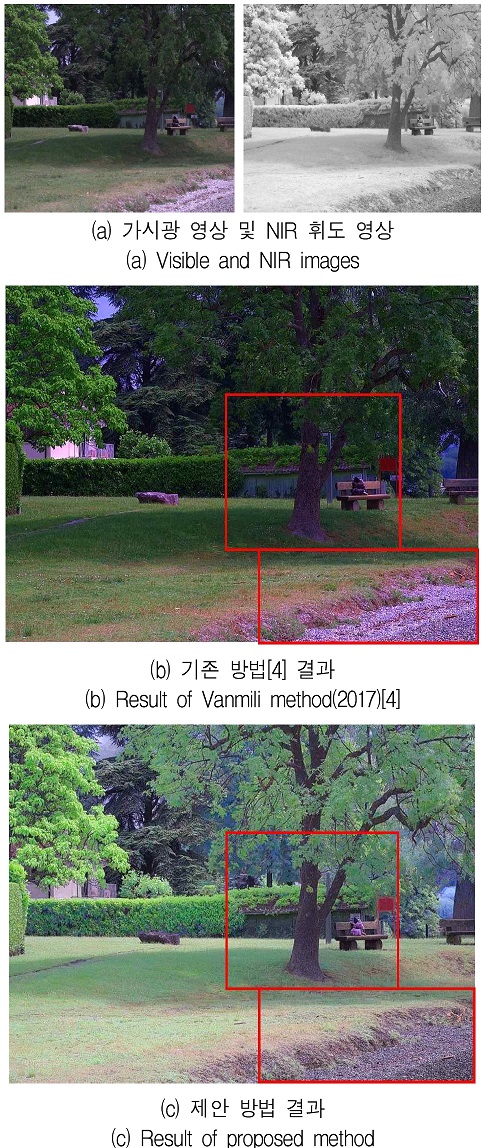

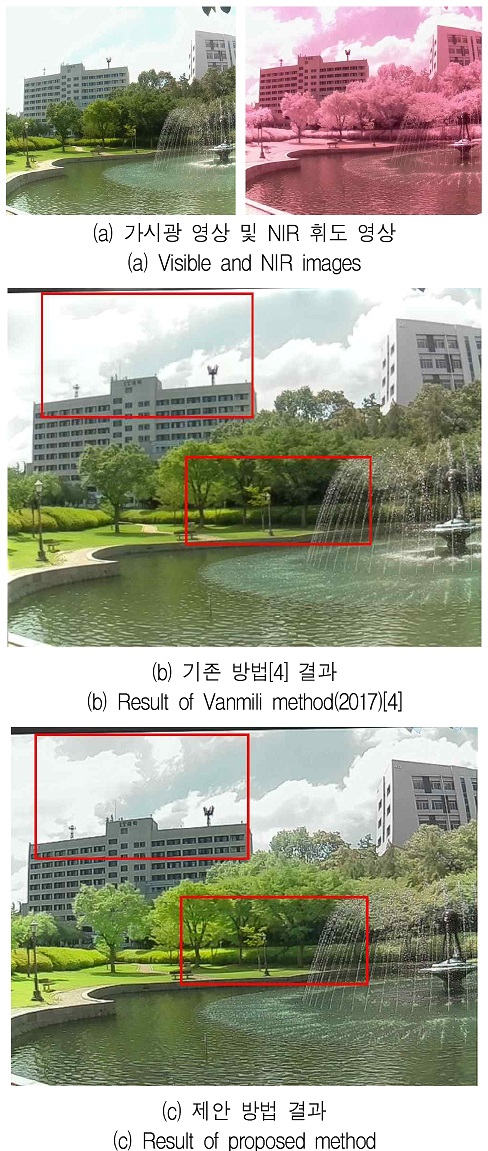

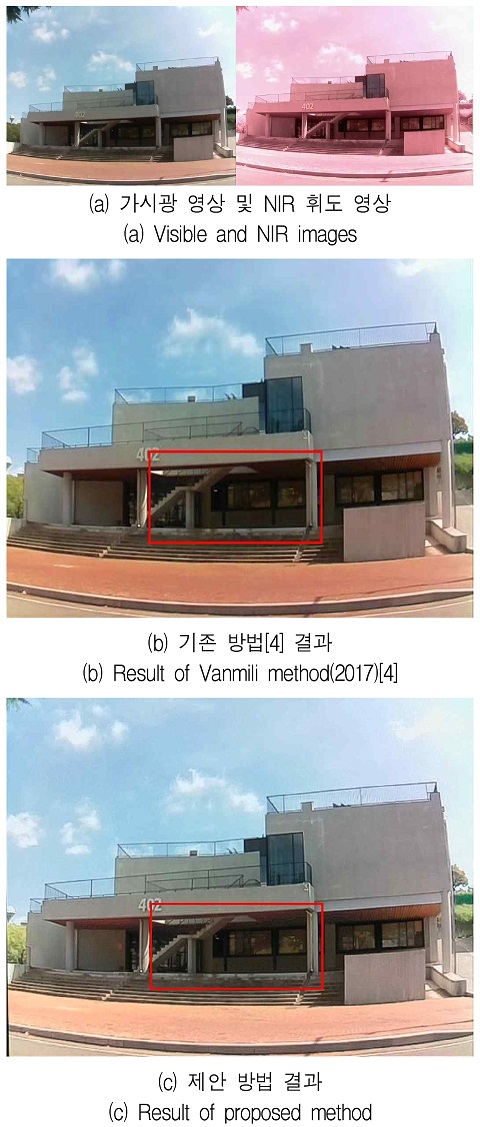

제안 알고리즘의 성능 평가를 위해 다양한 가시광 및 근적외선 영상을 합성하였다. 또한 구현한 라즈베리파이 카메라 모듈을 이용해 밝은 실외 환경에서 가시광 및 근적외선 영상을 촬영하고 합성하였다. 그리고 해당 영상을 이용하여 기존 Vanmali의 합성 방식과 비교 평가하였다[4]. 그림 7에서 그림 14까지 입력 가시광 및 근적외선 영상과 결과 영상들을 보여준다.

그림 7에서 Vanmili의 합성기법(b)에 비해 제안 방법(c)은 구름과 원거리의 산 부분에서 영상의 디테일 정보가 잘 담긴 것을 확인할 수 있다. 또한 색 표현이 자연스럽고 가시성이 우수하다.

그림 8에서 Vanmili 합성기법(b)의 결과 영상에서 나무, 벤치, 길 등을 포함하여 영상 전반에 걸쳐 붉은 색이 강하고 과채도 증상이 나타남을 확인할 수 있으며 화이트 밸런스가 정확하지 않는 등 원 영상과 다른 색 느낌을 보인다. 반면 제안 방법(c)는 어두운 영역의 디테일 잘 표현되었고 화이트 밸런스가 유지되어 색표현이 자연스럽다.

그림 9 및 그림 10은 직접 구현한 장치를 통해 실시간으로 취득한 영상의 정합 및 합성 결과이다. Vanmili 합성기법(b)는 구름 영역에서 포화가 발생하는 것을 볼 수 있고 명암 차가 큰 그늘 부분의 정보가 잘 나타나지 않는다. 반면 제안 방법(c)는 구름 영역에서 포화가 되지 않고, 영상 전반적으로 우수한 디테일 표현 성능을 보인다.

Ⅴ. 결 론

본 논문에서는 웨이블릿 변환 영역의 영상 정보를 이용한 가시광 및 근적외선 영상 합성 알고리즘을 제안하였다. 제안된 알고리즘은 기존의 대표적인 합성 방법인 Vanmali의 알고리즘의 비해 자연스러운 색 표현과 영상의 세부 정보 표현에 우수성을 보인다. 또한, 특수 센서를 사용하지 않고 구현한 카메라 모듈의 활용도 면에서 강점을 보이며, 장치의 구현을 통해 실시간으로 영상 촬영, 정합 및 디스플레이된 영상을 얻을 수 있다.

Acknowledgments

이 논문은 2019년도 정부(교육부)의 재원으로 한국연구재단의 지원을 받아 수행된 기초연구사업임 (NRF-2019R1D1A3A03020225)

References

-

Taeho Kil and Nam Ik Cho, "Image Fusion using RGB and Near Infrared Image", Journal of Broadcast Engineering, Vol. 21, No. 4, pp. 515-524, Jul. 2016.

[https://doi.org/10.5909/JBE.2016.21.4.515]

-

Jong Myeong Lim and Jisang Yoo, "Super-resolution Algorithm using Discrete Wavelet Transform for Single-image", Journal of Broadcast Engineering, Vol. 17, No. 2, pp. 344-353, Mar. 2012.

[https://doi.org/10.5909/JEB.2012.17.2.344]

-

Ueshiba, Toshio, and Fumiaki Tomita, "Plane-based calibration algorithm for multi-camera systems via factorization of homography matrices", International Conference on Computer Vision, Vol. 2, pp. 966-973, Oct. 2003.

[https://doi.org/10.1109/ICCV.2003.1238453]

-

A. V. Vanmali and V. M. Gadre, "Visible and NIR image fusion using weight-map-guided Laplacian–Gaussian pyramid for improving scene visibility", Sādhanā : Academy proceedings in engineering sciences, Vol. 42, No. 7, pp. 1063-1082, Jun. 2017.

[https://doi.org/10.1007/s12046-017-0673-1]

-

S. K. Nayar and S. G. Narasimhan, "Vision in bad weather", Proceedings of the Seventh IEEE International Conference on Computer Vision. Vol. 2, pp. 820-827, Sep. 1999.

[https://doi.org/10.1109/ICCV.1999.790306]

- Y. Y. Schechner, S. G. Narasimhan, and S. K. Nayar, "Instant dehazing of images using polarization", in Proceedings of the 2001 IEEE Computer Society Conference on Computer Vision and Pattern Recognition. CVPR 2001, Vol. 1, pp. I-325-I–332, Dec. 2001.

-

R. Fattal, "Single image dehazing", ACM Trans. Graph., Vol. 27, No. 3, pp. 1–9, Aug. 2008.

[https://doi.org/10.1145/1360612.1360671]

-

M. Antonini, M. Barlaud, P. Mathieu, and I. Daubechies, "Image coding using wavelet transform", IEEE Trans. Image Process., Vol. 1, No. 2, pp. 205–220, Apr. 1992.

[https://doi.org/10.1109/83.136597]

- E. Karami, S. Prasad, and M. Shehata, "Image Matching Using SIFT, SURF, BRIEF and ORB: Performance Comparison for Distorted Images", arXiv, Oct. 2017.

-

Wen Wang, Bo Li, Jin Zheng, Shu Xian, and Jing Wang, "A fast Multi-Scale Retinex algorithm for color image enhancement", in 2008 International Conference on Wavelet Analysis and Pattern Recognition, pp. 80–85, Aug. 2008.

[https://doi.org/10.1109/ICWAPR.2008.4635754]

-

D. Jobson, Z. Rahman, and G. Woodell, "Properties and performance of a center/surround retinex", IEEE transactions on image processing, Vol. 6, No. 3, pp. 451-462, Mar. 1997.

[https://doi.org/10.1109/83.557356]

- Zhong Guangjun, Cheng Lizhi, and Chen Huowang, "A simple 9/7-tap wavelet filter based on lifting scheme", Proceedings 2001 International Conference on Image Processing, Vol. 2, pp. 249-252, Oct. 2001.

-

Joong-Hee Lim and Inn-Ho Jee, "A Study on Enhancement of Digital Image Performance Using Dual Tree Wavelet Transformation in Non-separable Image Processing", JIIBC, Vol. 12, No. 1, pp. 65–74, Feb. 2012.

[https://doi.org/10.7236/JIWIT.2012.12.1.65]

-

Joong-Hee Lim, Jong-Hong Shin, and Inn-Ho Jee, "2D Digital Image Processing Using High Density Discrete Wavelet Transformation", JIIBC, Vol. 13, No. 1, pp. 1–8, Feb. 2013.

[https://doi.org/10.7236/JIIBC.2013.13.1.1]

2015년 3월 ~ 현재 : 경북대학교 IT대학 전자공학부 학부생

관심분야 : HDR, 영상 처리, 영상 융합, 이미지 센서, 아날로그 회로, 디지털 회로

2010년 2월 : 경북대학교 전자전기 컴퓨터학부(공학사)

2012년 2월 : 경북대학교 전자전기컴퓨터학부(공학석사)

2017년 9월 : 경북대학교 전자공학부(박사후 연구원)

2019년 8월 : 아진산업 선행연구팀 연구원

2019년 8월 ~ 현재 : 경북대학교 전자공학부 계약교수

관심분야 : Color Image Processing, Color Management HDR 영상처리, 적외선 영상처리, 인공지능

1997년 2월 : 경북대학교 전자공학과(공학사)

1999년 2월 : 경북대학교 전자공학과(공학석사)

1999년 2월 ~ 2004년 6월 : LG 전자 영상제품연구소 선임연구원

2008년 2월 : 경북대학교 전자공학과(공학박사)

2009년 8월 ~ 2017년 7월 : 경북대학교 IT대학 전자공학부 연구초빙교수

2018년 3월 ~ 현재 : 경북대학교 IT대학 전자공학부 교수

관심분야 : Color Image Processing, Color Appearance Model, Color Management, HDR 영상처리, 영상융합, 딥러닝영상처리